本讲主要说下逻辑回归的相关问题和具体的实现方法

1. 什么是逻辑回归

逻辑回归是线性回归的一种,那么什么是回归,什么是线性回归

回归指的是公式已知,对公式中的未知参数进行估计,注意公式必须是已知的,否则是没有办法进行回归的

线性回归指的是回归中的公式是一次的,例如z=ax+by

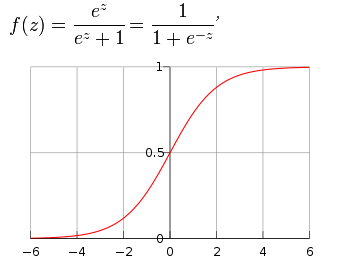

逻辑回归其实就是在线性回归的基础上套了一个sigmoid函数,具体的样子如下

2. 正则化项

引入正则化项的目的是防止模型过拟合,函数对样本的拟合有三种结果

欠拟合:直观的理解就是在训练集上的误差比较大,拟合出来的函数应该是曲线,结果拟合成了一条直线

过拟合:在训练集上的误差很小甚至为0,追求经验风险最小化,模型拟合的很复杂,往往在未知的样本集上表现的不够好

合适的拟合:在训练集合测试集上都表现的比较好,追求经验风险和结构风险的均衡

解决过拟合的问题一般有两种方法,一是减少特征的维度,二是进行正则化。对减少特征的维度我的理解是造成过拟合的原因是特征太多样本太少,所以进行特征选择以减少特征会得到比较好的拟合效果,下面详细说一下正则化。

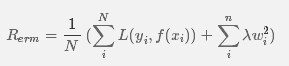

先看一下正则化的样子

其实就是在损失函数里加入一个正则化项,正则化项就是权重的L1或者L2范数乘以一个lamda,用来控制损失函数和正则化项的比重,直观的理解,首先防止过拟合的目的就是防止最后训练出来的模型过分的依赖某一个特征,当最小化损失函数的时候,某一维度很大,拟合出来的函数值与真实的值之间的差距很小,通过正则化可以使整体的cost变大,从而避免了过分依赖某一维度的结果。当然加正则化的前提是特征值要进行归一化,例如有的特征的范围是200-500,有个特征的范围是0-1,这个时候就要进行归一化,例如都化为0-1之间。

3. 最小二乘法和最大似然法

最小二乘法,感觉名字起的不好,不能一目了然,

本讲主要说一下逻辑回归中的几个问题和具体的参数求解方法1. 什么是逻辑回归2. 正则化项3. 最小二乘法和最大似然法4. java实现梯度下降法实验:样本:-0.017612 14.053064 0-1.395634 4.662541 1-0.752157 6.538620 0-1.322371 7.152853 00.423363 11.054677 00.

本讲主要说一下逻辑回归中的几个问题和具体的参数求解方法1. 什么是逻辑回归2. 正则化项3. 最小二乘法和最大似然法4. java实现梯度下降法实验:样本:-0.017612 14.053064 0-1.395634 4.662541 1-0.752157 6.538620 0-1.322371 7.152853 00.423363 11.054677 00.

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

420

420

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?