公众号每天更新5条大模型问题及解决方案

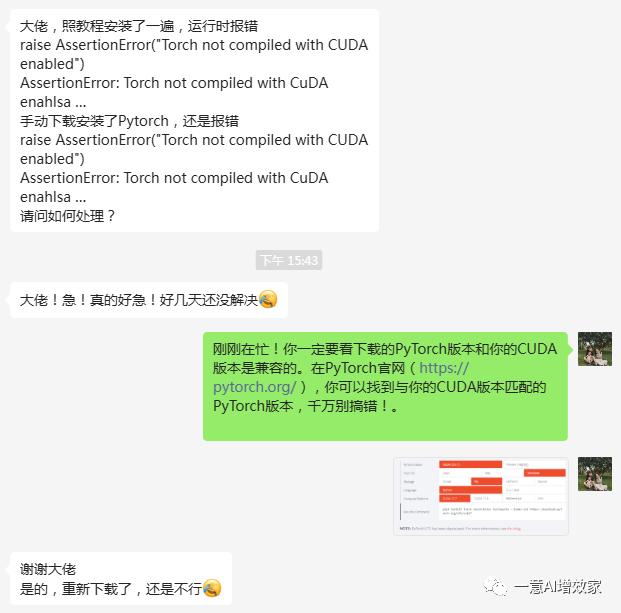

今天,在【NLP学习群】中,一位同学反馈,一直卡在cuda报错,无法部署大模型,重装也没用,一意专注部署前中后问题解决,专业对口了!

01 报错信息分析:

报错信息如下:

raise AssertionError("Torch not compiled with CUDA enabled")AssertionError: Torch not compiled with CuDA enahlsa …

报错分析:

这个报错提示是由于在运行需要使用CUDA(NVIDIA的GPU计算平台)的PyTorch代码时,但你的PyTorch安装没有启用CUDA支持所致。

出现这个问题的常见原因有两种:

-

未正确安装带有CUDA支持的PyTorch版本:你需要安装经过CUDA编译的PyTorch版本,而不是仅支持CPU的版本。通常在安装PyTorch时,CUDA版本的支持是可选的,并且需要选择与你的GPU驱动程序兼容的CUDA版本。

-

环境配置问题:即使你已经正确安装了CUDA版本的PyTorch,有时候可能在运行代码时会使用与CUDA支持不一致的环境(例如,如果你在一个不支持CUDA的环境中运行代码)。确保你在运行代码的机器上有可用的CUDA设备,并且PyTorch能够正确地访问它。

02 解决方案

a 首先,卸载 Torch 框架

pip uninstall torch torchvisionb 重新安装 Torch 框架并确保使用 CUDA 进行编译

pip install torch torchvision -f https://download.pytorch.org/whl/cu111/torch_stable.htmlc 如果你使用的是 Docker,那么你需要确保 Docker 环境中的 Torch 框架已经使用 CUDA 进行编译。你可以通过以下命令来检查 Torch 框架是否已安装:

docker run --rm -it nvidia/cuda:11.0-base nvidia-smid Torch 框架已经安装,你可以尝试重新部署 Docker 容器,确保使用 CUDA 进行编译:

docker run --rm -it nvidia/cuda:11.0-base nvidia-smi如果以上还未解决,那么!应该是环境变量问题,要更改变量

A 在安装 PyTorch 后,你需要将 PyTorch 的 bin 目录添加到 PATH 环境变量中。具体操作如下:

打开终端或命令提示符。输入以下命令,然后按 Enter 键:echo $PATH

这将显示当前 PATH 环境变量的值。

B 在显示的 PATH 环境变量值中添加 PyTorch 的 bin 目录。例如,如果你的 PyTorch 安装在 /path/to/pytorch 目录下,那么你需要将 /path/to/pytorch/bin 添加到 PATH 环境变量中:

输入以下命令,然后按 Enter 键:

export PATH=$PATH:/path/to/pytorch/bin 这将把 PyTorch 的 bin 目录添加到 PATH 环境变量中。

C 重新打开终端或命令提示符,输入以下命令,然后按 Enter 键:

echo $PATH 这将显示当前 PATH 环境变量的值,你应该会看到 PyTorch 的 bin 目录已经被添加到 PATH 环境变量中了。

至此!问题解决!

因为设备、目标不同,如果你的问题还没解决,可以公众号后台回复“问答3000条”进群,有更多同学帮你,也可以点公众号里的有偿1对1!

一意AI增效家

AI领域学习伴侣、大模型训练搭档、企服AI产品安全认证、专家培训咨询、企服知识图谱、数字人搭建

公众号

目前一意AI提供的价值主要在四个方面!

#1 高质量数据集

我搭建了一个数据共享交换平台,目前已收录中文对话、金融、医疗、教育、儿童故事五个领域优质数据集,还可以通过会员之间共享,工众后台:“数据集”下载。

#2 报错或问题解决

你可能像我们NLP学习群中的同学一样,遇到各种报错或问题,我每天挑选5条比较有代表性的问题及解决方法贴出来,供大家避坑;每天更新,工众后台:“问答3000条”获清单汇总。

#3 运算加速

还有同学是几年前的老爷机/笔记本,或者希望大幅提升部署/微调模型的速度,我们应用了动态技术框架,大幅提升其运算效率(约40%),节省显存资源(最低无显卡2g内存也能提升),工众后台:“加速框架”;

#4 微调训练教程

如果你还不知道该怎么微调训练模型,我系统更新了训练和微调的实战知识库,跟着一步步做,你也能把大模型的知识真正应用到实处,产生价值。

1178

1178

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?