在AI领域,概率论告诉我们什么样的算法是合理的。可以用概率、统计理论分析AI系统的行为。

为什么要用概率论?

1. 目标固有的随机性。

2. 不完全的观测。

3. 不完全的建模。(比如考虑计算性能)

随机数

概率分布

离散数和概率质量函数(PMF)

连续变量和概率密度函数(PDF)

边缘概率

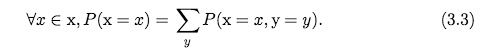

离散数的边缘概率

连续变量的边缘概率

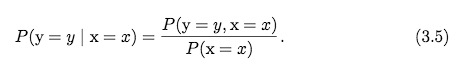

条件概率

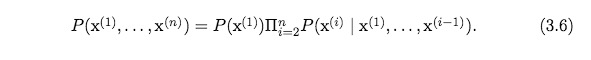

条件概率的链式规则

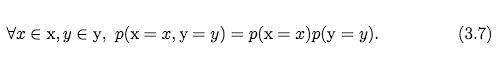

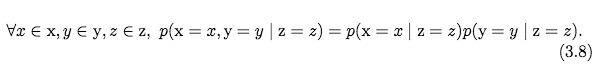

独立

条件独立

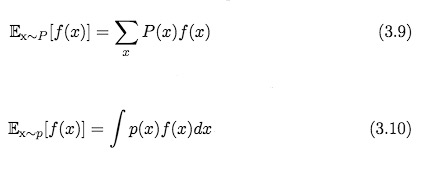

期望

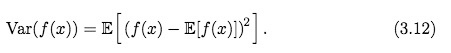

方差

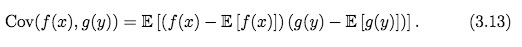

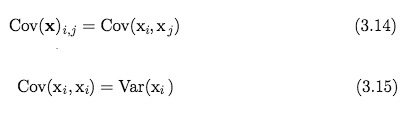

协方差

泊松分布(抛硬币)

多项式分布(掷骰子)

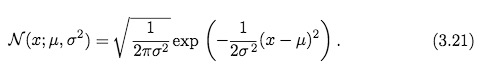

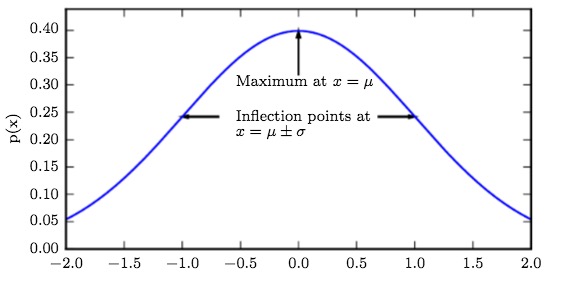

高斯分布(正态分布)

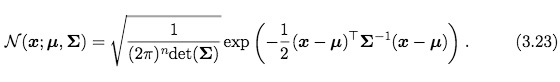

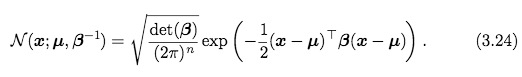

多元正态分布

多元正态分布,另一种写法:

指数分布和拉普拉斯分布

狄拉克分布和经验分布

混合分布

常用函数

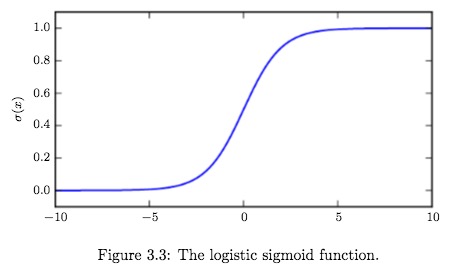

logistic sigmoid 泊松分布用它

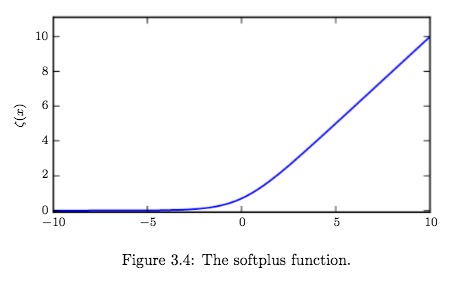

softplus 2001年

正态分布用它来生成β或者σ。

贝叶斯公式

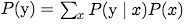

公式中的P(y)可以这样得到

连续变量的技术细节

信息论

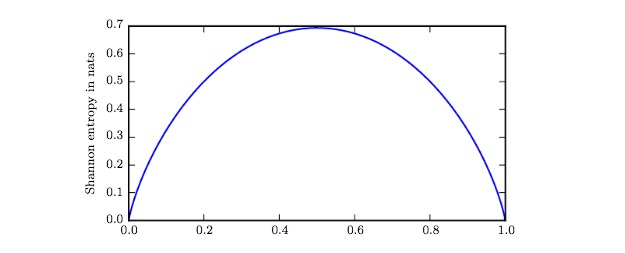

图中的函数为:(p −1)log(1−p)−p log p

越接近0,随机变量为0的几率越大,所以熵越小。约接近1,随机变量为1的几率越大,所以熵也越小。当p=0.5时,随机变量为0,1的可能性一样,所以熵最大。

KL距离,用来衡量对同一随机变量的两种概率分布方法的差异。交叉熵

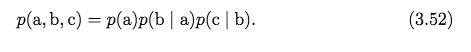

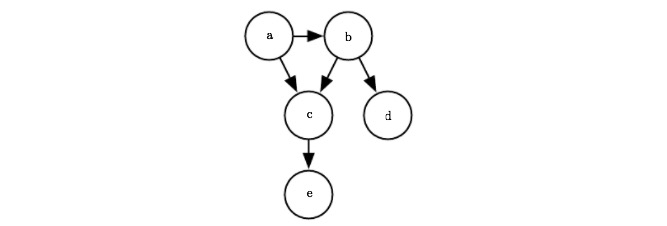

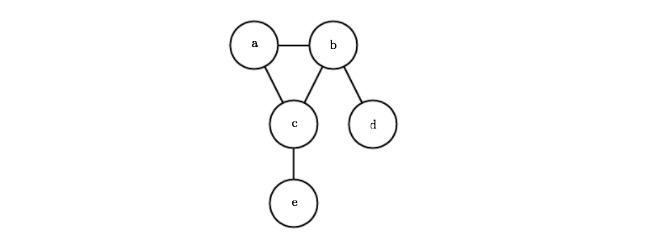

结构化概率模型(图模型)

三个随机变量a,b,c a影响b,b影响c,a和c是独立随机变量。

那么可以用下面的公式来分解概率模型:

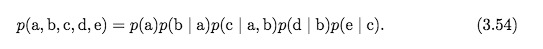

有向图表示的概率模型:

无向图表示的概率模型:

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?