深度神经网络以及正则化

前面我们介绍了简单的线性模型,但是它仍有局限性,接下来介绍非线性模型。首先介绍,偷懒的工程师最喜欢的非线性模型ReLU(Rectified Linear Units)

ReLU

ReLU的函数形式为:

f(x)=max(0,x)

它的导数也非常简单,小于0的时候,导数为0,大于0的时候,导数为1。

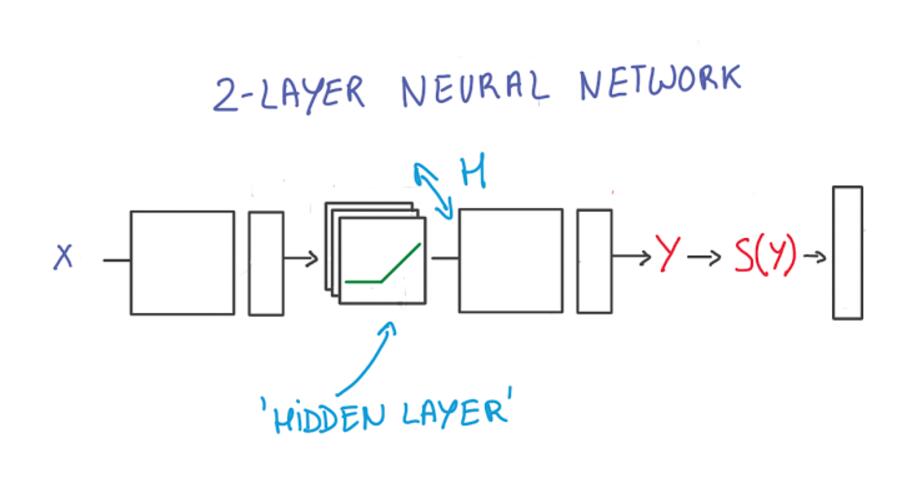

用ReLU在前面的逻辑分类器的基础上构建简单的非线性模型:

- 第一层由一组X的权重和偏差组成并通过ReLU函数激活。这一层的输出会提供给下一层,但是在神经网络外部不可见,因此称为隐藏层。

- 第二层由隐藏层的权重和偏差组成,隐藏层的输入即为第一层的输出,然后由softmax函数生成概率。

- H对应的是分类器中ReLU的个数,H越大,网络越复杂。

2-layer的神经网络只有乘法、加法和ReLU操作,深度学习可以实现这些操作,实现的关键就是:链式法则

链式法则

链式法则就是将上一层的输出作为下一层的输入,这种方法求导很方便。

例如:

[g(f(x))

本文介绍了深度学习中的非线性模型ReLU及其导数,阐述了2-layer神经网络的构建原理,重点讲解了链式法则在反向传播中的应用。此外,还探讨了防止过拟合的三种方法:观察验证集表现、L2正则化和Dropout技术。

本文介绍了深度学习中的非线性模型ReLU及其导数,阐述了2-layer神经网络的构建原理,重点讲解了链式法则在反向传播中的应用。此外,还探讨了防止过拟合的三种方法:观察验证集表现、L2正则化和Dropout技术。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

10万+

10万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?