背景

企业或个人会有很多资料,搜索相关内容时会很花时间,搭建本地知识库可以有效的解决这个问题。在centos7搭建基于 FastGPT 本地知识库。

部署流程

FastGPT 是一个基于 LLM 大语言模型的知识库问答系统,提供开箱即用的数据处理、模型调用等能力。同时可以通过 Flow 可视化进行工作流编排,从而实现复杂的问答场景!项目地址:github.com/labring/FastGPT

知识库搭建流程

1、安装docker

(1)卸载旧版本

yum remove docker \

docker-client \

docker-client-latest \

docker-common \

docker-latest \

docker-latest-logrotate \

docker-logrotate \

docker-engine

(2)、安装所需的安装包

yum install -y yum-utils

(3)设置国内镜像

yum-config-manager --add-repo http://mirrors.aliyun.com/docker-ce/linux/centos/docker-ce.repo

(4)、安装docker

curl -fsSL https://get.docker.com | bash -s docker --mirror Aliyun

(5) 安装 docker-compose

curl -L https://github.com/docker/compose/releases/download/v2.20.3/docker-compose-`uname -s`-`uname -m` -o /usr/local/bin/docker-compose

chmod +x /usr/local/bin/docker-compose

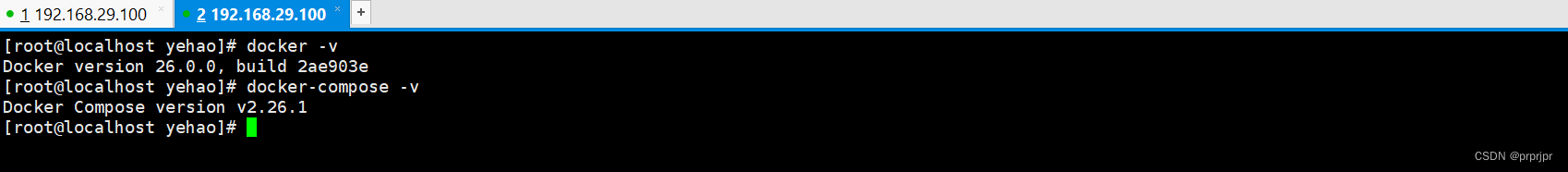

(6) 验证安装

docker -v

docker-compose -v

(7) 创建fastgpt目录

在/home下创建一个fastgpt

mkdir fastgpt

cd fastgpt

拉取文件两个文件

curl -O https://raw.githubusercontent.com/labring/FastGPT/main/files/deploy/fastgpt/docker-compose.yml

curl -O https://raw.githubusercontent.com/labring/FastGPT/main/projects/app/data/config.json

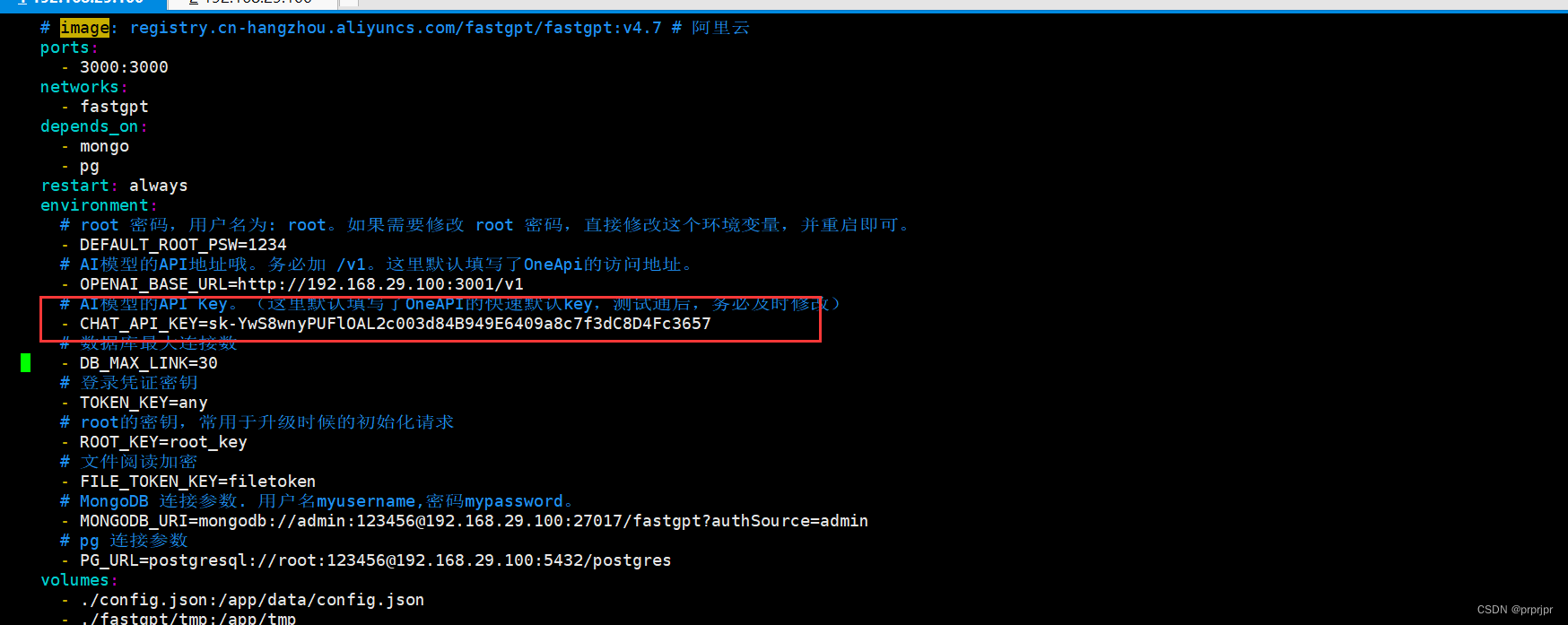

vim docker-compose.yml

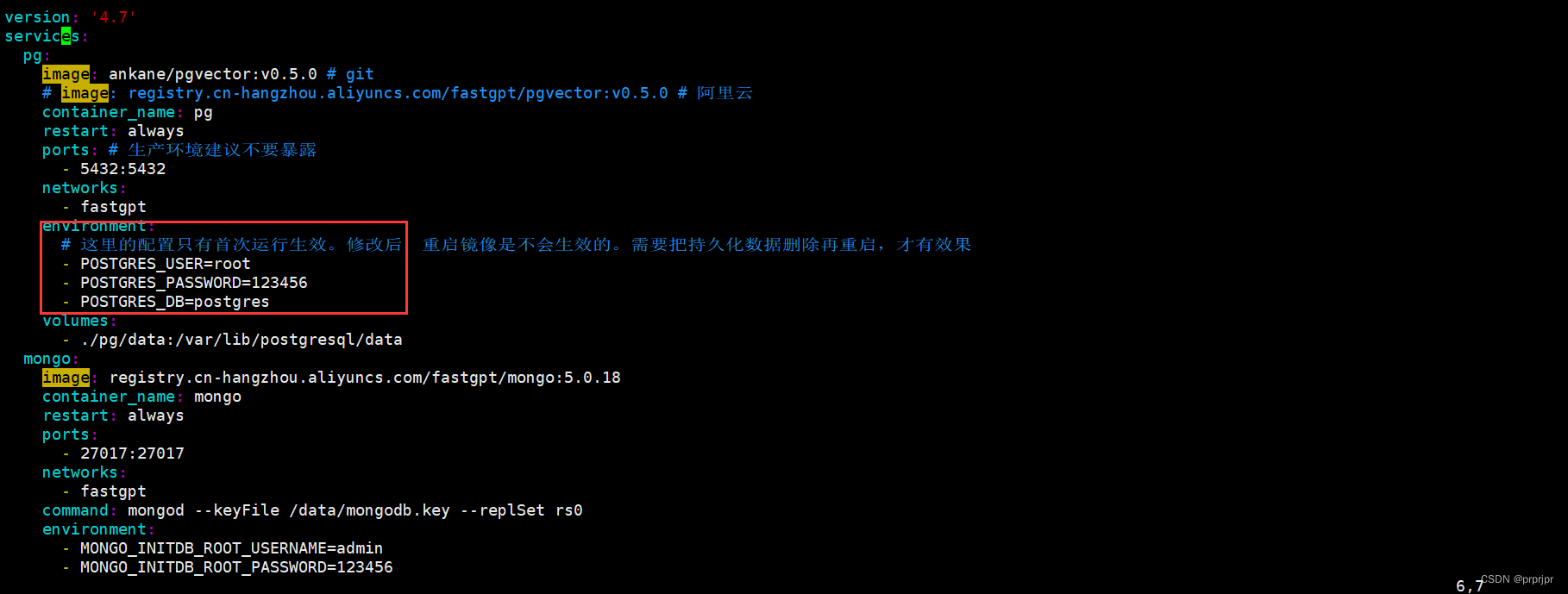

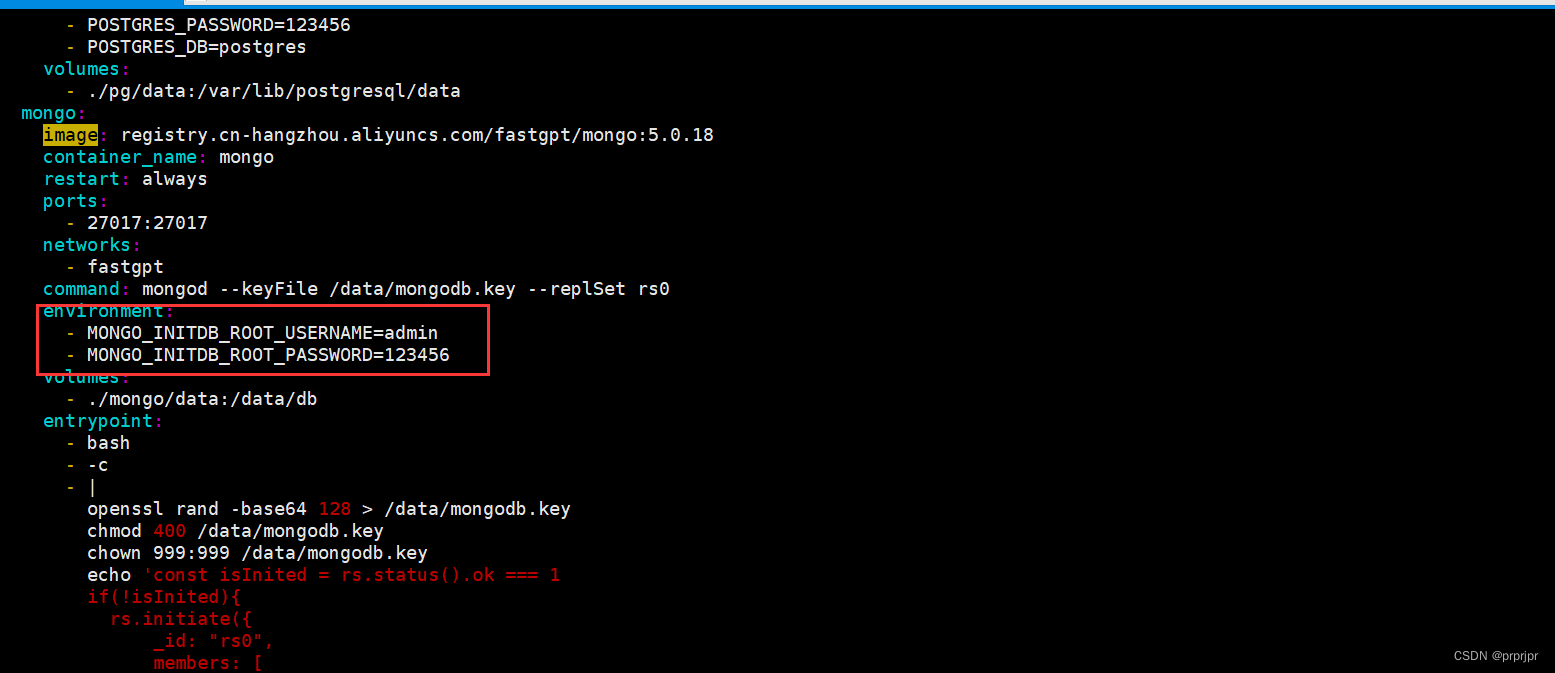

1、设置pg向量库用户名和密码

2、设置mongodb 用户名和密码

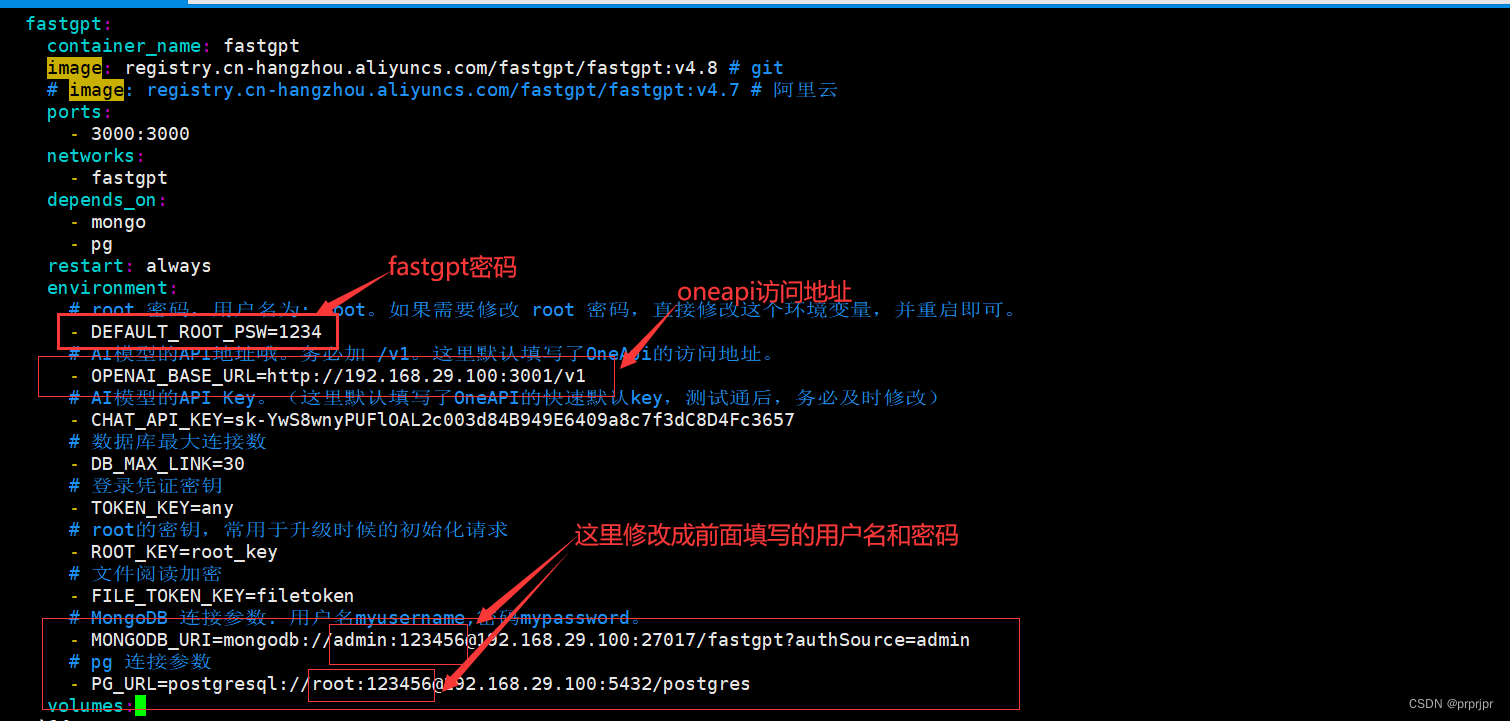

3、需要特别注意修改的地方

4、启动容器,等待镜像拉取结束

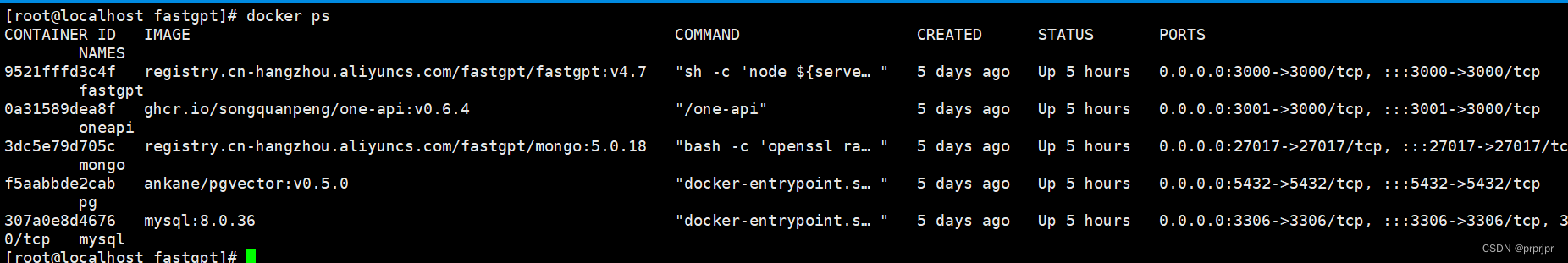

docker-compose up -d

所有容器启动成功后就可以发访问fastgpt了

(8)访问fastgpt

通过 ip:3000 直接访问。登录用户名为 root,密码为docker-compose.yml环境变量里设置的 密码。

(9) centos 安装ollama

curl -fsSL https://ollama.com/install.sh | sh

然后通过ollama里下载相应的模型

如qwen:4b,qwen:8b和向量模型 haw/dmeta-embedding-zh:latest

ollama run qwen:4b

ollama run qwen:8b

ollama run llama3:8b

haw/dmeta-embedding-zh:latest

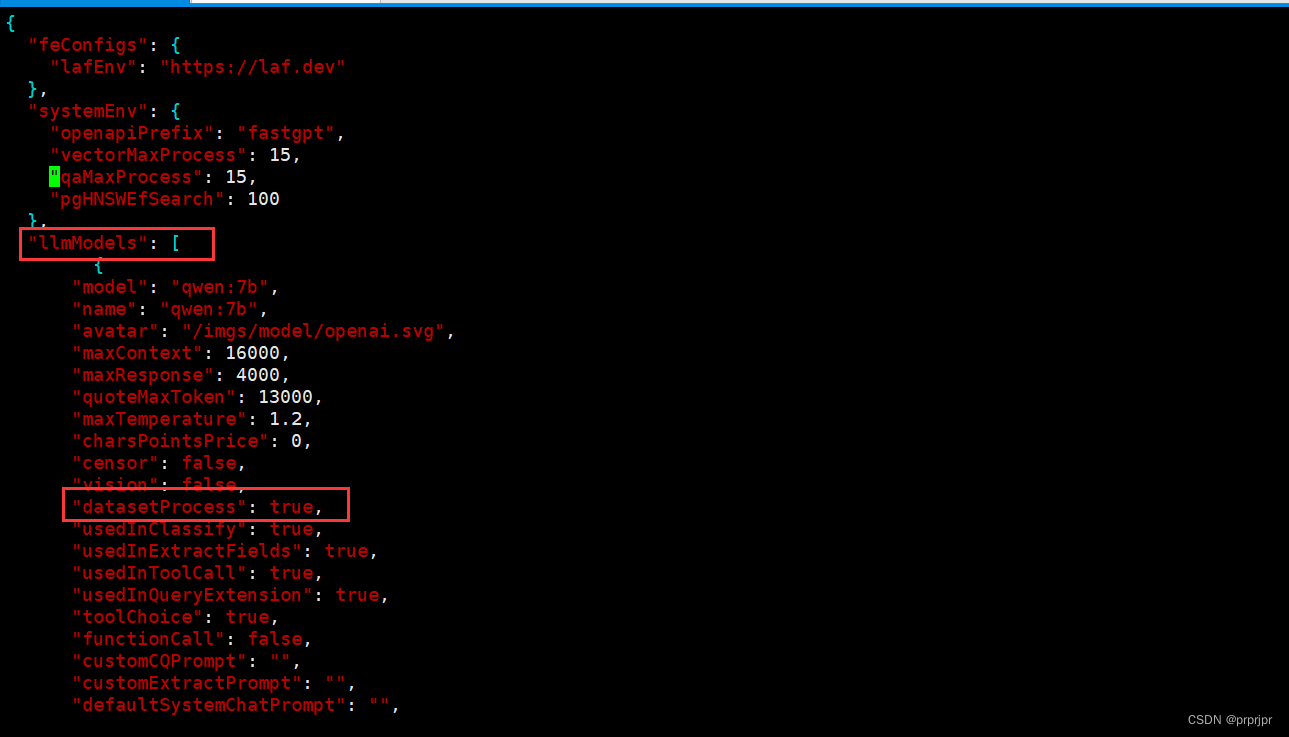

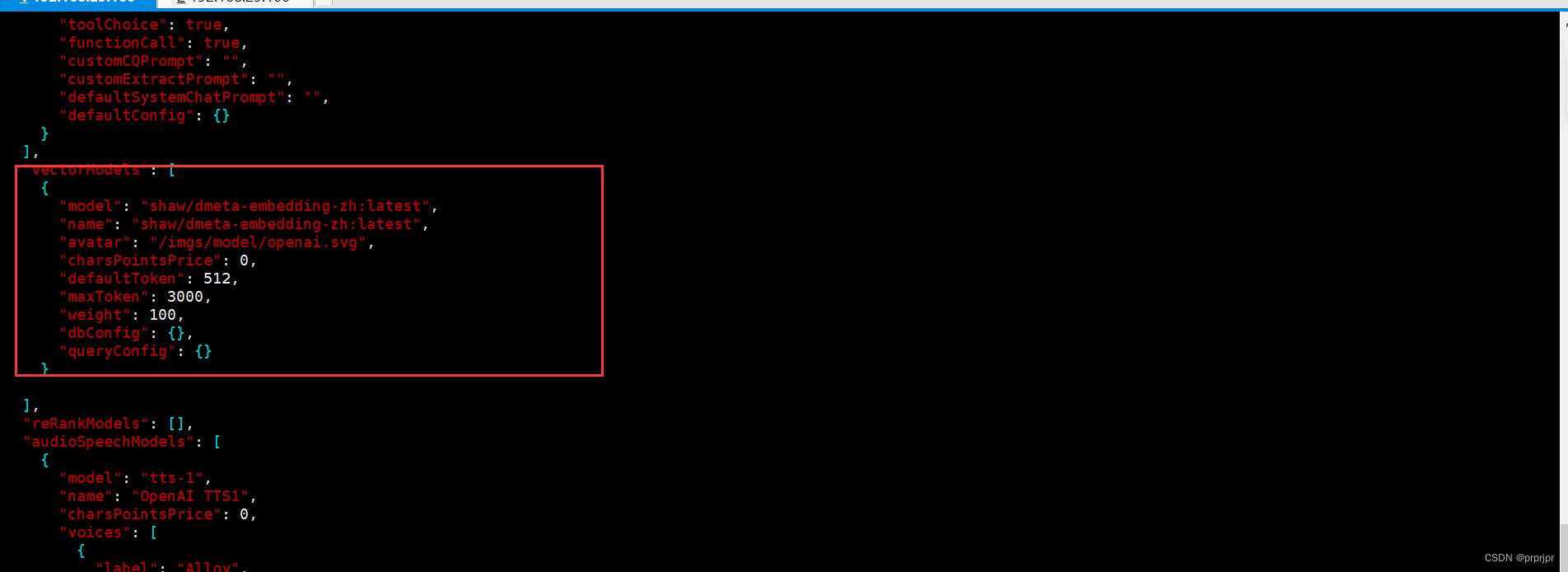

在config.json 配置语言模型和向量模型,配置完成以后重启docker-compose。注意:datasetProcess需要设置为true

docker-compose down

docker-compose up -d

(10)访问oneapi

通过 ip:3001 直接访问。登录用户名为 root,密码默认的123456

配置渠道

复制令牌修改到

复制令牌修改到

然后重启 docker-compose

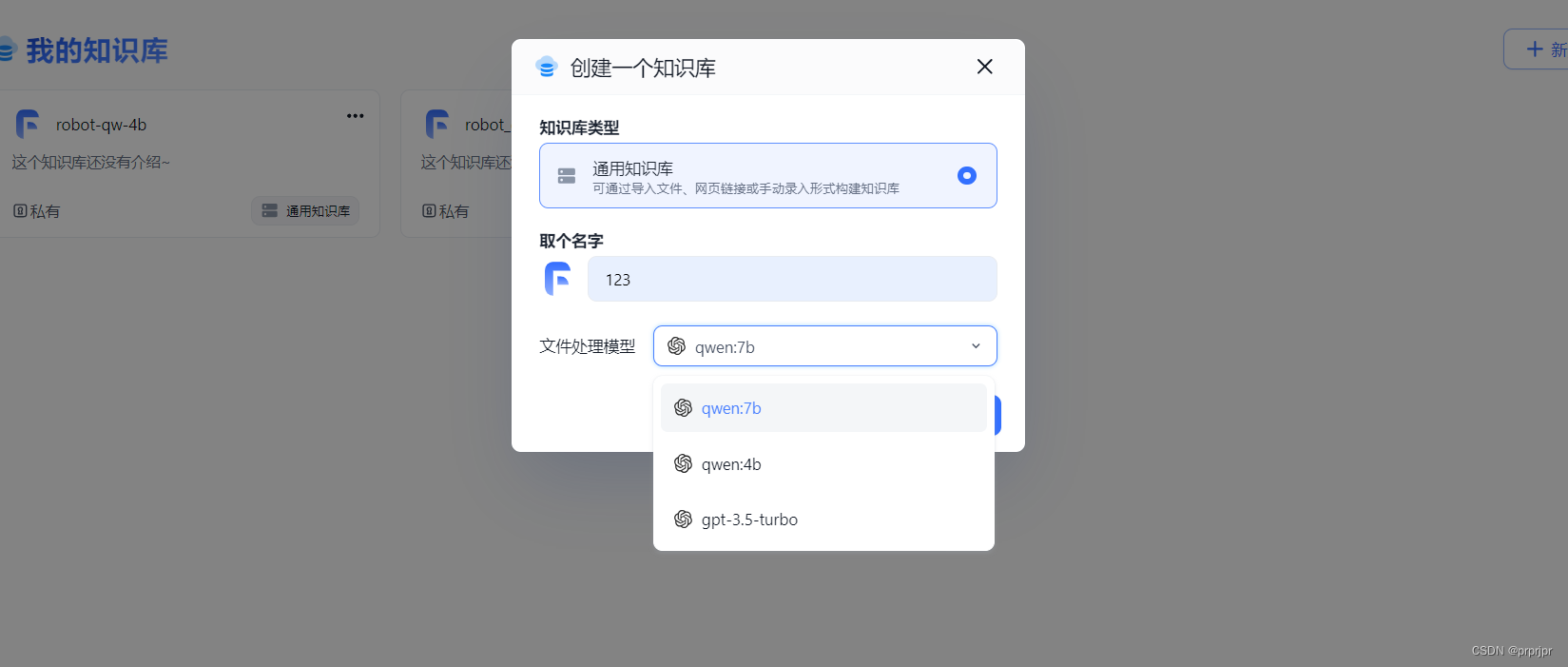

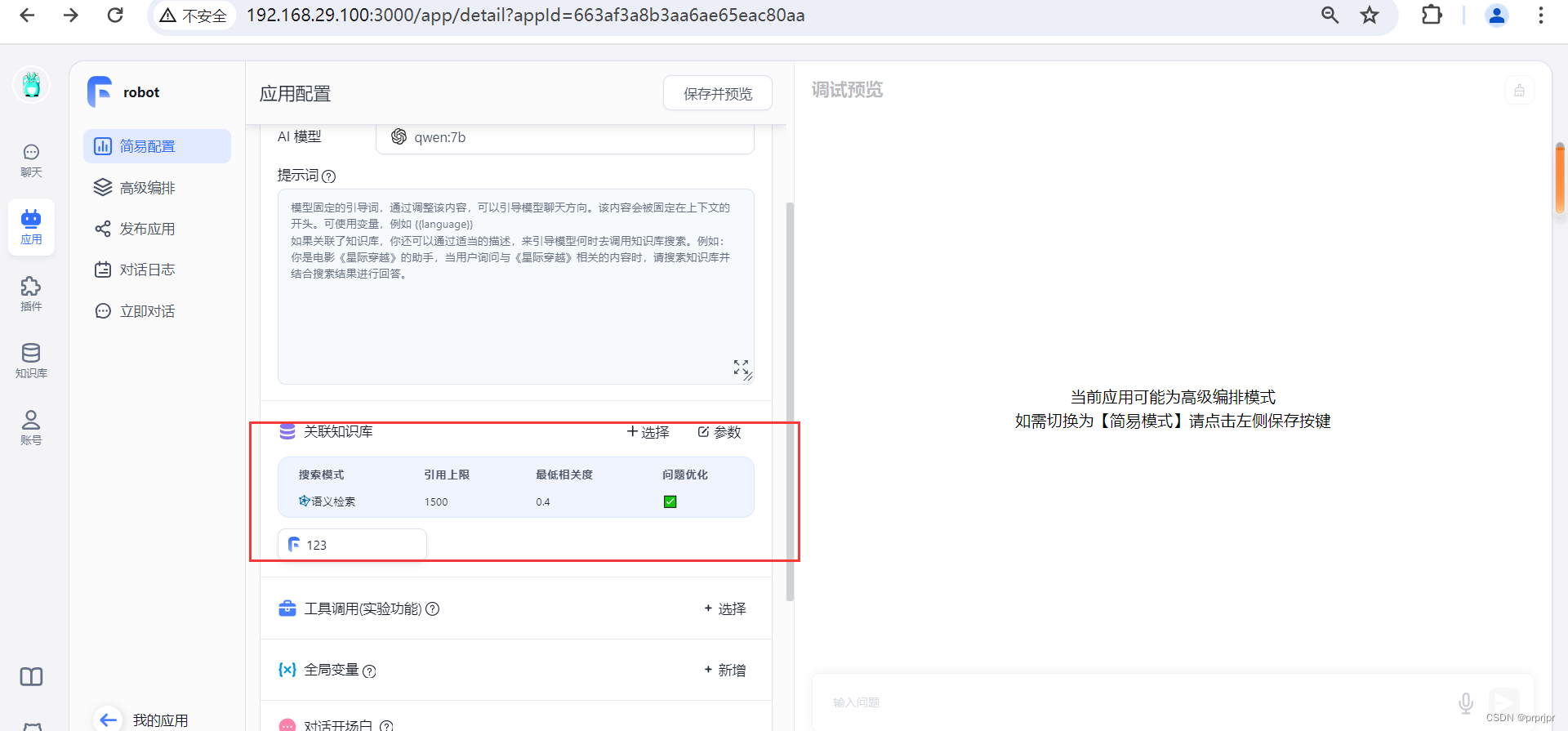

(11)搭建知识库

1、在fastgpt里新建知识库

2、上传文件,数据参数选默认

3、文件上传完成后,将知识库绑定创建的应用就可以使用啦

具体的fastgpt 使用教程移步github.com/labring/FastGPT的使用文档。

2073

2073

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?