linear_regression

还是直接看代码是如何写的。

从numpy中建立输入与输出。

import torch

import torch.nn as nn

import numpy as np

import matplotlib.pyplot as plt

from torch.autograd import Variable

# Hyper Parameters

input_size = 1

output_size = 1

num_epochs = 60

learning_rate = 0.001

# Toy Dataset

x_train = np.array([[3.3], [4.4], [5.5], [6.71], [6.93], [4.168],

[9.779], [6.182], [7.59], [2.167], [7.042],

[10.791], [5.313], [7.997], [3.1]], dtype=np.float32)

y_train = np.array([[1.7], [2.76], [2.09], [3.19], [1.694], [1.573],

[3.366], [2.596], [2.53], [1.221], [2.827],

[3.465], [1.65], [2.904], [1.3]], dtype=np.float32)构造线性回归模型,只有一个线性层

# Linear Regression Model

class LinearRegression(nn.Module):

def __init__(self, input_size, output_size):

super(LinearRegression, self).__init__()

self.linear = nn.Linear(input_size, output_size)

def forward(self, x):

out = self.linear(x)

return out

model = LinearRegression(input_size, output_size)构造loss和优化算法。

# Loss and Optimizer

criterion = nn.MSELoss()

optimizer = torch.optim.SGD(model.parameters(), lr=learning_rate) 开始训练。

# Train the Model

for epoch in range(num_epochs):

# Convert numpy array to torch Variable

inputs = Variable(torch.from_numpy(x_train))

targets = Variable(torch.from_numpy(y_train))

# Forward + Backward + Optimize

optimizer.zero_grad()

outputs = model(inputs)

loss = criterion(outputs, targets)

loss.backward()

optimizer.step()

if (epoch+1) % 5 == 0:

print ('Epoch [%d/%d], Loss: %.4f'

%(epoch+1, num_epochs, loss.data[0]))其中,torch.from_numpy的原型是

torch.from_numpy(ndarray) 表示从numpy中生成Tensor,并且共享numpy数据

举例:

>>> a = numpy.array([1, 2, 3])

>>> t = torch.from_numpy(a)

>>> t

torch.LongTensor([1, 2, 3])

>>> t[0] = -1

>>> a

array([-1, 2, 3])画图,查看结果。

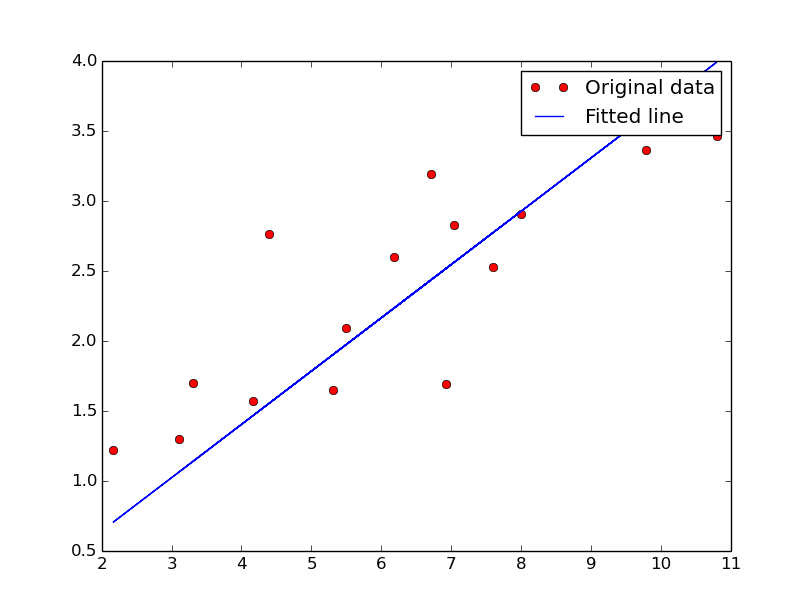

# Plot the graph

predicted = model(Variable(torch.from_numpy(x_train))).data.numpy()

plt.plot(x_train, y_train, 'ro', label='Original data')

plt.plot(x_train, predicted, label='Fitted line')

plt.legend()

plt.show()最终结果大概是这样,可以看出线性层拟合的就是一条直线。

逻辑回归可以看成是分类问题,线性回归可以看成是拟合或者预测问题。

434

434

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?