DARWIN: Survival of the Fittest Fuzzing Mutators (NDSS 2023)

变异调度(Mutation Scheduling)能够在很大程度上提升Fuzzing的效率。而现有的变异调度策略往往在现实生活(Real World)的程序中没有很好的效果,而且需要一定的专业知识来设置相关参数。

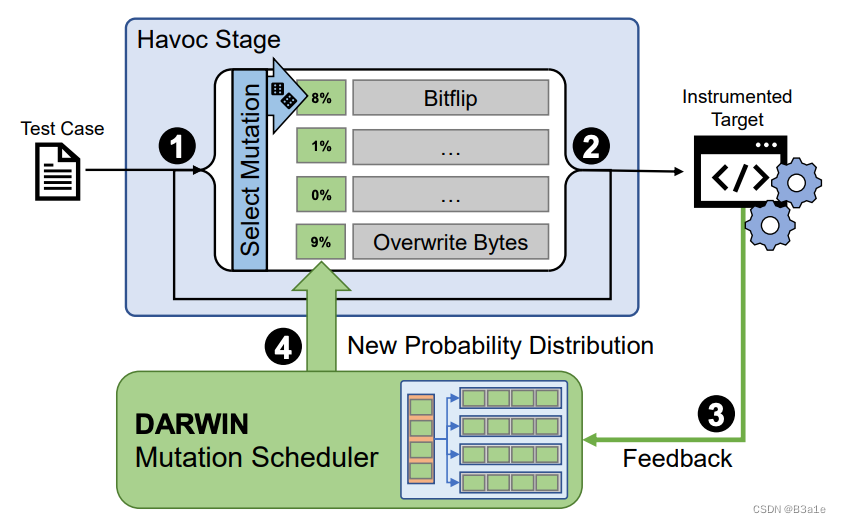

本文提出了DARWIN,基于AFL实现了Fuzzing过程中优化(Optimize)和调整(Adapt)变异策略。

DARWIN的大致工作流程如下图所示。

论文代码已开源。

915

915

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?