上一次我介绍了,没有hadoop模式下的spark的安装,下面将要介绍基于hadoop伪分布模式下的spark环境的搭建,其中hadoop为hadoop-2.2.0的环境,系统为ubuntu-14.04

1.首先要确保spark已经成功解压安装,详情请查看上篇博文

http://blog.csdn.net/qiumianderen5/article/details/46400885

2.然后修改spark目录下conf里面的spark-env.sh 文件

(1)首先需要从 spark-env.sh.template 中创建一个新的spark-env.sh文件

cp spark-env.sh.template spark-env.sh(2)然后修改spark-env.sh里面的参数

vim spark-env.sh修改的内容:

export SCALA_HOME=/usr/local/share/scala/scala-2.10.4

export JAVA_HOME=/usr/jdk1.7.0_51

export SPARK_MASTER=localhost

export SPARK_LOCAL_IP=localhost

export HADOOP_HOME=/home/hadoop/hadoop/hadoop-2.2.0

export SPARK_HOME=/home/hadoop/hadoop/spark-1.3.1

export SPARK_LIBARY_PATH=.:$JAVA_HOME/lib:$JAVA_HOME/jre/lib:$HADOOP_HOME/lib/native

export YARN_CONF_DIR=$HADOOP_HOME/etc/hadoop

export SPARK_EXAMPLE_JAR=/home/hadoop/hadoop/spark-1.3.1/examples/target/spark-examples_2.10-1.3.1.jar3.然后启动spark:

sbin/start-all.sh4.如果需要启动HDFS或者YARN则需要转到hadoop中去启动相应的HDFS和YARN

启动HDFS:

start-dfs.sh启动YARN:

start-yarn.sh5.效果

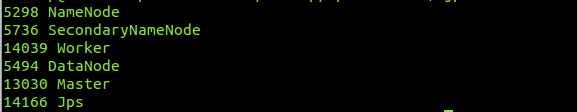

其中的Master和Worker就是Spark的启动的进程

希望大家都能搭建成功

965

965

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?