概述

MaxKB 是一款基于 LLM 大语言模型的知识库问答系统。

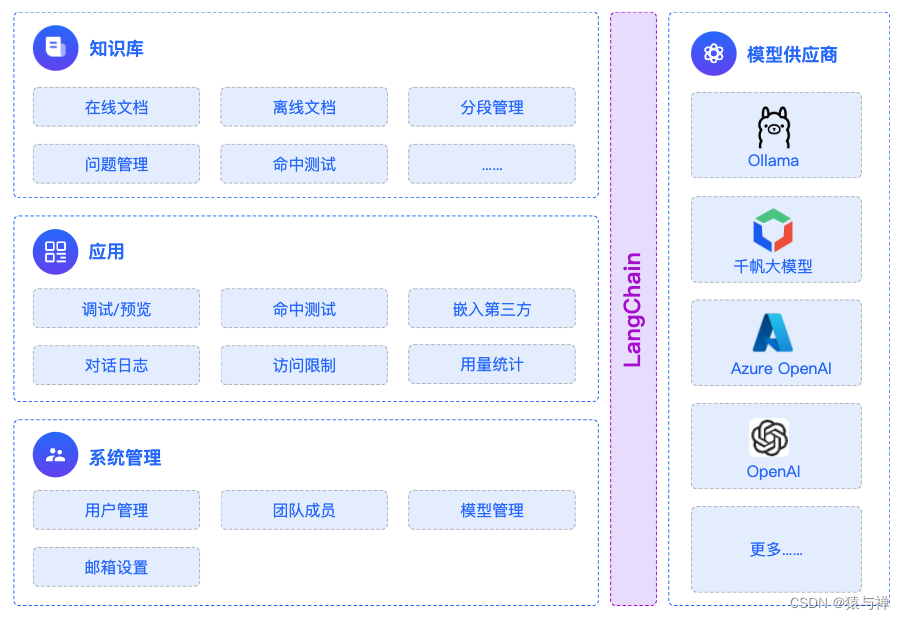

多模型支持:支持对接主流的大模型,包括本地私有大模型(如 Llama 2)、OpenAI、通义千问、Kimi、Azure OpenAI 和百度千帆大模型等;

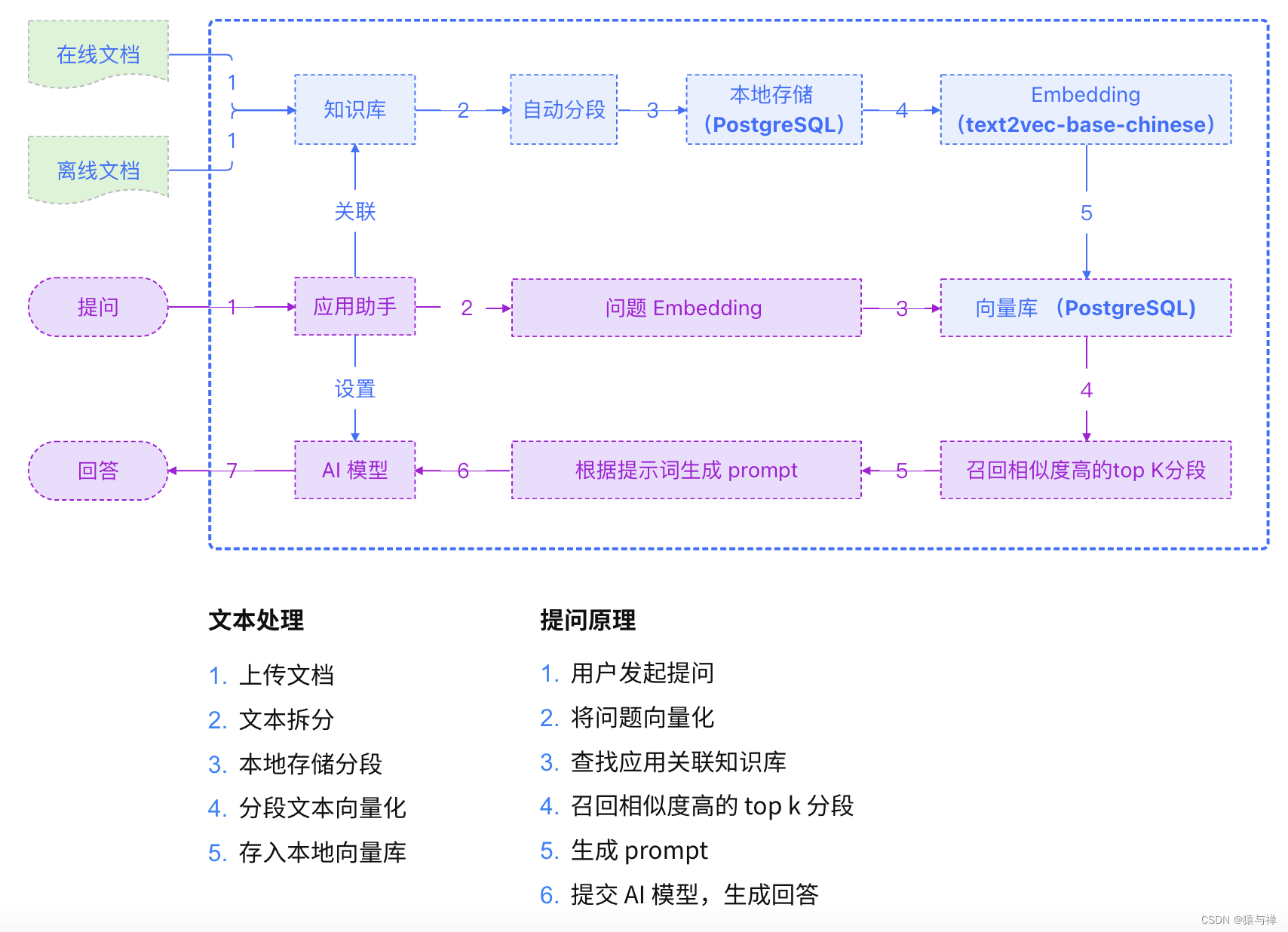

开箱即用:支持直接上传文档、自动爬取在线文档,支持文本自动拆分、向量化,智能问答交互体验好;

无缝嵌入:支持零编码快速嵌入到第三方业务系统。

MaxKB产品架构

MaxKB实现原理

安装MaxKB

docker run -d --name=maxkb -p 5080:8080 -v /home/maxkb:/var/lib/postgresql/data 1panel/maxkb

本文介绍了如何利用MaxKB结合Ollama搭建知识库问答系统。MaxKB支持多种大模型,提供开箱即用的文档上传和自动爬取功能,并能无缝嵌入第三方应用。步骤包括安装MaxKB和Ollama,配置集成,创建知识库,以及通过Swagger API进行调试和预览。

本文介绍了如何利用MaxKB结合Ollama搭建知识库问答系统。MaxKB支持多种大模型,提供开箱即用的文档上传和自动爬取功能,并能无缝嵌入第三方应用。步骤包括安装MaxKB和Ollama,配置集成,创建知识库,以及通过Swagger API进行调试和预览。

订阅专栏 解锁全文

订阅专栏 解锁全文

5711

5711

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?