最近,OpenAI再次以其令人瞩目的成就——Sora——震撼了世界。这个名为Sora的大型文本到视频模型,能够生成长达一分钟的视频,预示着一个更加宏大征程的开始。OpenAI将这一创新描述为构建“物理世界的通用模拟器”,这不仅是一项技术突破,也是探索人工智能潜力的一次大胆尝试。 在这篇博客中,我对OpenAI发布的Sora技术报告进行了深入的解读。我努力在保证内容全面性的同时,使其易于快速阅读,力图达到与官方技术报告相似的效果。为此,我还包含了大部分官网上的视频素材,使读者能够更直观地感受到Sora的强大能力。 在博客的最后,我也简单分享了自己对这一技术革新的看法。从对现实世界的精准模拟到未来可能的应用前景,Sora无疑开启了人工智能领域的一个新篇章。我们正处于这一变革的前沿,见证着人工智能如何逐渐成为我们生活中不可或缺的一部分。—— AI Dream,APlayBoy Teams!

引言解读

-

探索视频数据上的大规模生成模型训练:OpenAI在这部分强调了他们在视频数据上进行生成模型的大规模训练的努力。这表明了对动态和复杂数据类型的投入,突破了以往大多数研究仅限于静态图像的范畴。

-

多样性视频和图像生成的文本条件扩散模型:该模型不仅能够处理多种格式和尺寸的视频和图像,还能够根据文本条件生成相应的内容。这一点显示了模型在理解和生成内容方面的强大能力,尤其是在处理多种类型媒体时的灵活性。

-

采用Transformer架构处理视频和图像的时空信息:此处还提到了利用Transformer结构,可以处理视频和图像的时空数据。这种架构的引入对于理解视频内容的动态变化至关重要。

-

Sora模型:Sora模型可以高效生成高质量视频,强调了其在生成长达一分钟的高保真视频方面的能力。这显示了OpenAI在提高视频生成质量和时长方面取得的显著进展。

-

视频生成模型的未来:即,向通用物理世界模拟器迈进。这展望了扩展视频生成模型在未来模拟物理世界方面的潜力。

介绍解读

-

统一视觉数据表示法与大规模生成模型训练:报告首先聚焦于如何将各类视觉数据转化为统一的表示形式,这是实现生成模型大规模训练的关键。通过这种统一表示,模型能够更有效地学习和生成多样化的视觉内容。

-

Sora能力与局限性的定性评估:报告第二部分关注于定性评估Sora模型的能力和局限性。这意味着报告将展示Sora在实际应用中的表现,但不包括具体的模型和实现细节。

-

先前研究与Sora的比较:这部分还提到了先前在视频数据生成模型方面的研究,包括使用循环网络、生成对抗网络、自回归 Transformer 和 Diffusion Model 的方法。这些研究通常专注于特定类型的视觉数据、较短视频或固定尺寸的视频。相比之下,Sora作为一个通用的视觉数据模型,能够生成时长、宽高比和分辨率各异的视频和图像,甚至能够生成长达一分钟的高清视频。

实现说明

将视觉数据转化为patches

-

灵感来源于大型语言模型:这一部分指出,Sora模型的设计灵感来源于大型语言模型(LLM),LLM通过在大规模的互联网数据上进行训练来获得通用能力。大型语言模型的成功部分得益于它们使用的代表不同文本模态(如代码、数学和各种自然语言)的标记(tokens)。Sora模型试图将这种成功应用到视觉数据生成模型中。

-

Sora的视觉patches:在Sora模型中,对应于语言模型的文本标记的是视觉patches。之前的研究已经证明,视觉patches是一个有效的视觉数据模型表示形式。Sora模型采用视觉patches作为其核心表示手段,以处理多样化的视频和图像数据。

-

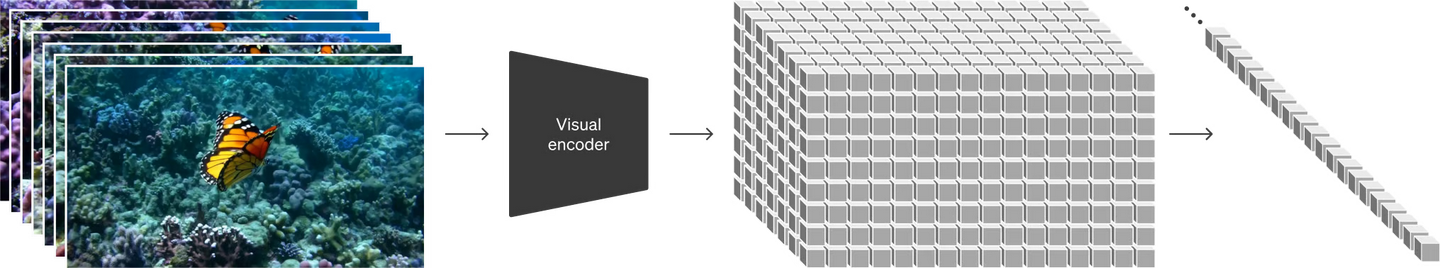

视频转化为patches的过程:在高层次上,Sora模型将视频转化为patches的过程包括两个步骤:首先将视频压缩到一个低维的潜在空间,然后将这个表示分解为时空patches。这种方法允许模型有效地处理视频数据,捕捉视频的动态特性和细节。

视频压缩网络

-

视觉数据降维的训练网络:报告介绍了一个专门用于降低视觉数据维度的网络。这个网络的作用是接收原始视频作为输入,并输出一个在时间和空间上都被压缩的潜在表示。这一步骤对于处理大规模视频数据至关重要,因为它减少了所需处理的数据量,同时保留了视频的关键信息。

-

Sora在压缩潜在空间中的训练和生成:Sora模型不仅可以在这种压缩的潜在空间上进行训练,而且还在这个空间内生成视频。这意味着Sora学习并模拟了视频数据的压缩表示,这是其处理和生成高质量视频的关键。

-

对应的解码器模型:报告还提到了一个对应的解码器模型,它负责将生成的潜在表示映射回像素空间。这个解码器是生成过程的关键部分,因为它使模型能夠将压缩的视频数据转换回可视的、高质量的视频格式。

时空潜在patches

-

从压缩视频中提取时空patches序列:给定一个压缩后的输入视频,Sora模型从中提取出一系列时空patches,这些patches在模型中的作用类似于变换器(transformer)的标记(tokens)。这种方案同样适用于图像,因为图像可以被视为只有单帧的视频。这种基于patch

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?