Optimization

SGD:比较稳定

Adam:算的比较快,波动大

有助于optimization的方式:shuffling、dropout、gradient noise、warm up

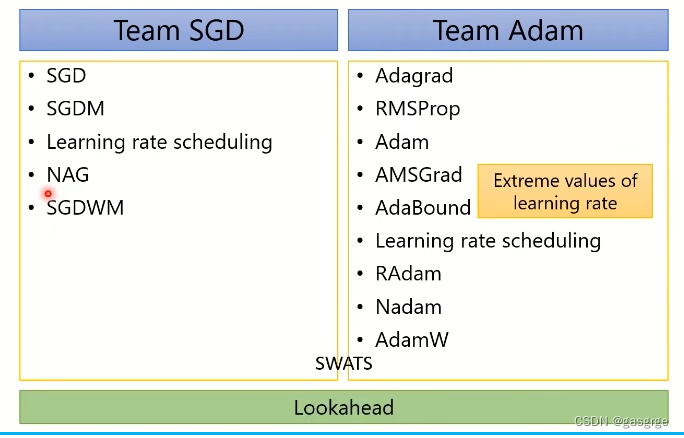

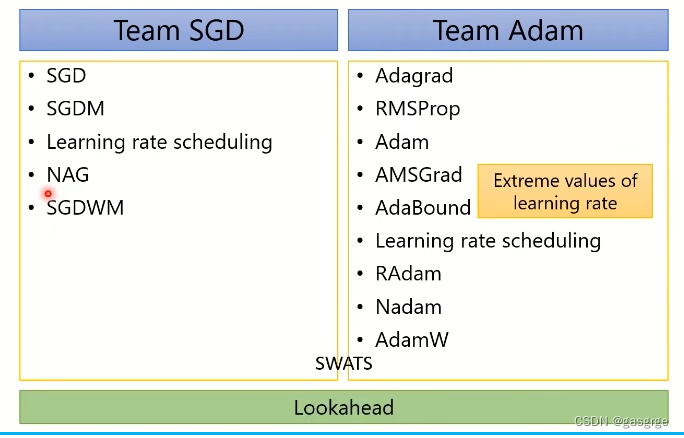

了解到的optimizer

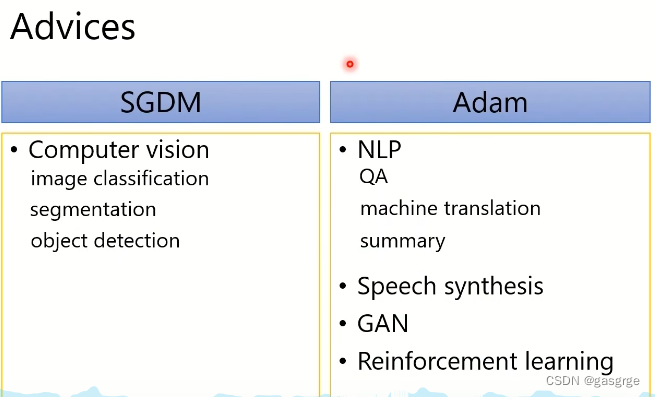

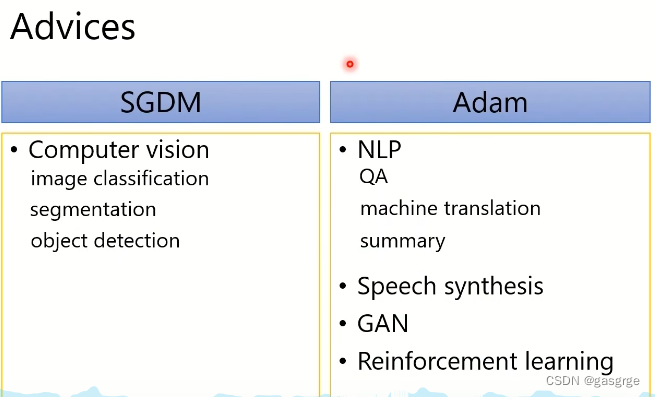

CV领域多是SGD,NLP领域多是Adam

本文探讨了SGD与Adam优化器在计算机视觉(CV)和自然语言处理(NLP)领域的使用特点,指出Adam计算速度快但波动较大,而SGD较稳定。同时提到有助于优化的技术手段如数据洗牌、dropout、梯度噪声和warmup。

本文探讨了SGD与Adam优化器在计算机视觉(CV)和自然语言处理(NLP)领域的使用特点,指出Adam计算速度快但波动较大,而SGD较稳定。同时提到有助于优化的技术手段如数据洗牌、dropout、梯度噪声和warmup。

Optimization

SGD:比较稳定

Adam:算的比较快,波动大

有助于optimization的方式:shuffling、dropout、gradient noise、warm up

了解到的optimizer

CV领域多是SGD,NLP领域多是Adam

1174

1174

220

220

4307

4307

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?