梯度是一个向量,它的最重要性质就是指出了函数f在其自变量y增加时最大增长率的方向。负梯度指出f的最陡下降方向利用这个性质,可以设计一个迭代方案来寻找函数的最小值。

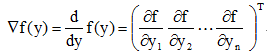

梯度法定义:设函数f(y)是向量y = (y1, y2, …, yn)T的函数,则f(y)的梯度定义为:

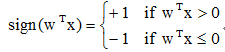

对感知器算法

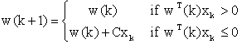

定义一个对错误分类敏感的准则函数J(w, x)。先任选一个初始权向量w(1),计算准则函数J的梯度,然后从w(1)出发,在最陡方向(梯度方向)上移动某一距离得到下一个权向量w(2) 。从w(k)导出w(k+1)的一般关系式 :C是一个正的比例因子(步长)

若正确地选择了准则函数J(w,x),则当权向量w是一个解时,J达到极小值(J的梯度为零)。由于权向量是按J的梯度值减小,因此这种方法称为梯度法(最速下降法)。为了使权向量能较快地收敛于一个使函数J极小的解,C值的选择是很重要的。若C值太小,则收敛太慢;若C值太大,则搜索可能过头,引起发散。

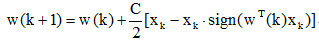

如下面的例子所示:

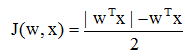

选准则函数J(w,x)=|wTx|-wTx,考虑一维模式的情况。

设训练样本x为1。

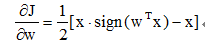

当错误分类时,wTx<0,J为正值,▽J=-2,则w(k+1)=w(k)+2C,对权向量进行校正。

当正确分类时,wTx>0,J=0,▽J=0,则w(k+1)=w(k),权向量不变。

固定增量的逐次调整算法:

设取准则函数为:

时,则w(k+1) = w(k),此时不对权向量进行修正;当

时,则w(k+1) = w(k),此时不对权向量进行修正;当 时,则w(k+1) = w(k) + Cxk,需对权向量进行校正,初始权向量w(1)的值可任选,显然这就是前面所说的感知器算法,因此感知器算法是梯度法的一个特例。在上式中C是预先选好的固定值,在迭代过程中,只要

时,则w(k+1) = w(k) + Cxk,需对权向量进行校正,初始权向量w(1)的值可任选,显然这就是前面所说的感知器算法,因此感知器算法是梯度法的一个特例。在上式中C是预先选好的固定值,在迭代过程中,只要 ,就要对权向量修正Cxk值,因此称为固定增量算法。

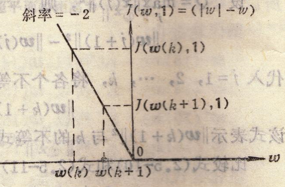

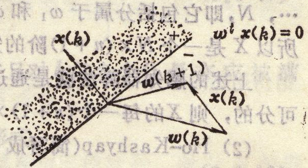

,就要对权向量修正Cxk值,因此称为固定增量算法。过程说明:设已由前一步迭代得到w(k)的值。读入模式样本xk,判别wT(k)xk是否大于0。在示意图中,xk界定的判别界面为wT(k)xk=0。当w(k)在判别界面的负区域时,wT(k)xk<0。

校正: w(k+1)= w(k)+ xk ,这里取C=1。校正后, w(k+1)向量比w(k)向量更接近于模式xk所决定的正区域。若模式是线性可分的,选择合适的准则函数J(w,x),算法就能给出解。若模式不是线性可分的,算法的结果就会来回摆动,得不到收敛。

1410

1410

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?