说明:此项目仅限于交流学习使用。有诸多未完善的地方,敬请谅解!后续会逐步完善,欢迎一起交流学习。

参考资料

安装部署 | Apache StreamPark (incubating)

科学大数据开源社区/PiFlow - 码云 - 开源中国 (gitee.com)

下载安装包

下载方式:扫码关注公众号PiflowX,发送安装包获取下载链接。

环境要求

| 要求 | 版本 | 是否必须 | 说明 |

|---|---|---|---|

| 操作系统 | Linux | 是 | 不支持Window系统 |

| JAVA | 1.8+ | 是 | |

| MySQL | 5.6+ | 否 | 默认使用H2数据库,推荐使用 MySQL |

| Flink | 1.12.0+ | 是 | StreamPark支持Flink version >= 1.12,PiflowX的Flink组件基于1.18.0版本,安装1.18.0 |

| Hadoop | 3 | 否 | PiflowX Spark组件需要hadoop环境 |

| Spark | 3 | 否 | PiflowX Spark组件需要安装spark |

解压部署

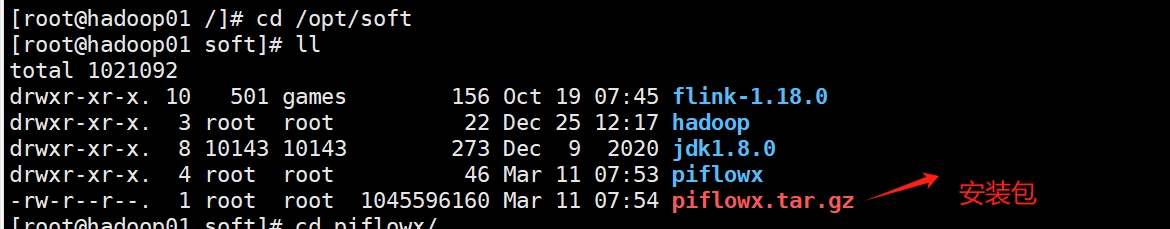

下载PiflowX安装包,解包后安装目录如下:

tar -xvf piflow.tar.gz -C /your_install_path

# your_install_path:你的安装路径

# 例:tar -xvf piflow.tar.gz -C /opt/soft

├── piflowx

│ ├── piflowx-server

│ │ ├── classpath

│ │ ├── config.properties

│ │ ├── lib

│ │ ├── logs

│ │ ├── restart.sh

│ │ ├── server.ip

│ │ ├── start.sh

│ │ ├── status.sh

│ │ └── stop.sh

│ └── streampark

│ ├── bin

│ ├── client

│ ├── conf

│ ├── DISCLAIMER

│ ├── lib

│ ├── LICENSE

│ ├── licenses

│ ├── LICENSE.tpl

│ ├── NOTICE

│ ├── plugins

│ ├── python

│ ├── README.md

│ ├── script

│ └── temp

Java环境配置

参考:Linux 配置Java环境(图文详细)_⑤ 配置java运行环境linux-CSDN博客

Hadoop&Flink&Spark环境配置

省略

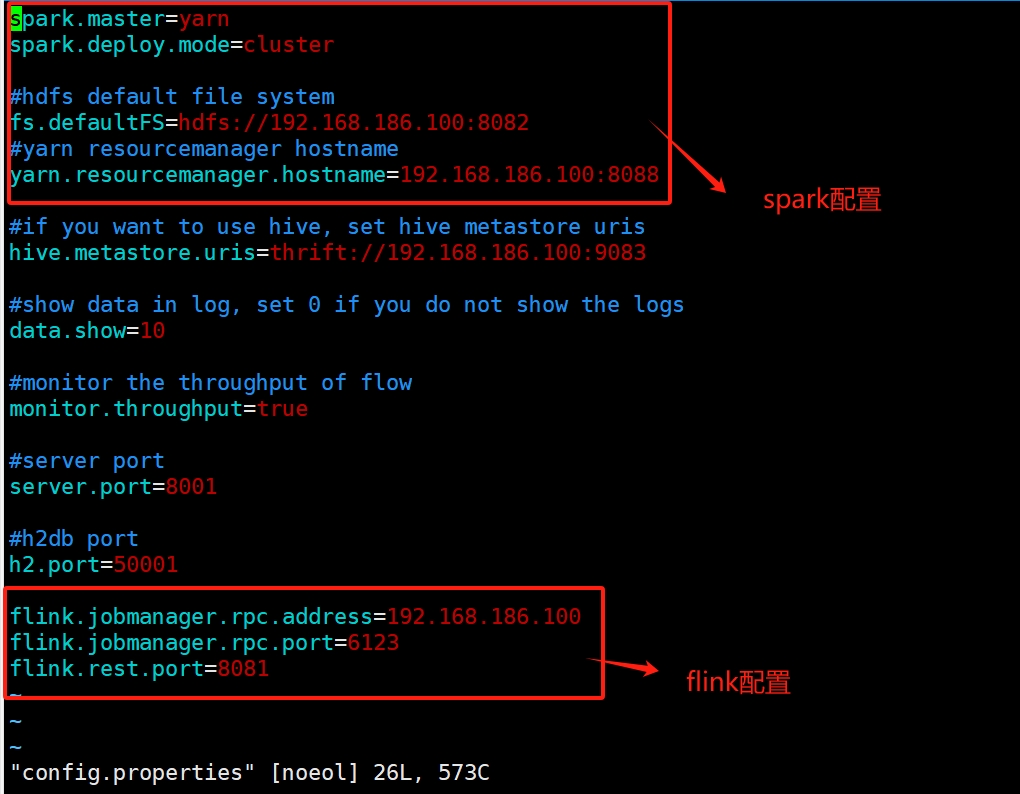

piflowx-server配置

vim /your_install_path/piflowx/piflowx-server/config.properties

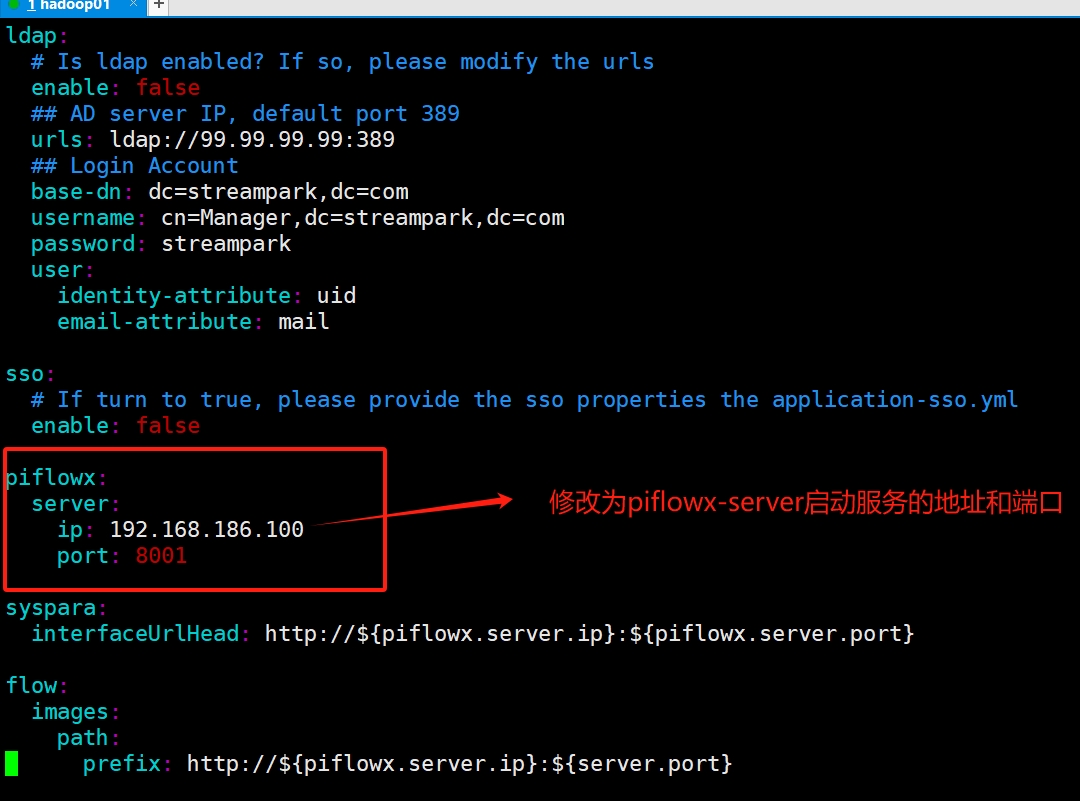

StreamPark配置

vim /your_install_path/piflowx/streampark/conf/application.yml

修改piflowx连接信息

修改Streampark workpase

找到 streampark 这一项,找到 workspace 的配置,修改成一个用户有权限的目录

streampark:

# HADOOP_USER_NAME 如果是on yarn模式( yarn-prejob | yarn-application | yarn-session)则需要配置 hadoop-user-name

hadoop-user-name: hdfs

# 本地的工作空间,用于存放项目源码,构建的目录等.

workspace:

local: /opt/streampark_workspace # 本地的一个工作空间目录(很重要),用户可自行更改目录,建议单独放到其他地方,用于存放项目源码,构建的目录等.

remote: hdfs:///streampark # support hdfs:///streampark/ 、 /streampark 、hdfs://host:ip/streampark/

workspace默认local为/opt/streampark_workspace,如果使用默认配置,则直接创建目录

mkdir -p /opt/streampark_workspace

启动piflowx-server

cd /your_install_path/piflowx/piflowx-server && ./start.sh

启动StremPark

cd /your_install_path/piflowx/streampark/bin && ./start.sh

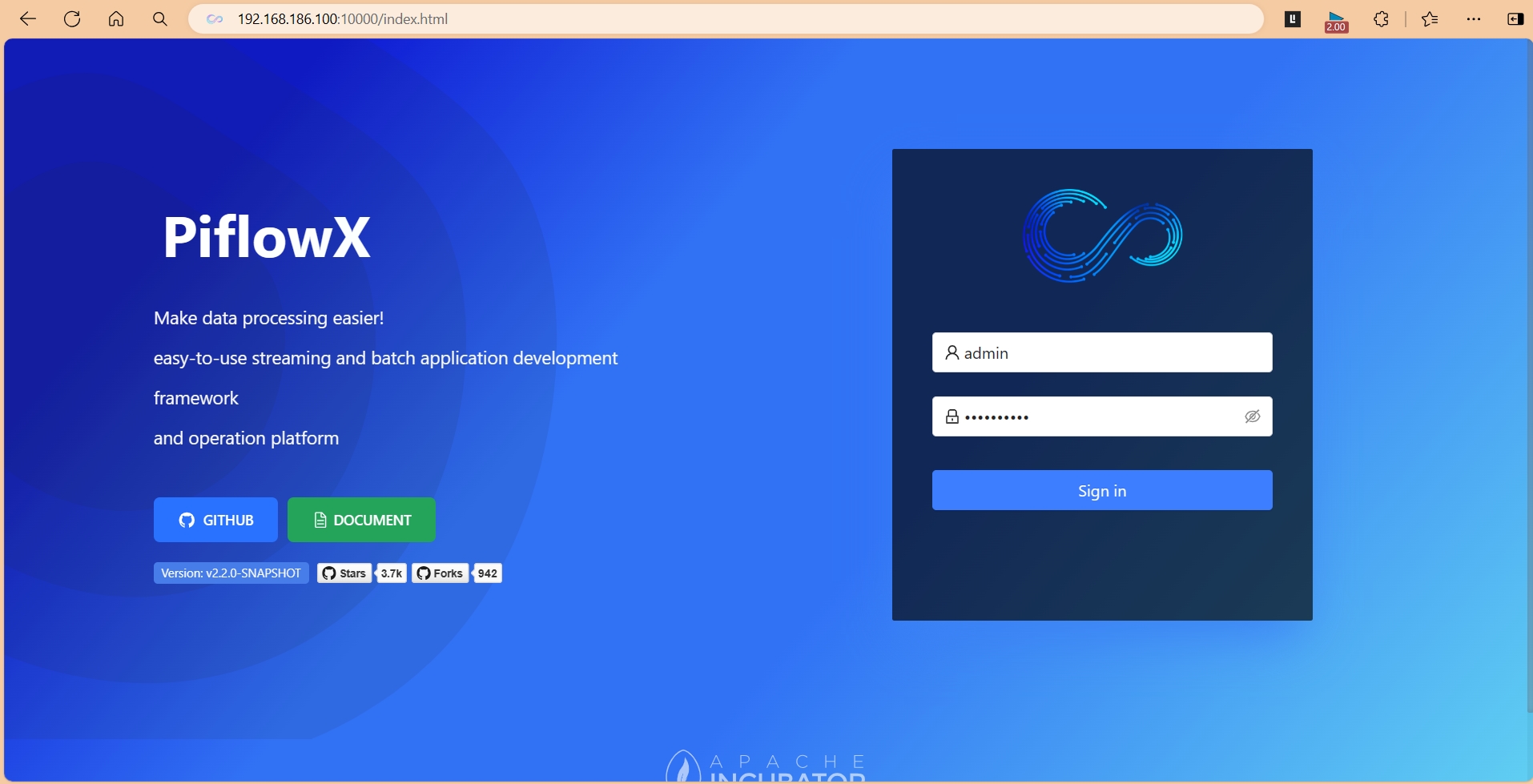

访问PiflowX

http://ip:10000/index.html

# 默认密码: admin / streampark

PiflowX安装部署

597

597

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?