transformer代码结构图.这个图其实就是把网上常见的transformer图画得更详细了,参考的是transformer的代码.这么细致的图并不方便于记忆,但是日后回顾细节时不必再看代码.

总结有如下几个点:

- encoder的输入和bert的输入相同的是都有token_emb和pos_emb,但transformer没有token_type_id(也叫segment_id).另外transformer中采用的三角函数式位置编码,bert是训练得到的位置编码.位置编码的重要性低于token_emb,transformer为了满足这一点,给token_emb乘了sqrt(d),bert则是自己学习到了两者之间的重要性关系.

- 三角函数式编码和bert位置编码有一些共同特征:最关心的是离自己最近的(即对角线相关性更大),相较于三角函数式位置编码bert式对其他位置的token更加关注,并且呈现出空洞的特点.

- encoder的结构和bert基本完全一致.只在全连接层多了一个dropout.

- decoder的输入训练时是右移后的,预测时是上一time step的输出.要加位置编码,还有encoder和decoder的词表是不一样的.

- decoder中,encoder的输出出现在每一个block中,并不是只在第一个block;

- decoder中的self attention的mask是下三角mask,cross attention的mask还是encoder的mask.此外,cross attention中的kv是encoder的输出,q是decoder的输入.

- transformer是先dropout再layer normalization的,而bert则是先layer normalization再dropout.

其他笔记:

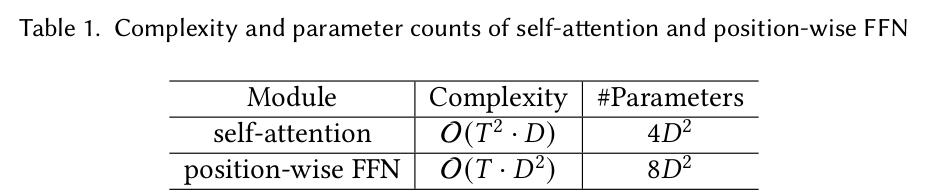

当序列长度远小于维度时,复杂度主要是FFN上,看维度有多大。当序列长度远大于维度时,复杂度主要在self attention上,看序列长度有多大。所以当要把transformer应用到长序列时会用稀疏attention.

225

225

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?