机器学习技法 Lecture16:Finale

Feature Exploitation Techniques

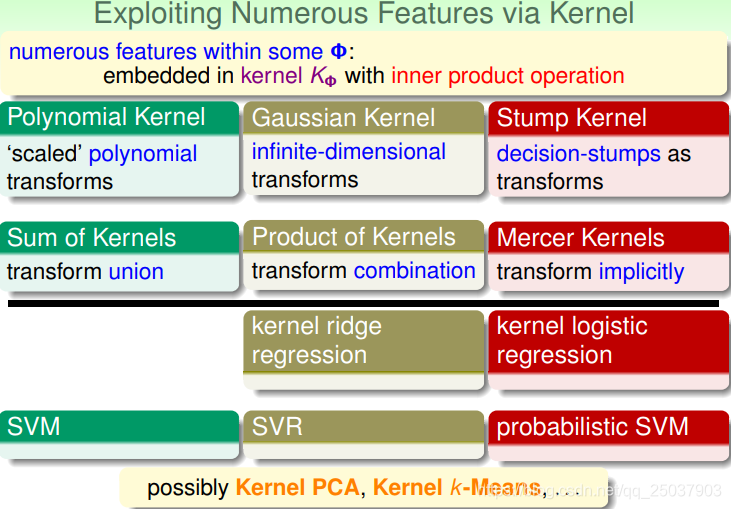

用核方法来利用数据的特征,以及对应的算法:

核方法主要是进行空间映射后进行内积的操作,可以结合到很多存在内积运算的算法中。

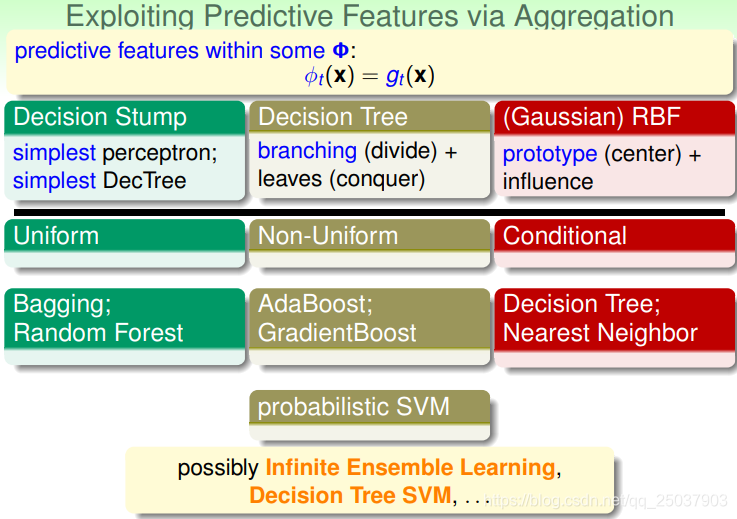

还可以通过aggregation来利用特征。把aggregation中的基函数g(x)当做是对于特征的运算即可。

同样的可以将一些算法组合起来,比如将svm当做是一个小g(x)等等。

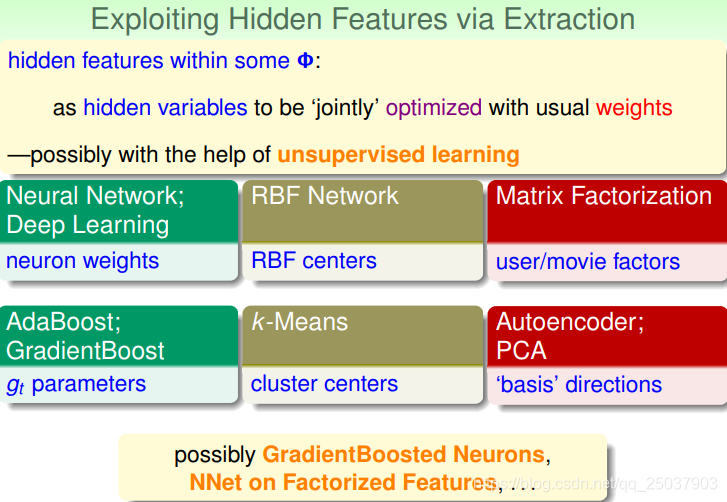

特征抽取的形式也是一个重要的方法。它们之间也可以互相组合。

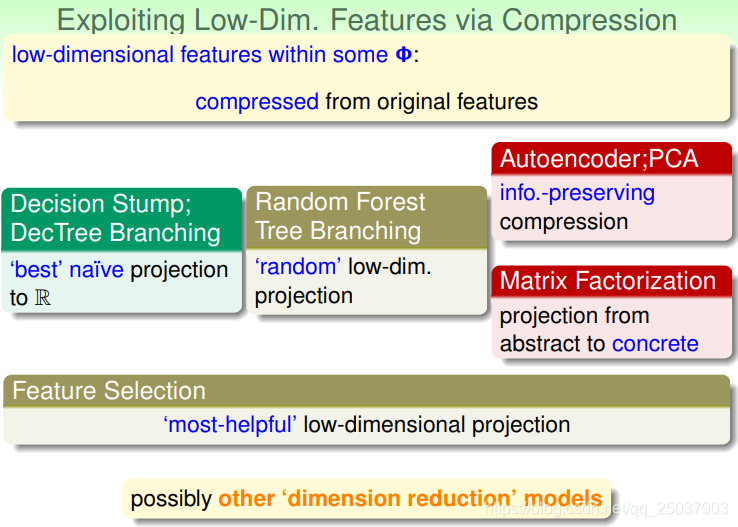

通过维度压缩得到更低维度的特征也是一种利用方式(和上一个extraction感觉可以 合并)。

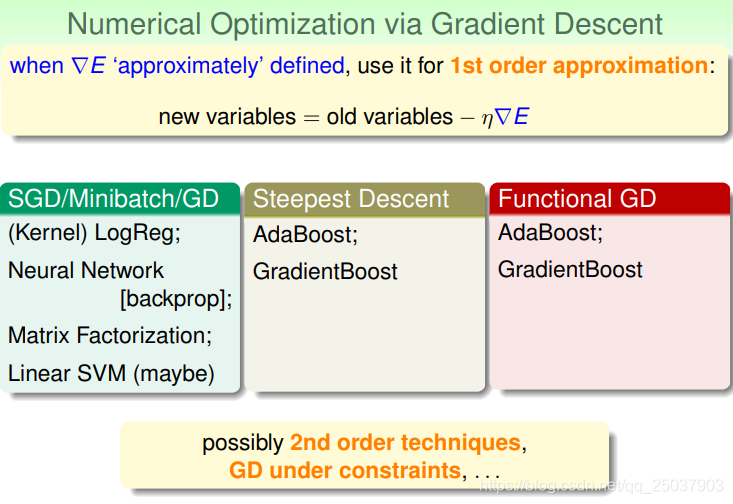

Error Optimization Techniques

目标函数的优化方法。首先是正常的梯度下降:

梯度下降的方式有很多,而且adboost也可以看成一种梯度下降。

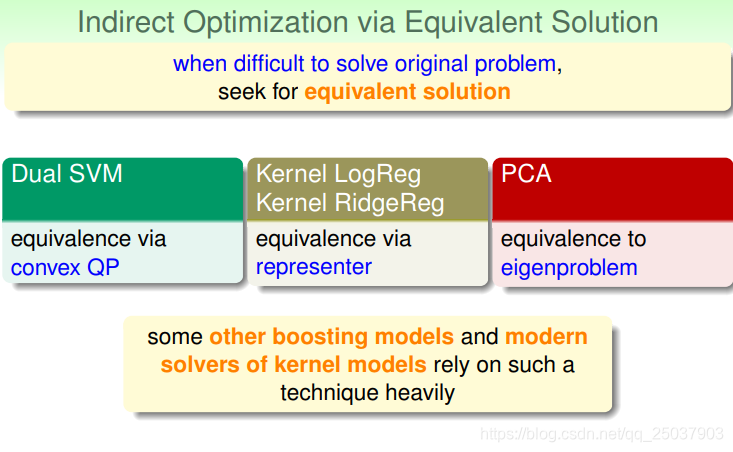

还有一种方式是转化法。将不好求的优化问题转化为另外一个等价的可以求解的问题。

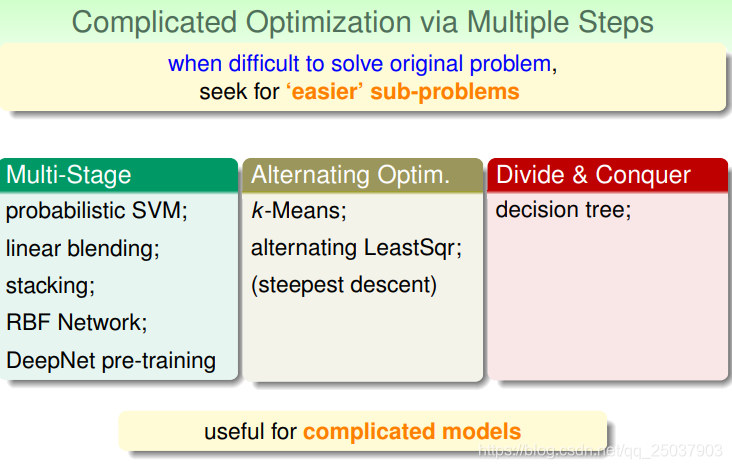

对于复杂的问题来说,也可以使用分步骤的方式来进行优化。

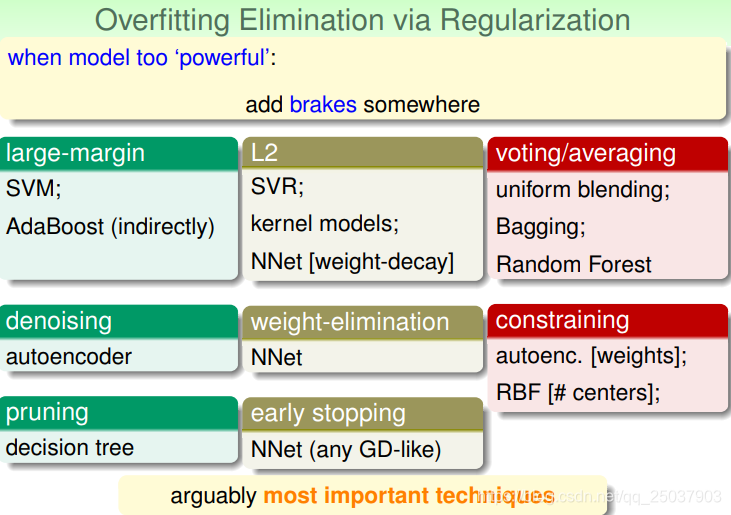

Overfitting Elimination Techniques

通过正则化的方式避免过拟合:

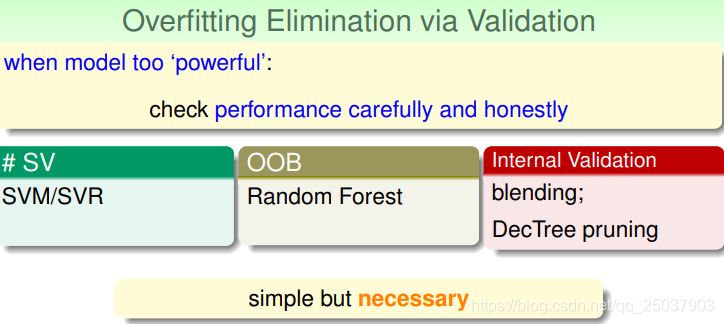

使用交叉验证的方式也有利于减少过拟合:

Machine Learning in Practice

又举了它们几次KDD的例子。感觉秘诀主要就是aggregation+特征工程。不过能够做出较好的特征以及aggregation还不过拟合比较厉害。

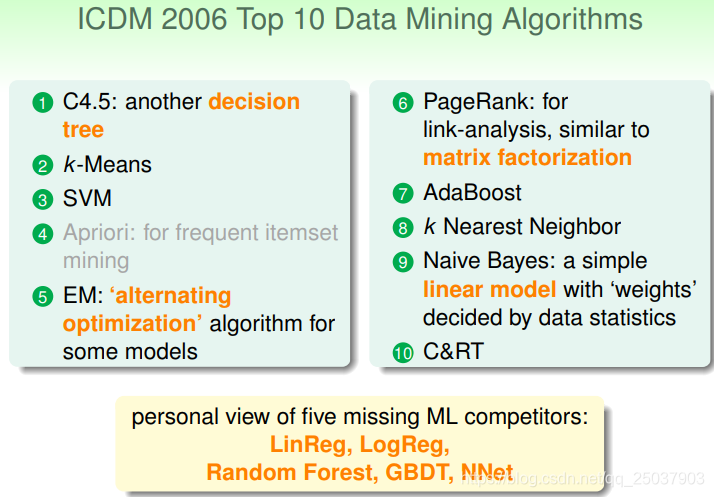

实际最常用的一些算法大部分都学过了:

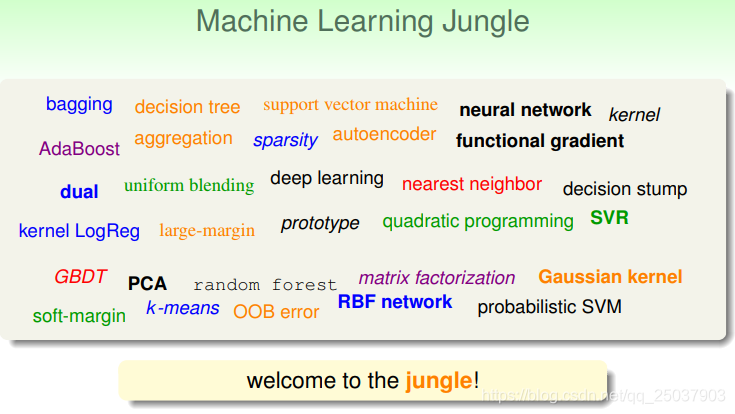

完结撒花!

3116

3116

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?