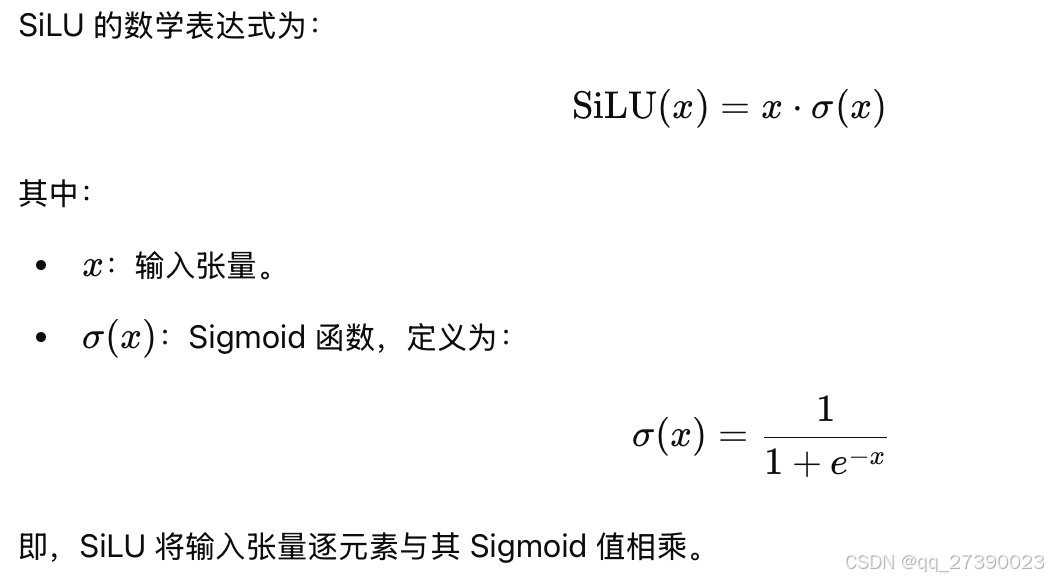

在 PyTorch 中,torch.nn.functional.silu 是一种激活函数,称为 SiLU(Sigmoid-Weighted Linear Unit)。它结合了 Sigmoid 和线性单元特性,用于在深度学习模型中引入非线性。

1. 定义

2. 使用方式

torch.nn.functional.silu 可以直接对张量进行操作。常见用法如下:

import torch

import torch.nn.functional as F

# 输入张量

x = torch.tensor([-2.0, -1.0, 0.0, 1.0, 2.0])

# 使用 SiLU 激活函数

output = F.silu(x)

print(output)

3. 性能特点

(1) 平滑性

SiLU 激活函数是 平滑的非线性函数,在输入范围内变化均匀,没有尖锐的不连续点。

(2) 可导性

SiLU 是可微分的,且梯度计算稳定。其导数为:

![]()

(3) 表现能力

SiLU 函数结合了线性部分(通过 xx)和非线性部分(通过 σ(x)σ(x)),相比 ReLU 和 Sigmoid 函数:

- 避免了 ReLU 的“死区”(输入为负值时导数为 0 的区域)。

- 提供了更强的特征表示能力。

4. 适用场景

- SiLU 在一些深度模型(如 Transformer 和神经网络搜索任务)中表现出色。

- 它对模型的训练效果往往优于 ReLU 和 LeakyReLU,尤其是在对激活平滑性敏感的场景下。

5. 小结

torch.nn.functional.silu 是 PyTorch 提供的 SiLU 激活函数,结合了线性和非线性特性,具有良好的平滑性和可导性。它是一种先进的激活函数选择,在现代深度学习任务中得到了越来越广泛的应用。

3591

3591

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?