squeeze 函数:从数组的形状中删除单维度条目,即把shape中为1的维度去掉

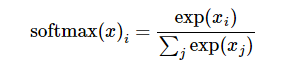

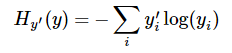

current_label = np.squeeze(current_label)tf.nn.softmax_cross_entropy_with_logits函数:交叉熵损失函数,该函数用于计算loss,函数参数如下: tf.nn.softmax_cross_entropy_with_logits(logits, labels, name=None)第一个参数为预测样本的输出,即神经网络的最后一层输出,第二个参数为实际输入数据对应的标签值,函数实际工作有两部,softmax+cros_entropy.其中i表示对应的输出向量中的第几个,表示实际标签,y表示softmax后得到的预测标签

def get_loss(pred, label, BATCH_SIZE):

loss = tf.nn.softmax_cross_entropy_with_logits(logits=pred, labels=label)

classify_loss = tf.reduce_mean(loss)/BATCH_SIZE

tf.summary.scalar('classify loss', classify_loss)

179

179

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?