1. Attention in CV

1.1. CHAM:actionrecognition using convolutional hierarchical attention model.5

Cnn+多层LSTM,soft attention(指可导,hard attention使用强化学习,但是强化学习方差较大)

1.2. Recursiverecurrent nets with attention modeling for OCR in the wild.6

Recursive是结构上的循环(节省空间增加深度,类似与ISTN),recurrent是时间上的循环(多层使关注不同任务)。

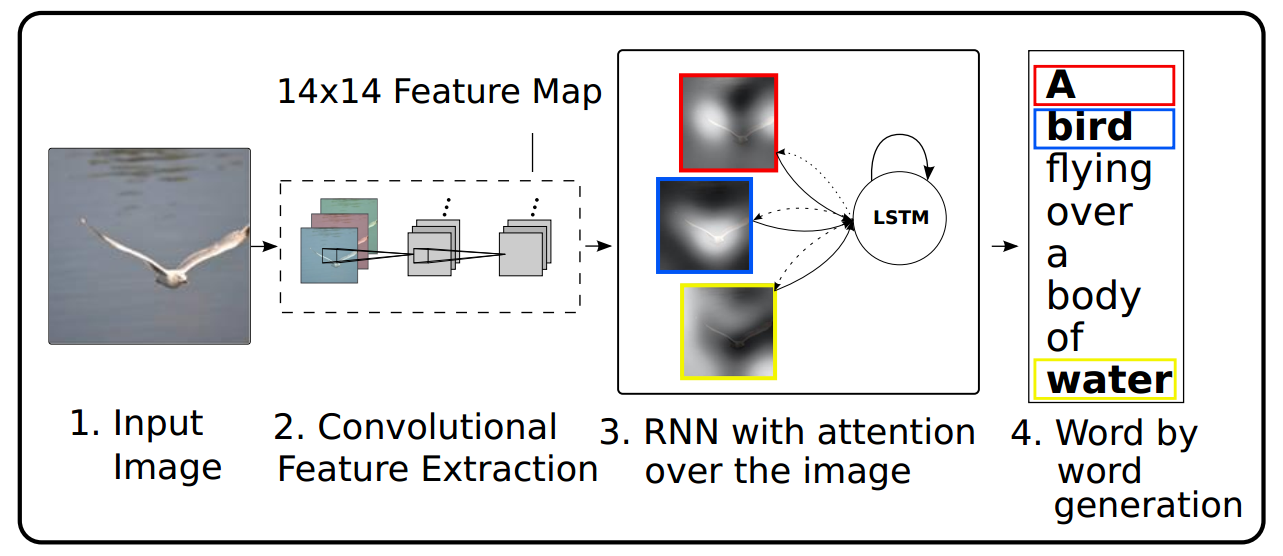

1.3. Show,attend and tell: neural image caption generation with visual attention.7

Image caption任务。

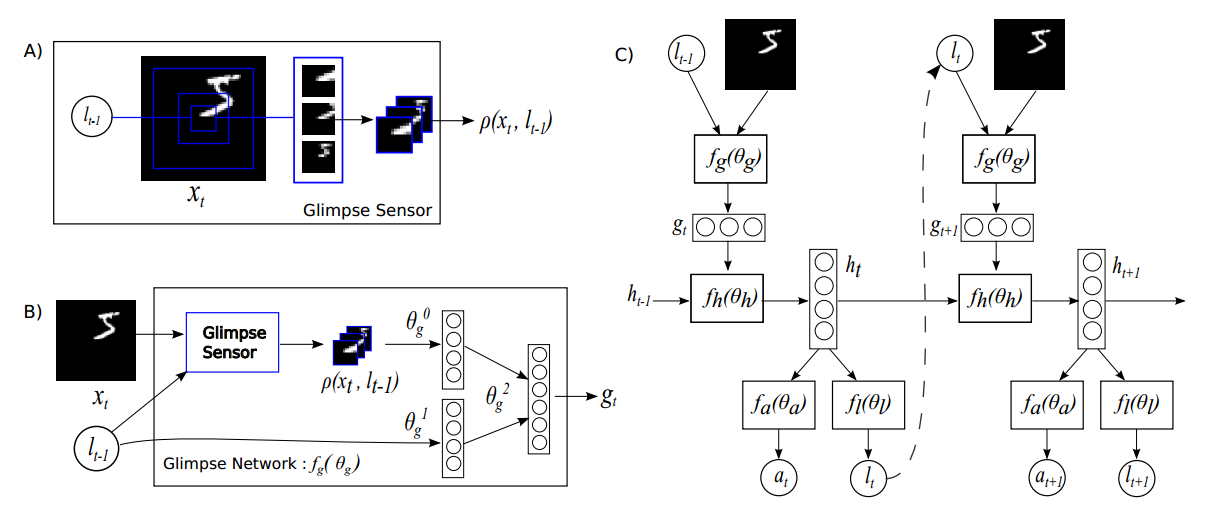

1.4. Recurrentmodels of visual attention.8

鼻祖。

5. Yan,S., Smith, J. S., Lu, W. & Zhang, B. CHAM: action recognition usingconvolutional hierarchical attention model.ArXiv Prepr. ArXiv170503146(2017).

6. Lee,C.-Y. & Osindero, S. Recursive recurrent nets with attention modeling forOCR in the wild. inProceedings of the IEEE Conference on Computer Visionand Pattern Recognition 2231–2239 (2016).

7. Xu,K. et al. Show, Attend and Tell: Neural Image Caption Generation withVisual Attention. in14, 77–81 (2015).

8. Mnih,V., Heess, N., Graves, A. & others. Recurrent models of visual attention.inAdvances in neural information processing systems 2204–2212 (2014).

602

602

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?