如果你是NLP领域初学者,欢迎关注我的博客,我不仅会分享理论知识,更会通过实例和实用技巧帮助你迅速入门。我的目标是让每个初学者都能轻松理解复杂的NLP概念,并在实践中掌握这一领域的核心技能。

通过我的博客,你将了解到:

- NLP的基础概念,为你打下坚实的学科基础。

- 实际项目中的应用案例,让你更好地理解NLP技术在现实生活中的应用。

- 学习和成长的资源,助你在NLP领域迅速提升自己。

不论你是刚刚踏入NLP的大门,还是这个领域的资深专家,我的博客都将为你提供有益的信息。一起探索语言的边界,迎接未知的挑战,让我们共同在NLP的海洋中畅游!期待与你一同成长,感谢你的关注和支持。欢迎任何人前来讨论问题。

【NLP 基础知识一】词嵌入(Word Embeddings)

【NLP 基础知识二】词嵌入(Word Embeddings)之“Word2Vec:一种基于预测的方法”

【NLP基础知识三】词嵌入(Word Embeddings)之“GloVe:单词表示的全局向量”

5、GloVe:单词表示的全局向量

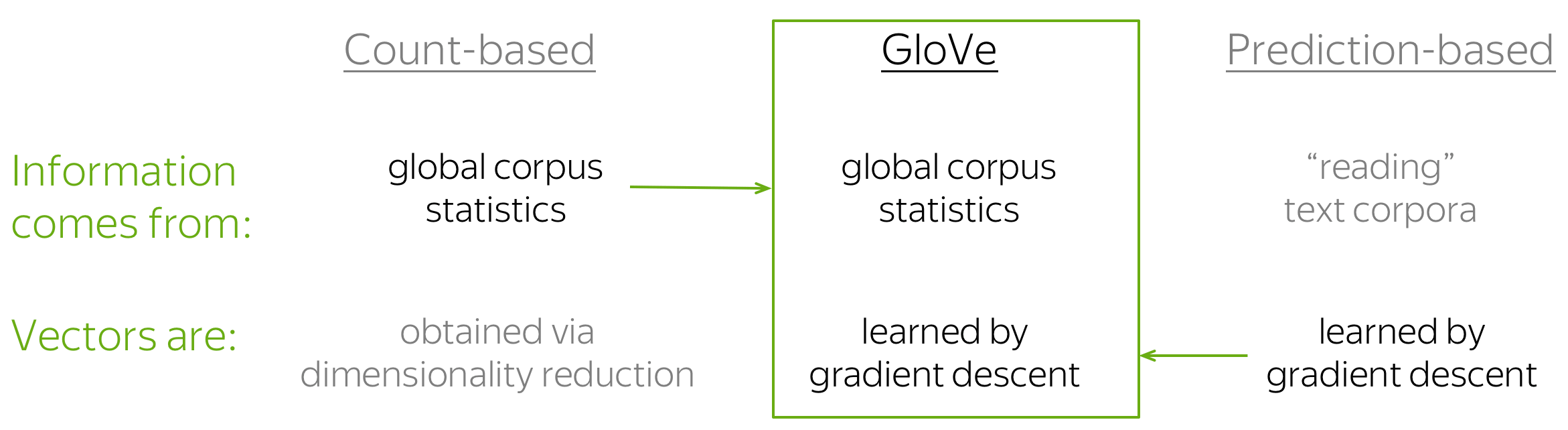

GloVe 模型是基于计数的方法和基于预测的方法(例如 Word2Vec)的组合。模型名称 GloVe 代表 Global Vectors,也体现了它的核心思想:利用语料库中的全局信息来学习词向量。

正如之前所见,最简单的基于计数的方法使用共现计数来衡量单词 w 和上下文 c 之间的关联:N(w, c)。类似地,GloVe 也使用这种计数来构建损失函数:

与 Word2Vec 类似,Glove 也有中心词向量和上下文词向量的区分,这二者构成了Glove的参数。 此外,该方法对每个词向量都引入了一个标量偏置项 (即上图的 b)。

有趣的地方在于,GloVe 控制了少见词和频繁词的影响:对每对 (w, c) 而言,损失将以如下方式加权:

- 对于罕见的 (w, c),损失会受惩罚,

- 对于频繁出现的 (w, c),损失也不会被过度加权。

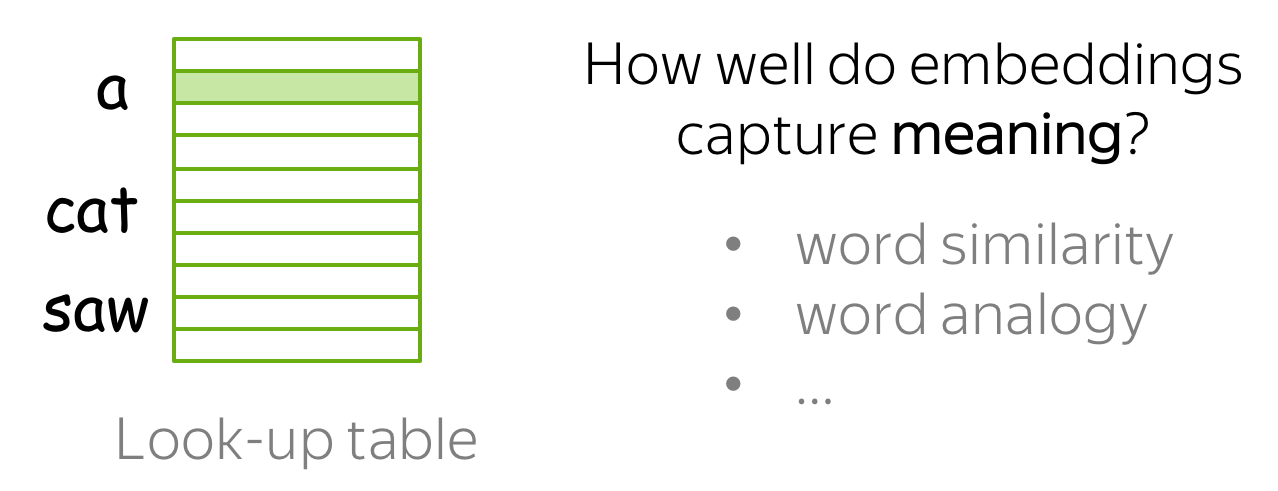

6、词嵌入的评价

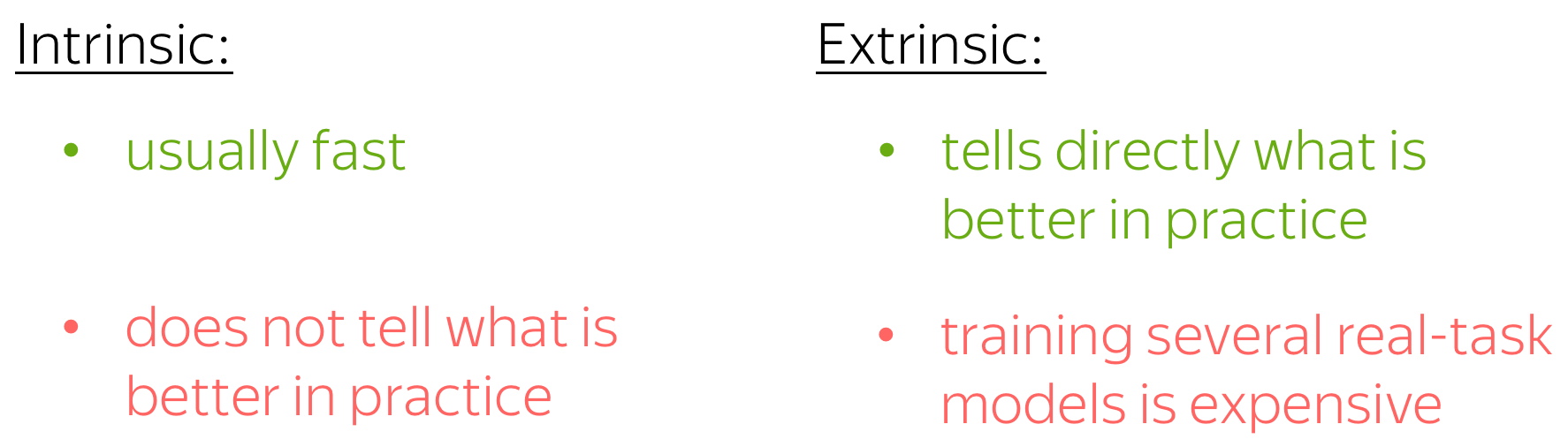

我们如何评价一种获取词嵌入的方法要比另一种更好呢?目前学术界有两种评估手段(不仅适用于词嵌入):内在评价和外在评价。

编者按:下文中我们使用词嵌入 (Word Embeddings) 来指代词向量 (Word Vectors),但实际上它们是一个东西。

内在评价:基于内在属性

这种类型的评价着眼于词嵌入的内在属性,即它们捕捉单词“含义”的程度。在分析与解释部分,我们将详细讨论如何通过词相似性和词类比任务上评价词嵌入。

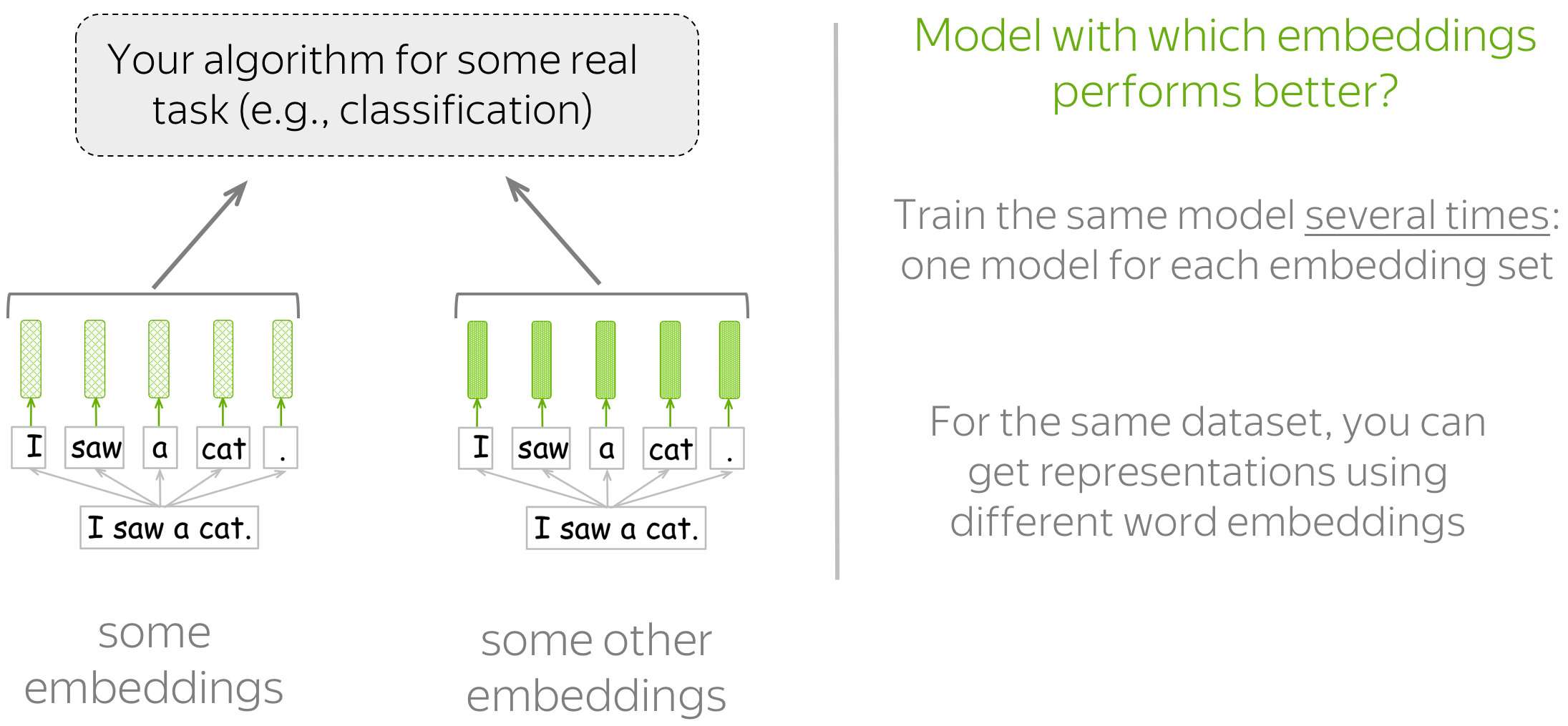

外部评价:基于下游任务

这种类型的评价会告诉读者哪些嵌入更适合读者真正关心的任务(例如,文本分类、指代消解等)。

在这种情况下,你必须为下游任务制定一个可以搭配不同词嵌入方法的模型。然后,通过模型的性能来确定哪些词嵌入方法更好。

如何选择

你必须要接受的是,没有完美的词嵌入,也没有适用于所有情况的词嵌入:它总是取决于很多事情。

关于评价,您通常更关心下游任务本身的性能。 因此,读者可能会对外部评价更感兴趣。 然而,下游任务上的模型通常需要大量的时间和资源来训练,尤其是当你需要训练多个的时候,训练成本可能过于昂贵。

至于选择哪个词嵌入,最后还是要取决于读者自己 😃

分析与解释

编者按:对于词嵌入,本节的大部分内容通常被认为是内在评价的手段之一。 但是,由于理解模型学到的内容(不是指特定任务上的性能)是人们通常为分析所做的事情,因此有了本分析部分。

漫步太空……语义空间!

语义空间旨在创建捕捉单词含义的自然语言表征。词嵌入构成了语义空间,所以我们一般会将多维空间中的一组词向量称作“语义空间”。

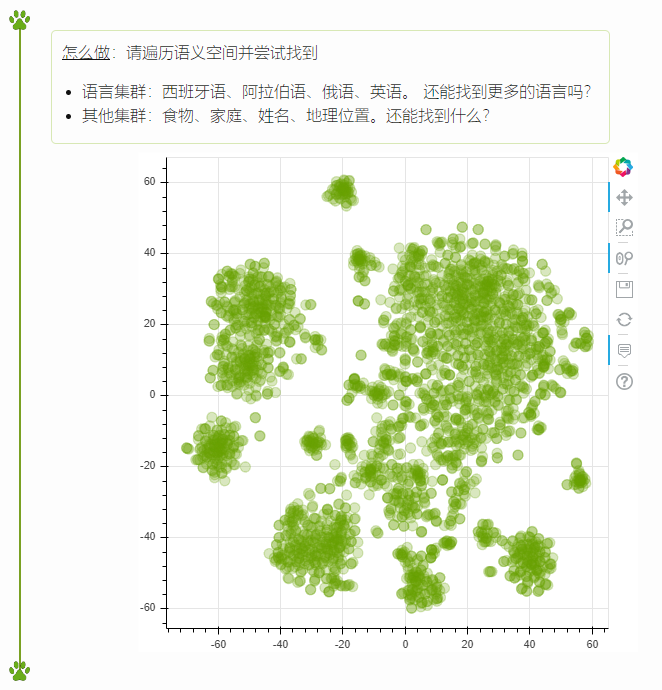

下面显示了在 twitter 数据(取自 gensim)上训练的 GloVe 向量形成的语义空间。 使用 t-SNE 将向量投影到二维空间,下图中展示了前3000个最常用的单词。

寻找最近的邻居(最近邻)

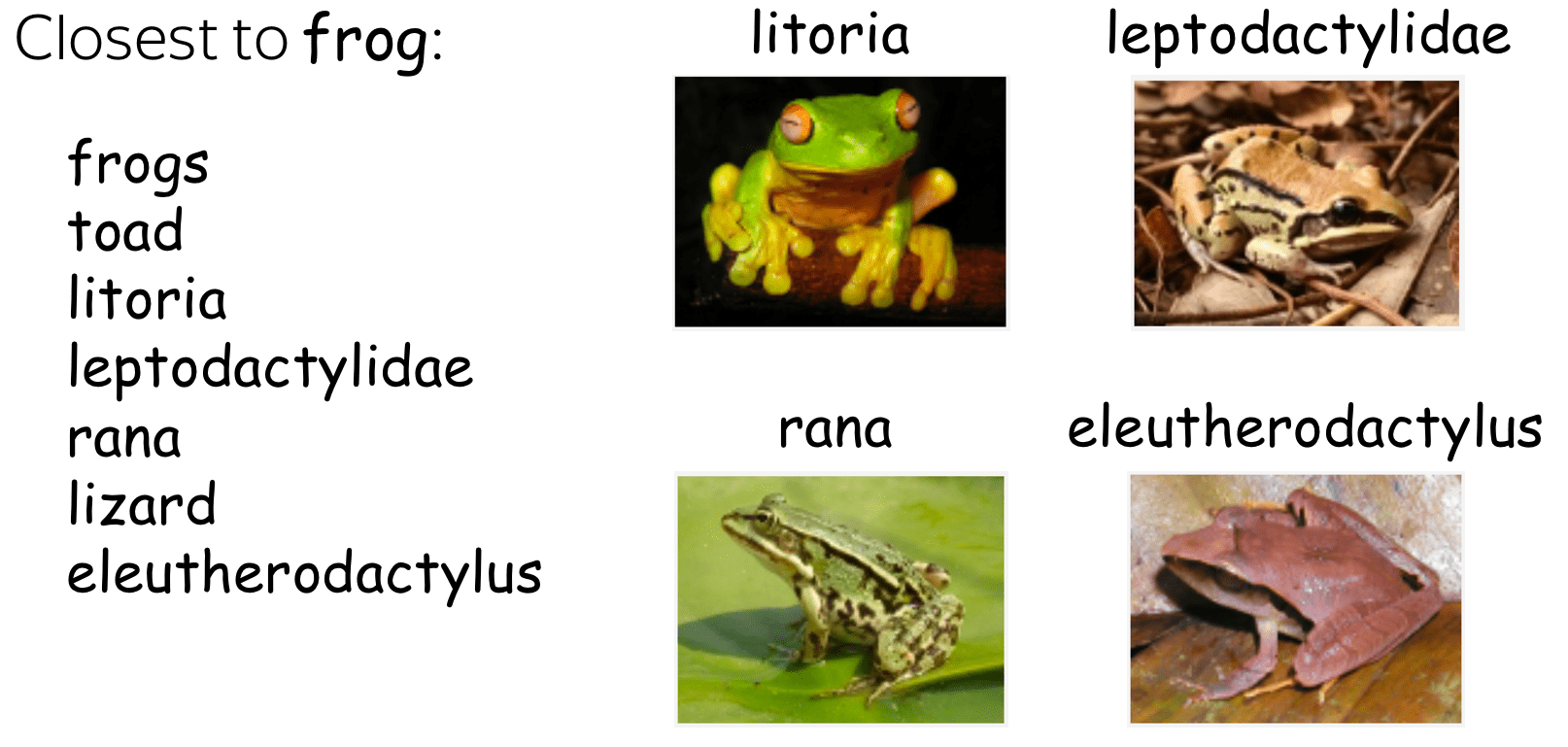

在浏览语义空间的过程中,可能读者会注意到某些点与它的邻居通常密切相关。有时,即使是罕见词也有类似性质。请看右图中的例子:语义空间中 leptodactylidae (细趾蟾科) 或 litoria (雨滨蛙属) 这两个罕见词与 frogs (青蛙) 的距离很近。

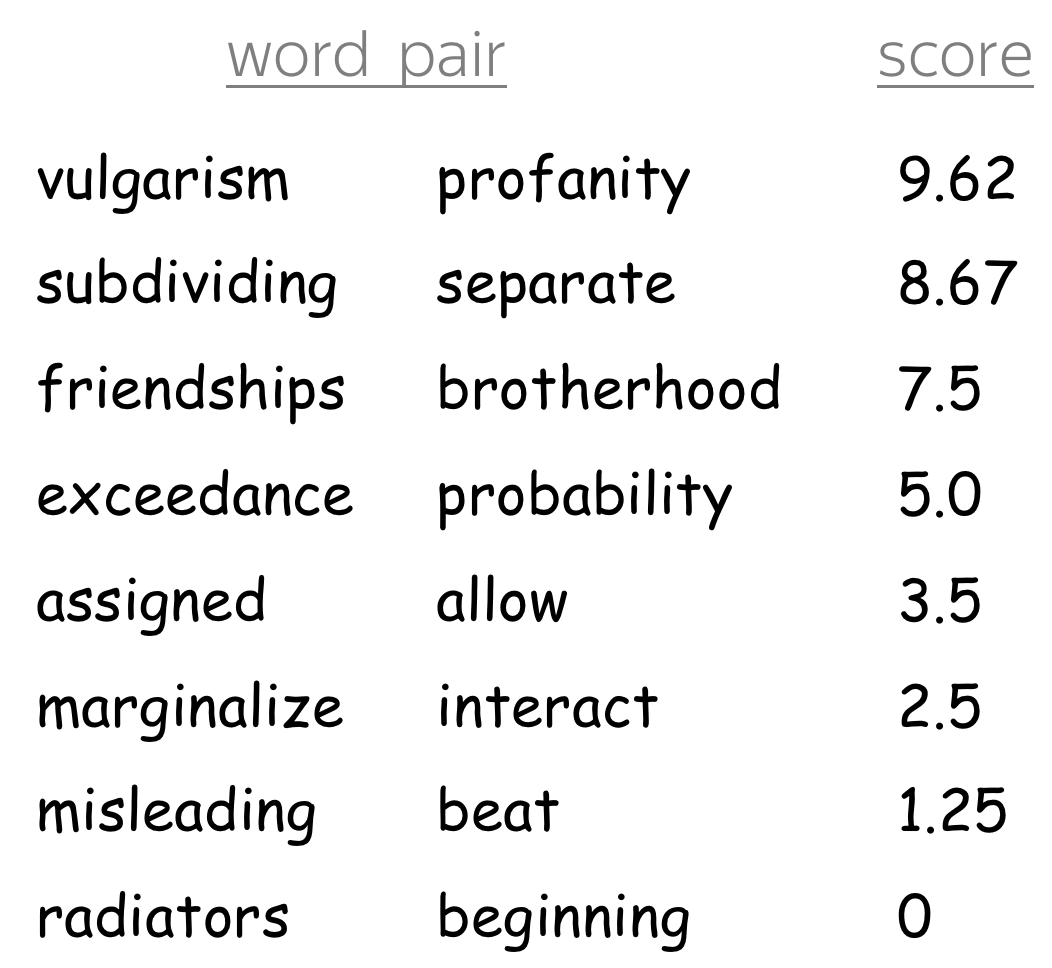

词相似度的测试基准

通过余弦相似度或欧几里得距离“查看”最近的邻居是评价模型所学习到的词嵌入质量的常用方法之一。学术界中已经有一些单词相似度的测试基准(即测试集),它们由人类判断有相似性的词对组成。词嵌入的质量可以用这些词对的相似度分数(分别来自模型和人类)之间的相关性所衡量。

线性结构

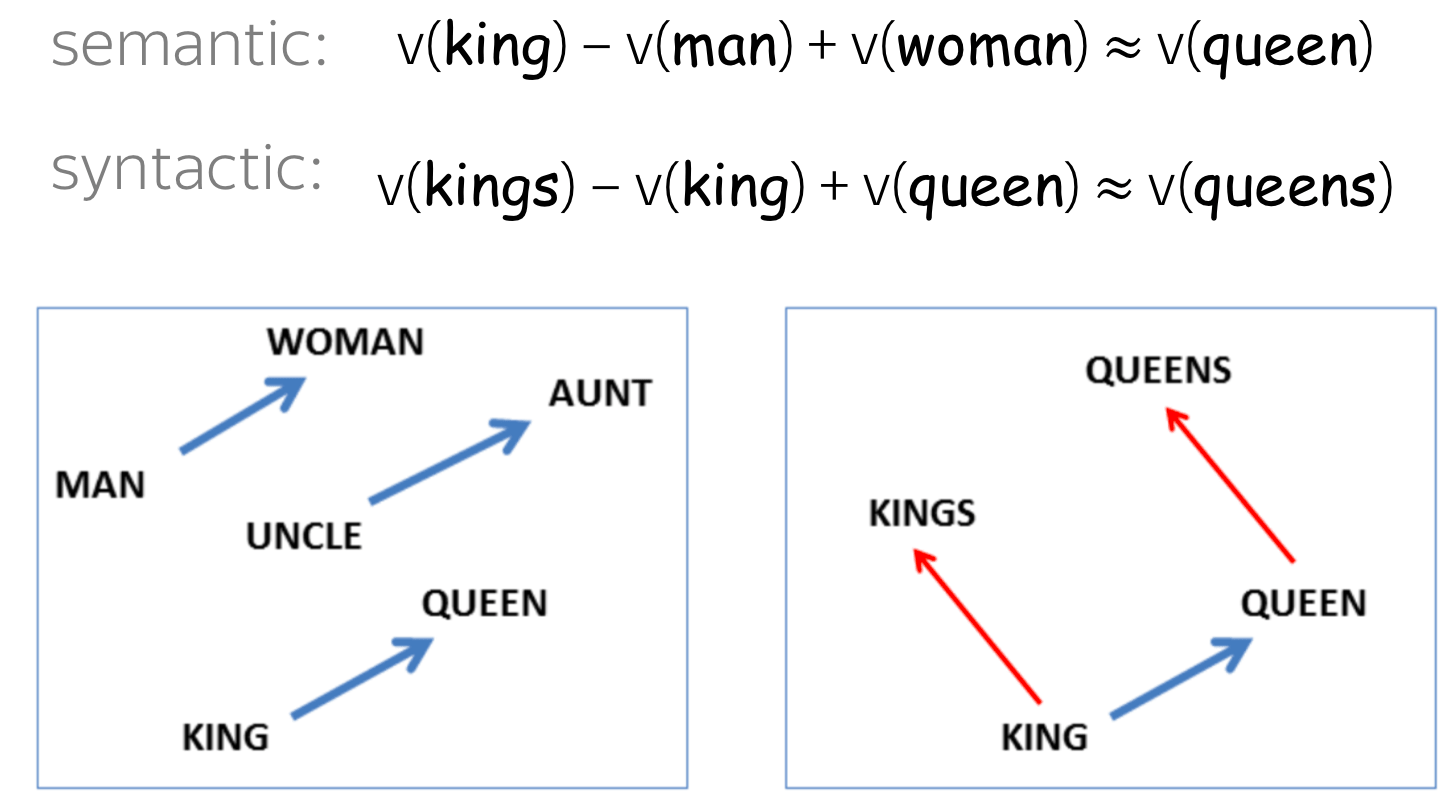

尽管词语相似度的结果令人鼓舞,但它们并不令人惊讶:因为词嵌入是专门训练来反映单词相似度的。真正令人惊讶的是,词之间的许多语义和句法关系在词向量空间中(几乎)是线性的。

例如,king (国王) 和 queen (王后) 之间的差距与 man (男人) 和 woman (女人) 之间的差距是类似的。 再例如,queens 是queen 的复数,正如同 kings 是 king 的复数。 man - woman

≈

\approx

≈ king - queen 的例子可能是最受欢迎的例子,但其实也有许多其他有趣的例子。

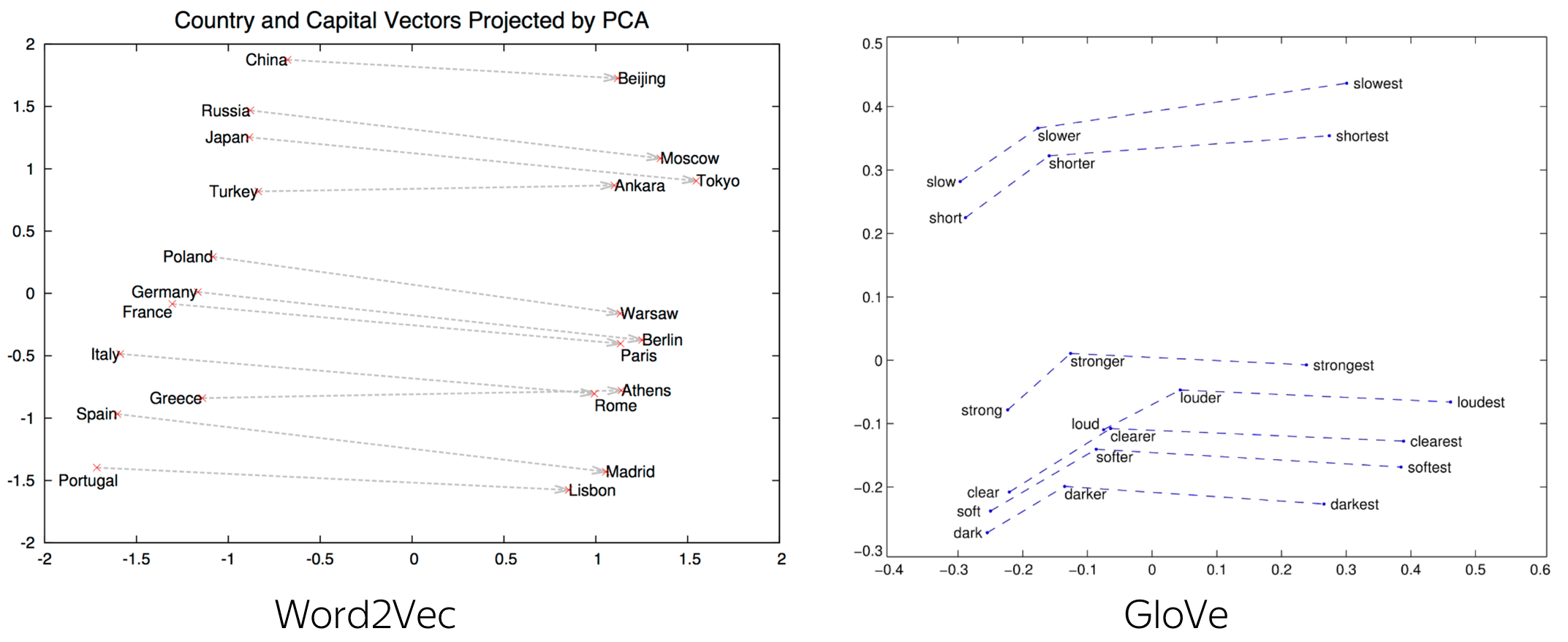

下面是 country-capital (国家-首都) 关系和一些句法关系的例子。

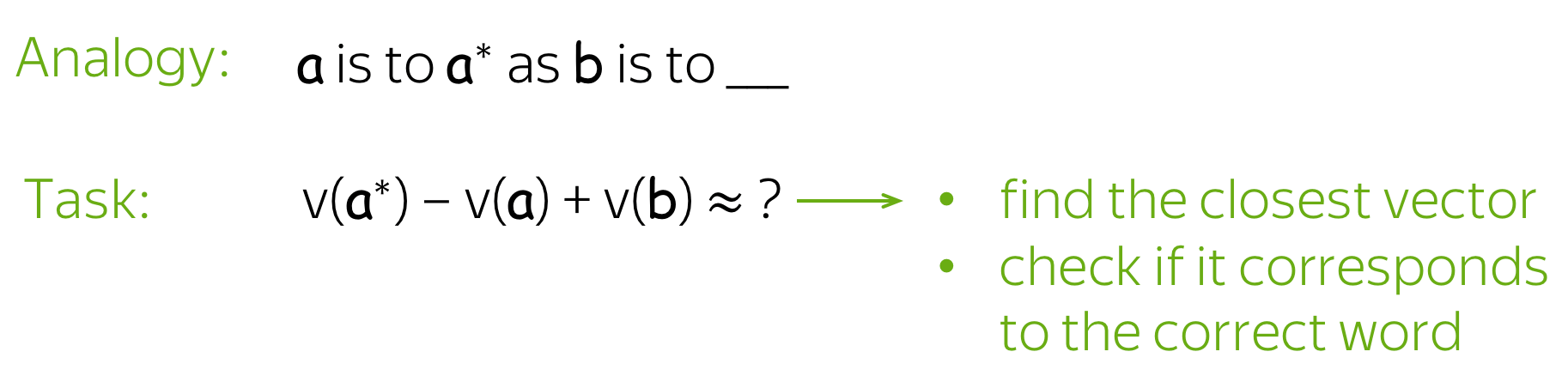

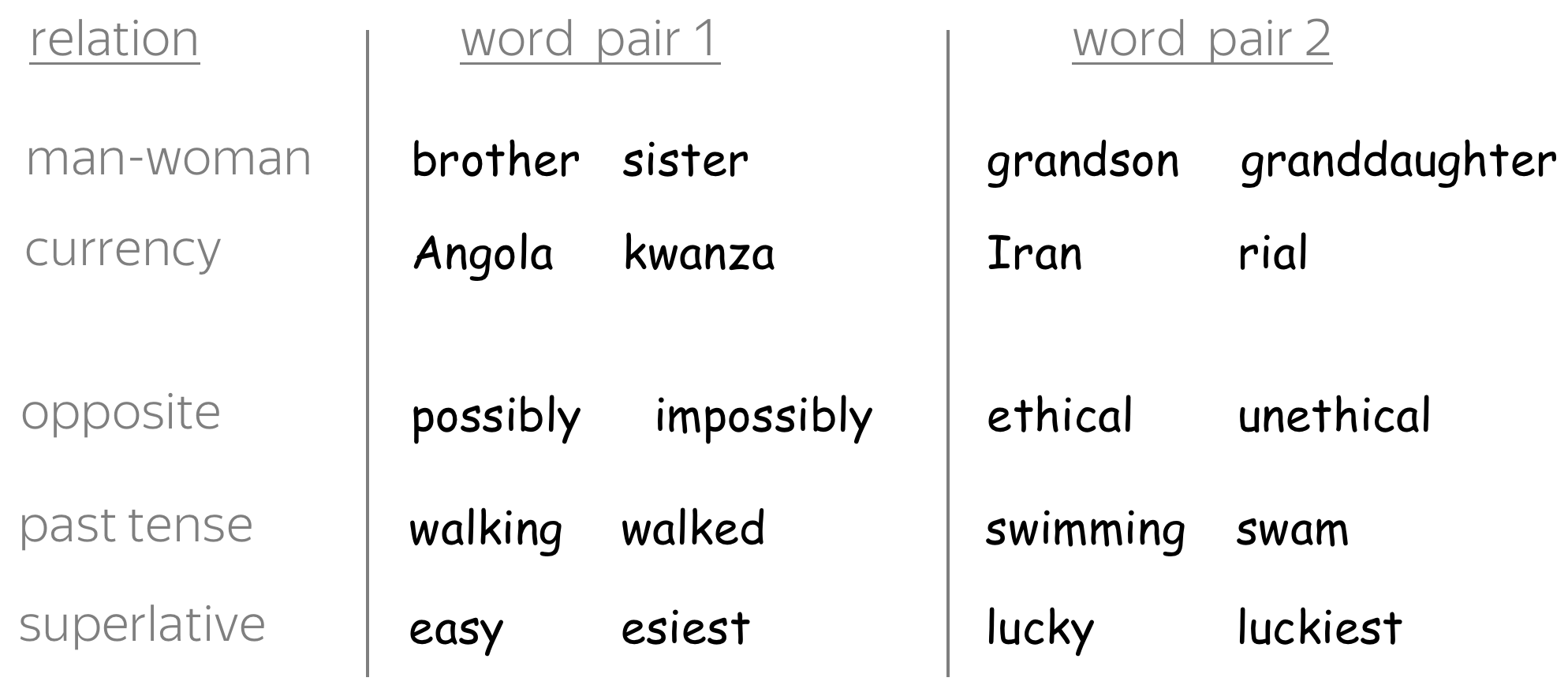

词类比的测试基准

上面所介绍的这些近似线性的关系启发了一种新型的评估方式:词类比评估 (Word Analogy Evaluation)。

给定相同关系的两个词对,例如 (man, woman) 和 (king, queen),词类比任务是检查模型是否可以根据任三个词来找到目标词。例如,我们需要检查与 king - man + woman 最接近的向量是否对应于单词 queen。

学术界已经有一些类比基准,其中包括 (MSR + Google analogy 测试集) 和 BATS (更大规模的类比测试集)。

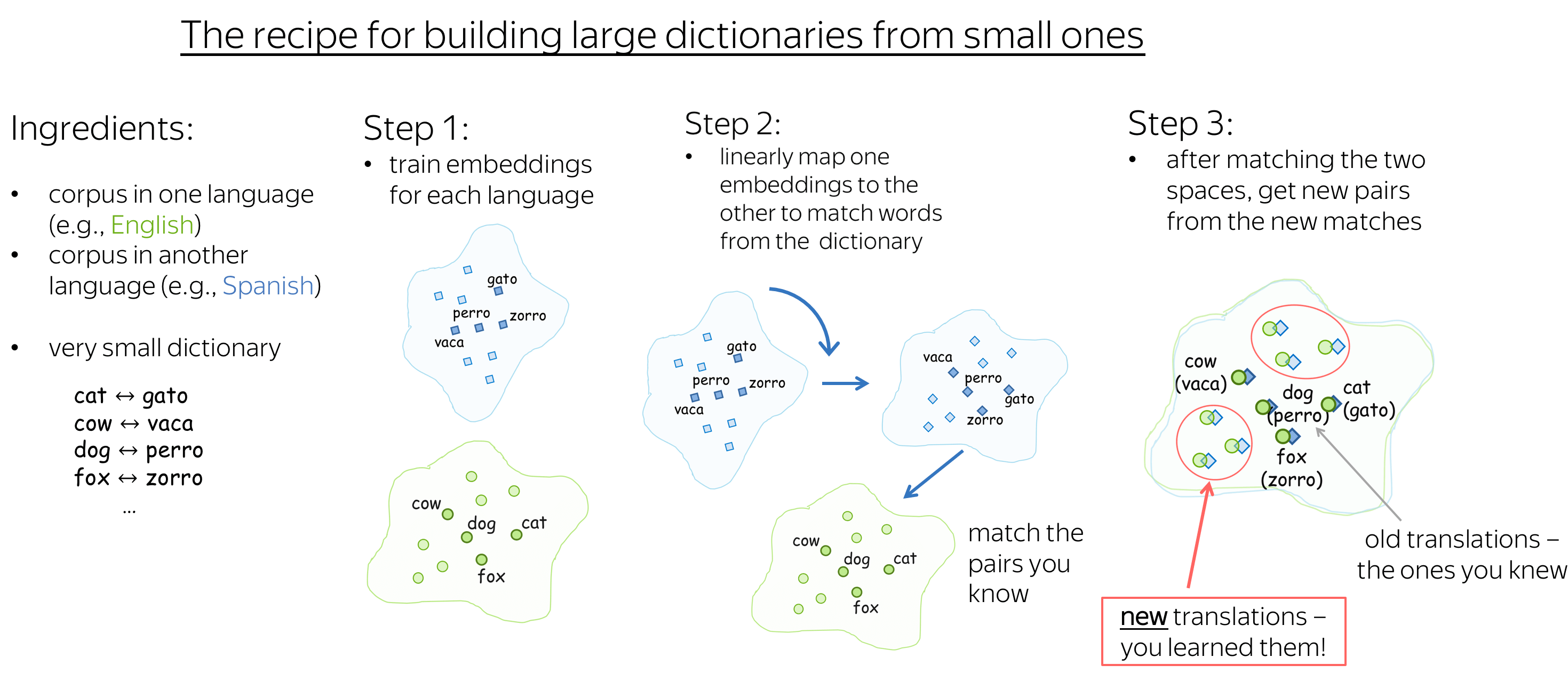

语言之间的相似性

我们可以看到单词之间的一些关系在语义空间中(几乎)都是线性的。那么,语言之间呢?事实证明,语言之间的语义空间也是(有点)线性的,这意味着你可以将一个语言的语义空间线性映射到另一个语言的语义空间,从而两种语言中语义相同的词在联合语义空间中可以匹配上。

在Word2Vec提出之后不久,上图形象地解释了 Tomas Mikolov 等人提出的方法。举个例子,我们得到一组词对及其向量表示

{

x

i

,

z

i

}

i

=

1

n

\{\color{#88a635}{x_i}\color{black}, \color{#547dbf}{z_i}\color{black} \}_{i=1}^n

{xi,zi}i=1n, 其中

x

i

\color{#88a635}{x_i}

xi 和

z

i

\color{#547dbf}{z_i}

zi 分别是源语言中第 i 个单词及其在目标语言中对应单词的向量。 优化目标是找到一个变换矩阵 W,使得

W

z

i

W\color{#547dbf}{z_i}

Wzi 近似于

x

i

\color{#88a635}{x_i}

xi:即从源语言空间匹配目标语言空间。

W

W

W 可以通过梯度下降法来学习,最小化以下目标:

W

=

arg

min

W

∑

i

=

1

n

∥

W

z

i

−

x

i

∥

2

W = \arg \min\limits_{W}\sum\limits_{i=1}^n\parallel W\color{#547dbf}{z_i}\color{black} - \color{#88a635}{x_i}\color{black}\parallel^2

W=argWmini=1∑n∥Wzi−xi∥2

在原始论文中,用来学习的词汇由源语言中5000个最常用的单词及其对应翻译单词组成,其余的词对都是通过学习得到。

在这个充满科技魔力的时代,自然语言处理(NLP)正如一颗璀璨的明星般照亮我们的数字世界。当我们涉足NLP的浩瀚宇宙,仿佛开启了一场语言的奇幻冒险。正如亚历克斯·康普顿所言:“语言是我们思想的工具,而NLP则是赋予语言新生命的魔法。”这篇博客将引领你走进NLP前沿,发现语言与技术的交汇点,探寻其中的无尽可能。不论你是刚刚踏入NLP的大门,还是这个领域的资深专家,我的博客都将为你提供有益的信息。一起探索语言的边界,迎接未知的挑战,让我们共同在NLP的海洋中畅游!期待与你一同成长,感谢你的关注和支持。欢迎任何人前来讨论问题。

197

197

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?