梯度:

梯度是一个向量求导的导数:f的梯度是包含所有偏导数的向量。向量的导数还是一个向量,所以梯度既是导数又是向量。

梯度的方向:与这个函数在该点增长最快的方向一致。梯度的大小:|梯度|=max(方向导数)

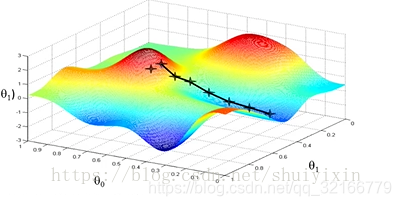

梯度下降法作用:求损失函数(loss function) 最小值

吴恩达笔记:沿着下坡走,找到局部最小值,下坡方向就是梯度反方向,最小值就是loss function的

深度学习花书笔记:

一维时

y=f(x)

f(x+ε)≈ f(x)+εf’(x)

因为f(x-εsign(f’(x)))是比f(x)小的,往导数反方向走

多维时

则是往所有向量的偏导数方向走。

2921

2921

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?