多元变量线性回归

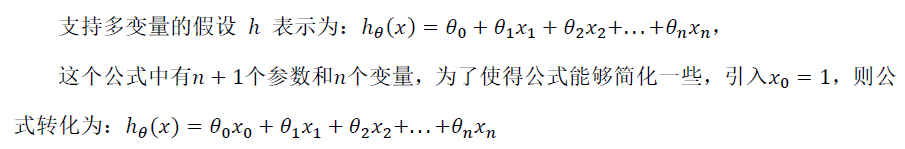

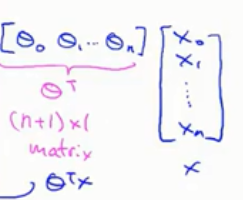

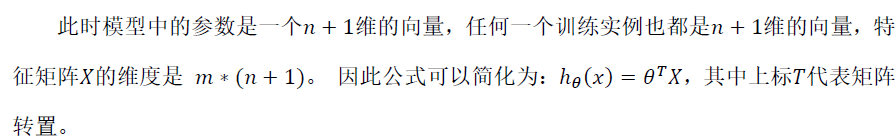

1.多维特征:

2.多元梯度下降:

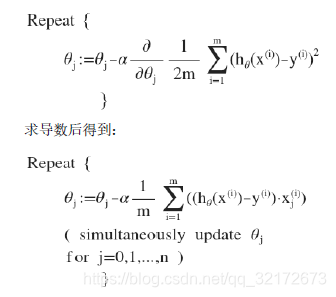

代价函数:(目标与单变量一致,要找出使代价函数最小的一系列参数)

![]()

梯度下降算法:

梯度下降算法——特征缩放:

除了固定以外,

的值都要变成[-1,1]范围左右之间的取值,不仅仅是[-1,1],可以在该范围内波动,但是不要幅度太大。

的值都要变成[-1,1]范围左右之间的取值,不仅仅是[-1,1],可以在该范围内波动,但是不要幅度太大。

![]() (平均值指的是训练集中不同组别的同一特征值的平均值)

(平均值指的是训练集中不同组别的同一特征值的平均值)

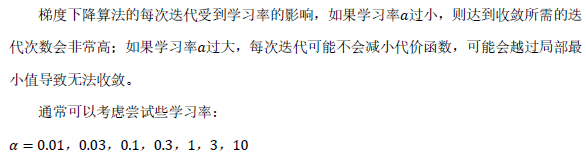

梯度下降算法——学习率

观测算法收敛的现象:可以绘制迭代次数与代价函数的的图表;也可以将代价函数的变化与某个阈(如0.001)值进行比较。

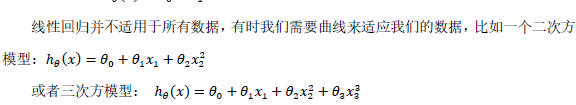

根据不同的情况,建立不同的模型

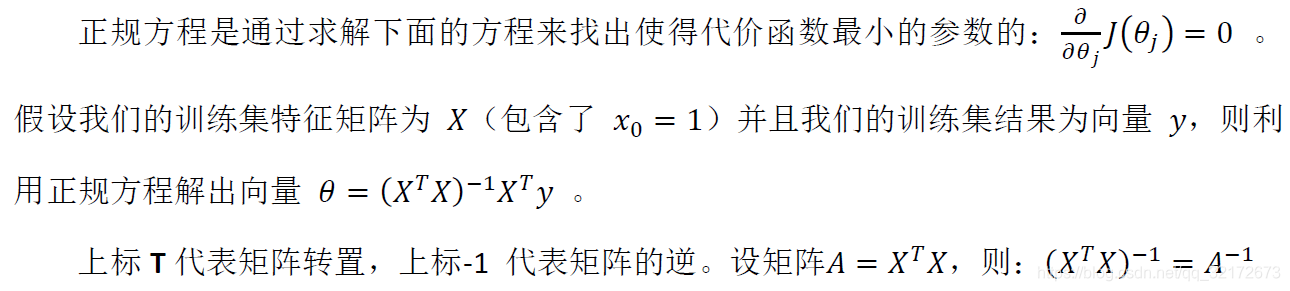

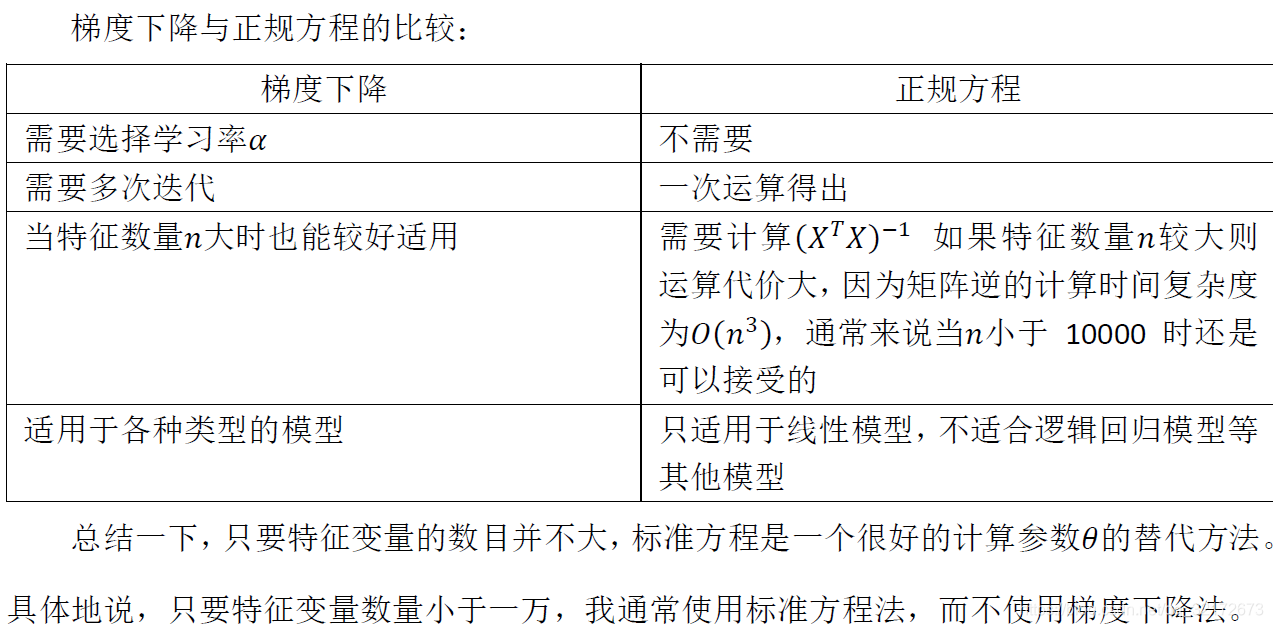

3.正规方程

这样求出来的?向量就是最优解,即该?向量中的n个?值为使得代价函数最小的一系列最优值。

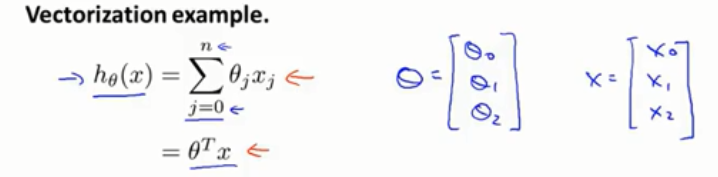

3.向量化

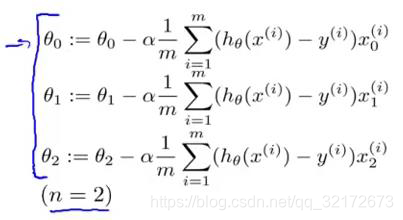

梯度下降回归计算:

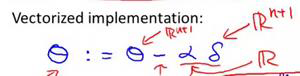

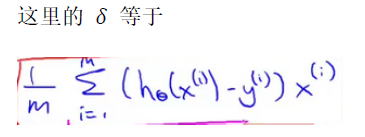

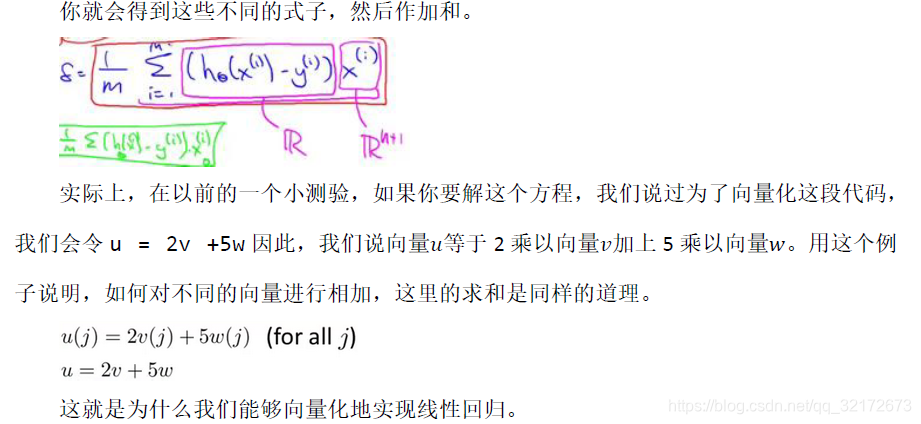

等价换算为:把 ?看做一个向量,然后用 ?-? 乘以某个别的向量来更新 ?。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?