论文:《Going Deeper with Convolutions》

论文翻译:https://www.jianshu.com/p/3942b7e33e95

参考资料:https://blog.csdn.net/qq_34886403/article/details/82290009

摘要

在ImageNet大规模视觉识别挑战赛2014(ILSVRC14)上提出了一种代号为Inception的深度卷积神经网络结构,并在分类和检测上取得了新的最好结果。GoogLeNet是在ILSVRC14提交中应用的一个Inception网络特例,是一个22层的深度网络。

近期工作

最近神经网络大致趋势是,增加网络深度,增加网络层宽度,利用dropout解决过拟合问题。

Inception结构大量使用了1x1卷积层,主要原因是:它可以通过降维来解决计算的瓶颈,同时也可以加深网络的深度,或者是宽度。

1×1卷积

1×1卷积首先是出现在Network in Network这篇论文当中,作者想要让网络变得更深,但并不是简单的去增加神经网络的层数。

如果卷积的输出输入都是一个平面,那么1X1卷积核并没有什么意义,它是完全不考虑像素与周边其他像素关系。但卷积的输出输入是长方体,所以1X1卷积实际上对每个像素点,在不同的channels上进行线性组合(信息整合),且保留原有平面结构,调控depth,从而完成升维或降维的功能。

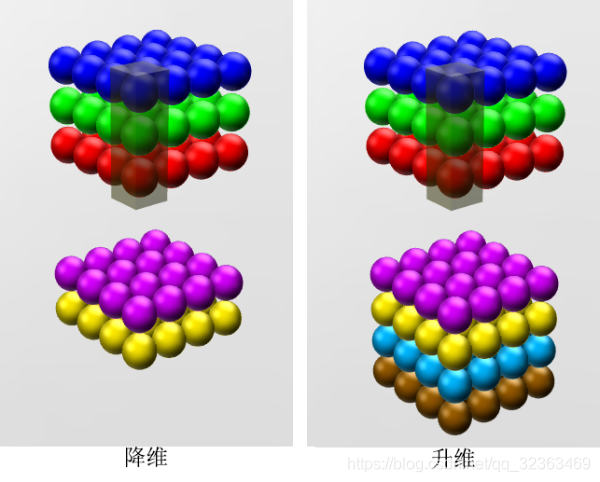

下图所示,如果选择2个filters的1X1卷积层,那么数据就从原来的depth 3降到了2。若用4个filters,则起到了升维的作用。

参考:https://www.jianshu.com/p/04c2a9ccaa75

动机和高层次的探索

提高深度神经网络性能最直接的方式是增加它们的尺寸,包括增加网络深度与宽度。但是这样的做法主要有两个缺点:1、参数更多,意味着容易出现过拟合。2、是占用更多的计算资源,假如网络体积很大,但是很多权重接近于0,这是没用的,完全是浪费资源。

解决上述两个缺点的方法是引入稀疏性和用稀疏连接替代全连接层。引入稀疏性是指用一个复杂的结构近似局部最优稀疏,以接近生物神经系统(这是Inception的核心)。这引出中间步骤的问题:能否通过一个结构实现类似滤波器的稀疏性?更有研究表明,将稀疏的矩阵聚类为相对密集矩阵会有更佳的性能。所以作者提出用一个复杂的结构来近似局部最优稀疏结构。

稀疏矩阵

在矩阵中,若数值为0的元素数目远远多于非0元素的数目,并且非0元素分布没有规律时,则称该矩阵为稀疏矩阵;与之相反,若非0元素数目占大多数时,则称该矩阵为稠密矩阵。定义非零元素的总数比上矩阵所有元素的总数为矩阵的稠密度。

结构细节

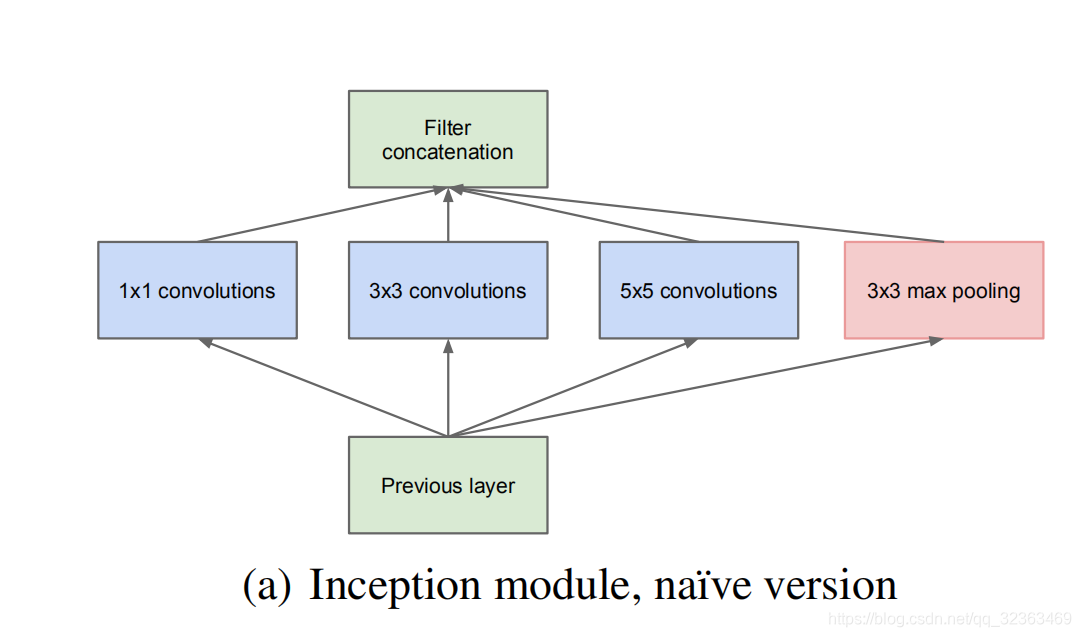

为了避免patch-alignment问题,Inception结构采用的卷积核尺寸限制在1x1,3x3和5x5,经过上述卷积核,所有输出将会叠加到一个矩阵上。同时,pooling结构是当前卷积网络成功的关键,所以在增加一个并行的pooling结构。

随着Inception结构的叠加,他们的相关输出统计会发生变化,在层次较深的地方,捕获到的更抽象特征,他们的空间集中度会降低,所以要采用更大的卷积核,所以建议在高层次中增加使用3x3,5x5的卷积核。

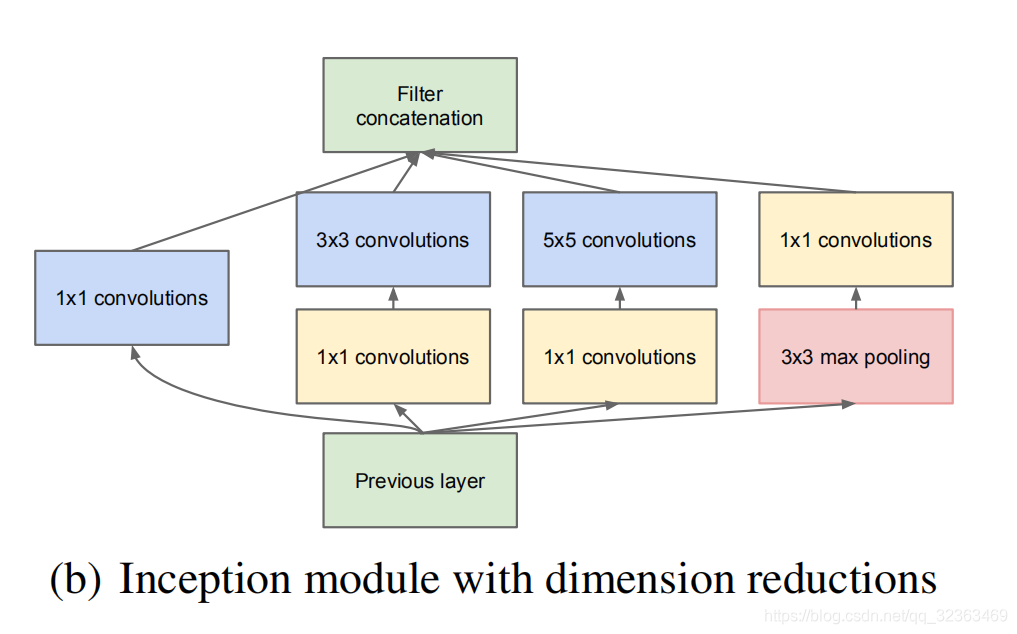

上面Inception结构存在一个重要的问题—‘计算量’,在深层的卷积网络中,适度数量的5x5卷积操作是被禁止的。一旦加入了pooling操作,这个问题就尤为突出。将pooling与卷积结构合并输出,将会大大增加输出数量。为了解决这个问题,提出‘降维’的想法。论文中提出使用1x1的卷积核进行降维。1x1的卷积核不仅可以降维,同时还有修正线性特性。

Inception网络是指由Inception模块堆积而成的网络,偶尔在Inception模块之间使用步长为2的max-pooling对网络进行采用。由于技术原因,在高层次中使用Inception模块,在底层仍使用传统的卷积网络效果更好。

这个结构一个有用的地方是:他可以显著的增加每个阶段的神经元数量,但又不会造成下个阶段非常大的计算复杂度。他是通过在大型卷积前使用1x1卷积核进行降维实现。

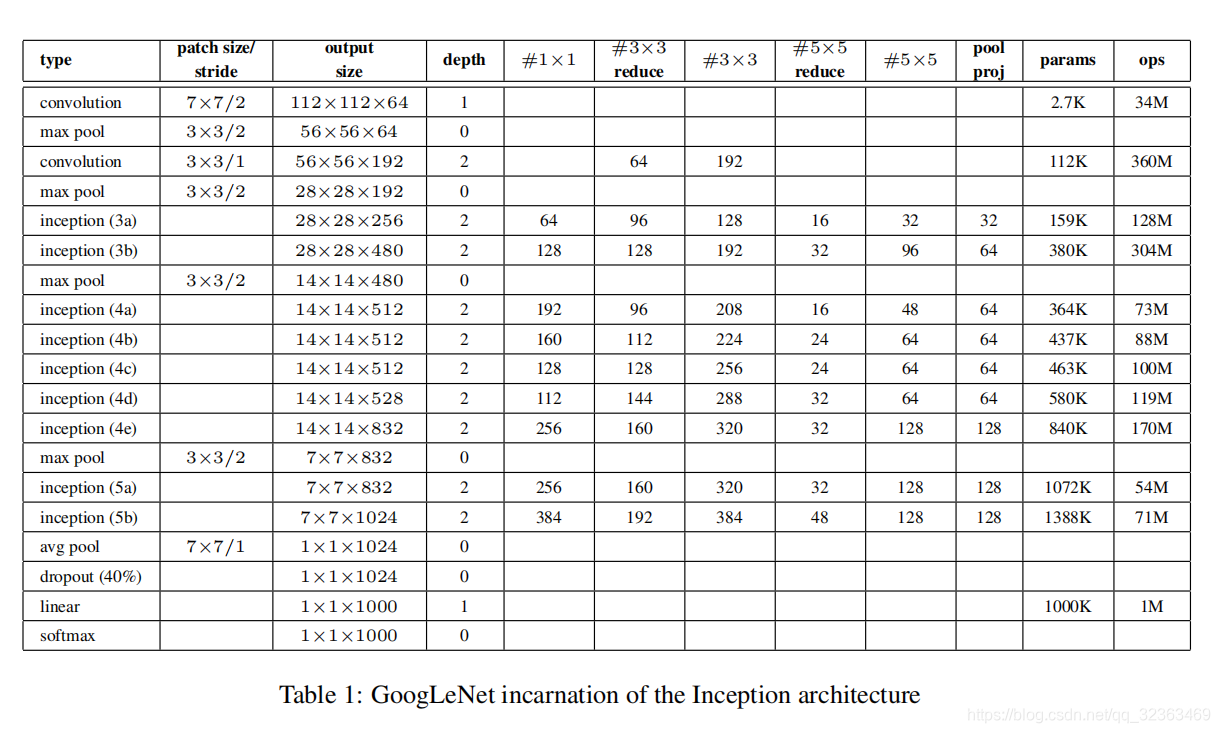

GoogLeNet

所有的卷积都使用了修正线性激活,包括Inception模块内部的卷积。在我们的网络中感受野是在均值为0的RGB颜色空间中,大小是224×224。“#3×3 reduce”和“#5×5 reduce”表示在3×3和5×5卷积之前,降维层使用的1×1滤波器的数量。在pool proj列可以看到内置的最大池化之后,投影层中1×1滤波器的数量。所有的这些降维/投影层也都使用了线性修正激活。

因为网络比较深,考虑到梯度反向传播的问题,在中间层增加的辅助分类器,在训练阶段,辅助分类器的误差以0.3的权重加到主网络的误差上面。在测试时候去掉辅助分类器。

因为网络比较深,考虑到梯度反向传播的问题,在中间层增加的辅助分类器,在训练阶段,辅助分类器的误差以0.3的权重加到主网络的误差上面。在测试时候去掉辅助分类器。

3235

3235

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?