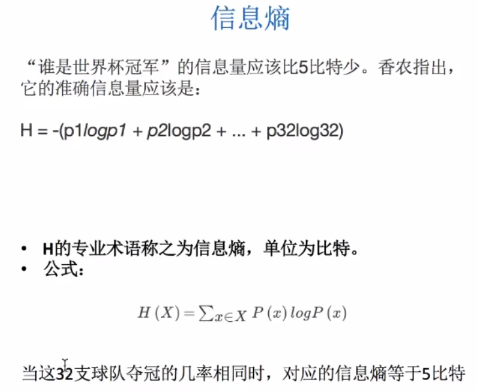

信息熵和信息增益

信息熵(information entropy)是信息论的基本概念。描述信息源各可能事件发生的不确定性。

信息增益:在概率论和信息论中,信息增益是非对称的,用以度量两种概率分布P和Q的差异。信息增益描述了当使用Q进行编码时,再使用P进行编码的差异。通常P代表样本或观察值的分布,也有可能是精确计算的理论分布。Q代表一种理论,模型,描述或者对P的近似。

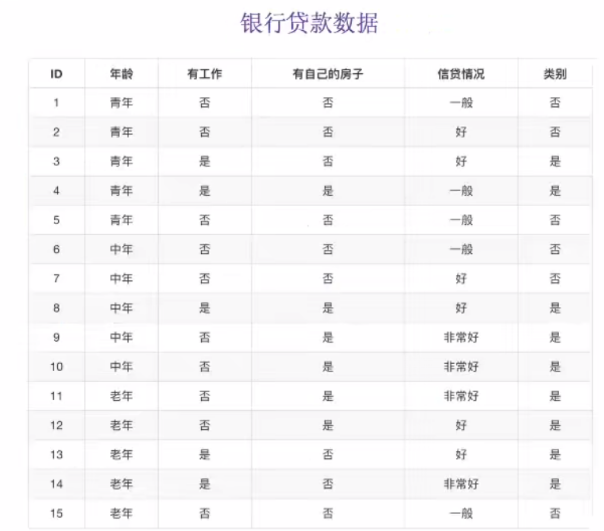

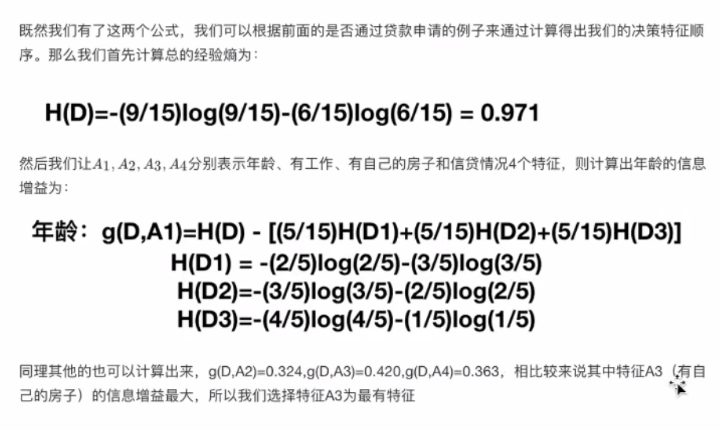

上述计算均针对于目标值,总共15条数据,9个是,6个否,对于年龄,又分为青年、中年和老年;各占1/3,对于青年,有2个是,3个否,计算青年的信息熵,对于中年和老年同样可计算信息熵,最后计算出年龄的信息增益是信息熵-年龄的条件熵

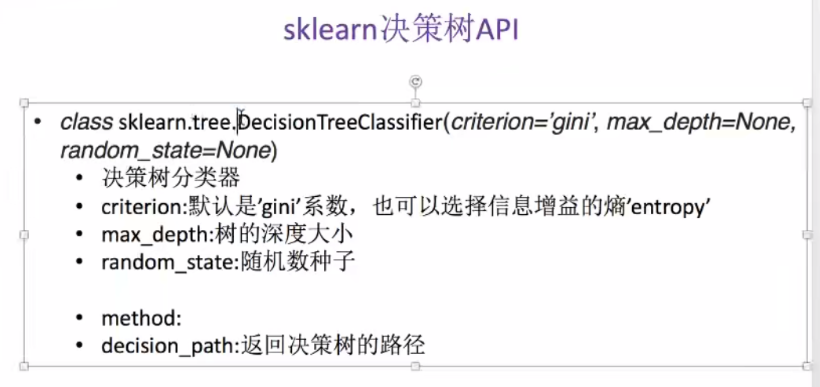

决策树

决策树的划分依据之一就是信息增益

实例

使用决策树进行乳腺癌的分类

from sklearn.datasets import load_breast_cancer

from sklearn.model_selection import train_test_split

from sklearn.tree import DecisionTreeClassifier, export_graphviz

#导入数据集

data = load_breast_cancer()

#查看特征维度

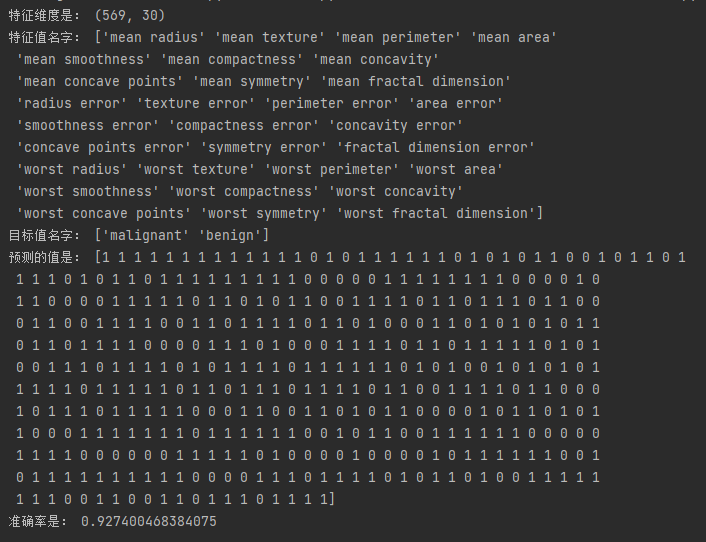

print('特征维度是:',data.data.shape)

#特征值名字

print('特征值名字:',data.feature_names)

#目标值名字

print('目标值名字:',data.target_names)

#分为训练集及测试集

x_train,x_test,y_train,y_test = train_test_split(data.data,data.target,train_size=0.25)

#使用决策树

dec = DecisionTreeClassifier() #默认基尼系数

dec.fit(x_train,y_train)

#输出预测值

y_pre = dec.predict(x_test)

print('预测的值是:',y_pre)

#输出准确率

print('准确率是:',dec.score(x_test,y_test))

#导出决策树图dot格式

export_graphviz(dec,out_file='./tree.dot',feature_names=data.feature_names,class_names=data.target_names)

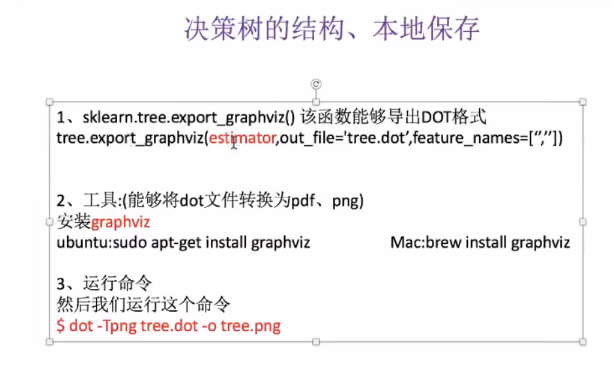

其中可以导出决策树图

需要安装graphviz,可以pip安装,将安装目录的bin 放入环境变量。重启电脑就可以使用命令了。

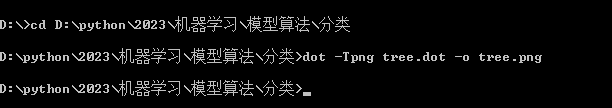

cmd进入到tree.dot所在的文件夹,输入命令dot -Tpng tree.dot -o tree.png

390

390

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?