Joint Detection and Identification FeatureLearning for Person Search(整合行人检测和行人再识别的行人搜索新框架)

Abstract

现存的行人再识别基准和方法主要是在queries and candidates之间匹配已经裁剪过的行人图片。但是现实中的场景不会这样理想,在做行人搜索时,我们需要先用行人检测的方法标记出行人,再用行人再识别的方法搜索出特定的人。

本文提出了一个针对行人搜索的新的深度学习框架,它能够将行人检测和行人再识别整合到一个卷积神经网络。本文建议使用在线实例匹配(online instance matching,简称OIM)损失函数来训练网络,因为它能很好的适应大量的识别数据集。

数据集包含18184 images,8432 identities和96143个行人包围框,实验结果展示,这个整合的框架比那些为整合的方式工作的更好,并且OIM损失函数比传统的softmax损失函数收敛更快。

1. Introduction

行人再识别旨在在gallery中匹配target person。他在视频方面有广泛的应用,如识别嫌疑犯,交叉视频的行人跟踪(两个以上摄像机拍摄到的内容,不一定连续),行人活动分析。这个问题具有挑战性,因为人的姿势,摄像机的角度,光线,背景噪声等都会影响检测。

尽管已经提出了大量的行人再识别数据集和方法,但是他们还是很难应用到现实世界中。因为行人再识别的研究使用的数据集大多数是手工标记的剪切过的图片。

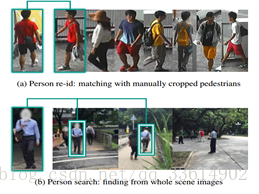

如上图,可以很清晰的解释了行人再识别和行人搜索的不同点。行人再识别,是在已经假设行人检测已经做的完美的基础上做的再识别研究。而行人搜索更贴近于现实世界的应用,更具有挑战性,正如检测行人时可能不可避免的出现false alarms(假正例吗?不确定),漏检,misalignments(包围框错位),这些都会对行人搜索的效果产生影响。

在2014年,有人首次将行人检测和再识别结合起来,提出一种基于行人检测和人的匹配得分的滑动窗口方案来解决行人搜索问题。但是手工设计特征和滑动窗口的自身存在的限制性因素越来越明显。

文章中,提出了一个针对行人搜索的新框架。传统的方法时将这个问题分成两个任务(行人检测和行人再识别)。他们在一个单一的CNN中处理这两个任务。

我们的CNN包括两个部分,给出输入是gallery image,用pedestrain proposal net(行人候选网络)来产生候选行人的bounding boxes(包围框),然后将他们放入identificationnet(身份识别网络)来提取特征,最后和target person 进行比较。Pedestrain proposal net和identification net 在整合优化中相互适应。例如:proposalnet会更优先候选框的召回率(召回率高,那么假正例率也会变高)而不是精确率(精确率高那么假反例就会增多),因为这些假正例(非行人却被误认为是行人的候选框)会在后面的特征匹配中被剔除掉。同时

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9289

9289

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?