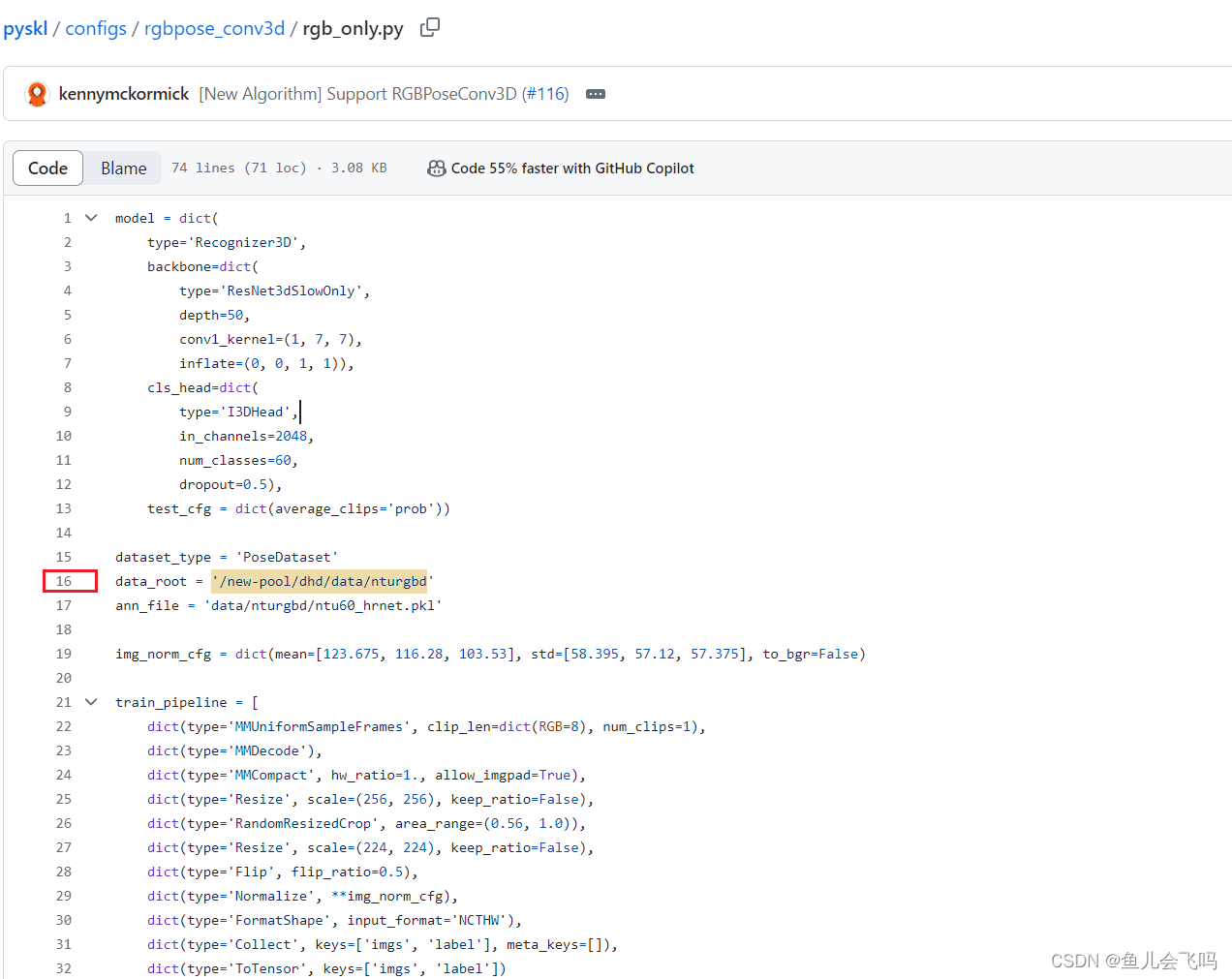

model = dict(

type='Recognizer3D',

backbone=dict(

type='ResNet3dSlowOnly',

depth=50,

conv1_kernel=(1, 7, 7),

inflate=(0, 0, 1, 1)),

cls_head=dict(

type='I3DHead',

in_channels=2048,

num_classes=60,

dropout=0.5),

test_cfg = dict(average_clips='prob'))

dataset_type = 'PoseDataset'

data_root = '/new-pool/dhd/data/nturgbd'

ann_file = 'data/nturgbd/ntu60_hrnet.pkl'

img_norm_cfg = dict(mean=[123.675, 116.28, 103.53], std=[58.395, 57.12, 57.375], to_bgr=False)

train_pipeline = [

dict(type='MMUniformSampleFrames', clip_len=dict(RGB=8), num_clips=1),

dict(type='MMDecode'),

dict(type='MMCompact', hw_ratio=1., allow_imgpad=True),

dict(type='Resize', scale=(256, 256), keep_ratio=False),

dict(type='RandomResizedCrop', area_range=(0.56, 1.0)),

dict(type='Resize', scale=(224, 224), keep_ratio=False),

dict(type='Flip', flip_ratio=0.5),

dict(type='Normalize', **img_norm_cfg),

dict(type='FormatShape', input_format='NCTHW'),

dict(type='Collect', keys=['imgs', 'label'], meta_keys=[]),

dict(type='ToTensor', keys=['imgs', 'label'])

]

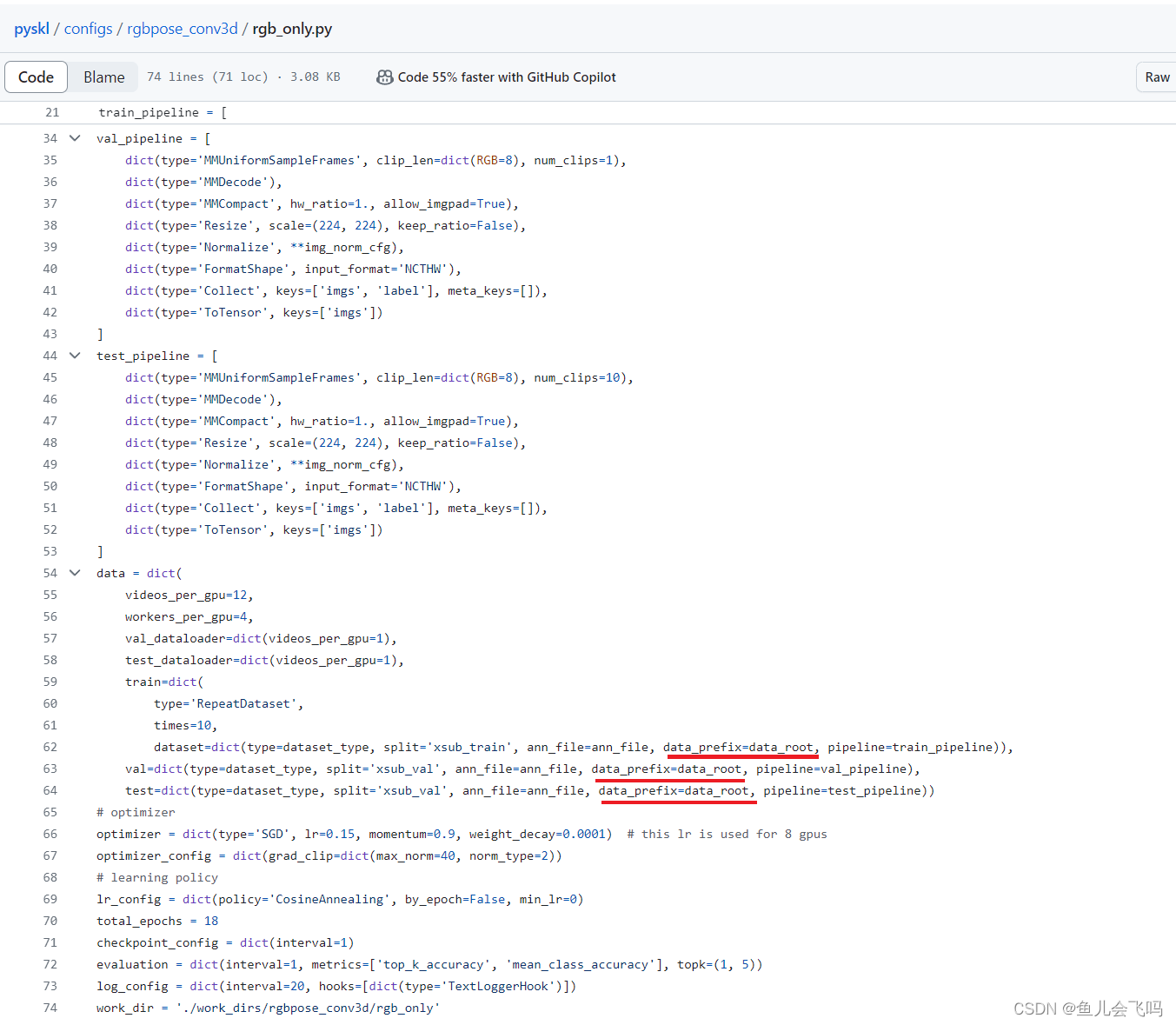

val_pipeline = [

dict(type='MMUniformSampleFrames', clip_len=dict(RGB=8), num_clips=1),

dict(type='MMDecode'),

dict(type='MMCompact', hw_ratio=1., allow_imgpad=True),

dict(type='Resize', scale=(224, 224), keep_ratio=False),

dict(type='Normalize', **img_norm_cfg),

dict(type='FormatShape', input_format='NCTHW'),

dict(type='Collect', keys=['imgs', 'label'], meta_keys=[]),

dict(type='ToTensor', keys=['imgs'])

]

test_pipeline = [

dict(type='MMUniformSampleFrames', clip_len=dict(RGB=8), num_clips=10),

dict(type='MMDecode'),

dict(type='MMCompact', hw_ratio=1., allow_imgpad=True),

dict(type='Resize', scale=(224, 224), keep_ratio=False),

dict(type='Normalize', **img_norm_cfg),

dict(type='FormatShape', input_format='NCTHW'),

dict(type='Collect', keys=['imgs', 'label'], meta_keys=[]),

dict(type='ToTensor', keys=['imgs'])

]

data = dict(

videos_per_gpu=12,

workers_per_gpu=4,

val_dataloader=dict(videos_per_gpu=1),

test_dataloader=dict(videos_per_gpu=1),

train=dict(

type='RepeatDataset',

times=10,

dataset=dict(type=dataset_type, split='xsub_train', ann_file=ann_file, data_prefix=data_root, pipeline=train_pipeline)),

val=dict(type=dataset_type, split='xsub_val', ann_file=ann_file, data_prefix=data_root, pipeline=val_pipeline),

test=dict(type=dataset_type, split='xsub_val', ann_file=ann_file, data_prefix=data_root, pipeline=test_pipeline))

# optimizer

optimizer = dict(type='SGD', lr=0.15, momentum=0.9, weight_decay=0.0001) # this lr is used for 8 gpus

optimizer_config = dict(grad_clip=dict(max_norm=40, norm_type=2))

# learning policy

lr_config = dict(policy='CosineAnnealing', by_epoch=False, min_lr=0)

total_epochs = 18

checkpoint_config = dict(interval=1)

evaluation = dict(interval=1, metrics=['top_k_accuracy', 'mean_class_accuracy'], topk=(1, 5))

log_config = dict(interval=20, hooks=[dict(type='TextLoggerHook')])

work_dir = './work_dirs/rgbpose_conv3d/rgb_only'dataset_type = 'PoseDataset'

data_root = '/new-pool/dhd/data/nturgbd'

ann_file = 'data/nturgbd/ntu60_hrnet.pkl'

img_norm_cfg = dict(mean=[123.675, 116.28, 103.53], std=[58.395, 57.12, 57.375], to_bgr=False)定义了数据集的相关信息。dataset_type 是数据集的类型,这里是 'PoseDataset'。data_root 是数据集的根目录的路径,ann_file 是数据集的注释文件的路径。

img_norm_cfg 定义了图像的归一化配置。mean 是一个长度为 3 的列表,表示图像的均值,std 是一个长度为 3 的列表,表示图像的标准差。to_bgr 表示是否将图像转换为 BGR 格式。

data_root 变量表示数据集的根目录路径。在这个路径下,可以找到包含训练数据、验证数据和测试数据的子文件夹或文件。具体的数据组织方式可能因数据集而异,但通常会有类似以下的结构:

data_root/

├── train/

├── val/

└── test/在这个示例中,data_root 指向的是数据集的根目录。train/ 子文件夹包含训练集数据,val/ 子文件夹包含验证集数据,test/ 子文件夹包含测试集数据。

您可以根据您的实际数据集的组织方式来设置 data_root 变量,确保它指向包含相应数据子文件夹的路径。这样模型在训练、验证或测试时就可以根据 data_root 变量找到相应的数据。

那为什么还new-pool/dhd?

/new-pool/dhd 是与 data_root 变量相结合使用的完整路径。在代码中,data_root 变量指向的是数据集的根目录路径,而 /new-pool/dhd 是数据集的具体存储位置。

具体来说,data_root 表示数据集的根目录路径,而 /new-pool/dhd 是根目录路径的一部分,用来指定数据集存储在哪个具体的目录或位置上。这种情况下,/new-pool/dhd 可能是一个服务器或存储设备中的路径,用来表示数据集的存储位置。

您需要根据您的实际情况,将 data_root 设置为正确的根目录路径,以及将 /new-pool/dhd 替换为您实际的数据集存储位置的路径。

请确保在设置 data_root 时使用了正确的路径,并根据您的实际情况进行相应的调整。

参考:

pyskl/configs/rgbpose_conv3d/rgb_only.py at main · kennymckormick/pyskl · GitHub

4112

4112

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?