安装spark3.2

1 .下载

地址:https://spark.apache.org/downloads.html

2. 解压到安装目录

解压:

重命名:

3.安装scala

地址:https://downloads.lightbend.com/scala/2.12.15/scala-2.12.15.tgz

4. 配置环境变量

立即生效:source ~/.bashrc

4.配置

配置spark-env.sh

cp $SPARK_HOME/conf/spark-env.sh.template $SPARK_HOME/conf/spark-env.sh

vim $SPARK_HOME/conf/spark-env.sh

export JAVA_HOME=/usr/local/java

export SCALA_HOME=/opt/src/scala-2.12.15

export HADOOP_HOME=/opt/src/hadoop-3.3.1

export HADOOP_CONF_DIR=$HADOOP_HOME/etc/hadoop

export SPARK_MASTER_HOST=node001

export SPARK_LOCAL_DIRS=/opt/src/spark-3.2.0

export SPARK_DRIVER_MEMORY=2g #内存

export SPARK_WORKER_CORES=1 #cpus核心数

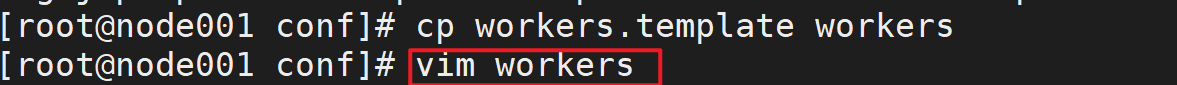

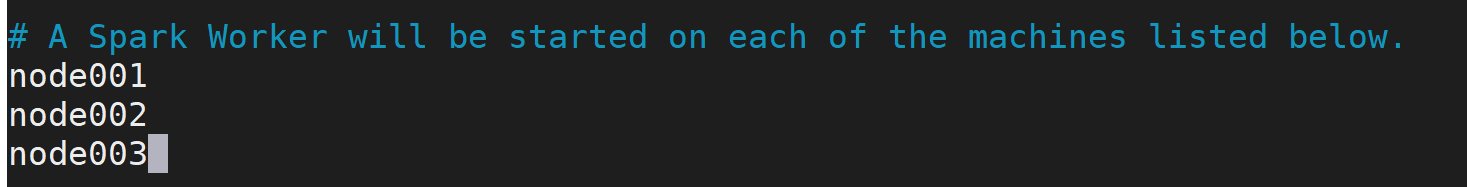

配置workers

添加worker主机:

5.复制到其他结点并启动

6.启动

./sbin/start-all.sh

7.验证

./bin/run-example SparkPi 10

3265

3265

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?