MLP定义

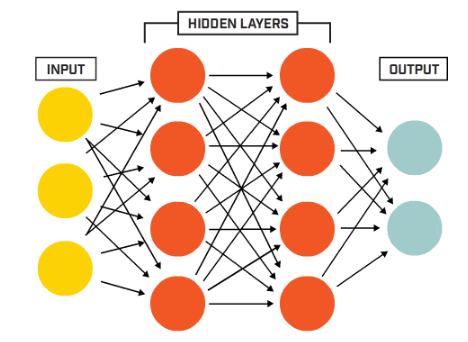

多层感知机(MLP,Multilayer Perceptron)也叫人工神经网络(ANN,Artificial Neural Network),由输入层、隐藏层和输出层组成,其中隐藏层可以设置一层或多层,如下图:

在MLP中,各层间是全连接的。由输入层伊始,经由隐藏层到输出层,完成对输入的向量转化。

输入层到隐藏层

在输入层到隐藏层的过程中,前一层的输出会作为当前层的输入,计算规则常为:权重与输入之间的乘积和+偏置的值。

假设当前输入为X1,那么它经过当前层转换的公式为:

f

(

X

1

)

=

W

1

X

1

+

b

1

f(X1)=W^1X1+b^1

f(X1)=W1X1+b1

其中,W为权重,b为偏置。函数f 可以是常用的sigmoid函数或者tanh函数,如果是用sigmoid函数,该公式实际上就是LR逻辑回归。

sigmoid函数、tanh函数以及下小节涉及的softmax函数,我的另一篇博客有详细解析:机器学习/深度学习/NLP-1-常用激活函数

隐藏层到输出层

隐藏层到输出层就是一个多类别的LR逻辑回归,这里应用softmax函数。

假设当前输入为X2,那么它经过输出层最后的输出为:

g

(

X

2

)

=

W

2

X

2

+

b

2

g(X2)=W^2X2+b^2

g(X2)=W2X2+b2

如果隐藏层只有一层,那么X2就是隐藏层的输出f(X1)。

MLP整体公式

将输入层、隐藏层和输出层串起来,公式如下:

F

(

X

)

=

g

(

W

2

(

W

1

X

+

b

1

)

+

b

2

)

F(X)=g(W^2(W^1X+b^1)+b^2)

F(X)=g(W2(W1X+b1)+b2)

这个公式只代表只有一层隐藏层的情况。

多层隐藏层的情况以及MLP的反向传播、loss等公式细节可参考:机器学习——多层感知机MLP的相关公式

这个博客里的图也很漂亮:

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?