前面文章详细叙述了如何安装pytorch的环境,本节我们一起对比cpu运算和gpu运算的效果

# -*- coding: utf-8 -*-

import torch

import numpy

import time

# 框架信息

print("torch.__version__=",torch.__version__)

print("torch.cuda.is_available()=",torch.cuda.is_available())

print()

a=torch.randn(10000,1000)

b=torch.randn(1000,2000)

t0=time.time()

c=torch.matmul(a,b)

t1=time.time()

print(a.device,t1-t0,c.norm(2))

print()

device=torch.device("cuda")

a=a.to(device)

b=b.to(device)

print("第一遍")

t0=time.time()

c=torch.matmul(a,b)

t1=time.time()

print(a.device,t1-t0,c.norm(2))

print("第二遍")

t0=time.time()

c=torch.matmul(a,b)

t1=time.time()

print(a.device,t1-t0,c.norm(2))

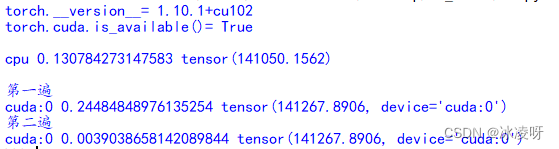

输出结果

可以看到第一次gpu运算比cpu运算慢,那是因为cuda的一些初始化工作占用一定时间,初始化完毕后就快很多了,可以说的磨刀不误砍柴工。至于为啥cpu和gpu运算结果不一样,因为GPU端计算浮点数精度和CPU端不同。GPU默认是float精度,CPU默认是double精度。这就意味着在GPU作浮点数乘除计算结果如果累计的话,必然存在误差。

1942

1942

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?