🎉AI学习星球推荐: GoAI的学习社区 知识星球是一个致力于提供《机器学习 | 深度学习 | CV | NLP | 大模型 | 多模态 | AIGC 》各个最新AI方向综述、论文等成体系的学习资料,配有全面而有深度的专栏内容,包括不限于 前沿论文解读、资料共享、行业最新动态以、实践教程、求职相关(简历撰写技巧、面经资料与心得)多方面综合学习平台,强烈推荐AI小白及AI 1;;爱好者学习,性价比非常高!加入星球➡️点击链接

【 书生·浦语大模型实战营】学习笔记(七):大模型评测实战

👨💻导读: 本篇笔记内容主要为【 书生·浦语大模型实战营】学习笔记(七):大模型评测实战 ,主要对OpenCompass 大模型评测部分详细介绍,并分别进行实战应用,欢迎大家交流学习!

本次学习资料

1.【视频】:OpenCompass 大模型评测实战

2.【文档】:https://github.com/InternLM/Tutorial/blob/camp2/agent/lagent.md#1-lagent-web-demo

3.【作业】:https://github.com/InternLM/Tutorial

- 基础作业

使用 OpenCompass 评测 internlm2-chat-1_8b 模型在 C-Eval 数据集上的性能

- 进阶作业

将自定义数据集提交至OpenCompass官网

4.【环境】开发机:InternStudio

理论部分

一、大模型评测 概述

-

为什么要研究大模型的评测

-

性能验证

首先,研究评测对于我们全面了解大型语言模型的优势和限制至关重要。尽管许多研究表明大型语言模型在多个通用任务上已经达到或超越了人类水平,但仍然存在质疑,即这些模型的能力是否只是对训练数据的记忆而非真正的理解。例如,即使只提供LeetCode题目编号而不提供具体信息,大型语言模型也能够正确输出答案,这暗示着训练数据可能存在污染现象。

- 交互能力

其次,研究评测有助于指导和改进人类与大型语言模型之间的协同交互。考虑到大型语言模型的最终服务对象是人类,为了更好地设计人机交互的新范式,我们有必要全面评估模型的各项能力。

- 遵守法规和标准

最后,研究评测可以帮助我们更好地规划大型语言模型未来的发展,并预防未知和潜在的风险。随着大型语言模型的不断演进,其能力也在不断增强。通过合理科学的评测机制,我们能够从进化的角度评估模型的能力,并提前预测潜在的风险,这是至关重要的研究内容。

- 舒适性和安全性

就像飞机的制造一样,尽管成本高昂,但一旦制造完成,大家使用的机会就会非常频繁。因此,了解不同语言模型之间的性能、舒适性和安全性,能够帮助人们更好地选择适合的模型,这对于研究人员和产品开发者而言同样具有重要意义。

全面性:如何构造能扩展且覆盖程度广的评测体系。

评测成本:一方面是算力,另一方面是基于人工打分的主观评测成本高。

数据污染:有的模型在评测集上做训练,分高,不可信。

需要有发现数据污染的方法 鲁棒性:大模型对提示词比较敏感

如何评测大模型

根据模型类型不同,设定不同的评测方法。

提示词工程

长文本评测

2. OpenCompass介绍

开源可复现:提供公平、公开、可复现的大模型评测方案

全面的能力维度:五大维度设计,提供 70+ 个数据集约 40 万题的的模型评测方案,全面评估模型能力

丰富的模型支持:已支持 20+ HuggingFace 及 API 模型

分布式高效评测:一行命令实现任务分割和分布式评测,数小时即可完成千亿模型全量评测

多样化评测范式:支持零样本、小样本及思维链评测,结合标准型或对话型提示词模板,轻松激发各种模型最大性能

灵活化拓展:想增加新模型或数据集?想要自定义更高级的任务分割策略,甚至接入新的集群管理系统?OpenCompass 的一切均可轻松扩展!

3. 评测对象

基座模型:一般是经过海量的文本数据以自监督学习的方式进行训练获得的模型(如OpenAI的GPT-3,Meta的LLaMA),往往具有强大的文字续写能力。

对话模型:一般是在的基座模型的基础上,经过指令微调或人类偏好对齐获得的模型(如OpenAI的ChatGPT、上海人工智能实验室的书生·浦语),能理解人类指令,具有较强的对话能力。

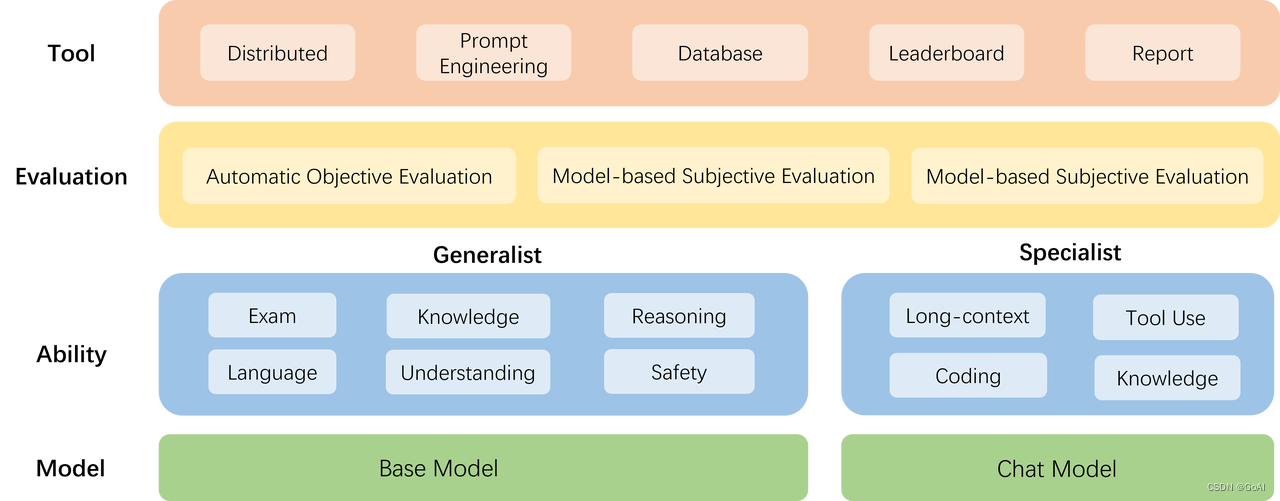

4. 工具架构

模型层:OpenCompass 以基座模型和对话模型作为重点评测对象。

能力层:OpenCompass 从通用能力和特色能力两个方面来进行评测维度设计。

在模型通用能力方面,从语言、知识、理解、推理、安全等多个能力维度进行评测。

在特色能力方面,从长文本、代码、工具、知识增强等维度进行评测。

方法层:OpenCompass 采用客观评测与主观评测两种评测方式。

客观评测能便捷地评估模型在具有确定答案(如选择,填空,封闭式问答等)的任务上的能力。

主观评测能评估用户对模型回复的真实满意度,OpenCompass 采用基于模型辅助的主观评测和基于人类反馈的主观评测两种方式。

工具层:OpenCompass 提供丰富的功能支持自动化地开展大语言模型的高效评测。包括分布式评测技术,提示词工程,对接评测数据库,评测榜单发布,评测报告生成等诸多功能。

5. 评测方法

客观评测和主观评测

1.客观评测

针对具有标准答案的客观问题,我们可以我们可以通过使用定量指标比较模型的输出与标准答案的差异,并根据结果衡量模型的性能。OpenCompass 采用提示词工程 (prompt engineering)和语境学习(in-context learning)进行客观评测。 在客观评测的具体实践中,我们通常采用下列两种方式进行模型输出结果的评测:

判别式评测:该评测方式基于将问题与候选答案组合在一起,计算模型在所有组合上的困惑度(perplexity),并选择困惑度最小的答案作为模型的最终输出

生成式评测:该评测方式主要用于生成类任务,如语言翻译、程序生成、逻辑分析题等。具体实践时,使用问题作为模型的原始输入,并留白答案区域待模型进行后续补全。

2.主观评测

语言表达生动精彩,变化丰富,大量的场景和能力无法凭借客观指标进行评测。针对如模型安全和模型语言能力的评测,以人的主观感受为主的评测更能体现模型的真实能力,并更符合大模型的实际使用场景。 OpenCompass 采取的主观评测方案是指借助受试者的主观判断对具有对话能力的大语言模型进行能力评测。在实际评测中,本文将采用真实人类专家的主观评测与基于模型打分的主观评测相结合的方式开展模型能力评估。 在具体开展主观评测时,OpenComapss 采用单模型回复满意度统计和多模型满意度比较两种方式开展具体的评测工作

快速开始

OpenCompass 评估一个模型通常包括以下几个阶段:配置 -> 推理 -> 评估 -> 可视化。

1.配置:这是整个工作流的起点。您需要配置整个评估过程,选择要评估的模型和数据集。此外,还可以选择评估策略、计算后端等,并定义显示结果的方式。

2.推理与评估:在这个阶段,OpenCompass 将会开始对模型和数据集进行并行推理和评估。推理阶段主要是让模型从数据集产生输出,而评估阶段则是衡量这些输出与标准答案的匹配程度。这两个过程会被拆分为多个同时运行的“任务”以提高效率,但请注意,如果计算资源有限,这种策略可能会使评测变得更慢。如果需要了解该问题及解决方案,可以参考 FAQ: 效率。

3.可视化:评估完成后,OpenCompass 将结果整理成易读的表格,并将其保存为 CSV 和 TXT 文件。你也可以激活飞书状态上报功能,此后可以在飞书客户端中及时获得评测状态报告。 接下来,我们将展示 OpenCompass 的基础用法,展示书生浦语在 C-Eval 基准任务上的评估。它们的配置文件可以在 configs/eval_demo.py 中找到。

1.实践

安装环境

studio-conda -o internlm-base -t opencompass

source activate opencompass

git clone -b 0.2.4 https://github.com/open-compass/opencompass

cd opencompass

pip install -e .

数据准备

解压评测数据集到 data/ 处

# https://github.com/open-compass/opencompass/blob/main/README_zh-CN.md

wget https://github.com/open-compass/opencompass/releases/download/0.2.2.rc1/OpenCompassData-core-20240207.zip

# scp -o StrictHostKeyChecking=no -r -P 42001 D:\Download\OpenCompassData-core-20240207.zip root@ssh.intern-ai.org.cn:/root/opencompass

unzip OpenCompassData-core-20240207.zip

将会在 OpenCompass 下看到data文件夹

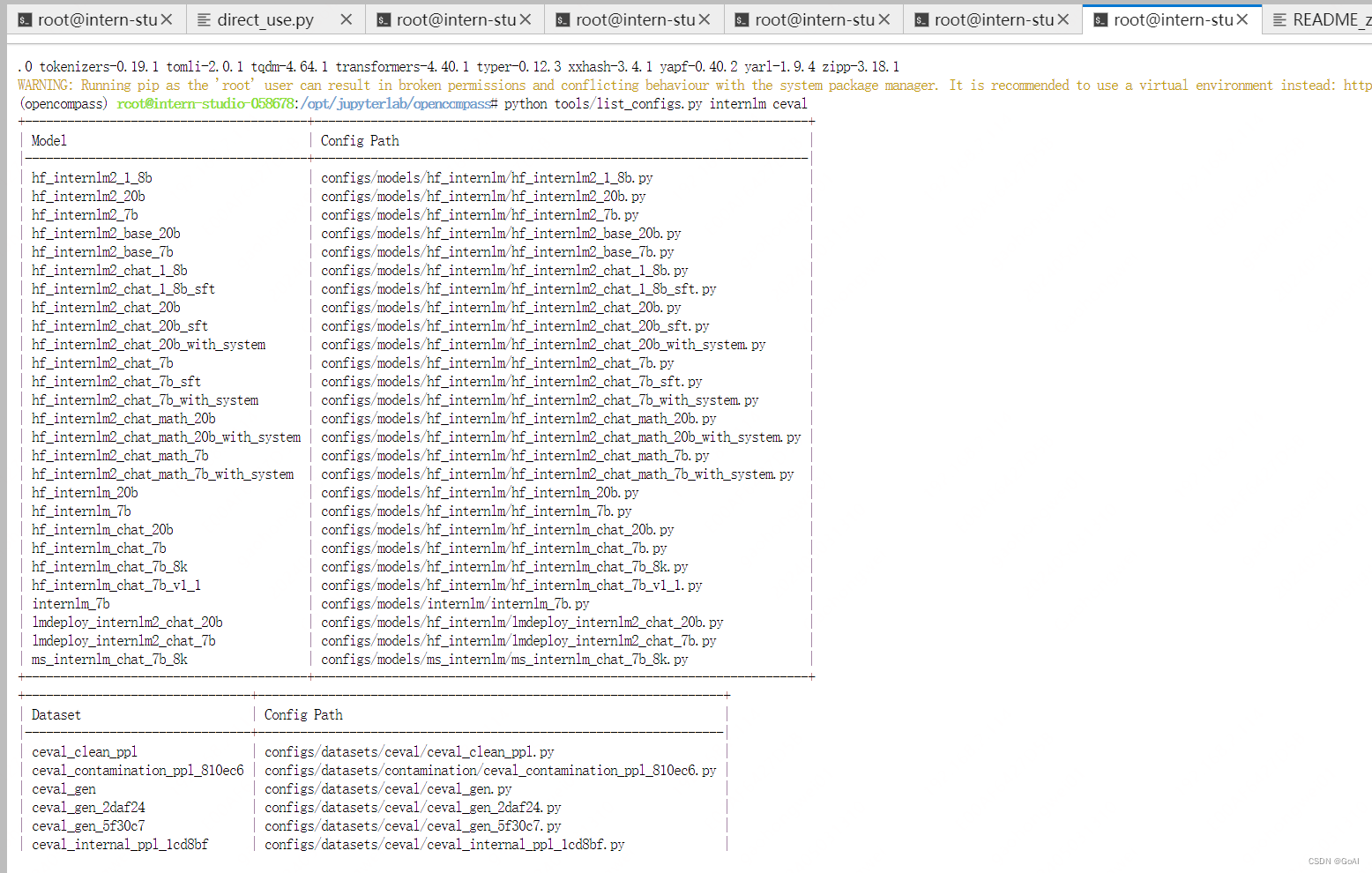

查看支持的数据集和模型

列出所有跟 InternLM 及 C-Eval 相关的配置,python tools/list_configs.py internlm ceval

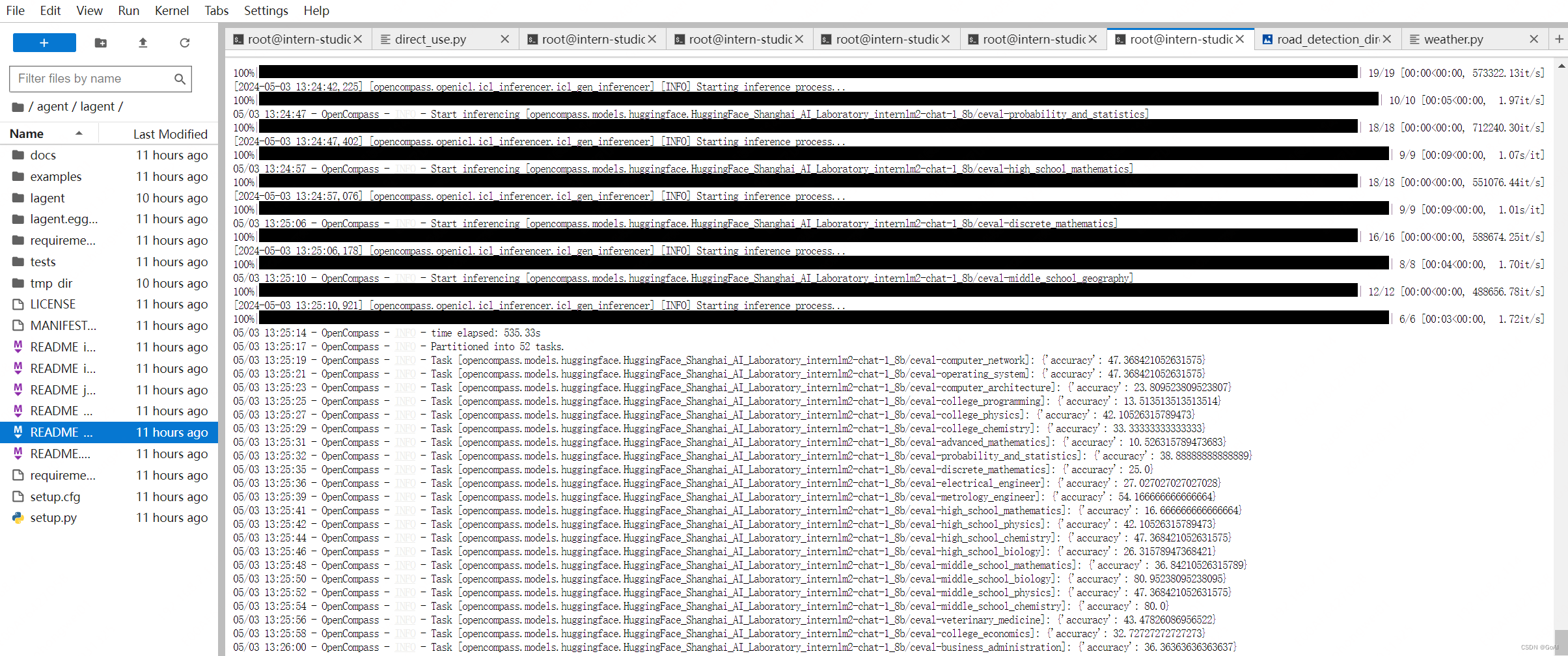

2. 启动评测

正确安装 OpenCompass 并准备好数据集后,可以通过以下命令评测 InternLM2-Chat-1.8B 模型在 C-Eval 数据集上的性能。

pip install protobuf

export MKL_SERVICE_FORCE_INTEL=1

在 --debug 模式下,任务将按顺序执行,并实时打印输出。

#详细命令解析

python run.py

--datasets ceval_gen \

--hf-path /share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b \ # HuggingFace 模型路径

--tokenizer-path /share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b \ # HuggingFace tokenizer 路径(如果与模型路径相同,可以省略)

--tokenizer-kwargs padding_side='left' truncation='left' trust_remote_code=True \ # 构建 tokenizer 的参数

--model-kwargs device_map='auto' trust_remote_code=True \ # 构建模型的参数

--max-seq-len 1024 \ # 模型可以接受的最大序列长度

--max-out-len 16 \ # 生成的最大 token 数

--batch-size 4 \ # 批量大小

--num-gpus 1 # 运行模型所需的 GPU 数量

--debug

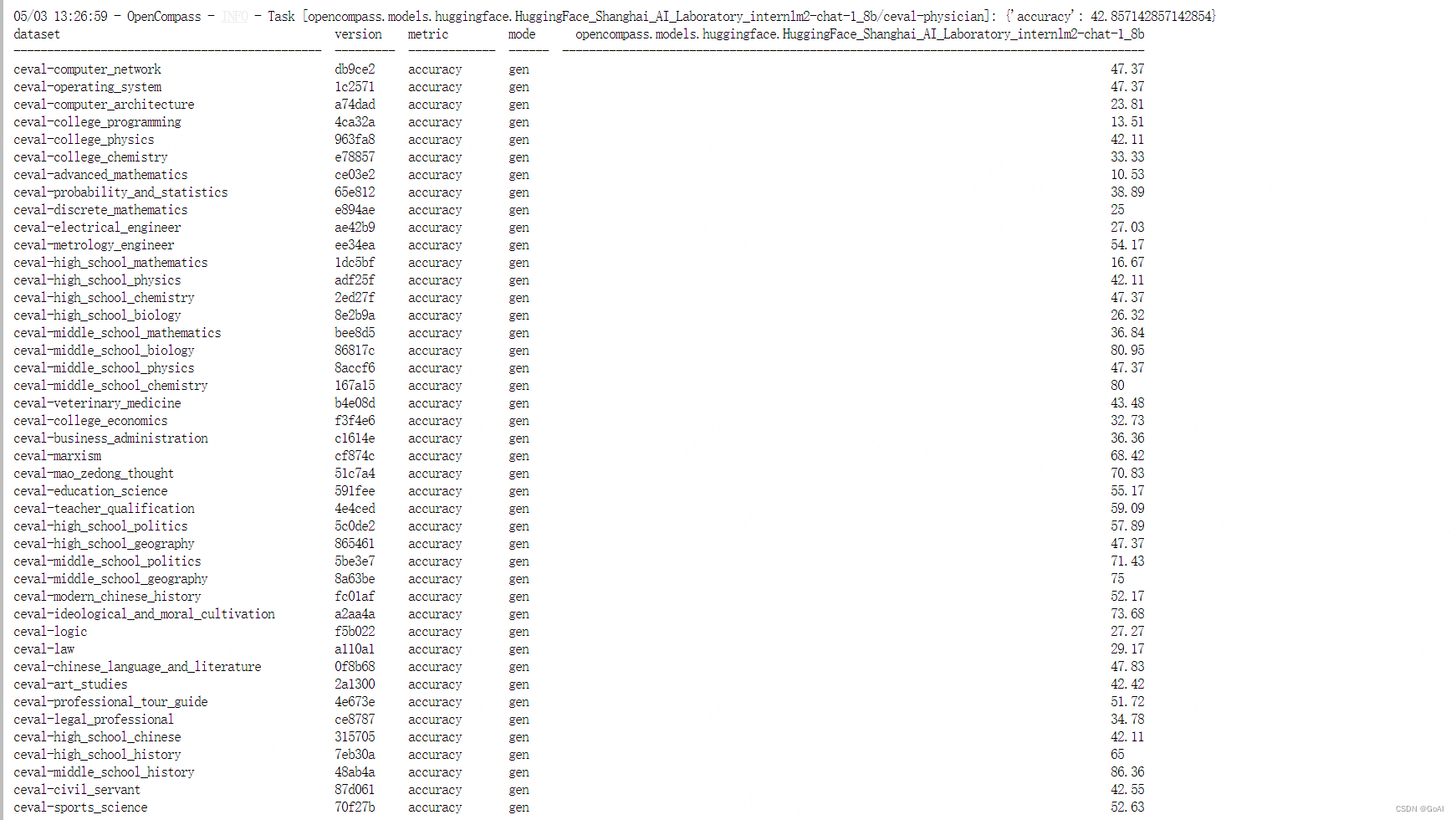

最终评测效果:

自定义数据集客主观评测:量身定制,慧眼识珠

自建客观数据集步骤

详细的客观评测指引参见:链接

大海捞针:星辰藏海深,字海寻珠难

大海捞针测试简介

大海捞针测试(灵感来自 NeedleInAHaystack)是指通过将关键信息随机插入一段长文本的不同位置,形成大语言模型 (LLM) 的Prompt,通过测试大模型是否能从长文本中提取出关键信息,从而测试大模型的长文本信息提取能力的一种方法,可反映LLM长文本理解的基本能力。

数据集介绍

Skywork/ChineseDomainModelingEval 数据集收录了 2023 年 9 月至 10月期间发布的高质量中文文章,涵盖了多个领域。这些文章确保了公平且具有挑战性的基准测试。 该数据集包括特定领域的文件:

zh_finance.jsonl 金融

zh_game.jsonl 游戏

zh_government.jsonl 政务

zh_movie.jsonl 电影

zh_tech.jsonl 技术

zh_general.jsonl 综合

这些文件用于评估LLM对不同特定领域的理解能力。

实验评估步骤:链接

总结

本篇笔记内容主要为【 书生·浦语大模型实战营】学习笔记(七):大模型评测实战 ,主要对OpenCompass 大模型评测部分详细介绍,欢迎大家交流学习!

文章介绍了OpenCompass大模型评测实战,详细阐述了评测大模型的必要性、方法(包括客观评测如判别式和生成式,以及主观评测),并展示了如何使用OpenCompass进行模型性能验证,涉及模型类型、评测对象、工具架构和实战步骤。

文章介绍了OpenCompass大模型评测实战,详细阐述了评测大模型的必要性、方法(包括客观评测如判别式和生成式,以及主观评测),并展示了如何使用OpenCompass进行模型性能验证,涉及模型类型、评测对象、工具架构和实战步骤。

1579

1579

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?