【RocketMQ】3、运行原理

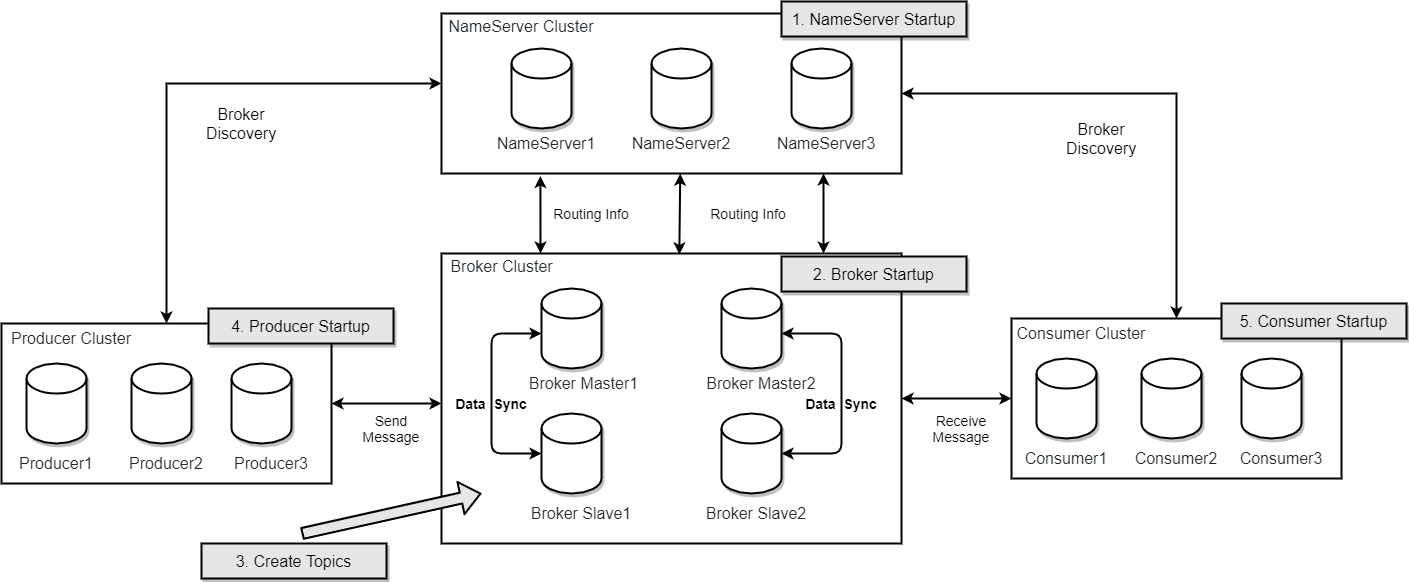

RoketMQ的主要流程如下图所示,下面将从消息的生产、存储、消费三个部分进行介绍。

一、消息的生产(Producer)

1、消息生产过程

Producer可以将消息写入到某Broker中的某Queue中,其经历了如下过程:

- Producer发送消息之前,会先向NameServer发出获取消息Topic的路由信息的请求

- NameServer返回该Topic的路由表及Broker列表

- Producer根据代码中指定的Queue选择策略,从Queue列表中选出一个队列,用于后续存储消息

- Produer对消息做一些特殊处理,例如,消息本身超过4M,则会对其进行压缩

- Producer向选择出的Queue所在的Broker发出RPC请求,将消息发送到选择出的Queue

路由表:实际是一个Map,key为Topic名称,value是一个QueueData实例列表。QueueData并不是一个Queue对应一个QueueData,而是一个Broker中该Topic的所有Queue对应一个QueueData。即,只要涉及到该Topic的Broker,一个Broker对应一个QueueData。QueueData中包含brokerName。简单来说,路由表的key为Topic名称,value则为所有涉及该Topic的BrokerName列表。

Broker列表:其实际也是一个Map。key为brokerName,value为BrokerData。一个Broker对应一个BrokerData实例,对吗?不对。一套brokerName名称相同的Master-Slave小集群对应一个BrokerData。BrokerData中包含brokerName及一个map。该map的key为brokerId,value为该broker对应的地址。brokerId为 0 表示该broker为Master,非 0 表示Slave。

2、NameServer选择算法

客户端(生产者/消费者)在配置时必须要写上NameServer集群的地址,那么客户端到底连接的是哪个NameServer节点呢?客户端首先会生产一个随机数,然后再与NameServer节点数量取模,此时得到的就是所要连接的节点索引,然后就会进行连接。如果连接失败,则会采用round-robin策略,逐个尝试着去连接其它节点。

3、Queue选择算法

对于无序消息,其Queue选择算法,也称为消息投递算法,常见的有两种:

(1)轮询算法

-

默认选择算法。该算法保证了每个Queue中可以均匀的获取到消息。

-

该算法存在一个问题:由于某些原因,在某些Broker上的Queue可能投递延迟较严重。从而导致Producer的缓存队列中出现较大的消息积压,影响消息的投递性能。

(2)最小投递延迟算法

-

该算法会统计每次消息投递的时间延迟,然后根据统计出的结果将消息投递到时间延迟最小的Queue。如果延迟相同,则采用轮询算法投递。该算法可以有效提升消息的投递性能。

-

该算法也存在一个问题:消息在Queue上的分配不均匀。投递延迟小的Queue其可能会存在大量的消息。而对该Queue的消费者压力会增大,降低消息的消费能力,可能会导致MQ中消息的堆积。

二、消息的存储(Broker)

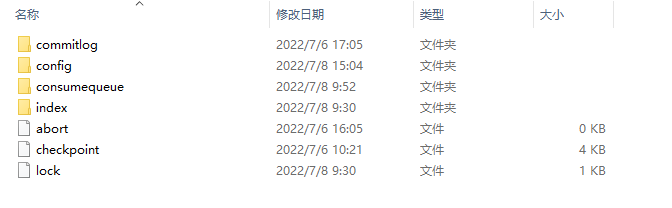

消息存储在本地文件系统中,默认位置为用户目录下store文件夹下。

- abort:该文件在Broker启动后会自动创建,正常关闭Broker,该文件会自动消失。若在没有启动Broker的情况下,发现这个文件是存在的,则说明之前Broker的关闭是非正常关闭。

- checkpoint:其中存储着commitlog、consumequeue、index文件的最后刷盘时间戳

- commitlog:其中存放着commitlog文件,而消息是写在commitlog文件中的

- config:存放着Broker运行期间的一些配置数据

- consumequeue:其中存放着consumequeue文件,队列就存放在这个目录中

- index:其中存放着消息索引文件indexFile

- lock:运行期间使用到的全局资源锁

消息的存储主要与CommitLog、ConsumeQueue、IndexFile三个文件有关。

1、CommitLog

源码中,CommitLog文件被命名为MappedFile。

(1)目录结构

CommitLog目录中存放着很多的MappedFile文件,当前Broker中的所有消息都是落盘到这些MappedFile文件中的。MappedFile文件大小为1G(小于等于1G),文件名由 20 位十进制数构成,表示当前文件的第一条消息的起始位移偏移量。

(2)命名方式

- 第一个文件名一定是 20 位 0 构成的。因为第一个文件的第一条消息的偏移量CommitLog offset为 0

- 当第一个文件放满时,则会自动生成第二个文件继续存放消息。假设第一个文件大小是 1073741820 字节(1G = 1073741824字节),则第二个文件名就是 00000000001073741824 。

- 以此类推,第n个文件名应该是前n-1个文件大小之和。

- 一个Broker中所有MappedFile文件的CommitLog offset是连续的

需要注意的是,一个Broker中仅包含一个CommitLog目录,所有的MappedFile文件都是存放在该目录中的。即无论当前Broker中存放着多少Topic的消息,这些消息都是被顺序写入到了MappedFile文件中的。也就是说,这些消息在Broker中存放时并没有被按照Topic进行分类存放。

MappedFile文件是顺序读写的文件,所有其访问效率很高

无论是SSD磁盘还是SATA磁盘,通常情况下,顺序存取效率都会高于随机存取。

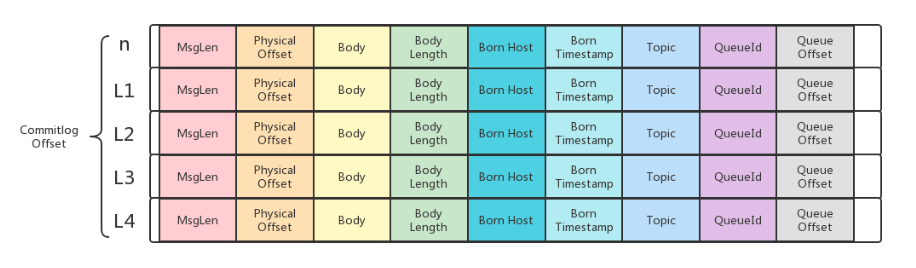

(3)文件内容

MappedFile文件内容由一个个的消息单元构成,其中消息内容不是定长的。

每个消息单元中包含消息总长度MsgLen、消息的物理位置physicalOffset、消息体内容Body、消息体长度BodyLength、消息主题Topic、Topic长度 TopicLength、消息生产者BornHost、消息发送时间戳BornTimestamp、消息所在的队列QueueId、消息在Queue中存储的偏移量QueueOffset等近 20 余项消息相关属性。

2、ConsumeQueue

引入ConsumeQueue的目的主要是提高消息消费的性能,由于RocketMQ是基于主题topic的订阅模式,消息消费是针对主题进行的,如果要遍历CommitLog文件中根据topic检索消息是非常低效的,Consumer即可根据ConsumeQueue来查找待消费的消息。

(1)目录结构

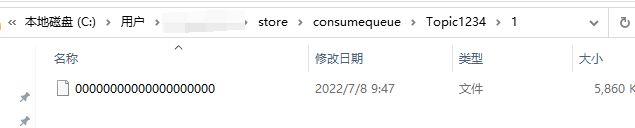

为了提高效率,会为每个Topic在~/store/consumequeue中创建一个目录,目录名为Topic名称。在该Topic目录下,会再为每个该Topic的Queue建立一个目录,目录名为queueId。每个目录中存放着若干consumequeue文件,consumequeue文件是commitlog的索引文件,可以根据consumequeue定位到具体的消息。

(2)命名方式

consumequeue文件名也由 20 位数字构成,表示当前文件的第一个索引条目的起始位移偏移量。与mappedFile文件名不同的是,其后续文件名是固定的。因为consumequeue文件大小是固定不变的。

(3)文件内容

其中,ConsumeQueue(逻辑消费队列)作为消费消息的索引,保存了指定Topic下的队列消息在CommitLog中的起始物理偏移量offset,消息大小size和消息Tag的HashCode值。ConsumeQueue文件可以看成是基于topic的CommitLog索引文件,故ConsumeQueue文件夹的组织方式如下:topic/queue/file三层组织结构,

同样consumequeue文件采取定长设计,每一个条目共20个字节,分别为8字节的commitlog物理偏移量、4字节的消息长度、8字节tag hashcode,单个文件由30W个条目组成,可以像数组一样随机访问每一个条目,每个ConsumeQueue文件大小约5.72M;

3、IndexFile

IndexFile提供了一种可以通过key或时间区间来查询消息的方法。该查询是通过store目录中的index子目录中的indexFile进行索引实现的快速查询。当然,这个indexFile中的索引数据是在包含了key的消息被发送到Broker时写入的。如果消息中没有包含key,则不会写入。

(1)目录结构

IndexFile文件存储在store目录的index子目录中

(2)命名方式

文件名fileName是以创建时的时间戳命名的,固定的单个IndexFile文件大小约为400M,一个IndexFile可以保存 2000W个索引,IndexFile的底层存储设计为在文件系统中实现HashMap结构,故rocketmq的索引文件其底层实现为hash索引。

这个时间戳有什么用处呢?

根据业务key进行查询时,查询条件除了key之外,还需要指定一个要查询的时间戳,表示要查询不大于该时间戳的最新的消息,即查询指定时间戳之前存储的最新消息。这个时间戳文件名可以简化查询,提高查询效率。具体后面会详细讲解。

(3)文件内容

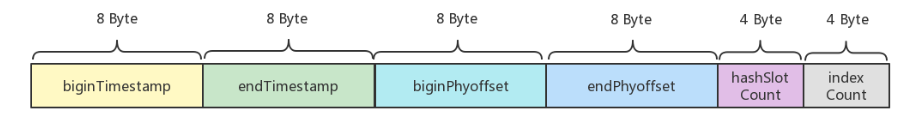

每个indexFile文件由三部分构成:indexHeader,slots槽位,indexes索引数据。

每个indexFile文件中包含500w个slot槽。而每个slot槽又可能会挂载很多的index索引单元。

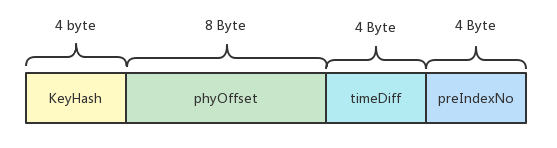

Ⅰ、IndexHeader

IndexHeader固定 40 个字节,其中存放着如下数据:

- beginTimestamp:该indexFile中第一条消息的存储时间

- endTimestamp:该indexFile中最后一条消息存储时间

- beginPhyoffset:该indexFile中第一条消息在commitlog中的偏移量commitlog offset

- endPhyoffset:该indexFile中最后一条消息在commitlog中的偏移量commitlog offset

- hashSlotCount:已经填充有index的slot数量(并不是每个slot槽下都挂载有index索引单元,这里统计的是所有挂载了index索引单元的slot槽的数量)

- indexCount:该indexFile中包含的索引单元个数(统计出当前indexFile中所有slot槽下挂载的所有index索引单元的数量之和)

Ⅱ、slots与indexes

所有的index统一放在所有的slots后,而不是每个slot后面放该slot挂载的indexes。因为无法确定该slot要挂载的indexes数量并预留空间。

- key的hash值 % 500万的结果即为slot槽位,然后将该slot值修改为该index索引单元的indexNo,根据这个indexNo可以计算出该index单元在indexFile中的位置。

- 不过,该取模结果的重复率是很高的,为了解决该问题,在每个index索引单元中增加了preIndexNo,用于指定该slot中当前index索引单元的前一个index索引单元。

- 而slot中始终存放的是其下最新的index索引单元的indexNo,这样的话,只要找到了slot就可以找到其最新的index索引单元,而通过这个index索引单元就可以找到其之前的所有index索引单元。

indexNo是一个在indexFile中的流水号,从 0 开始依次递增。即在一个indexFile中所有indexNo是以此递增的。indexNo在index索引单元中是没有体现的,其是通过indexes中依次数出来的。

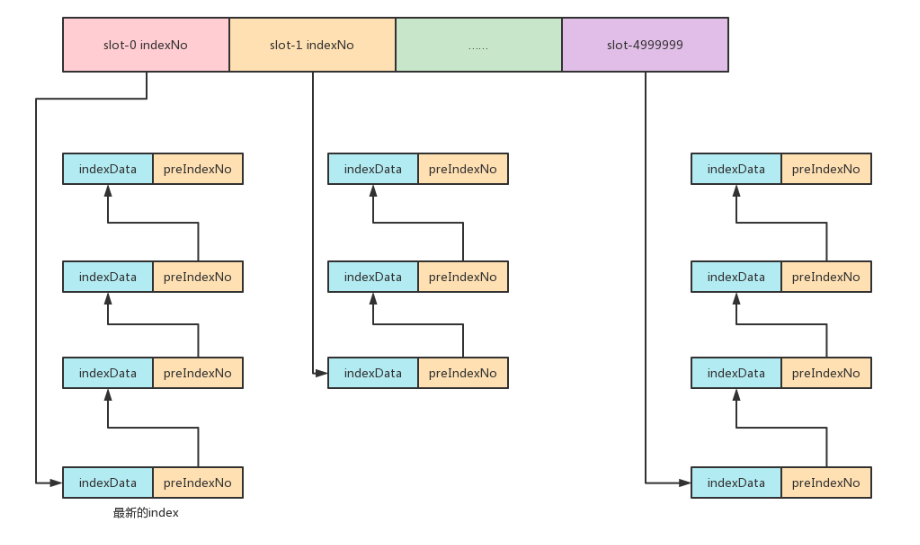

Ⅲ、index索引单元

index索引单元默写 20 个字节,其中存放着以下四个属性:

- keyHash:消息中指定的业务key的hash值

- phyOffset:当前key对应的消息在commitlog中的偏移量commitlog offset

- timeDiff:当前key对应消息的存储时间与当前indexFile创建时间的时间差

- preIndexNo:当前slot下当前index索引单元的前一个index索引单元的indexNo

(4)创建时机

- 当第一条带key的消息发送来后,系统发现没有indexFile,此时会创建第一个indexFile文件

- 当一个indexFile中挂载的index索引单元数量超出2000w个时,会创建新的indexFile。当带key的消息发送到来后,系统会找到最新的indexFile,并从其indexHeader的最后 4 字节中读取到indexCount。若indexCount >= 2000w时,会创建新的indexFile。

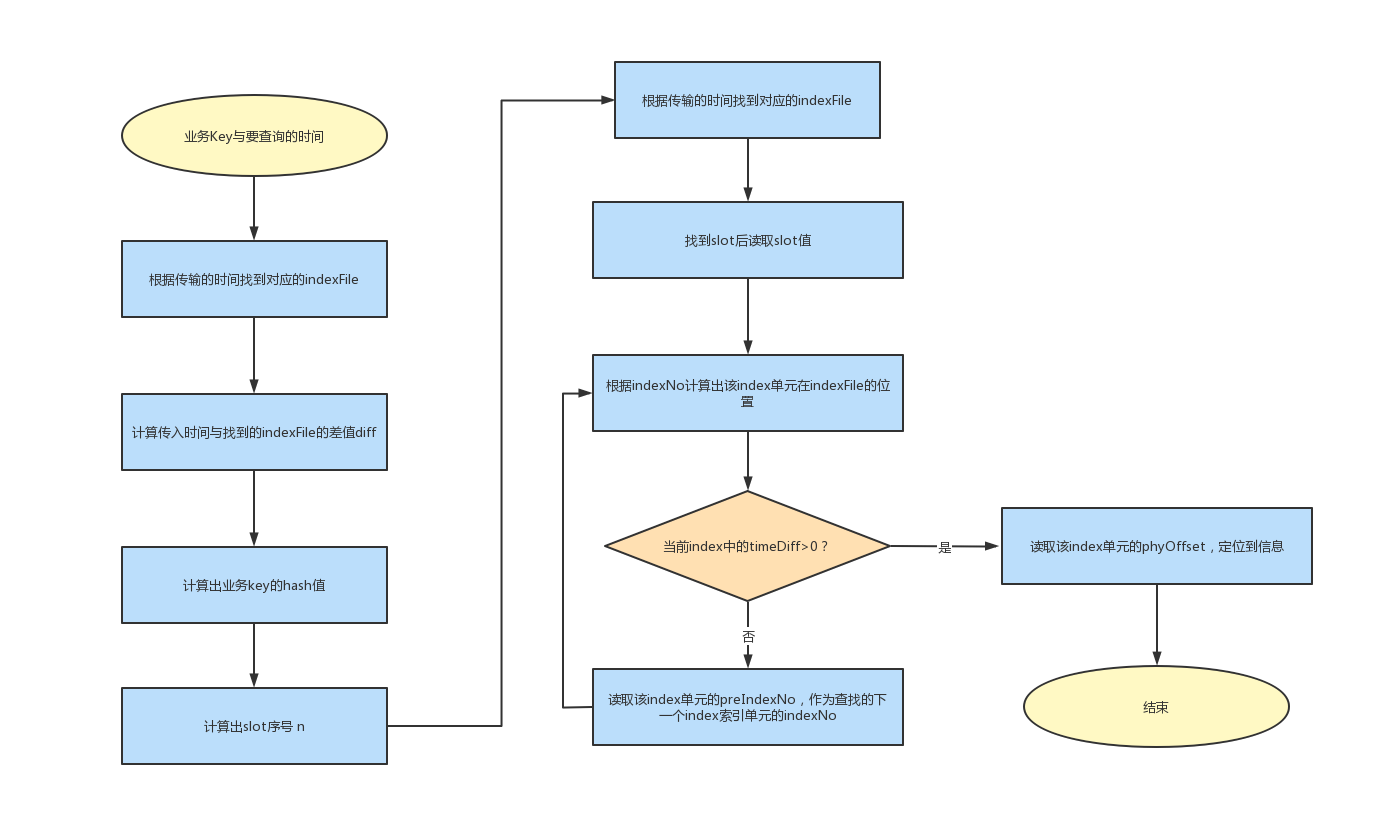

(5)消息查询流程

计算指定消息key的slot槽位序号:

slot槽位序号 = key的hash % 500w (式子1)

计算槽位序号为n的slot在indexFile中的起始位置:

slot(n)位置 = 40 + (n - 1) * 4 (式子2)

计算indexNo为m的index在indexFile中的位置

index(m)位置 = 40 + 500w * 4 + (m - 1) * 20 (式子3)

其中:

40 为indexFile中indexHeader的字节数

500w * 4 是所有slots所占的字节数

4、消息的写入与读取

(1)消息的写入

- Broker根据queueId,获取到该消息对应索引条目要在consumequeue目录中的写入偏移量,即QueueOffset

- 将queueId、queueOffset等数据,与消息一起封装为消息单元

- 将消息单元写入到commitlog

- 同时,形成消息索引条目

- 将消息索引条目分发到相应的consumequeue

(2)消息的读取

- Consumer获取到其要消费消息所在Queue的消费偏移量offset,计算出其要消费消息的消息offset

消费offset即消费进度,consumer对某个Queue的消费offset,即消费到了该Queue的第几条消息

消息offset = 消费offset + 1

- Consumer向Broker发送拉取请求,其中会包含其要拉取消息的Queue、消息offset及消息Tag。

- Broker计算在该consumequeue中的queueOffset。

queueOffset = 消息offset * 20字节

- 从该queueOffset处开始向后查找第一个指定Tag的索引条目。

- 解析该索引条目的前 8 个字节,即可定位到该消息在commitlog中的commitlog offset

- 从对应commitlog offset中读取消息单元,并发送给Consumer

(3)性能

- RocketMQ对文件的操作是通过mmap零拷贝实现的,对文件的操作转化为对内存地址的直接操作,极大提高了读写效率

consumequeue中的文件是顺序存放的,硬盘顺序读写速度要高于随机读写。并且还引入了PageCache页缓存机制,使得对consumequeue的读取几乎接近内存读取速度。 - RocketMQ中可能会影响性能的是对commitlog文件的读取。因为对commitlog文件来说,读取消息时会产生大量的随机访问,而随机访问会严重影响性能。不过,如果选择合适的系统IO调度算法,比如设置调度算法为Deadline(采用SSD固态硬盘的话),随机读的性能也会有所提升。

三、消息的消费(Consumer)

1、消费的类型

消费者从Broker中获取消息的方式有两种:Pull(拉取)和Push(推动)。

- Pull

- Consumer主动从Broker中拉取消息,主动权由Consumer控制。一旦获取了批量消息,就会启动消费过程。不过,该方式的 实时性较弱,即Broker中有了新的消息时消费者并不能及时发现并消费。

- 由于拉取时间间隔是由用户指定的,所以在设置该间隔时需要注意平稳:间隔太短,空请求比例会增加;间隔太长,消息的实时性太差

- Push

- 该模式下Broker收到数据后会主动推送给Consumer。该获取方式一般实时性较高。

- 该获取方式是典型的发布-订阅模式,即Consumer向其关联的Queue注册了监听器,一旦发现有新的消息到来就会触发回调的执行,回调方法是Consumer去Queue中拉取消息。而这些都是基于Consumer与Broker间的长连接的。长连接的维护是需要消耗系统资源的。

2、消费的模式

消费者组对于消息消费的模式分为两种:广播消费Broadcasting和集群消费Clustering。

-

广播消费Broadcasting

- 广播消费模式下,相同Consumer Group的每个Consumer实例都接收同一个Topic的全量消息。即:每条消息都会被发送到Consumer Group中的每个Consumer。

- 消费进度保存在Consumer端,广播模式下Consumer Group中每个Consumer都会消费所有消息,但它们的消费进度是不同。所以Consumer各自保存各自的消费进度

-

集群消费Clustering

- 集群消费模式下,相同Consumer Group的每个Consumer实例平均分摊同一个Topic的消息。即每条消息只会被发送到Consumer Group中的某个Consumer。

- 消费进度保存在broker中。Consumer Group中的所有Consumer共同消费一个Topic中的消息,同一条消息只会被消费一次。消费进度会参与到消费的负载均衡中,所以消费进度需要共享。

3、Rebalance机制

- Rebalance机制讨论的前提是:集群消费

- Rebalance即再均衡,指的是,将一个Topic下的多个Queue在同一个Consumer Group中的多个Consumer间进行重新分配的过程。

- Rebalance机制的本意是为了提升消息的并行消费能力。例如,一个Topic下 5 个队列,在只有 1 个消费者的情况下,这个消费者将负责消费这 5 个队列的消息。如果此时我们增加一个消费者,那么就可以给其中一个消费者分配 2 个队列,给另一个分配 3 个队列,从而提升消息的并行消费能力。

- 由于一个队列最多分配给一个消费者,因此当某个消费者组下的消费者实例数量大于队列的数量时,多余的消费者实例将分配不到任何队列。

(1)原因

- 消费者所订阅Topic的Queue数量发生变化

- Broker扩容或缩容

- Broker升级运维

- Broker与NameServer间的网络异常

- Queue扩容或缩容

- 消费者组中消费者的数量发生变化

- Consumer Group扩容或缩容

- Consumer升级运维

- Consumer与NameServer间网络异常

(2)过程

在Broker中维护着多个Map集合,这些集合中动态存放着当前Topic中Queue的信息、Consumer Group中Consumer实例的信息。一旦发现消费者所订阅的Queue数量发生变化,或消费者组中消费者的数量发生变化,立即向Consumer Group中的每个实例发出Rebalance通知。Consumer实例在接收到通知后会采用Queue分配算法自己获取到相应的Queue,即由Consumer实例自主进行Rebalance。

TopicConfigManager:key是topic名称,value是TopicConfig。TopicConfig中维护着该Topic中所有Queue的数据。

ConsumerManager:key是Consumser Group Id,value是ConsumerGroupInfo。

ConsumerGroupInfo中维护着该Group中所有Consumer实例数据。

ConsumerOffsetManager:key为Topic与订阅该Topic的Group的组合,即topic@group,value是一个内层Map。内层Map的key为QueueId,内层Map的value为该Queue的消费进度offset。

(3)Queue分配算法

一个Topic中的Queue只能由Consumer Group中的一个Consumer进行消费,而一个Consumer可以同时消费多个Queue中的消息。那么Queue与Consumer间的配对关系是如何确定的,即Queue要分配给哪个Consumer进行消费,也是有算法策略的。常见的有四种策略。这些策略是通过在创建Consumer时的构造器传进去的。

Ⅰ、平均分配策略

- 该算法是要根据

avg = QueueCount / ConsumerCount的计算结果进行分配的。 - 如果能够整除,则按顺序将avg个Queue逐个分配Consumer;

- 如果不能整除,则将多余出的Queue按照Consumer顺序逐个分配。

Ⅱ、环形分配策略

- 环形平均算法是指,根据消费者的顺序,依次在由queue队列组成的环形图中逐个分配。

Ⅲ、一致性hash策略

- 该算法会将consumer的hash值作为Node节点存放到hash环上,然后将queue的hash值也放到hash环上,通过顺时针方向,距离queue最近的那个consumer就是该queue要分配的consumer。

一致性hash算法存在的问题:

- 两种平均分配策略的分配效率较高,一致性hash策略的较低,因为一致性hash算法较复杂。

- 一致性hash策略分配的结果也很大可能上存在不平均的情况。

一致性hash算法存在的意义:

- 可以有效减少由于消费者组扩容或缩容所带来的大量的Rebalance。

- 适用于Consumer数量变化较频繁的场景。

Ⅳ、同机房策略

- 该算法会根据queue的部署机房位置和consumer的位置,过滤出当前consumer相同机房的queue。然后按照平均分配策略或环形平均策略对同机房queue进行分配。

- 如果没有同机房queue,则按照平均分配策略或环形平均策略对所有queue进行分配。

4、至少一次原则(offset管理)

- 即每条消息必须要被成功消费一次。

- Consumer在消费完消息后会向其消费进度记录器提交其消费消息的offset,offset被成功记录到记录器中,那么这条消费就被成功消费了。

什么是消费进度记录器?

对于广播消费模式来说,Consumer本身就是消费进度记录器。

对于集群消费模式来说,Broker是消费进度记录器。

(1)offset记录模式

Consumer消费进度offset是用来记录每个Queue的不同消费组的消费进度的。根据消费进度记录器的不同,可以分为两种模式:本地模式和远程模式。

Ⅰ、本地模式

- 当消费模式为广播消费时,offset使用本地模式存储。因为每条消息会被所有的消费者消费,每个消费者管理自己的消费进度,各个消费者之间不存在消费进度的交集。

- Consumer在广播消费模式下offset相关数据以json的形式持久化到Consumer本地磁盘文件中,默认文件路径为当前用户主目录下的

.rocketmq_offsets/${clientId}/${group}/Offsets.json。其中${clientId}为当前消费者id,默认为ip@DEFAULT;${group}为消费者组名称。

Ⅱ、远程模式

- 当消费模式为集群消费时,offset使用远程模式管理。因为所有Cosnumer实例对消息采用的是均衡消费,所有Consumer共享Queue的消费进度。

- Consumer在集群消费模式下offset相关数据以json的形式持久化到Broker磁盘文件中,文件路径为当前用户主目录下的

store/config/consumerOffset.json。 - Broker启动时会加载这个文件,并写入到一个双层Map(ConsumerOffsetManager)。外层map的key为topic@group,value为内层map。内层map的key为queueId,value为offset。当发生Rebalance时,新的Consumer会从该Map中获取到相应的数据来继续消费。

- 集群模式下offset采用远程管理模式,主要是为了保证Rebalance机制。

(2)作用

-

消费者是如何从最开始持续消费消息的?

消费者要消费的第一条消息的起始位置是用户自己通过consumer.setConsumeFromWhere()方法指定的。 -

在Consumer启动后,其要消费的第一条消息的起始位置常用的有三种,这三种位置可以通过枚举类型常量设置。这个枚举类型为ConsumeFromWhere。

CONSUME_FROM_LAST_OFFSET:从queue的当前最后一条消息开始消费

CONSUME_FROM_FIRST_OFFSET:从queue的第一条消息开始消费

CONSUME_FROM_TIMESTAMP:从指定的具 体时间戳位置的消息开始消费。这个具体时间戳是通过另外一个语句指定的 。 -

当消费完一批消息后,Consumer会提交其消费进度offset给Broker,Broker在收到消费进度后会将其更新到那个双层Map(ConsumerOffsetManager)及consumerOffset.json文件中,然后向该Consumer进行ACK,而ACK内容中包含三项数据:当前消费队列的最小offset(minOffset)、最大offset(maxOffset)、及下次消费的起始offset(nextBeginOffset)。

(3)重试队列

当rocketMQ对消息的消费出现异常时,会将发生异常的消息的offset提交到Broker中的重试队列。系统在发生消息消费异常时会为当前的topic@group创建一个重试队列,该队列以%RETRY%开头,到达重试时间后进行消费重试。

(4)offset提交模式

集群消费模式下,Consumer消费完消息后会向Broker提交消费进度offset,其提交方式分为两种:

Ⅰ、同步提交:

- 消费者在消费完一批消息后会向broker提交这些消息的offset,然后等待broker的成功响应。

- 若在等待超时之前收到了成功响应,则继续读取下一批消息进行消费(从ACK中获取nextBeginOffset)。

- 若没有收到响应,则会重新提交,直到获取到响应。在等待过程中,消费者是阻塞的,严重影响了消费者的吞吐量。

Ⅱ、异步提交:

- 消费者在消费完一批消息后向broker提交offset,但无需等待Broker的成功响应,可以继续读取并消费下一批消息。这种方式增加了消费者的吞吐量。

- 但需要注意,broker在收到提交的offset后,还是会向消费者进行响应的。可能还没有收到ACK,此时Consumer会从Broker中直接获取nextBeginOffset。

5、订阅关系一致性

订阅关系的一致性指的是,同一个消费者组(Group ID相同)下所有Consumer实例所订阅的Topic与Tag及对消息的处理逻辑必须完全一致。否则,消息消费的逻辑就会混乱,甚至导致消息丢失。

6、消息幂等

当出现消费者对某条消息重复消费的情况时,重复消费的结果与消费一次的结果是相同的,并且多次消费并未对业务系统产生任何负面影响,那么这个消费过程就是消费幂等的。

(1)场景

-

发送时消息重复

当一条消息已被成功发送到Broker并完成持久化,此时出现了网络闪断,从而导致Broker对Producer应答失败。 如果此时Producer意识到消息发送失败并尝试再次发送消息,此时Broker中就可能会出现两条内容相同并且Message ID也相同的消息,那么后续Consumer就一定会消费两次该消息。 -

消费时消息重复

消息已投递到Consumer并完成业务处理,当Consumer给Broker反馈应答时网络闪断,Broker没有接收到消费成功响应。为了保证消息至少被消费一次的原则,Broker将在网络恢复后再次尝试投递之前已被处理过的消息。此时消费者就会收到与之前处理过的内容相同、Message ID也相同的消息。 -

Rebalance时消息重复

当Consumer Group中的Consumer数量发生变化时,或其订阅的Topic的Queue数量发生变化时,会触发Rebalance,此时Consumer可能会收到曾经被消费过的消息。

(2)解决方法

幂等解决方案的设计中涉及到两项要素:幂等令牌与唯一性处理。只要充分利用好这两要素,就可以设计出好的幂等解决方案。

- 幂等令牌:是生产者和消费者两者中的既定协议,通常指具备唯一业务标识的字符串。例如,订单号、流水号。一般由Producer随着消息一同发送来的。

- 唯一性处理:服务端通过采用一定的算法策略,保证同一个业务逻辑不会被重复执行成功多次。例如,对同一笔订单的多次支付操作,只会成功一次。

幂等性操作的通用性解决方案是:

- 1、首先通过缓存去重。在缓存中如果已经存在了某幂等令牌,则说明本次操作是重复性操作;若缓存没有命中,则进入下一步。

- 2、在唯一性处理之前,先在数据库中查询幂等令牌作为索引的数据是否存在。若存在,则说明本次操作为重复性操作;若不存在,则进入下一步。

- 3、在同一事务中完成三项操作:唯一性处理后,将幂等令牌写入到缓存,并将幂等令牌作为唯一索引的数据写入到DB中。

第 1 步已经判断过是否是重复性操作了,为什么第 2 步还要再次判断?能够进入第 2 步,说明已经不是重复操作了,第 2 次判断是否重复?

当然不重复。一般缓存中的数据是具有有效期的。缓存中数据的有效期一旦过期,就是发生缓存穿透,使请求直接就到达了DBMS。

7、消息的堆积、延迟

消息处理流程中,如果Consumer的消费速度跟不上Producer的发送速度,MQ中未处理的消息会越来越多(进的多出的少),这部分消息就被称为堆积消息。消息出现堆积进而会造成消息的消费延迟。

以下场景需要重点关注消息堆积和消费延迟问题:

- 业务系统上下游能力不匹配造成的持续堆积,且无法自行恢复。

- 业务系统对消息的消费实时性要求较高,即使是短暂的堆积造成的消费延迟也无法接受。

(1)原因

- Consumer通过长轮询Pull模式批量拉取的方式从服务端获取消息,将拉取到的消息缓存到本地缓冲队列中。对于拉取式消费,在内网环境下会有很高的吞吐量,所以这一阶段一般不会成为消息堆积的瓶颈。

- Consumer将本地缓存的消息提交到消费线程中,使用业务消费逻辑对消息进行处理,处理完毕后获取到一个结果。这是真正的消息消费过程。此时Consumer的消费能力就完全依赖于消息的消费耗时和消费并发度了。如果由于业务处理逻辑复杂等原因,导致处理单条消息的耗时较长,则整体的消息吞吐量肯定不会高,此时就会导致Consumer本地缓冲队列达到上限,停止从服务端拉取消息。

- 因此消息堆积的主要瓶颈在于客户端的消费能力,而消费能力由

消费耗时和消费并发度决定。注意,消费耗时的优先级要高于消费并发度。即在保证了消费耗时的合理性前提下,再考虑消费并发度问题。

Ⅰ、消费耗时

- 影响消息处理时长的主要因素是代码逻辑。而代码逻辑中可能会影响处理时长代码主要有两种类型:CPU内部计算型代码和外部I/O操作型代码。

- 通常情况下代码中如果没有复杂的递归和循环的话,内部计算耗时相对外部I/O操作来说几乎可以忽略。所以外部IO型代码是影响消息处理时长的主要症结所在。

Ⅱ、消费并发度

- 一般情况下,消费者端的消费并发度由单节点线程数和节点数量共同决定,其值为

单节点线程数*节点数量。 - 通常需要优先调整单节点的线程数,若单机硬件资源达到了上限,则需要通过横向扩展来提高消费并发度。

单节点线程数,即单个Consumer所包含的线程数量

节点数量,即Consumer Group所包含的Consumer数量

对于普通消息、延时消息及事务消息,并发度计算都是单节点线程数*节点数量。但对于顺序消息则是不同的。顺序消息的消费并发度等于Topic的Queue分区数量。

1 )全局顺序消息:该类型消息的Topic只有一个Queue分区。其可以保证该Topic的所有消息被顺序消费。为了保证这个全局顺序性,Consumer Group中在同一时刻只能有一个Consumer的一个线程进行消费。所以其并发度为 1 。

2 )分区顺序消息:该类型消息的Topic有多个Queue分区。其仅可以保证该Topic的每个Queue分区中的消息被顺序消费,不能保证整个Topic中消息的顺序消费。为了保证这个分区顺序性,每个Queue分区中的消息在Consumer Group中的同一时刻只能有一个Consumer的一个线程进行消费。即,在同一时刻最多会出现多个Queue分区有多个Consumer的多个线程并行消费。所以其并发度为Topic的分区数量。

8、消息的清理

消息是被顺序存储在commitlog文件的,且消息大小不定长,所以消息的清理是不可能以消息为单位进行清理的,而是以commitlog文件为单位进行清理的。否则会急剧下降清理效率,并实现逻辑复杂。

commitlog文件存在一个过期时间,默认为 72 小时,即三天。除了用户手动清理外,在以下情况下也会被自动清理,无论文件中的消息是否被消费过:

- 文件过期,且到达清理时间点(默认为凌晨 4 点)后,自动清理过期文件

- 文件过期,且磁盘空间占用率已达过期清理警戒线(默认75%)后,无论是否达到清理时间点,都会自动清理过期文件

- 磁盘占用率达到清理警戒线(默认85%)后,开始按照设定好的规则清理文件,无论是否过期。默认会从最老的文件开始清理

- 磁盘占用率达到系统危险警戒线(默认90%)后,Broker将拒绝消息写入

1135

1135

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?