torch.nn.Conv2d()为torch中的卷积层,参数如下:

def __init__(self, in_channels,

out_channels,

kernel_size, stride=1,

padding=0, dilation=1,

groups=1, bias=True,

padding_mode='zeros'):

padding操作是用来对原有输入张量外围进行填补,以达到经过卷积之后得到的输出张量是我们所想要的维度。通常情况下padding用的都是全0填补,而torch中的padding采用的是四周全部进行填补的方式,padding的值为每一边所填补的层数。

举个栗子:

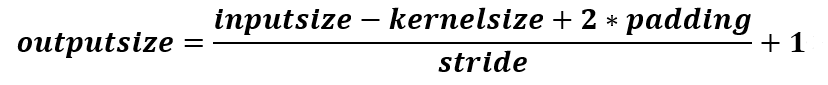

假设现有(1, 3, 3)维度的张量,1表示通道数,我希望经过一层卷积层之后得到的输出为(1, 5, 5)的维度,采用尺寸为(3,3)的过滤器,步长为1,根据输入大小和输出大小的计算公式,得到padding的值为2,即原张量上下左右各填补两层

得到的卷积层的权重、偏置和输出张量如下所示:

通过卷积层的运算可以得出torch的padding操作确实是四周全部进行填充。有的时候通过上述公式计算padding的值时可能会遇到不能整除的现象,此时必须将padding的值向上取整,这样填补后的张量会在H和W维度上各多一层,只要过滤器无法覆盖就不会对其进行卷积。

测试代码:

import torch

import torch.nn as nn

x = torch.randn(1, 3, 3)

print(x)

class Model(nn.Module):

def __init__(self):

super(Model, self).__init__()

self.model = nn.Sequential(

nn.Conv2d(

in_channels=1,

out_channels=1,

kernel_size=3,

stride=1,

padding=2

)

)

def forward(self, input):

input = input.view(1, 1, 3, 3)

return self.model(input)

model = Model()

param = {}

for name, parameters in model.named_parameters():

param[name] = parameters.detach().numpy()

print(param)

x_out = model(x)

print(x_out)

1349

1349

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?