ChatGPT模型,备受关注,不光是做人工智能、机器学习的人关注,而是大量的各行各业从业人员都来关注这个模型。ghat属于大规模预训练模型,有两个关键字,大规模和预训练,

大规模:参数够多、模型够大

预训练:数据集够多,训练时间够多

所以单个人没有足够的算力,那就直接有现成的吧

语言处理和图像处理在深度学习里都差不多原理基本相似,在监督学习中都是需要大量的标注数据和人工干预。

gpt也是迭代发展出来的

1、GPT 初代

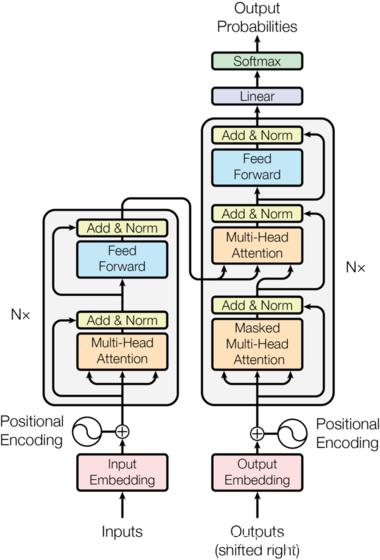

大致思想是基于 Transformer 这种编码器,获取了文本内部的相互联系。编解码的概念广泛应用于各个领域,在 NLP 领域,人们使用语言一般包括三个步骤:

接受听到或读到的语言 -> 大脑理解 -> 输出要说的语言。

语言是一个显式存在的东西,但大脑是如何将语言进行理解、转化、存储的,目前仍未探明的东西。但大脑理解语言这个过程,就是大脑将语言编码成一种可理解、可存储形式的过程,这个过程就叫做语言的编码。

相应的,把大脑中想要表达的内容,使用语言表达出来,就叫做语言的解码。

在语言模型中,编码器和解码器都是由一个个的 Transformer 组件拼接在一起形成的。(之后有时间会单独出一个Transformer )

GPT 使用了 decoder 部分。decoder 模型更加适应于文本生成领域。

2、GPT-2

最初的时候,预训练任务仅仅是一个完形填空任务就可以让语言模型有了极大进步,那么,给模型出其它的语言题型,应该也会对模型训练有极大的帮助。如句子打乱顺序再排序、选择题、判断题、改错题、把预测单字改成预测实体词汇等等,纷纷都可以制定数据集添加在模型的预训练里。最后把各种NLP任务的数据集全部添加到预训练阶段,如机器翻译、文本摘要、领域问答统统往预训练里加。

这个过程也和人脑很像,人脑是非常稳定和泛化的,既可以读诗歌,也可以学数学,还可以学外语,看新闻,听音乐等等,简而言之,就是一脑多用。

所以GPT-2 主要就是在 GPT 的基础上,又添加了多个任务,扩增了数据集和模型参数,又训练了一番。

模型可以多用,数据集也可以多用,如“汪小菲的妈是张兰”,这条文字包含的信息量是通用的,它既可以用于翻译,也可以用于分类,判断错误等等。也就是说,信息是脱离具体 NLP 任务存在的,举一反三,能够利用这条信息,在每一个 NLP 任务上都表现好,这个是 元学习(meta-learning)。本质上就是语言模型的一脑多用。

3、GPT-3

首先, GPT-3 的模型所采用的数据量之大,高达上万亿,模型参数量也十分巨大,上千亿,学习复杂,计算繁复。这些都是在燃烧的金钱,真就是 all you need is money。如此巨大的模型造就了 GPT-3 在许多十分困难的 NLP 任务,诸如撰写人类难以判别的文章,甚至编写SQL查询语句,React或者JavaScript代码上优异的表现。

以往的预训练都是两段式的,即,首先用大规模的数据集对模型进行预训练,然后再利用下游任务的标注数据集进行 finetune,时至今日这也是绝大多数 NLP 模型任务的基本工作流程。

GPT-3 就开始颠覆这种认知了。它提出了一种 in-context 学习方式。也就是,我们对模型进行引导,教会它应当输出什么内容。

4、ChatGPT

ChatGPT 模型上基本上和之前 GPT-3 都没有太大变化,主要变化的是训练策略变了,用上了强化学习。

几年前,alpha GO 击败了柯洁,几乎可以说明,强化学习如果在适合的条件下,完全可以打败人类,逼近完美的极限。

强化学习非常像生物进化,模型在给定的环境中,不断地根据环境的惩罚和奖励(reward),拟合到一个最适应环境的状态。

NLP 所依赖的环境,是整个现实世界,整个宇宙万物,都可以被语言描述,也就都需要针对模型输出的质量进行 reward 评价,它完全无法设计反馈惩罚和奖励函数。除非人们一点点地人工反馈。所以有钱能使鬼推磨,OpenAI 的 ChatGPT 就把这事给干了。

在ChatGPT里,具体就是让那40名外包人员不断地从模型的输出结果中筛选,判断哪些句子是好的,哪些是低质量的,这样就可以训练得到一个 reward 模型。

所以目前只要模型足够大,数据足够丰富,reward 模型经过了更多的人迭代和优化,完全可以创造一个无限逼近真实世界的超级 OpenAI 大脑。

但chatgpt 也有一些问题如它没有在推理阶段连接外部信息的。

总结:

大力出奇迹呀,有钱就是牛

Chatgpt之所以能够爆火,是因为其模型够大,支持功能够多(主要是对话即发散思维)但这些功能也是通过一条一条数据集喂出来的。一些小的企业或者公司没有必要将模型做的非常大,只需要通过Chatgpt实现某一功能即可。

1442

1442

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?