深度学习框架Pytorch——学习笔记(六)PyTorch实现L1,L2正则化以及Dropout

什么是过拟合?

过拟合的表现就是在训练过程中,loss越来越低,但在测试集上测试发现效果很差,测试loss反而在逐渐升高,模型泛化能力就变得很差。

即训练参数过于贴合训练集的一种现象。

解决过拟合的方法有:

1."踩刹车" 在过拟合出现之前进行刹车,lr-decay. 逐步降低学习率,前期大步走,后期小步走。

2.数据增强 获取更多的数据

3.正则化 本质是降低模型复杂度,防止过拟合

正则化方法是指在进行目标函数或代价函数优化时,在目标函数或代价函数后面加上一个正则项,一般有L1正则与L2正则等。

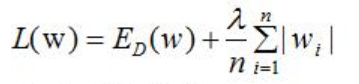

L1正则即在原有的损失函数的基础上添加参数向量的L1范数。

L2正则即在原有的损失函数的基础上添加参数向量的L2范数。

4.dropout 随着Alexnet提出的一种方法。

5.现在开始采用预训练方式进行,选取好的初始化参数。

Dropout 、L2、L1 正则化

Dropout

Dropout 就是缓解过拟合的一种方式,它的原理就是随机关闭一部分神经元,使其不工作,即参数不进行更新。

L1 L2 正则化

两种标准化方式:L1 L2. 对w进行惩罚.

L1正则即在原有的损失函数的基础上添加参数向量的L1范数。当w大于0时,更新的参数w变小;当w小于0时,更新的参数w变大;所以,L1正则化容易使参数变为0.

L2正则即在原有的损失函数的基础上添加参数向量的L2范数。当w趋向于0时,参数减小的非常缓慢,因此L2正则化使参数减小到很小的范围,但不为0。

在pytorch中没有明确的添加L1和L2正则化的方法,

L2可以直接的采用优化器自带的weight_decay选项来制订权重衰减,相当于L2正则化中的λ, optimizer = torch.optim.Adam(model.parameters(), lr=1e-4, weight_decay=1e-5)

L1 则采用手动直接加方式进行。

基于上次的实现神经网络,进行修改,使用Dropout

import torch.nn as nn

import torch.nn.functional as F

class Net(nn.Module):

def __init__(self):

super(Net, self).__init__()

self.conv1 = nn.Conv2d(3, 6, 5)

self.pool = nn.MaxPool2d(2, 2)

self.conv2 = nn.Conv2d(6, 16, 5)

self.dropout = nn.Dropout(0.5)

self.fc1 = nn.Linear(16 * 5 * 5, 120)

self.fc2 = nn.Linear(120, 84)

self.fc3 = nn.Linear(84, 10)

def forward(self, x):

x = self.conv1(x)

x = self.dropout(x)

x = self.pool(F.relu(x))

x = self.conv2(x)

x = self.dropout(x)

x = self.pool(F.relu(x))

x = x.view(-1, 16 * 5 * 5)

x = F.relu(self.fc1(x))

x = F.relu(self.fc2(x))

x = self.fc3(x)

return x

net = Net()

# ####GPU train

device = torch.device("cuda:0" if torch.cuda.is_available() else "cpu")

# 1.

net.to(device)

import torch.optim as optim

criterion = nn.CrossEntropyLoss()

optimizer = optim.SGD(net.parameters(), lr=0.001, momentum=0.9)

for epoch in range(10): # loop over the dataset multiple times

running_loss = 0.0

for i, data in enumerate(trainloader, 0):

# get the inputs

inputs, labels = data

# 2.

inputs, labels = inputs.to(device), labels.to(device)

# zero the parameter gradients

optimizer.zero_grad()

# forward + backward + optimize

outputs = net(inputs)

loss = criterion(outputs, labels)

loss.backward()

optimizer.step()

# print statistics

running_loss += loss.item()

if i % 2000 == 1999: # print every 2000 mini-batches

print('[%d, %5d] loss: %.3f' %

(epoch + 1, i + 1, running_loss / 2000))

running_loss = 0.0

print('Finished Training')

### GPU test

class_correct = list(0. for i in range(10))

class_total = list(0. for i in range(10))

with torch.no_grad():

for data in testloader:

images, labels = data

images, labels = images.to(device), labels.to(device)

outputs = net(images)

_, predicted = torch.max(outputs, 1)

# print(predicted)

c = (predicted == labels).squeeze()

for i in range(4):

label = labels[i]

class_correct[label] += c[i].item()

class_total[label] += 1

for i in range(10):

print('Accuracy of %5s : %2d %%' % (

classes[i], 100 * class_correct[i] / class_total[i]))

测试结果比对

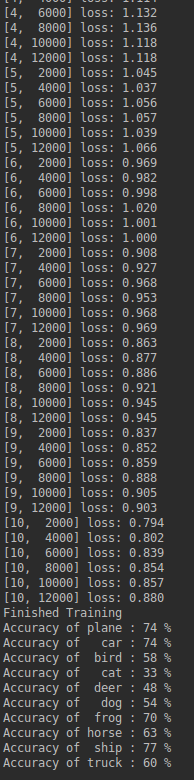

没有使用Dropout result

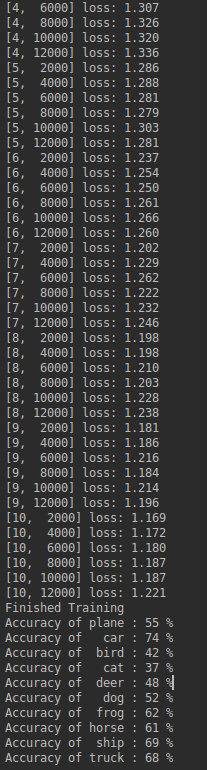

使用Dropout result

loss 还在下降,但效果是差不多的。

4919

4919

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?