前言

文件位置:./models/commonpy

该文件是实现YOLO算法中各个模块的地方,如果我们需要修改某一模块(例如C3),那么就需要修改这个文件中对应模块的的定义。

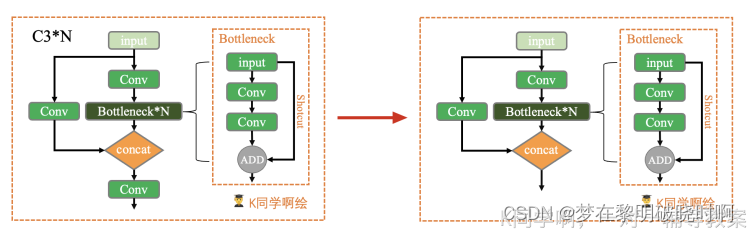

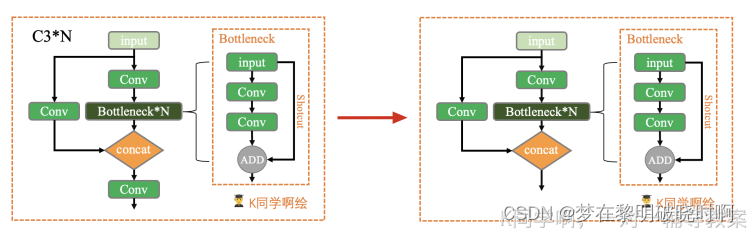

● 📌 本次任务:将YOLOv5s网络模型中的C3模块按照下图方式修改,并跑通YOLOv5。

● 💫 任务提示:仅需修改./models/common.yaml文件。

●📌 本篇文章来源:K同学的一对一辅导教案

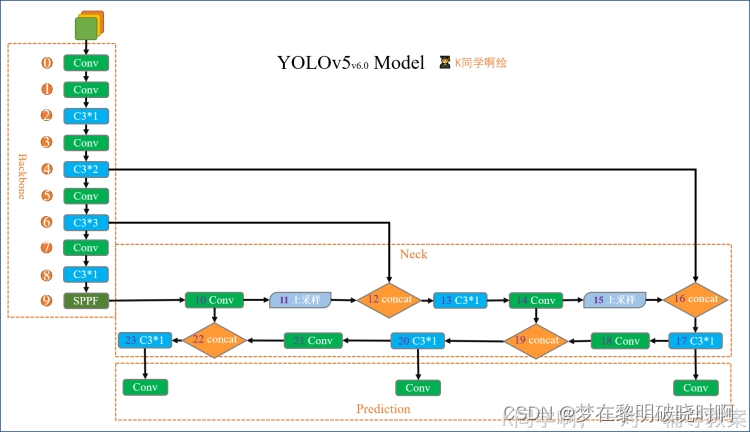

YOLOv5s网络结构图:

0导入需要的包和基本配置

import math # 数学函数模块

from copy import copy # 数据拷贝模块 分浅拷贝和深拷贝

from pathlib import Path # Path将str转换为Path对象 使字符串路径易于操作的模块

import numpy as np # numpy数组操作模块

import pandas as pd # panda数组操作模块

import requests # Python的HTTP客户端库

import torch # pytorch深度学习框架

import torch.nn as nn # 专门为神经网络设计的模块化接口

from PIL import Image # 图像基础操作模块

from torch.cuda import amp # 混合精度训练模块

from utils.datasets import letterbox

from utils.general import non_max_suppression, make_divisible, scale_coords, increment_path, xyxy2xywh, save_one_box

from utils.plots import colors, plot_one_box

from utils.torch_utils import time_synchronized`

1、基本组件

1.1、autopad

这个模块可以根据输入的卷积核计算该卷积模块所需的pad值。将会用于下面会讲到的Conv函数和Classify函数中。

def autopad(k, p=None):

"""用于Conv函数和Classify函数中

根据卷积核大小k自动计算卷积核padding数(0填充)

v5中只有两种卷积:

1、下采样卷积:conv3x3 s=2 p=k//2=1

2、feature size不变的卷积:conv1x1 s=1 p=k//2=1

:params k: 卷积核的kernel_size

:return p: 自动计算的需要pad值(0填充)

"""

if p is None:

p = k // 2 if isinstance(k, int) else [x // 2 for x in k] # 自动计算pad数

return p

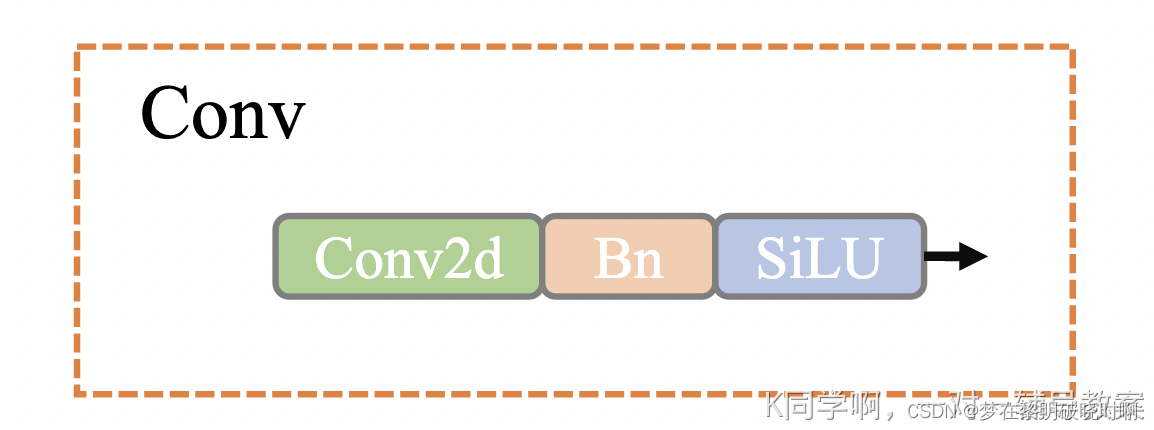

1.2、Conv

这个函数是整个网络中最基础的组件,由卷积层 + BN层 + 激活函数 组成,具体结构如下图:

Conv模块代码:

class Conv(nn.Module):

def __init__(self, c1, c2, k=1, s=1, p=None, g=1, act=True):

"""在Focus、Bottleneck、BottleneckCSP、C3、SPP、DWConv、TransformerBloc等模块中调用

Standard convolution conv+BN+act

:params c1: 输入的channel值

:params c2: 输出的channel值

:params k: 卷积的kernel_size

:params s: 卷积的stride

:params p: 卷积的padding 一般是None 可以通过autopad自行计算需要pad的padding数

:params g: 卷积的groups数 =1就是普通的卷积 >1就是深度可分离卷积

:params act: 激活函数类型 True就是SiLU()/Swish False就是不使用激活函数

类型是nn.Module就使用传进来的激活函数类型

"""

super(Conv, self).__init__()

self.conv = nn.Conv2d(c1, c2, k, s, autopad(k, p), groups=g, bias=False) # conv

self.bn = nn.BatchNorm2d(c2) # bn

self.act = nn.SiLU() if act is True else (act if isinstance(act, nn.Module) else nn.Identity()) # activation

#前向计算,网络执行的顺序是根据forward函数来决定的:conv+BN+silu

def forward(self, x):

return self.act(self.bn(self.conv(x)))

# 用于model类的fuse函数,conv+BN,加速推理,一般用于测试实验或者验证阶段

def fuseforward(self, x):

"""用于Model类的fuse函数

融合conv+bn 加速推理 一般用于测试/验证阶段

"""

return self.act(self.conv(x))

另外这个类中还有一个特殊函数 fuseforward ,这是一个前向加速推理模块,在前向传播过程中,通过融合conv + bn层,达到加速推理的作用,一般用于测试或验证阶段。

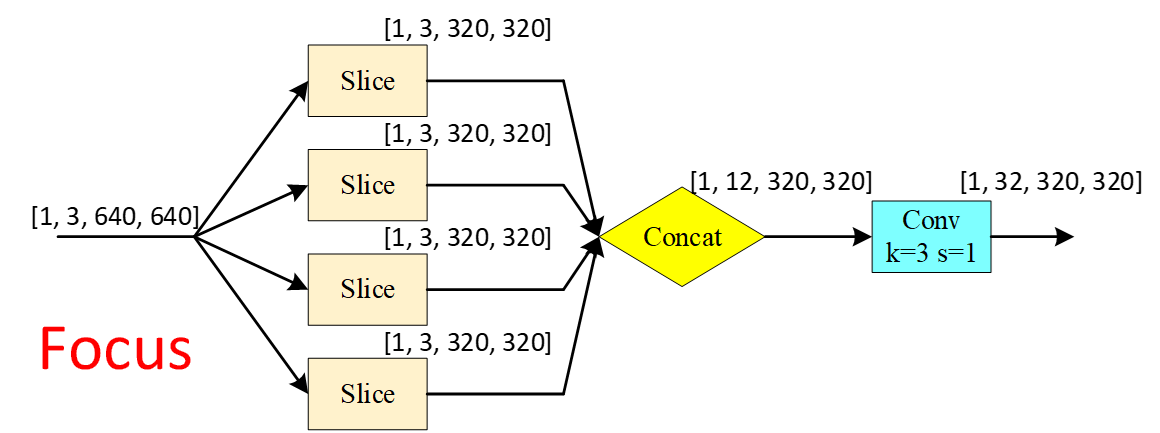

1.3、Focus

Focus模块是作者自己设计出来,为了减少浮点数和提高速度,而不是增加featuremap的,本质就是将图像进行切片,类似于下采样取值,将原图像的宽高信息切分,聚合到channel通道中。结构如下所示:

Focus模块代码:

class Focus(nn.Module):

def __init__(self, c1, c2, k=1, s=1, p=None, g=1, act=True):

"""在yolo.py的parse_model函数中被调用

理论:从高分辨率图像中,周期性的抽出像素点重构到低分辨率图像中,即将图像相邻的四个位置进行堆叠,

聚焦wh维度信息到c通道空,提高每个点感受野,并减少原始信息的丢失,该模块的设计主要是减少计算量加快速度。

Focus wh information into c-space 把宽度w和高度h的信息整合到c空间中

先做4个slice 再concat 最后再做Conv

slice后 (b,c1,w,h) -> 分成4个slice 每个slice(b,c1,w/2,h/2)

concat(dim=1)后 4个slice(b,c1,w/2,h/2)) -> (b,4c1,w/2,h/2)

conv后 (b,4c1,w/2,h/2) -> (b,c2,w/2,h/2)

:params c1: slice后的channel

:params c2: Focus最终输出的channel

:params k: 最后卷积的kernel

:params s: 最后卷积的stride

:params p: 最后卷积的padding

:params g: 最后卷积的分组情况 =1普通卷积 >1深度可分离卷积

:params act: bool激活函数类型 默认True:SiLU()/Swish False:不用激活函数

"""

super(Focus, self).__init__()

self.conv = Conv(c1 * 4, c2, k, s, p, g, act) # concat后的卷积(最后的卷积)

# self.contract = Contract(gain=2) # 也可以调用Contract函数实现slice操作

def forward(self, x):

# x(b,c,w,h) -> y(b,4c,w/2,h/2) 有点像做了个下采样

return self.conv(torch.cat([x[..., ::2, ::2], x[..., 1::2, ::2], x[..., ::2, 1::2], x[..., 1::2, 1::2]], 1))

# return self.conv(self.contract(x))

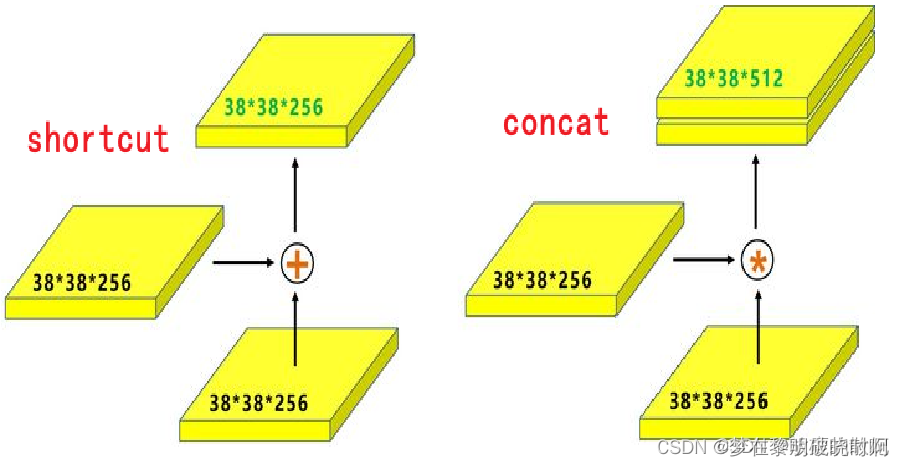

1.4、Bottleneck

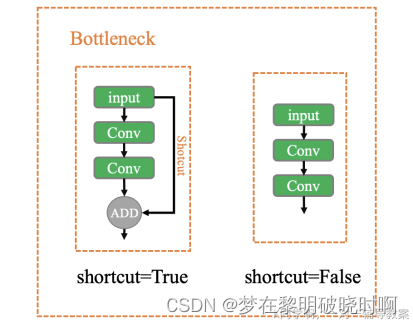

Bottleneck的模型结构如下图所示,当Shotcut=True(注意:具体代码里的条件为Shotcut and c1==c2)时,其网络结构类似残差网络,将输入input与两次Conv后的结构进行相加,否则不进行add操作。

模型结构:

Bottleneck模块代码:

class Bottleneck(nn.Module):

def __init__(self, c1, c2, shortcut=True, g=1, e=0.5):

"""在BottleneckCSP和yolo.py的parse_model中调用

Standard bottleneck Conv+Conv+shortcut

:params c1: 第一个卷积的输入channel

:params c2: 第二个卷积的输出channel

:params shortcut: bool 是否有shortcut连接 默认是True

:params g: 卷积分组的个数 =1就是普通卷积 >1就是深度可分离卷积

:params e: expansion ratio e*c2就是第一个卷积的输出channel=第二个卷积的输入channel

[ e -- 为bottleneck结构中的瓶颈部分的通道膨胀率(expansion ratio),

使用0.5即为输入的1/2,

e为控制瓶颈的参数,e越小则瓶颈越窄,

瓶颈是指经过一个Conv将通道数缩小,然后再通过一个Conv变成原来的通道数,

而e就是控制这个窄度的

————————————————

版权声明:本文为CSDN博主「放鹿的散妃」的原创文章,遵循CC 4.0 BY-SA版权协议,转载请附上原文出处链接及本声明。

原文链接:https://blog.csdn.net/ali1174/article/details/129766023]

"""

super(Bottleneck, self).__init__()

c_ = int(c2 * e) # hidden channels

self.cv1 = Conv(c1, c_, 1, 1) # 1x1卷积

self.cv2 = Conv(c_, c2, 3, 1, g=g) # 3x3卷积

self.add = shortcut and c1 == c2 # 相加操作 , shortcut=True and c1 == c2 才能做shortcut

#( shortcut为True 并且输入输出的channel大小一样才能进行add操作)

'''

[详解:](https://blog.csdn.net/ali1174/article/details/129766023)

https://blog.csdn.net/XiaoGShou/article/details/117351971

这里的瓶颈层,瓶颈主要体现在通道数channel上面!

一般1*1卷积具有很强的灵活性,这里用于降低通道数,如上面的膨胀率为0.5,

若输入通道为640,那么经过1*1的卷积层之后变为320;

经过3*3之后变为输出的通道数,这样参数量会大量减少

这里的shortcut即为图中的虚线,在实际中,shortcut(捷径)不一定是上面都不操作,

也有可能有卷积处理,但此时,另一只一般是多个ReNet模块串联而成。

而这里的shortcut也成为了identity分支,可以理解为恒等映射,

另一个分支被称为残差分支(Residual分支)

我们经常使用的残差分支实际上是1*1+3*3+1*1结构

'''

def forward(self, x):

return x + self.cv2(self.cv1(x)) if self.add else self.cv2(self.cv1(x))

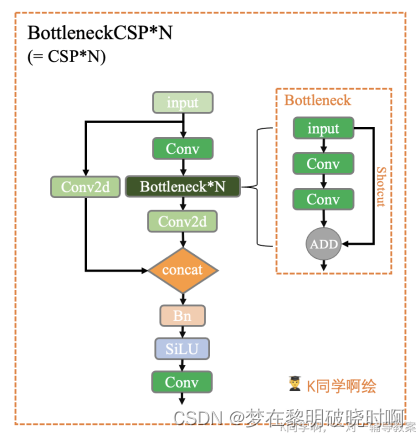

1.5、BottleneckCSP

这个模块是由Bottleneck模块和CSP结构组成。

CSP结构来源于2019年发表的一篇论文:CSPNet: A New Backbone that can Enhance Learning Capability of CNN.

这个模块和上面yolov5s中的C3模块等效,如果要用的话直接在yolov5s.yaml文件中讲C3改成BottleneckCSP即可,但是一般来说不用改,因为C3更好。

BottleneckCSP模块具体的结构如下所示:

BottleneckCSP模块代码:

class BottleneckCSP(nn.Module):

def __init__(self, c1, c2, n=1, shortcut=True, g=1, e=0.5):

"""在C3模块和yolo.py的parse_model模块调用

CSP Bottleneck https://github.com/WongKinYiu/CrossStagePartialNetworks

:params c1: 整个BottleneckCSP的输入channel

:params c2: 整个BottleneckCSP的输出channel

:params n: 有n个Bottleneck

:params shortcut: bool Bottleneck中是否有shortcut,默认True

:params g: Bottleneck中的3x3卷积类型 =1普通卷积 >1深度可分离卷积

:params e: expansion ratio c2xe=中间其他所有层的卷积核个数/中间所有层的输入输出channel数

"""

# ch_in, ch_out, number, shortcut, groups, expansion

super(BottleneckCSP, self).__init__()

c_ = int(c2 * e) # hidden channels

self.cv1 = Conv(c1, c_, 1, 1) # 第一个Conv模块

self.cv2 = nn.Conv2d(c1, c_, 1, 1, bias=False)

self.cv3 = nn.Conv2d(c_, c_, 1, 1, bias=False)

self.cv4 = Conv(2 * c_, c2, 1, 1)

self.bn = nn.BatchNorm2d(2 * c_) # applied to cat(cv2, cv3) 2*c_

self.act = nn.LeakyReLU(0.1, inplace=True)

# 叠加n次Bottleneck

self.m = nn.Sequential(*[Bottleneck(c_, c_, shortcut, g, e=1.0) for _ in range(n)])

def forward(self, x):

# y1相当于 先做一次cv1操作然后进行m操作最后进行cv3操作, 也就是BCSPn模块中的上面的分支操作

# 输入x ->Conv模块 ->n个bottleneck模块 ->Conv模块 ->y1

y1 = self.cv3(self.m(self.cv1(x)))

# y2就是进行cv2操作,也就是BCSPn模块中的下面的分支操作(直接逆行conv操作的分支, Conv--nXBottleneck--conv)

# 输入x -> Conv模块 -> 输出y2

y2 = self.cv2(x)

# 最后y1和y2做拼接, 然后做bn, 然后做act激活, 最后做cv4

# 输入y1,y2->按照通道数融合 ->归一化 -> 激活函数 -> Conv输出 -> 输出

return self.cv4(self.act(self.bn(torch.cat((y1, y2), dim=1))))

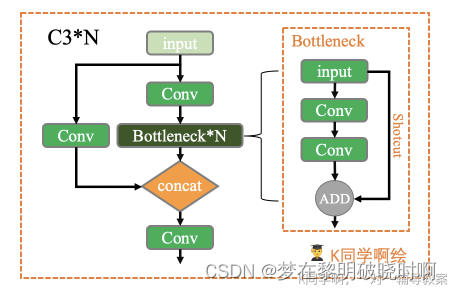

1.6、C3

这个模块是一种简化版的BottleneckCSP,因为除了Bottleneck部分只有3个卷积,可以减少参数,所以取名C3。而作者之所以用C3来带代替BottleneckCSP也是有原因的,作者原话:

C3模块具体的结构如下所示:

C3模块代码:

class C3(nn.Module):

def __init__(self, c1, c2, n=1, shortcut=True, g=1, e=0.5):

"""在C3TR模块和yolo.py的parse_model模块调用

CSP Bottleneck with 3 convolutions

:params c1: 整个BottleneckCSP的输入channel

:params c2: 整个BottleneckCSP的输出channel

:params n: 有n个Bottleneck

:params shortcut: bool Bottleneck中是否有shortcut,默认True

:params g: Bottleneck中的3x3卷积类型 =1普通卷积 >1深度可分离卷积

:params e: expansion ratio c2xe=中间其他所有层的卷积核个数/中间所有层的输入输出channel数

"""

super(C3, self).__init__()

c_ = int(c2 * e) # hidden channels

self.cv1 = Conv(c1, c_, 1, 1)

self.cv2 = Conv(c1, c_, 1, 1)

self.cv3 = Conv(2 * c_, c2, 1) # act=FReLU(c2)

self.m = nn.Sequential(*[Bottleneck(c_, c_, shortcut, g, e=1.0) for _ in range(n)])

# 实验性 CrossConv

# self.m = nn.Sequential(*[CrossConv(c_, c_, 3, 1, g, 1.0, shortcut) for _ in range(n)])

def forward(self, x):

return self.cv3(torch.cat((self.m(self.cv1(x)), self.cv2(x)), dim=1))

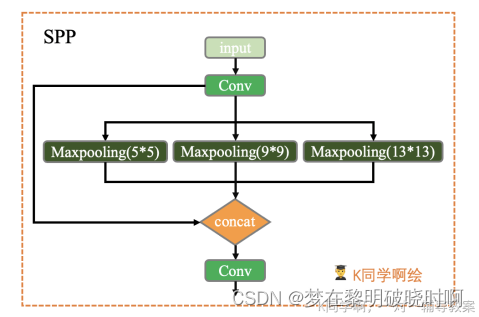

1.7、SPP

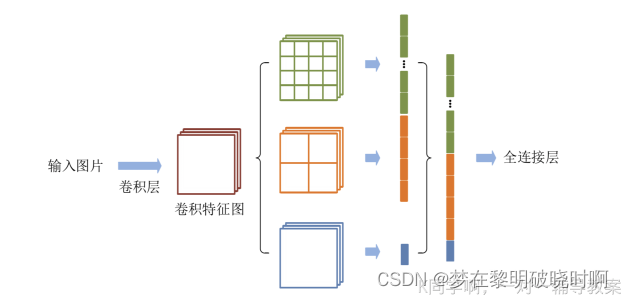

高层网络层的感受野的语义信息表征能力强,低层网络层的感受野空间细节信息表征能力强。空间金字塔池化(Spatial Pyramid Pooling,SPP)是目标检测算法中对高层特征进行多尺度池化以增加感受野的重要措施之一。

CNN的卷积层是可以处理任意尺度的输入的,只是在全连接层处有限制尺度。经典的空间金字塔池化模块首先将输入的卷积特征分成不同的尺寸,然后每个尺寸提取固定维度的特征,最后将这些特征拼接成一个固定的维度,如图1所示。输入的卷积特征图的大小为(w,h),第一层空间金字塔采用4×4的刻度对特征图进行划分,其将输入的特征图分成了16个块,每块的大小为(w/4, h/4);第二层空间金字塔采用2×2刻度对特征图进行划分,其将特征图分为4个快,每块大小为(w/2,h/2);第三层空间金字塔将整张特征图作为一块,进行特征提取操作,最终的特征向量为21=16+4+1维。

SPP是在Feature Map经过不同尺度的池化后,将特征图们重新cat起来传到下一层侦测网络中,其网络结构如下图所示。这样SPP就融合了局部与全局特征,同时还兼顾了避免裁剪图像的作用。

SPP模块具体的结构如下所示:

SPP模块代码:

class SPP(nn.Module):

def __init__(self, c1, c2, k=(5, 9, 13)):

"""在yolo.py的parse_model模块调用

空间金字塔池化 Spatial pyramid pooling layer used in YOLOv3-SPP

:params c1: SPP模块的输入channel

:params c2: SPP模块的输出channel

:params k: 保存着三个maxpool的卷积核大小 默认是(5, 9, 13)

"""

super(SPP, self).__init__()

c_ = c1 // 2 # hidden channels

# CV1进行conv操作

self.cv1 = Conv(c1, c_, 1, 1) # 第一层1*1卷积

# cv2进行conv操作

self.cv2 = Conv(c_ * (len(k) + 1), c2, 1, 1) # 最后一层卷积 +1是因为有len(k)+1个输入

self.m = nn.ModuleList([nn.MaxPool2d(kernel_size=x, stride=1, padding=x // 2) for x in k]) # m最大池化操作的list,通过nn.ModuleList进行构造一个m模块,在构造时对每一个k都要进行最大池化

def forward(self, x):

# 先进行cv1的操作

x = self.cv1(x)

# 对每一个m进行最大池化 和没有做池化的每一个输入进行叠加 然后做拼接 最后做cv2操作

return self.cv2(torch.cat([x] + [m(x) for m in self.m], 1))

# torch.cat()是将两个tensor 横着拼接拼在一起

# 补充: 或者是List 列表中的tensor

1.8、Concat

这个函数是讲自身(a list of tensors)按照某个维度进行concat,常用来合并前后两个feature map,也就是上面yolov5s结构图中的Concat。

class Concat(nn.Module):

def __init__(self, dimension=1):

"""在yolo.py的parse_model模块调用

Concatenate a list of tensors along dimension

:params dimension: 沿着哪个维度进行concat

"""

super(Concat, self).__init__()

self.d = dimension

def forward(self, x):

# x: a list of tensors

return torch.cat(x, self.d)

📋torch.cat()用法示例:

>>> x = torch.randn(2, 3)

>>> x

#tensor([[ 0.6580, -1.0969, -0.4614],

# [-0.1034, -0.5790, 0.1497]])

>>> torch.cat((x, x, x), 0)

#tensor([[ 0.6580, -1.0969, -0.4614],

# [-0.1034, -0.5790, 0.1497],

# [ 0.6580, -1.0969, -0.4614],

# [-0.1034, -0.5790, 0.1497],

# [ 0.6580, -1.0969, -0.4614],

# [-0.1034, -0.5790, 0.1497]])

>>> torch.cat((x, x, x), 1)

#tensor([[ 0.6580, -1.0969, -0.4614, 0.6580, -1.0969, -0.4614, 0.6580,

# -1.0969, -0.4614],

# [-0.1034, -0.5790, 0.1497, -0.1034, -0.5790, 0.1497, -0.1034,

# -0.5790, 0.1497]])

1.9、Contract、Expand

这两个函数用于改变 feature map 维度。

● Contract 函数改变输入特征的shape,将 feature map 的 w 和 h 维度(缩小)的数据收缩到 channel 维度上(放大)。如:x(1,64,80,80) to x(1,256,40,40)。

● Expand 函数也是改变输入特征的 shape,不过与 Contract 的相反, 是将 channel 维度(变小)的数据扩展到W和H维度(变大)。如:x(1,64,80,80) to x(1,16,160,160)。

以下是对两个模块的解读。

class Contract(nn.Module):

"""用在yolo.py的parse_model模块 用的不多

改变输入特征的shape 将w和h维度(缩小)的数据收缩到channel维度上(放大)

Contract width-height into channels, i.e. x(1,64,80,80) to x(1,256,40,40)

"""

def __init__(self, gain=2):

super().__init__()

# 缩放的尺度

self.gain = gain

def forward(self, x):

N, C, H, W = x.size() # 1 64 80 80

s = self.gain # 2

x = x.view(N, C, H // s, s, W // s, s) # x(1,64,40,2,40,2)

# permute: 改变tensor的维度顺序

x = x.permute(0, 3, 5, 1, 2, 4).contiguous() # x(1,2,2,64,40,40)

# .view: 改变tensor的维度

return x.view(N, C * s * s, H // s, W // s) # x(1,256,40,40)

class Expand(nn.Module):

"""用在yolo.py的parse_model模块 用的不多

改变输入特征的shape 将channel维度(变小)的数据扩展到W和H维度(变大)

Expand channels into width-height, i.e. x(1,64,80,80) to x(1,16,160,160)

"""

def __init__(self, gain=2):

super().__init__()

self.gain = gain

def forward(self, x):

N, C, H, W = x.size() # 1 64 80 80

s = self.gain # 2

x = x.view(N, s, s, C // s ** 2, H, W) # x(1,2,2,16,80,80)

x = x.permute(0, 3, 4, 1, 5, 2).contiguous() # x(1,16,80,2,80,2)

return x.view(N, C // s ** 2, H * s, W * s) # x(1,16,160,160)

2、重要类

下面的几个函数都是属于模型的扩展模块。yolov5的作者将搭建模型的函数功能写的很齐全。不光包含搭建模型部分,还考虑到了各个方面其他的功能,比如给模型搭载nms功能、给模型封装成包含前处理、推理、后处理的模块(预处理 + 推理 + nms)、二次分类等等功能。

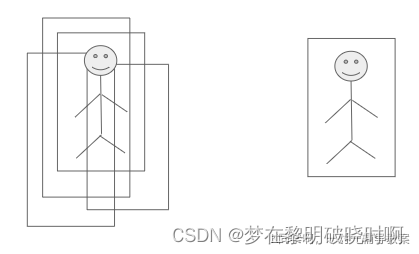

2.1、非极大值抑制(NMS)

非极大值抑制(Non-maximum Suppression (NMS))的作用简单说就是模型检测出了很多框,我应该留哪些。

YOLOv5 中使用 NMS 算法用来移除一些网络模型预测时生成的多余检测框,该算法的核心思想是指搜索局部得分最大值预测并移除与局部最大值预测框重叠度超过一定阈值的检测框,需要注意的是,NMS 算法对所有待检测目标类别分别执行。

非极大值抑制的基本原理:

1、将所有的矩形框按照不同的类别标签分组,组内按分数高低进行排序,取得分最高的矩形框先放入结果序列;

2、遍历剩余矩形框,计算与当前得分最高的矩形框的交并比IOU,若大于预设的阈值则剔除;

3、对剩余的检测框重复操作(2),直到处理完图像内所有的候选框,即可得到最后的框序列信息;

这个模块是给模型搭载 NMS 功能,直接调用的./utils/general.py文件的non_max_suppression()函数。

class NMS(nn.Module):

"""在yolo.py中Model类的nms函数中使用

NMS非极大值抑制 Non-Maximum Suppression (NMS) module

给模型model封装nms 增加模型的扩展功能 但是我们一般不用 一般是在前向推理结束后再调用non_max_suppression函数

"""

conf = 0.25 # 置信度阈值 confidence threshold

iou = 0.45 # iou阈值 IoU threshold

classes = None # 是否nms后只保留特定的类别 (optional list) filter by class

max_det = 1000 # 每张图片的最大目标个数 maximum number of detections per image

def __init__(self):

super(NMS, self).__init__()

def forward(self, x):

"""

:params x[0]: [batch, num_anchors(3个yolo预测层), (x+y+w+h+1+num_classes)]

直接调用的是general.py中的non_max_suppression函数给model扩展nms功能

"""

return non_max_suppression(x[0], self.conf, iou_thres=self.iou, classes=self.classes, max_det=self.max_det)

2.2、AutoShape

这个模块是一个模型扩展模块,给模型封装成包含前处理、推理、后处理的模块(预处理 + 推理 + nms),用的不多。autoshape模块在train中不会被调用,当模型训练结束后,会通过这个模块对图片进行重塑,来方便模型的预测。

该模块自动调整shape,由于我们输入的图像可能不一样,可能来自cv2/np/PIL/torch 对输入进行预处理,因此通过调用此模块调整其shape。以下为代码解析部分。

AutoShape模块代码:

class AutoShape(nn.Module):

# YOLOv5 input-robust model wrapper for passing cv2/np/PIL/torch inputs. Includes preprocessing, inference and NMS

# YOLOv5模型包装器,用于传递 cv2/np/PIL/torch 输入,

# 包括预处理(preprocessing), 推理(inference) and NMS

conf = 0.25 # NMS confidence threshold

iou = 0.45 # NMS IoU threshold

agnostic = False # NMS class-agnostic

multi_label = False # NMS multiple labels per box

classes = None # (optional list) filter by class, i.e. = [0, 15, 16] for COCO persons, cats and dogs

max_det = 1000 # maximum number of detections per image

amp = False # Automatic Mixed Precision (AMP) inference

def __init__(self, model, verbose=True):

super().__init__()

if verbose:

LOGGER.info('Adding AutoShape... ')

copy_attr(self, model, include=('yaml', 'nc', 'hyp', 'names', 'stride', 'abc'), exclude=()) # copy attributes

self.dmb = isinstance(model, DetectMultiBackend) # DetectMultiBackend() instance

self.pt = not self.dmb or model.pt # PyTorch model

# 开启验证模式

self.model = model.eval()

if self.pt:

m = self.model.model.model[-1] if self.dmb else self.model.model[-1] # Detect()

m.inplace = False # Detect.inplace=False for safe multithread inference

m.export = True # do not output loss values

def _apply(self, fn):

# Apply to(), cpu(), cuda(), half() to model tensors that are not parameters or registered buffers

self = super()._apply(fn)

if self.pt:

m = self.model.model.model[-1] if self.dmb else self.model.model[-1] # Detect()

m.stride = fn(m.stride)

m.grid = list(map(fn, m.grid))

if isinstance(m.anchor_grid, list):

m.anchor_grid = list(map(fn, m.anchor_grid))

return self

@smart_inference_mode()

def forward(self, ims, size=640, augment=False, profile=False):

# Inference from various sources. For size(height=640, width=1280), RGB images example inputs are:

# file: ims = 'data/images/zidane.jpg' # str or PosixPath

# URI: = 'https://ultralytics.com/images/zidane.jpg'

# OpenCV: = cv2.imread('image.jpg')[:,:,::-1] # HWC BGR to RGB x(640,1280,3)

# PIL: = Image.open('image.jpg') or ImageGrab.grab() # HWC x(640,1280,3)

# numpy: = np.zeros((640,1280,3)) # HWC

# torch: = torch.zeros(16,3,320,640) # BCHW (scaled to size=640, 0-1 values)

# multiple: = [Image.open('image1.jpg'), Image.open('image2.jpg'), ...] # list of images

'''

这里的imgs针对不同的方法读入,官方也给了具体的方法,size是图片的尺寸

'''

dt = (Profile(), Profile(), Profile())

with dt[0]:

if isinstance(size, int): # expand

size = (size, size)

p = next(self.model.parameters()) if self.pt else torch.empty(1, device=self.model.device) # param

autocast = self.amp and (p.device.type != 'cpu') # Automatic Mixed Precision (AMP) inference

# 把图片转化成模型输入的形式

# 图片如果是tensor格式 说明是预处理过的,

# 直接正常进行前向推理即可 nms在推理结束进行(函数外写)

if isinstance(ims, torch.Tensor): # torch

with amp.autocast(autocast):

return self.model(ims.to(p.device).type_as(p), augment=augment) # inference

# Pre-process

# 输入的可能不是一张图片,因为你输入的形式应该是[batch_size,image style],这里获取到输入的n张图片,

# 然后每张图片存储在列表imgs里面

n, ims = (len(ims), list(ims)) if isinstance(ims, (list, tuple)) else (1, [ims]) # number, list of images

shape0, shape1, files = [], [], [] # image and inference shapes, filenames

# 遍历图片

for i, im in enumerate(ims):

f = f'image{i}' # filename

# 这个if条件基本上不会满足,他是针对一些特殊需求的,输入的是uri

# 这其实也是有效的,比如训练了一个黄图监测网络,然后通过爬虫从地址池里爬取img的uri,储存起来

if isinstance(im, (str, Path)): # filename or uri

im, f = Image.open(requests.get(im, stream=True).raw if str(im).startswith('http') else im), im

im = np.asarray(exif_transpose(im))

elif isinstance(im, Image.Image): # PIL Image

im, f = np.asarray(exif_transpose(im)), getattr(im, 'filename', f) or f

# 存放图像的名字

files.append(Path(f).with_suffix('.jpg').name)

'''

下面的操作主要是以下功用:

首先将图片原来的[H,W,C]的shape转换成[C,H,W]

然后将图像统一为3通道图像,灰度图则转化为RGB图

提取图像的[H,W]保存到shape0列表里面

用输入图像的size(上面默认的640)/max[H,W],就可以得到缩放比例g

再将原始的[H,W]x缩放比例g得到模型输入的shape保存到shape1列表里面

然后更新imgs

'''

if im.shape[0] < 5: # image in CHW

im = im.transpose((1, 2, 0)) # reverse dataloader .transpose(2, 0, 1)

im = im[..., :3] if im.ndim == 3 else cv2.cvtColor(im, cv2.COLOR_GRAY2BGR) # enforce 3ch input

s = im.shape[:2] # HWC

shape0.append(s) # image shape

g = max(size) / max(s) # gain

shape1.append([int(y * g) for y in s])

ims[i] = im if im.data.contiguous else np.ascontiguousarray(im) # update

shape1 = [make_divisible(x, self.stride) for x in np.array(shape1).max(0)] # inf shape

x = [letterbox(im, shape1, auto=False)[0] for im in ims] # pad

x = np.ascontiguousarray(np.array(x).transpose((0, 3, 1, 2))) # stack and BHWC to BCHW

x = torch.from_numpy(x).to(p.device).type_as(p) / 255 # uint8 to fp16/32

with amp.autocast(autocast):

# Inference

with dt[1]:

y = self.model(x, augment=augment) # forward

# Post-process

with dt[2]:

# 然后对y进行nms处理,就得等到了最终的preds [batch_size, n, 4]和scores [batch_size,n,1]了

y = non_max_suppression(y if self.dmb else y[0],

self.conf,

self.iou,

self.classes,

self.agnostic,

self.multi_label,

max_det=self.max_det) # NMS

for i in range(n):

scale_boxes(shape1, y[i][:, :4], shape0[i])

# 把处理好的内容给到betection类中做最后处理

return Detections(ims, y, files, dt, self.names, x.shape)

2.3、Detections

该模块是一个专门针对目标检测的封装类

class Detections:

# YOLOv5 detections class for inference results

# YOLOv5推理结果检测类

def __init__(self, ims, pred, files, times=(0, 0, 0), names=None, shape=None):

super().__init__()

d = pred[0].device # device

gn = [torch.tensor([*(im.shape[i] for i in [1, 0, 1, 0]), 1, 1], device=d) for im in ims] # normalizations

self.ims = ims # list of images as numpy arrays

self.pred = pred # list of tensors pred[0] = (xyxy, conf, cls)

self.names = names # class names

self.files = files # image filenames

self.times = times # profiling times

self.xyxy = pred # xyxy pixels

self.xywh = [xyxy2xywh(x) for x in pred] # xywh pixels

self.xyxyn = [x / g for x, g in zip(self.xyxy, gn)] # xyxy normalized

self.xywhn = [x / g for x, g in zip(self.xywh, gn)] # xywh normalized

self.n = len(self.pred) # number of images (batch size)

self.t = tuple(x.t / self.n * 1E3 for x in times) # timestamps (ms)

self.s = tuple(shape) # inference BCHW shape

def _run(self, pprint=False, show=False, save=False, crop=False, render=False, labels=True, save_dir=Path('')):

s, crops = '', []

for i, (im, pred) in enumerate(zip(self.ims, self.pred)):

s += f'\nimage {i + 1}/{len(self.pred)}: {im.shape[0]}x{im.shape[1]} ' # string

if pred.shape[0]:

for c in pred[:, -1].unique():

n = (pred[:, -1] == c).sum() # detections per class

s += f"{n} {self.names[int(c)]}{'s' * (n > 1)}, " # add to string

s = s.rstrip(', ')

if show or save or render or crop:

annotator = Annotator(im, example=str(self.names))

for *box, conf, cls in reversed(pred): # xyxy, confidence, class

label = f'{self.names[int(cls)]} {conf:.2f}'

if crop:

file = save_dir / 'crops' / self.names[int(cls)] / self.files[i] if save else None

crops.append({

'box': box,

'conf': conf,

'cls': cls,

'label': label,

'im': save_one_box(box, im, file=file, save=save)})

else: # all others

annotator.box_label(box, label if labels else '', color=colors(cls))

im = annotator.im

else:

s += '(no detections)'

im = Image.fromarray(im.astype(np.uint8)) if isinstance(im, np.ndarray) else im # from np

if show:

display(im) if is_notebook() else im.show(self.files[i])

if save:

f = self.files[i]

im.save(save_dir / f) # save

if i == self.n - 1:

LOGGER.info(f"Saved {self.n} image{'s' * (self.n > 1)} to {colorstr('bold', save_dir)}")

if render:

self.ims[i] = np.asarray(im)

if pprint:

s = s.lstrip('\n')

return f'{s}\nSpeed: %.1fms pre-process, %.1fms inference, %.1fms NMS per image at shape {self.s}' % self.t

if crop:

if save:

LOGGER.info(f'Saved results to {save_dir}\n')

return crops

@TryExcept('Showing images is not supported in this environment')

def show(self, labels=True):

self._run(show=True, labels=labels) # show results

def save(self, labels=True, save_dir='runs/detect/exp', exist_ok=False):

save_dir = increment_path(save_dir, exist_ok, mkdir=True) # increment save_dir

self._run(save=True, labels=labels, save_dir=save_dir) # save results

def crop(self, save=True, save_dir='runs/detect/exp', exist_ok=False):

save_dir = increment_path(save_dir, exist_ok, mkdir=True) if save else None

return self._run(crop=True, save=save, save_dir=save_dir) # crop results

def render(self, labels=True):

self._run(render=True, labels=labels) # render results

return self.ims

def pandas(self):

# return detections as pandas DataFrames, i.e. print(results.pandas().xyxy[0])

new = copy(self) # return copy

ca = 'xmin', 'ymin', 'xmax', 'ymax', 'confidence', 'class', 'name' # xyxy columns

cb = 'xcenter', 'ycenter', 'width', 'height', 'confidence', 'class', 'name' # xywh columns

for k, c in zip(['xyxy', 'xyxyn', 'xywh', 'xywhn'], [ca, ca, cb, cb]):

a = [[x[:5] + [int(x[5]), self.names[int(x[5])]] for x in x.tolist()] for x in getattr(self, k)] # update

setattr(new, k, [pd.DataFrame(x, columns=c) for x in a])

return new

def tolist(self):

# return a list of Detections objects, i.e. 'for result in results.tolist():'

r = range(self.n) # iterable

x = [Detections([self.ims[i]], [self.pred[i]], [self.files[i]], self.times, self.names, self.s) for i in r]

# for d in x:

# for k in ['ims', 'pred', 'xyxy', 'xyxyn', 'xywh', 'xywhn']:

# setattr(d, k, getattr(d, k)[0]) # pop out of list

return x

def print(self):

LOGGER.info(self.__str__())

def __len__(self): # override len(results)

return self.n

def __str__(self): # override print(results)

return self._run(pprint=True) # print results

def __repr__(self):

return f'YOLOv5 {self.__class__} instance\n' + self.__str__()

2.4、Classify

这是一个二级分类模块,什么是二级分类模块?比如做车牌的识别,先识别出车牌 ,如果想对车牌上的字进行识别,就需要二级分类进一步检测。如果对模型输出的分类需要进行二次分类,就可以用这个模块。这个类写的比较简单,若进行复杂的二级分类,可以根据需要进行改写。

Classify模块代码:

class Classify(nn.Module):

# YOLOv5 classification head, i.e. x(b,c1,20,20) to x(b,c2)

def __init__(self, c1, c2, k=1, s=1, p=None, g=1): # ch_in, ch_out, kernel, stride, padding, groups

"""

这是一个二级分类模块, 什么是二级分类模块? 比如做车牌的识别, 先识别出车牌, 如果想对车牌上的字进行识别, 就需要二级分类进一步检测.

如果对模型输出的分类再进行分类, 就可以用这个模块. 不过这里这个类写的比较简单, 若进行复杂的二级分类, 可以根据自己的实际任务可以改写, 这里代码不唯一.

"""

super().__init__()

c_ = 1280 # efficientnet_b0 size

self.conv = Conv(c1, c_, k, s, autopad(k, p), g)

self.pool = nn.AdaptiveAvgPool2d(1) # to x(b,c_,1,1)

self.drop = nn.Dropout(p=0.0, inplace=True)

self.linear = nn.Linear(c_, c2) # to x(b,c2)

def forward(self, x):

if isinstance(x, list):

x = torch.cat(x, 1)

return self.linear(self.drop(self.pool(self.conv(x)).flatten(1)))

3、修改模型

将c3模块修改成以下结构

class C3(nn.Module):

# CSP Bottleneck with 3 convolutions

"""

:params c1: 整个C3的输入channel

:params c2: 整个C3的输出channel

:params n: 有n个子模块[Bottleneck/CrossConv]

:params shortcut: bool值,子模块[Bottlenec/CrossConv]中是否有shortcut,默认True

:params g: 子模块[Bottlenec/CrossConv]中的3x3卷积类型,=1普通卷积,>1深度可分离卷积

:params e: expansion ratio,e*c2=中间其它所有层的卷积核个数=中间所有层的的输入输出channel

"""

def __init__(self, c1, c2, n=1, shortcut=True, g=1, e=0.5): # ch_in, ch_out, number, shortcut, groups, expansion

super().__init__()

c_ = int(c2 * e) # hidden channels

self.cv1 = Conv(c1, c_, 1, 1)

self.cv2 = Conv(c1, c_, 1, 1)

# self.cv3 = Conv(2 * c_, c2, 1) # optional act=FReLU(c2)

self.m = nn.Sequential(*(Bottleneck(c_, c_, shortcut, g, e=1.0) for _ in range(n)))

# 实验性CrossConv

# self.m = nn.Sequential(*[CrossConv(c_, c_, 3, 1, g, 1.0, shortcut) for _ in range(n)])

def forward(self, x):

# 移除C3的结构,若要保持最终输出的channel仍为c2,则中间层的channel需为c2/2

# 设置e=0.5即可,取默认值不变

# return self.cv3(torch.cat((self.m(self.cv1(x)), self.cv2(x)), 1))

return torch.cat((self.m(self.cv1(x)), self.cv2(x)), 1)

4、运行&打印模型查看

cmd:

python train.py --img 900 --batch 2 --epoch 1 --data data/ab.yaml --cfg models/yolov5s.yaml --weights weights/yolov5s.pt --device '0'

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?