实现bagging及随机森林(回归)

本文我们依然使用波士顿房价数据作为案例,进行分析。

数据预处理

# 从 sklearn.datasets 导入波士顿房价数据读取器。

from sklearn.datasets import load_boston

# 从读取房价数据存储在变量 boston 中。

boston = load_boston()

# 从sklearn.cross_validation 导入数据分割器。

from sklearn.model_selection import train_test_split

X = boston.data

y = boston.target

# 随机采样 25% 的数据构建测试样本,其余作为训练样本。

X_train, X_test, y_train, y_test = train_test_split(X,

y,

random_state=33,

test_size=0.25)

# 从 sklearn.preprocessing 导入数据标准化模块。

from sklearn.preprocessing import StandardScaler

# 分别初始化对特征和目标值的标准化器。

ss_X = StandardScaler()

ss_y = StandardScaler()

# 分别对训练和测试数据的特征以及目标值进行标准化处理。

X_train = ss_X.fit_transform(X_train)

X_test = ss_X.transform(X_test)

y_train = ss_y.fit_transform(y_train.reshape(-1,1))

y_test = ss_y.transform(y_test.reshape(-1,1))

bagging 实现

from sklearn.ensemble import BaggingRegressor

bagr = BaggingRegressor()

bagr.fit(X_train, y_train)

bagr_y_predict = bagr.predict(X_test)

from sklearn.metrics import r2_score, mean_absolute_error, mean_squared_error

# 使用 R-squared、MSE 以及 MAE 指标对默认配置的随机回归森林在测试集上进行性能评估。

print('R-squared value of BaggingRegressor:', bagr.score(X_test, y_test))

print('The mean squared error of BaggingRegressor:', mean_squared_error(

ss_y.inverse_transform(y_test), ss_y.inverse_transform(bagr_y_predict)))

print('The mean absoluate error of BaggingRegressor:', mean_absolute_error(

ss_y.inverse_transform(y_test), ss_y.inverse_transform(bagr_y_predict)))

随机森林实现

from sklearn.ensemble import RandomForestRegressor

rfr = RandomForestRegressor()

rfr.fit(X_train, y_train)

rfr_y_predict = rfr.predict(X_test)

from sklearn.metrics import r2_score, mean_absolute_error, mean_squared_error

# 使用 R-squared、MSE 以及 MAE 指标对默认配置的随机回归森林在测试集上进行性能评估。

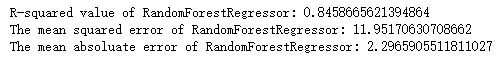

print('R-squared value of RandomForestRegressor:', rfr.score(X_test, y_test))

print('The mean squared error of RandomForestRegressor:', mean_squared_error(

ss_y.inverse_transform(y_test), ss_y.inverse_transform(rfr_y_predict)))

print('The mean absoluate error of RandomForestRegressor:', mean_absolute_error(

ss_y.inverse_transform(y_test), ss_y.inverse_transform(rfr_y_predict)))

我们可以看出,随机森林 R 2 R^2 R2要高于bagging,在MAE和MSE,方面随机森林要小于bagging,因此我们验证了一般情况下相较于bagging模型,随机森林的优越性。

**注意:**这里的bagging模型的基模型为决策树。

参考

[1] 李航. 统计学习方法[M]. 清华大学出版社, 北京, 2012.

[2] 周志华. 机器学习[M]. 清华大学出版社, 北京, 2016.

[3] 范淼,李超.Python 机器学习及实践[M].清华大学出版社, 北京, 2016.

1051

1051

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?