DeepSeek官网运行经常出现下述问题

于是想在本地部署一下,下面是操作流程,自己做个备份。

1. 首先下载软件

通过网盘分享的文件:大模型环境

链接: https://pan.baidu.com/s/1-5zAtse5A93-1Agfy2Vu_w 提取码: yu6a

2. 安装ollama

点击OllamaSetup.exe进行安装,默认情况下直接装到了C盘,算了,就不更改了。

3. 安装DeepSeek

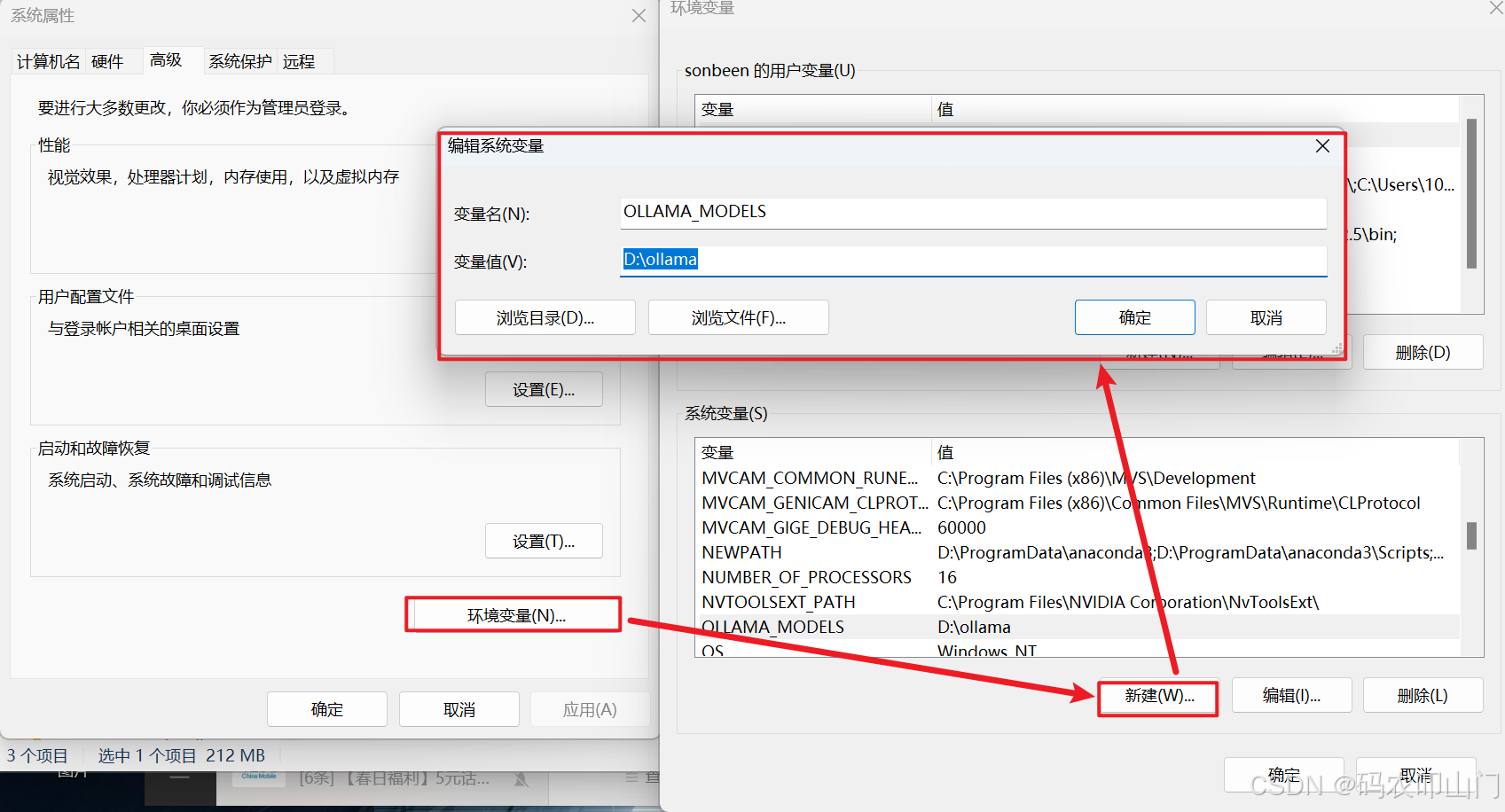

下面要下载模型,为了防止模型占用C盘空间,于是选择装在D盘,按照下面的方式进行修改。

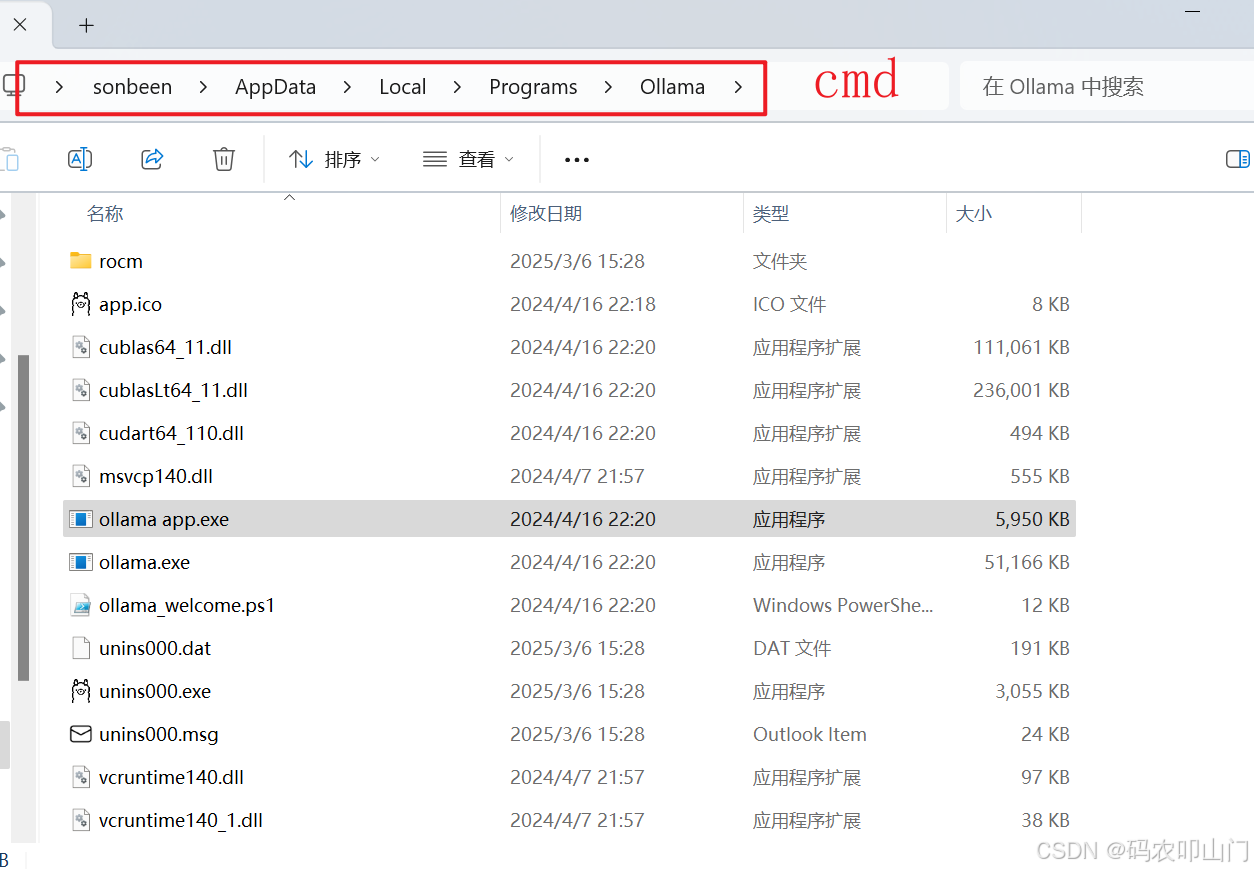

默认安装位置是:C:\Users\用户名\AppData\Local\Programs\Ollama,我们先进到这个位置,

将方框内的内容替换成“cmd”,

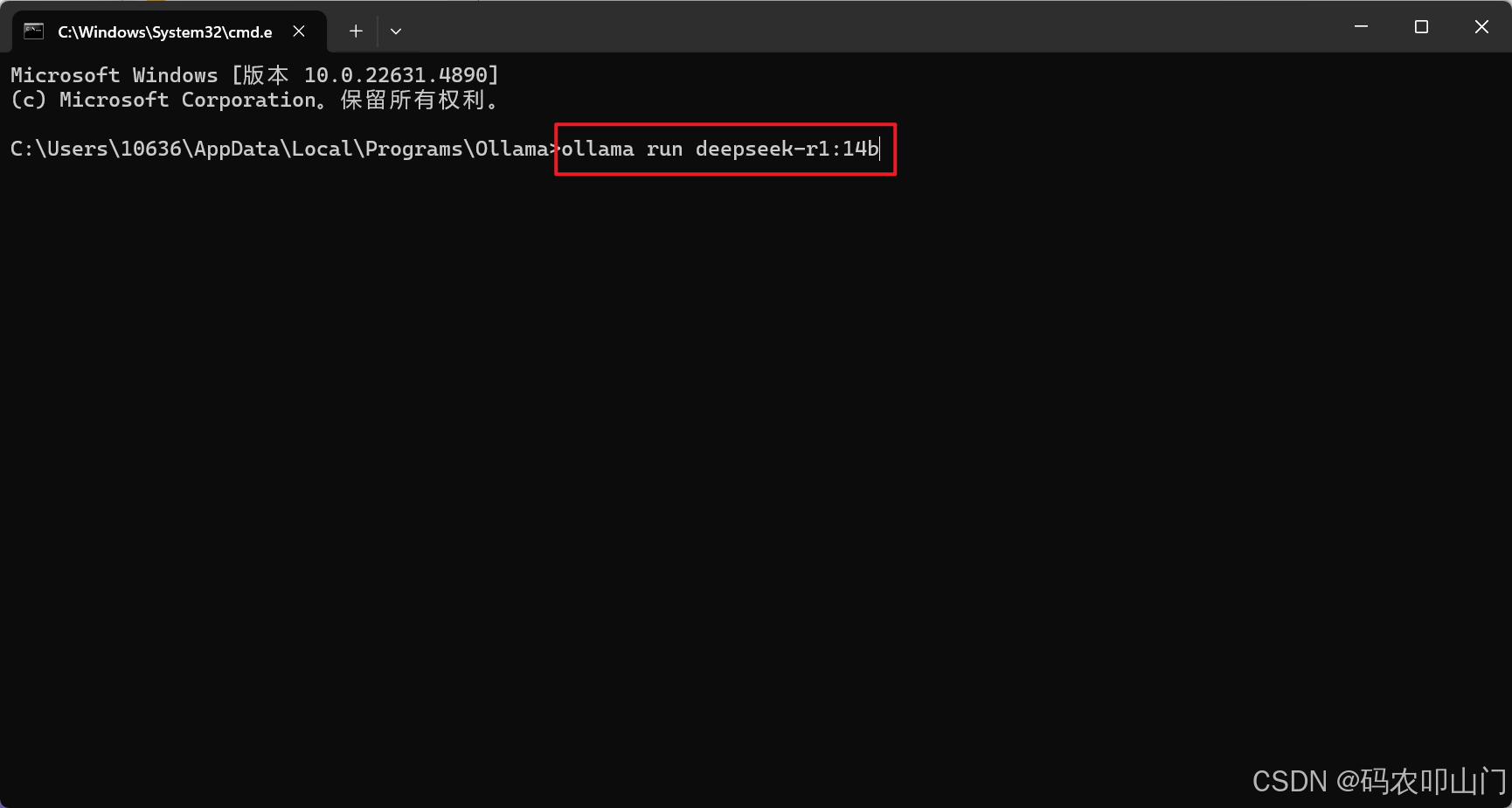

在出现的窗口中输入ollama run deepseek-r1:14b

根据空间大小也可以选择合适的模型,具体的可以百度搜索。

如何删除模型?在命令行输入,ollama rm + 模型名称,例如:ollama rm deepseek-r1:1.5b,就会自动删除对应模型。

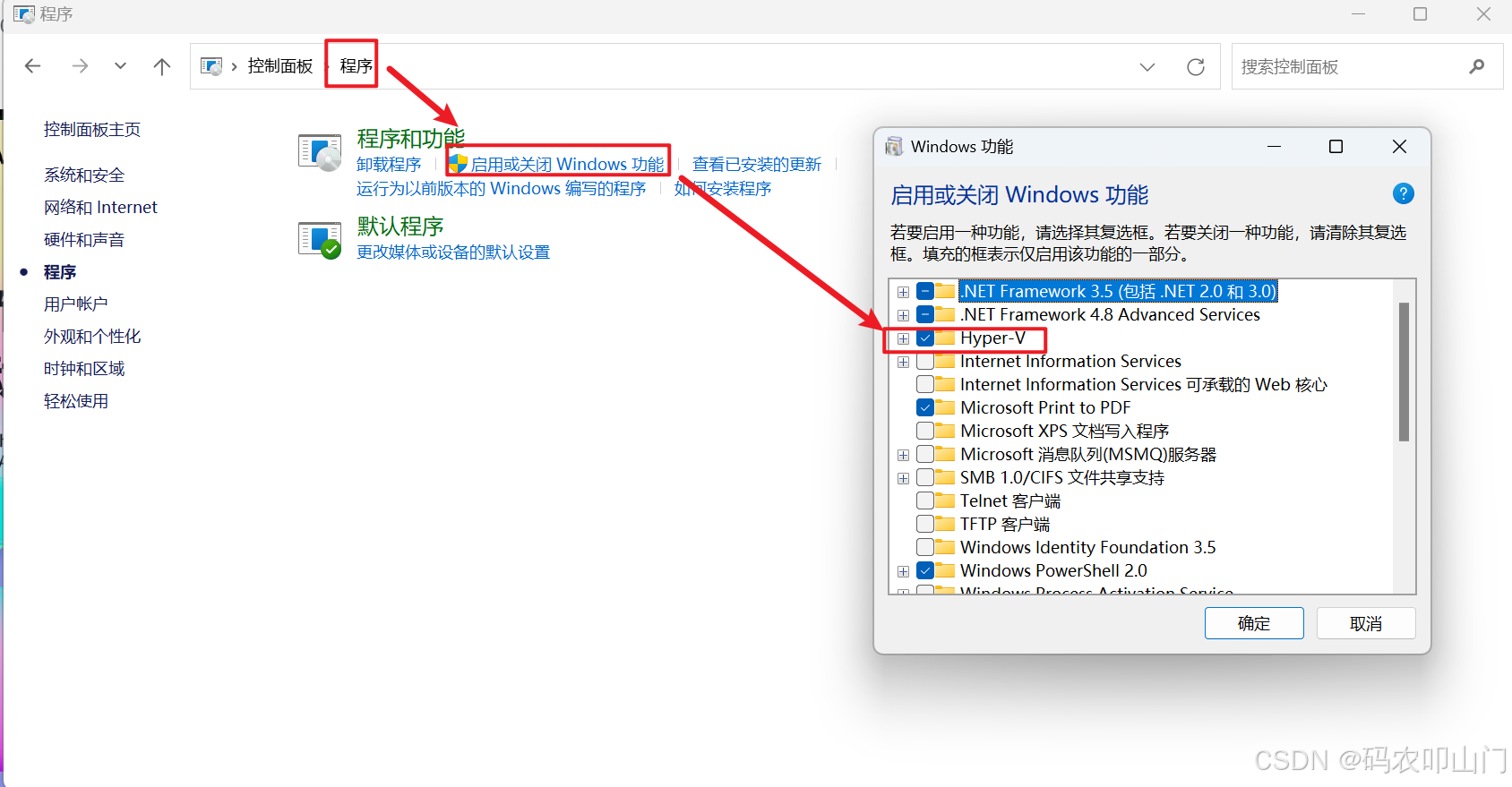

4. 安装HyperV

以管理员模式安装安装HyperV.bat,

在控制面板中可以发现此时已经安装好了

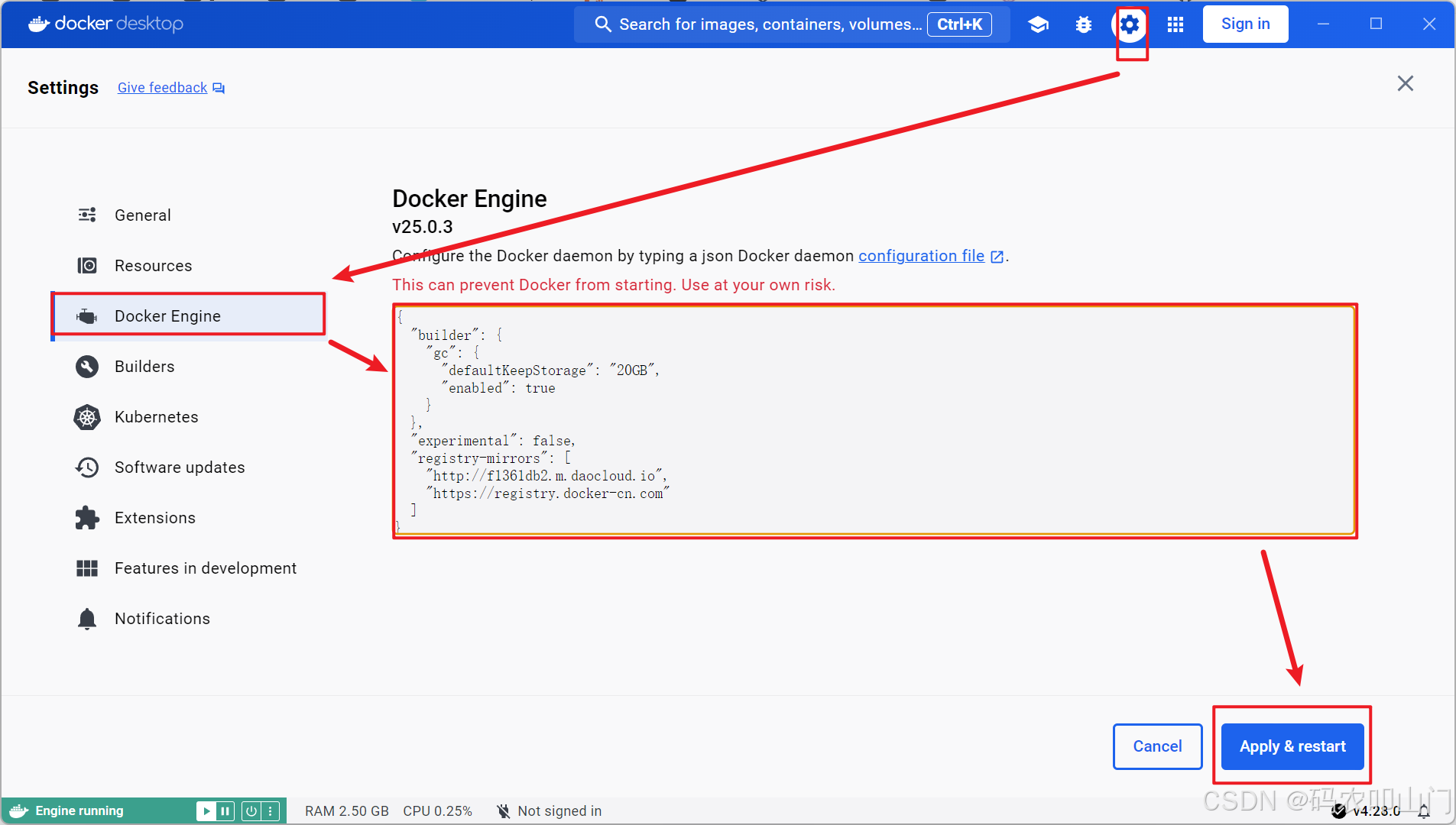

5 安装Docker

运行安装包

配置一下Docker访问中国镜像源

{

"builder": {

"gc": {

"defaultKeepStorage": "20GB",

"enabled": true

}

},

"experimental": false,

"registry-mirrors": [

"http://f1361db2.m.daocloud.io",

"https://registry.docker-cn.com"

]

}

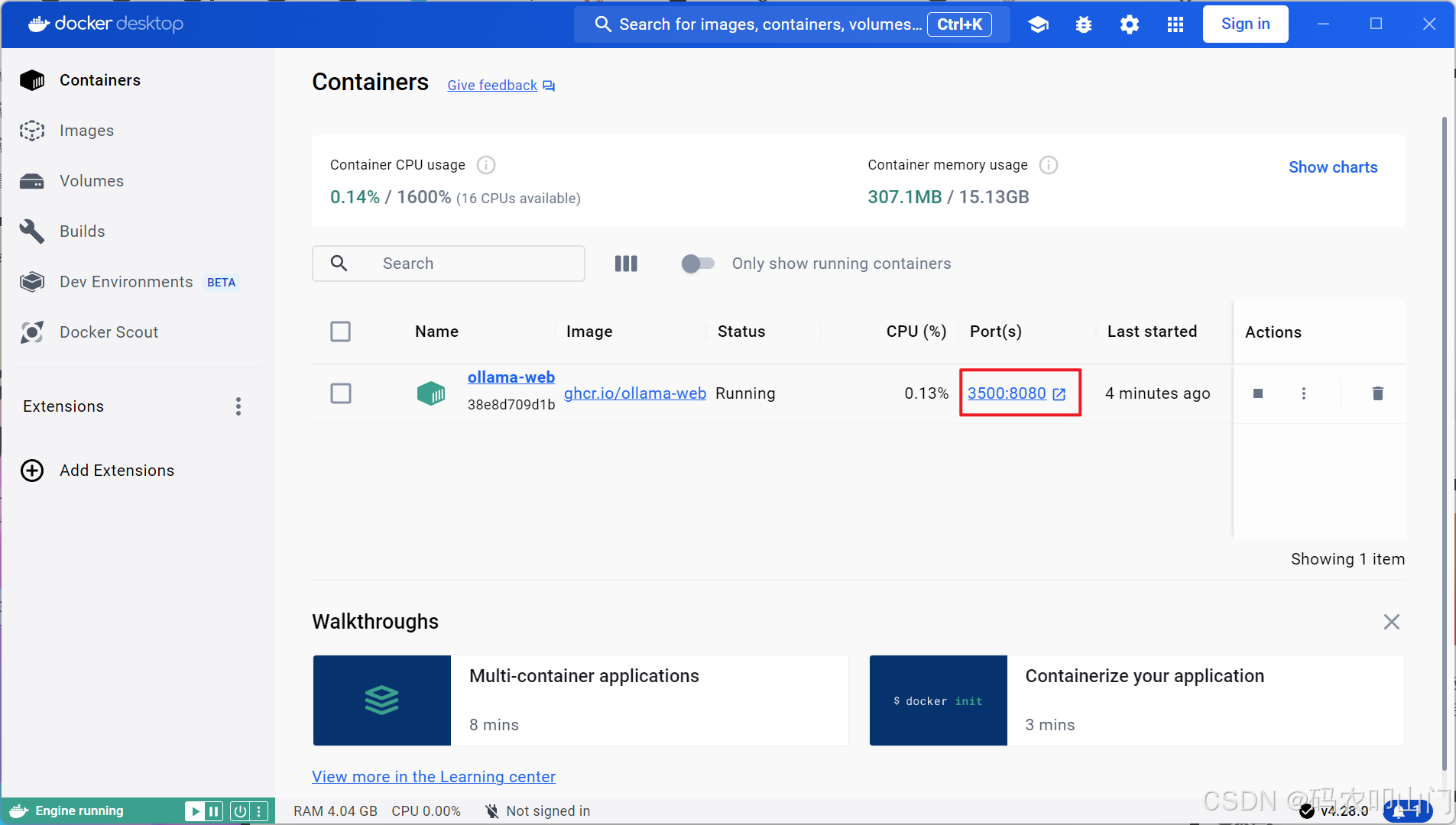

6. 安装聊天界面

在cmd中安装

docker run -d -p 3500:8080 --add-host=host.docker.internal:host-gateway --name ollama-webui --restart always ghcr.io/ollama-webui/ollama-webui:main

回到Docker界面看看是否已经在运行WebUI了,图标亮起就表示已经在运行了,点击后面的端口号就可以在浏览器中查看了。

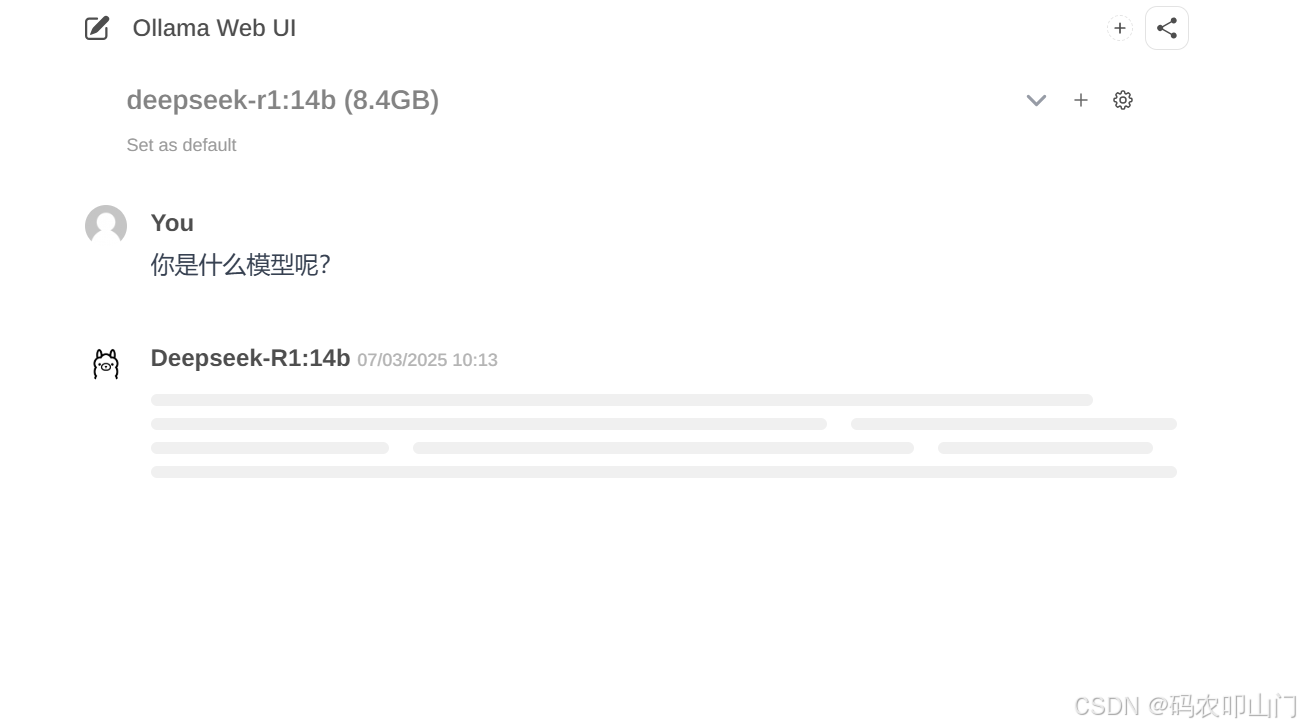

先注册,后登陆,然后选择模型,就可以开始聊天了。

但是一直卡在这里,有人知道原因吗?其实在第三步的时候就初见端倪

1689

1689

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?