最邻近规则分类(K-Nearest Neighbor)KNN算法

Cover和Hart在1968年提出了最初的邻近算法,它属于分类(classification)算法,输入基于实例的学习(instance-based learning), 懒惰学习(lazy learning)。

例子引入,对于电影类型的分类

将统一样本参数转换为坐标及类别

算法步骤

- 为了判断未知实例的类别,以所有已知类别的实例作为参照

- 选择参数K

- 计算未知实例与所有已知实例的距离

- 选择最近K个已知实例

- 根据少数服从多数的投票法则(majority-voting),让未知实例归类为K个最邻近样本中最多数的类别

怎么判断:

实验测试,那个K精确度最高选择K(一般为1、3、5、7)

计算未知实例(x1,y1)与所有实例(x,y)之间的距离,选择最佳距离,比如K=3,选择3个最近的距离;它们属于哪一类,根据少数服从多数的原则,未知实例类别与3个中多数的类别为同一类;

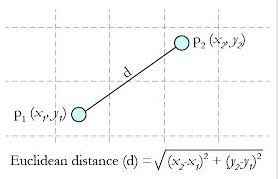

关于距离的衡量

使用类似几何中求距离的方法,其他距离衡量:余弦值(cos), 相关度 (correlation), 曼哈顿距离 (Manhattan distance)

举例

对于K选择不同,得到的结果不同,所以对K选择很敏感

算法优缺点

优点是简单、易于理解、容易实现、通过对K的选择可具备丢噪音数据的健壮性

缺点是需要大量空间存储所有已知实例,算法复杂度高(需要比较所有已知实例与要分类的实例)

当其样本分布不平衡时,比如其中一类样本过大(实例数量过多)占主导的时候,新的未知实例容易被归类为这个主导样本,因为这类样本实例数量过大,但这个新的未知实例实际并接近目标样本?

K(目标点比较距离点的数目)一般选择奇数(在结果使用少数服从多数);

改进版本

考虑距离,根据距离加上权重值,比如1/d(d:距离)

代码实现

#!/usr/bin/python

# coding:utf-8

"""

Time:20181022

KNNImplementation.py

算法步骤:

step.1---初始化距离为最大值

step.2---计算未知样本和每个训练样本的距离dist

step.3---得到目前K个最临近样本中的最大距离maxdist

step.4---如果dist小于maxdist,则将该训练样本作为K-最近邻样本

step.5---重复步骤2、3、4,直到未知样本和所有训练样本的距离都算完

step.6---统计K-最近邻样本中每个类标号出现的次数

step.7---选择出现频率最大的类标号作为未知样本的类标号

---------------------

原文:https://blog.csdn.net/xlm289348/article/details/8876353

版权声明:本文为博主原创文章,转载请附上博文链接!

最邻近规则分类(K-Nearest Neighbor)KNN

实例:电影类型的判断,特征:打斗、接吻

虹膜--花预测

萼片长度,萼片宽度,花瓣长度,花瓣宽度

loadDataset :加载数据集,并将数据集分为训练集和测试集

euclideanDistance:计算实例之间的最小最邻近距离

getNeighbors:训练集与测试机之间的最邻近距离

getResponse:最邻近距离降序并找出最大的最邻近距离

getAccuracy:计算训练模型的准确率

"""

import csv

import random

import math

import operator

def loadDataset(filename, split, trainingSet = [], testSet = []):

# with open(filename, 'rb') as csvfile:

with open(filename, 'rt') as csvfile:

lines = csv.reader(csvfile)

dataset = list(lines)

for x in range(len(dataset)-1):

for y in range(4):

dataset[x][y] = float(dataset[x][y])

if random.random() < split:

trainingSet.append(dataset[x])

else:

testSet.append(dataset[x])

print(testSet)

def euclideanDistance(instance1, instance2, length):

distance = 0

for x in range(length):

distance += pow((instance1[x]-instance2[x]), 2)

return math.sqrt(distance)

def getNeighbors(trainingSet, testInstance, k):

distances = []

length = len(testInstance)-1

print("len(trainingSet)", len(trainingSet))

print("trainingSet", testInstance)

# print("trainingSet", trainingSet)

for x in range(len(trainingSet)):

#testinstance

dist = euclideanDistance(testInstance, trainingSet[x], length)

distances.append((trainingSet[x], dist))

#distances.append(dist)

distances.sort(key=operator.itemgetter(1))

neighbors = []

for x in range(k):

neighbors.append(distances[x][0])

return neighbors

def getResponse(neighbors):

classVotes = {}

print("len(neighbors)", len(neighbors))

for x in range(len(neighbors)):

response = neighbors[x][-1]

print("response", neighbors[x][0])

if response in classVotes:

classVotes[response] += 1

else:

classVotes[response] = 1

# sortedVotes = sorted(classVotes.iteritems(), key=operator.itemgetter(1), reverse=True)

sortedVotes = sorted(classVotes.items(), key=operator.itemgetter(1), reverse=True)

return sortedVotes[0][0]

def getAccuracy(testSet, predictions):

correct = 0

print("len(testSet)", len(testSet))

for x in range(len(testSet)):

if testSet[x][-1] == predictions[x]:

# if testSet[x-1] == predictions[x]:

correct += 1

return (correct/float(len(testSet)))*100.0

def main():

#prepare data

trainingSet = []

testSet = []

split = 0.67

loadDataset(r'G:/Python/testproject1/venv1/MachineLearning/irisdata.txt', split, trainingSet, testSet)

print('Train set: ' + repr(len(trainingSet)))

print('Test set: ' + repr(len(testSet)))

print("testSet", testSet)

print("testSet[0][4]", testSet[0][4])

# python提供一种特殊操作 -1 返回最后一个数或者字符

print("testSet[0][-1]", testSet[0][-1])

print("testSet[0][4]", testSet[0][4])

#generate predictions

predictions = []

k = 3

for x in range(len(testSet)):

# trainingsettrainingSet[x]

print("x", x)

neighbors = getNeighbors(trainingSet, testSet[x], k)

result = getResponse(neighbors)

predictions.append(result)

print('>predicted=' + repr(result) + ', actual=' + repr(testSet[x][-1]))

accuracy = getAccuracy(testSet, predictions)

print('Accuracy: ' + repr(accuracy) + '%')

if __name__ == '__main__':

main()

参考:麦子学院机器学习讲义

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?