Spark每提交一次任务就会启动一个web服务,可以在网页中查看任务执行的DAG图,执行花费时间…,随着任务结束而关闭。对于历史任务查看需要另外启动Spark History服务。

(1) 修改spark-defaults.conf配置文件

该文件在SPARK_HOME/conf/下,新安装的spark中只有spark-defaults.conf.template这个文件,改名为spark-defaults.conf即可

[root@repo conf]# vim spark-defaults.conf

spark.eventLog.enabled true

spark.eventLog.dir hdfs://hadoop000:8020/spark/historyLog

spark.eventLog.enabled true 开启historylog功能

spark.eventLog.dir hdfs://hadoop000:8020/spark/historyLog 指定日志存放的路径

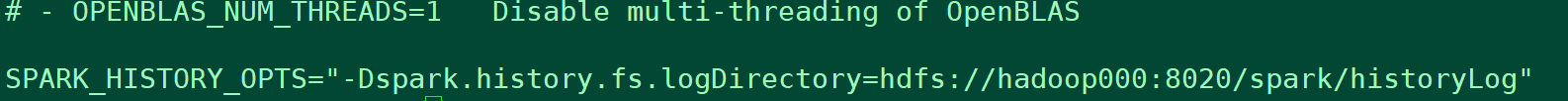

(2) 修改spark-env.sh 配置文件

SPARK_HISTORY_OPTS="-Dspark.history.fs.logDirectory=hdfs://hadoop000:8020/spark/historyLog"

参数说明

(3) .启动日志服务

sh /home/hadoop/app/spark-2.4.3-bin-2.6.0-cdh5.15.1/sbin/start-history-server.sh

(4) .webUI

2171

2171

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?