1、tf.reduce_mean 函数用于计算张量tensor沿着指定的数轴(tensor的某一维度)上的的平均值,主要用作降维或者计算tensor(图像)的平均值。

reduce_mean(input_tensor,

axis=None,

keep_dims=False,

name=None,

reduction_indices=None)第一个参数input_tensor: 输入的待降维的tensor;

第二个参数axis: 指定的轴,如果不指定,则计算所有元素的均值;

第三个参数keep_dims:是否降维度,设置为True,输出的结果保持输入tensor的形状,设置为False,输出结果会降低维度;

第四个参数name: 操作的名称;

第五个参数 reduction_indices:在以前版本中用来指定轴,已弃用;

原文链接:https://blog.csdn.net/dcrmg/article/details/79797826

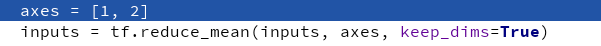

表示在inputs的1、2列做reduce操作。

表示在inputs的1、2列做reduce操作。

2、data_format有channels_first、 channels_last

keras默认为channels_last。

model.add(Convolution2D(

batch_input_shape=(None, 1, 28, 28), #多少数据 通道数 宽 高

filters=32, #滤波器数量

kernel_size=5, #滤波器大小5x5

strides=1, #步长1

padding='same', # Padding method

data_format='channels_first'

))3、批归一化 tf.layers.batch_normalization()

批归一化的作用:

(1)加速收敛

(2)控制过拟合,可以少用或不用Dropout和正则

(3)降低网络对初始化权重不敏感

(4)允许使用较大的学习率

暂时记录两个链接,有空认真研究:

这是理论:

https://blog.csdn.net/TeFuirnever/article/details/88845299

这是用法:

https://blog.csdn.net/tefuirnever/article/details/93457816

现在先做另外一个重要的事情:画出计算图,看看原来76%准确率的计算图和92%的计算图差别。

4、保存模型tf.train.Saver()

将训练好的模型参数保存起来,以便以后进行验证或测试,这是我们经常要做的事情。tf里面提供模型保存的是tf.train.Saver()模块。

模型保存,先要创建一个Saver对象:如

saver=tf.train.Saver()在创建这个Saver对象的时候,有一个参数我们经常会用到,就是 max_to_keep 参数,这个是用来设置保存模型的个数,默认为5,即 max_to_keep=5,保存最近的5个模型。如果你想每训练一代(epoch)就想保存一次模型,则可以将 max_to_keep设置为None或者0,如:

saver=tf.train.Saver(max_to_keep=0)但是这样做除了多占用硬盘,并没有实际多大的用处,因此不推荐。

当然,如果你只想保存最后一代的模型,则只需要将max_to_keep设置为1即可,即

saver=tf.train.Saver(max_to_keep=1)创建完saver对象后,就可以保存训练好的模型了,如:

saver.save(sess,'ckpt/mnist.ckpt',global_step=step)第一个参数sess,这个就不用说了。第二个参数设定保存的路径和名字,第三个参数将训练的次数作为后缀加入到模型名字中。

saver.save(sess, 'my-model', global_step=0) ==> filename: 'my-model-0'

...

saver.save(sess, 'my-model', global_step=1000) ==> filename: 'my-model-1000'看一个例子:

sess=tf.InteractiveSession()

sess.run(tf.global_variables_initializer())

saver=tf.train.Saver(max_to_keep=1)

for i in range(100):

batch_xs, batch_ys = mnist.train.next_batch(100)

sess.run(train_op, feed_dict={x: batch_xs, y_: batch_ys})

val_loss,val_acc=sess.run([loss,acc], feed_dict={x: mnist.test.images, y_: mnist.test.labels})

print('epoch:%d, val_loss:%f, val_acc:%f'%(i,val_loss,val_acc))

saver.save(sess,'ckpt/mnist.ckpt',global_step=i+1)

sess.close()5、restore()

769

769

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?