学习资料来源:零基础入门深度学习(2) - 线性单元和梯度下降

目录

一、线性单元的定义

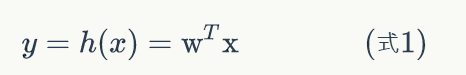

用一个可导的线性函数来替代感知器的阶跃函数,这种感知器叫做线性单元(可以用来解决回归问题)。设置线性单元的激活函数f为f(x)=x,,如下图所示:

二、线性单元的模型

模型:根据输入x预测输出y的算法

线性模型如下式,输出y是输入特征x1,x2,x3,...的线性组合。

其中,h(x)是假设,w0,w1,w2,w3,...是参数

三、监督学习和无监督学习

模型的训练:即参数w取什么值最合适。

监督学习:为了训练模型提供的训练样本,具有以下特征—即每个训练样本既包括输入特征x,也包括对应的输出y(y也叫做标记,label)。

无监督学习:为了训练模型提供的训练样本,具有以下特征—即每个训练样本中只有x没有y。

四、线性单元的目标函数

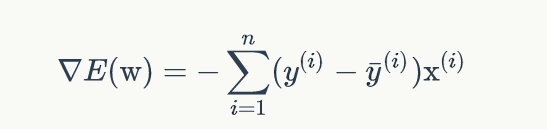

用实际值与预测值之间的误差作为线性单元的目标函数(希望误差越小越好),即

模型的训练,实际上就是求取到合适的w,使E(w)取得最小值,这实际上是一个优化问题。

五、梯度下降优化算法

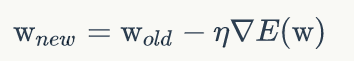

让x每次沿着梯度的反方向(函数值下降最快的方向)修改w值,即

其中,η是学习速率,▽E(w)是E(w)函数的梯度。

可见,每次更新w的迭代,要遍历训练数据中所有的样本进行计算,也称这种算法叫做批梯度下降(Batch Gradient Descent,BGD)。与之相对的是随机梯度下降算法(Stochastic Gradient Descent,SGD),每次更新w的迭代,只计算一个样本。

六、线性单元的实现

from perceptron import Perceptron

#定义激活函数f

f = lambda x: x

class LinearUnit(Perceptron):

def __init__(self, input_num):

'''初始化线性单元,设置输入参数的个数'''

Perceptron.__init__(self, input_num, f)

def get_training_dataset():

'''

捏造5个人的收入数据

'''

# 构建训练数据

# 输入向量列表,每一项是工作年限

input_vecs = [[5], [3], [8], [1.4], [10.1]]

# 期望的输出列表,月薪,注意要与输入一一对应

labels = [5500, 2300, 7600, 1800, 11400]

return input_vecs, labels

def train_linear_unit():

'''

使用数据训练线性单元

'''

# 创建感知器,输入参数的特征数为1(工作年限)

lu = LinearUnit(1)

# 训练,迭代10轮, 学习速率为0.01

input_vecs, labels = get_training_dataset()

lu.train(input_vecs, labels, 10, 0.01)

#返回训练好的线性单元

return lu

if __name__ == '__main__':

'''训练线性单元'''

linear_unit = train_linear_unit()

# 打印训练获得的权重

print linear_unit

# 测试

print 'Work 3.4 years, monthly salary = %.2f' % linear_unit.predict([3.4])

print 'Work 15 years, monthly salary = %.2f' % linear_unit.predict([15])

print 'Work 1.5 years, monthly salary = %.2f' % linear_unit.predict([1.5])

print 'Work 6.3 years, monthly salary = %.2f' % linear_unit.predict([6.3])

62

62

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?