GRU相比于LSTM运算量小了许多,其中LSTM是SimpleRNN四倍,GRU是三倍。GRU只有更新门和重置门,其中更新门类似将遗忘门和输入门使用这一个门统一调控,重置门会将上一次的记忆重置后投入“信息门”使用。

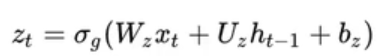

更新门

使用更新门用以调控以往数据遗忘的比例和当下数据的输入比例

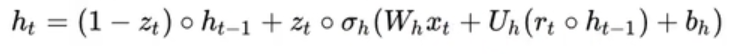

重置门

![]()

重置门用来重置上一次的记忆,然后再投入到信息门中形成当下的信息。

整合

其中类似LSTM中的遗忘门,

类似LSTM中的输入门,这两个门同一由更新门调控。

重置门用于重制上一次的记忆,与LSTM中的输出门并不类似,这里不必做强行类比。

1415

1415

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?