写在前面的话

「人工智能安全与隐私」系列论坛由深圳市大数据研究院、中国图象图形学学会主办,第九期由中山大学网络空间安全学院、中国图象图形学学会视觉大数据专委会承办,香港中文大学(深圳)数据科学学院,深圳市人工智能学会协办。

我在11月23日上午在b站上看了直播,感受颇深,没看的小伙伴可以去关注一下他们的b站号。今天进行汇报的老师是沈超老师。大牛级别的人物,大家看简介。这篇博客主要是会议纪要,就不参杂个人理解了。

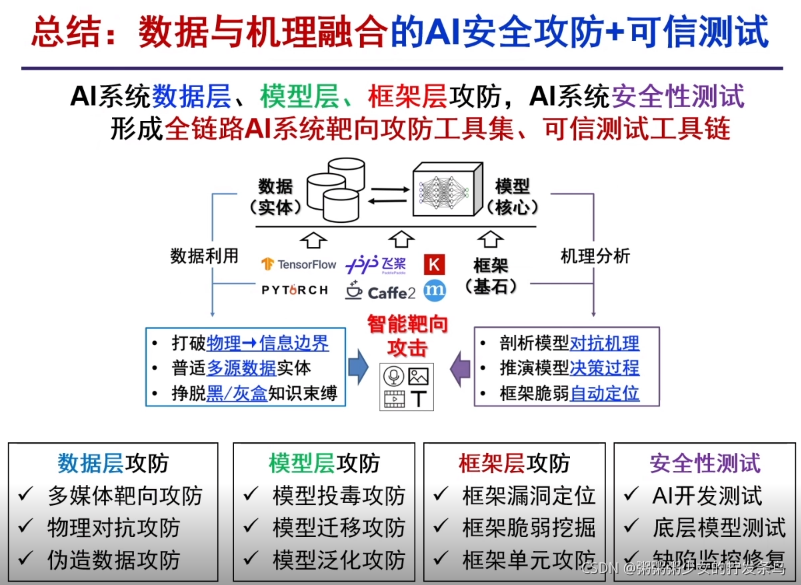

总结

我就简单谈一下自己的看法。

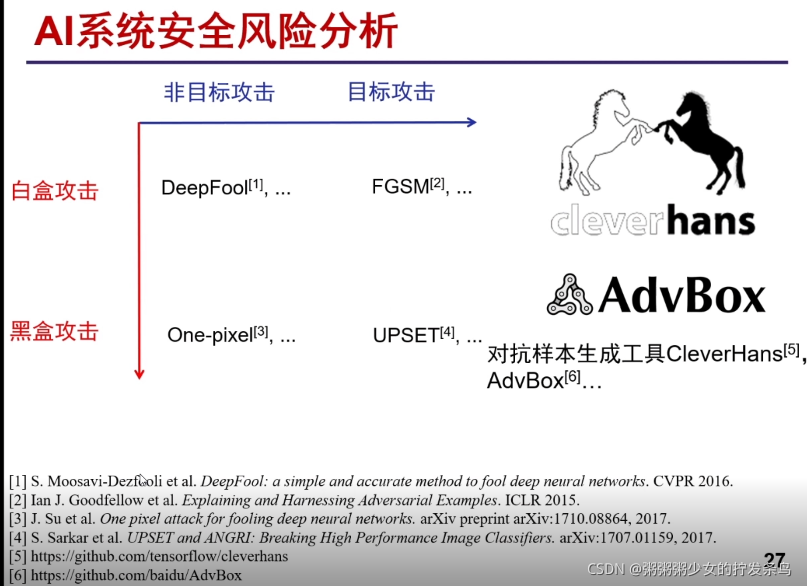

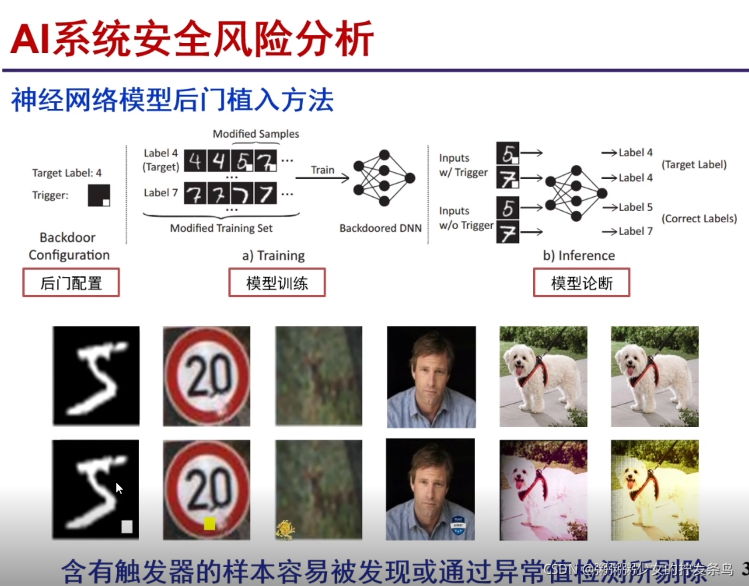

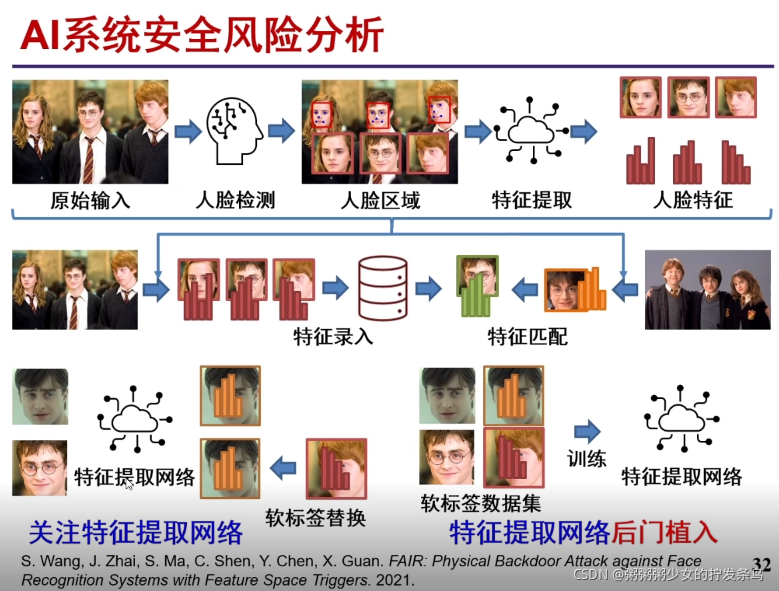

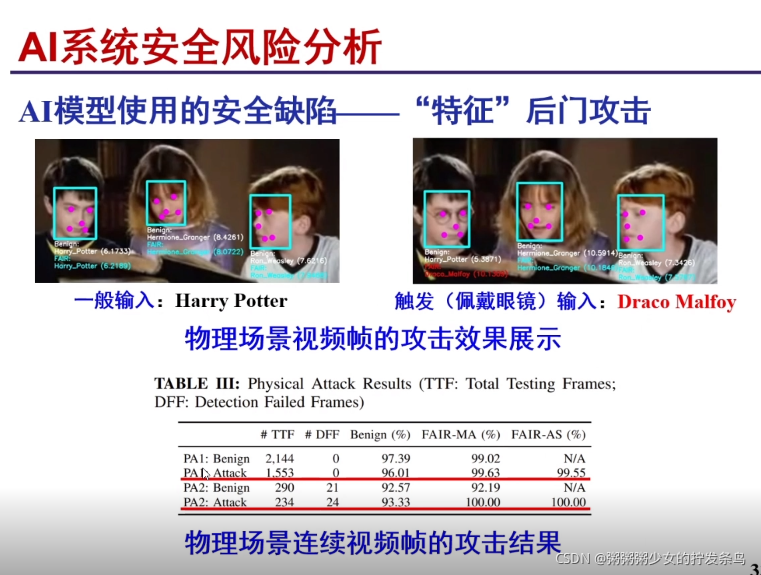

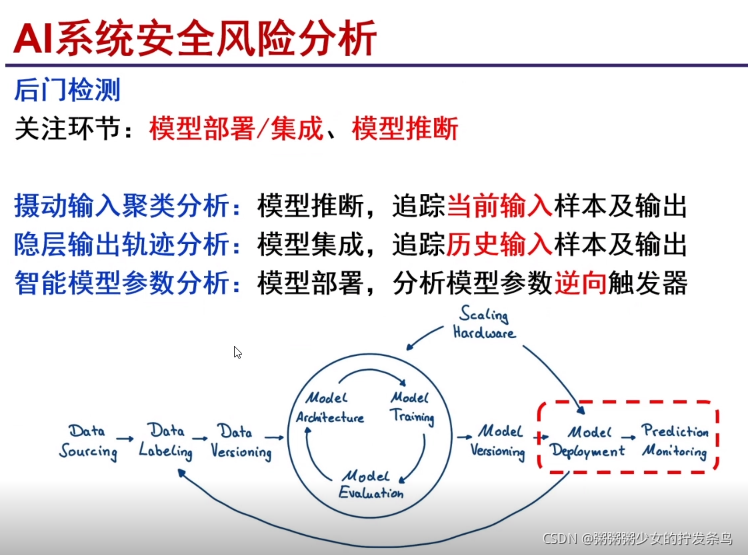

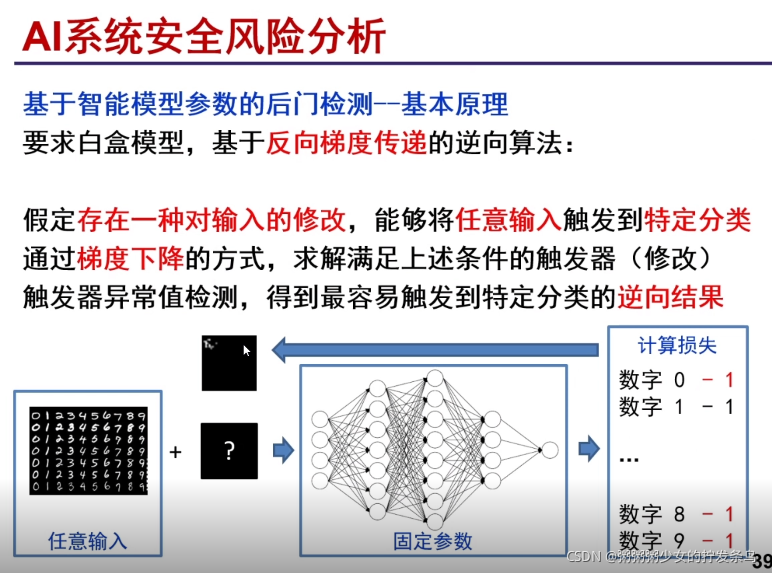

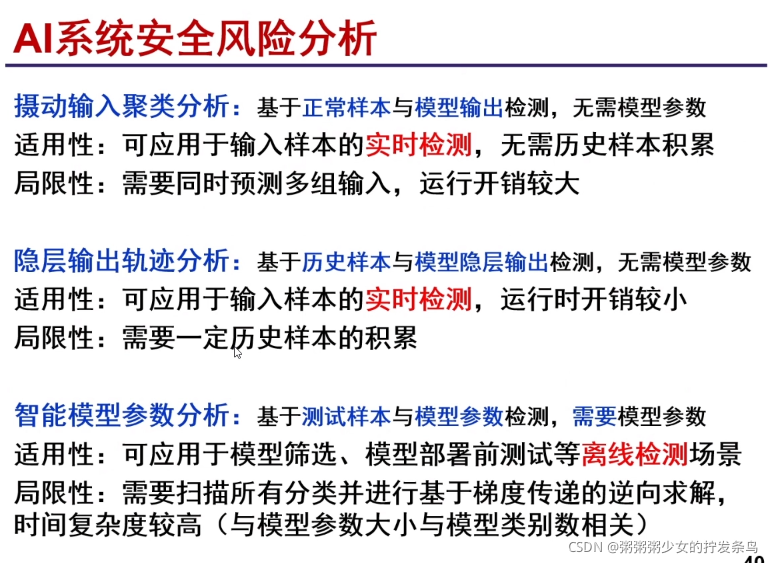

1、后门攻击和对抗样本

这两者很相似,但是要区分很难。后门攻击更具有目的性,需要触发器。我觉得不仅仅是在人工智能,在很多地方都有后门攻击,只是需要我们找到一个合适的场景。

2、研究方向

找到攻击,并且这个攻击门槛低影响大,就是一份很好的work。

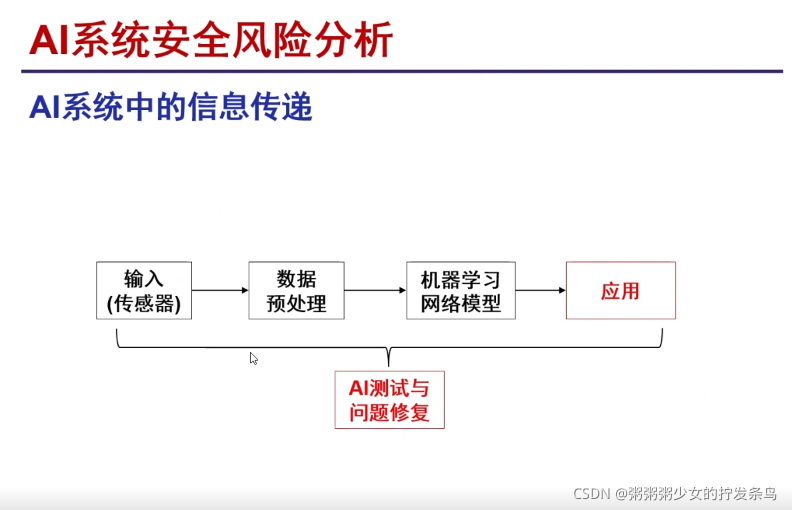

3、为什么大家关注人工智能的安全问题只关注一个点,没有级联的考虑?

因为人工智能这里面存在太多安全问题,考虑一个已经有很多需要挖掘的地方,级联需要考虑模块的联系,这样发动的攻击效果过大也更难。

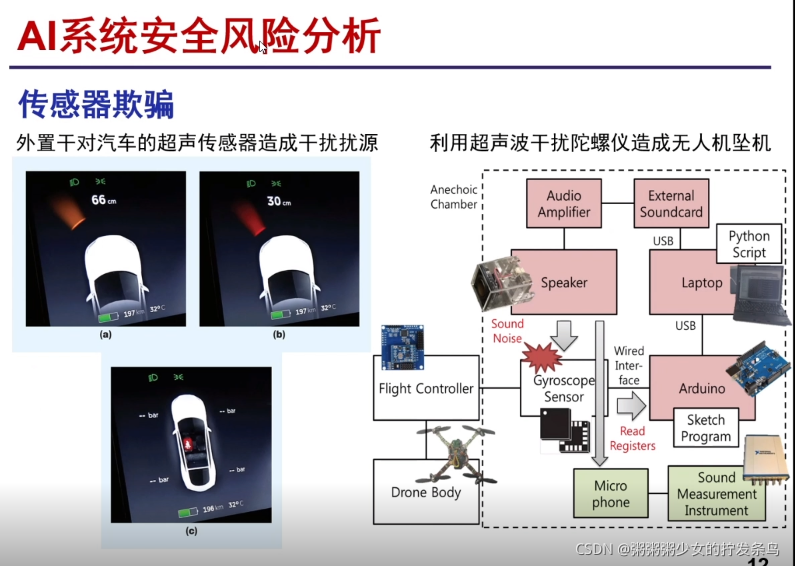

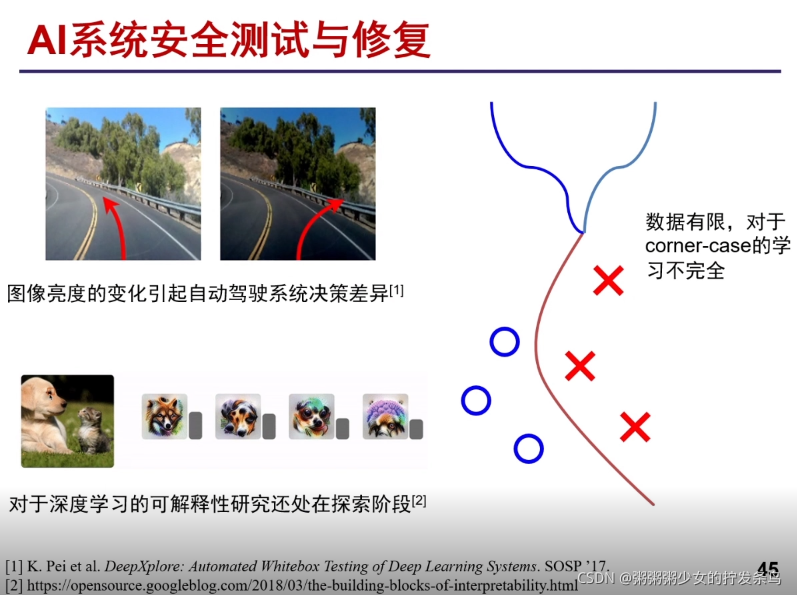

4、决策边界

关于那个车的决策偏向我觉得很有意思,改变亮度或者通过其他细小的变化使得决策发生完全变化。这样的场景值得去找。关于机器学习的决策边界影响的力度太大了。

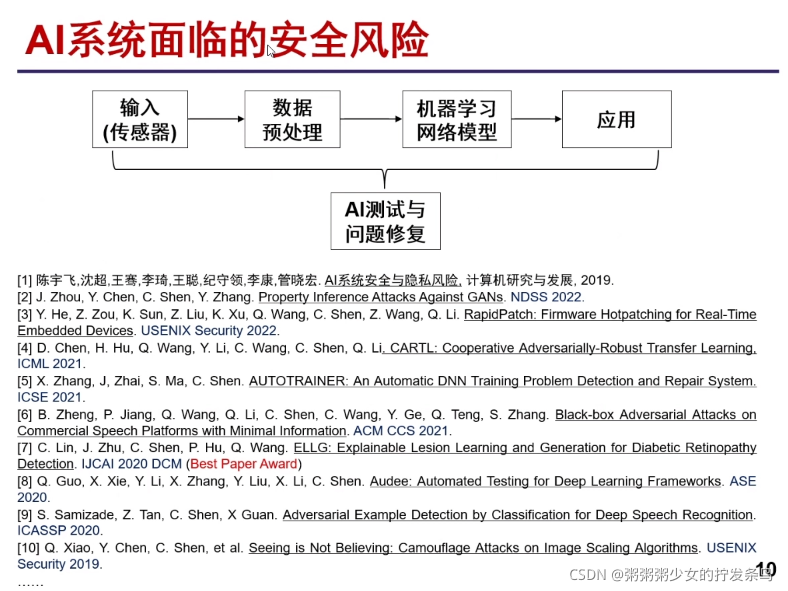

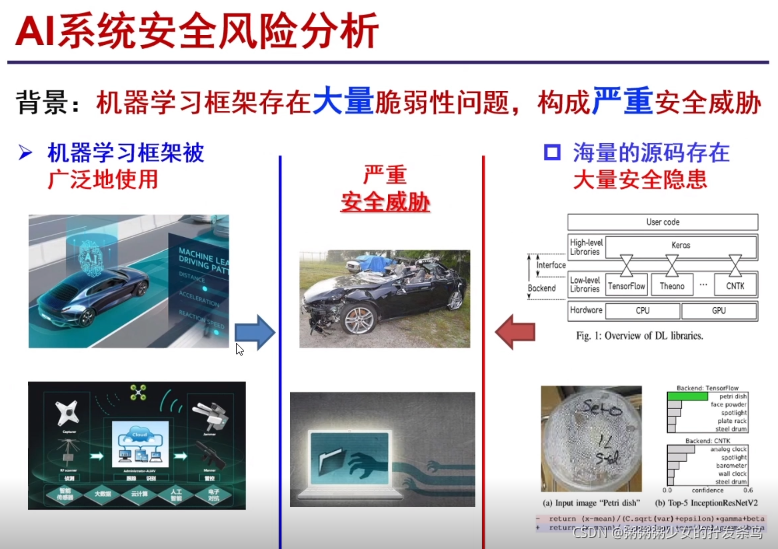

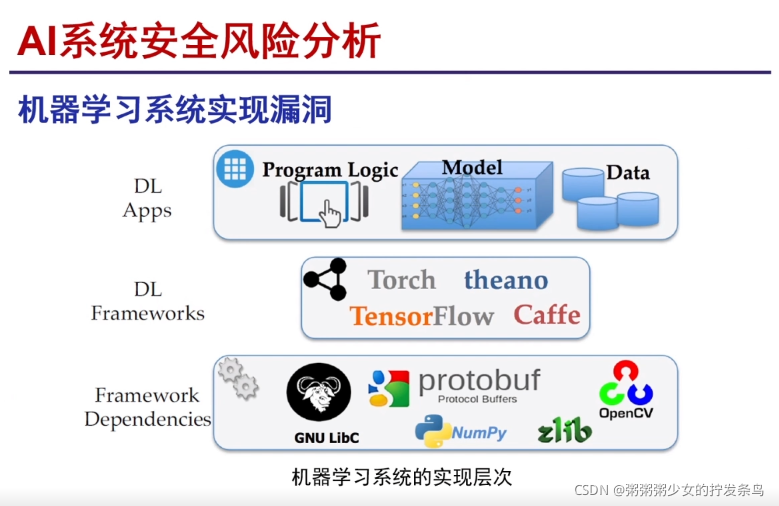

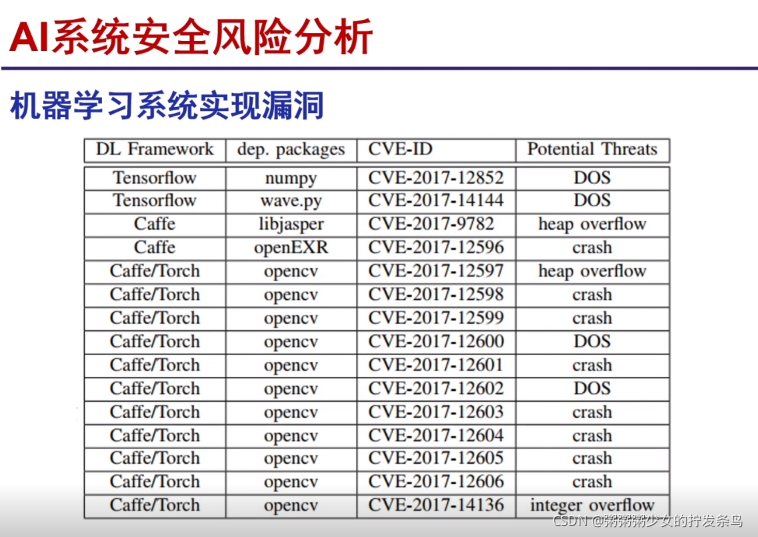

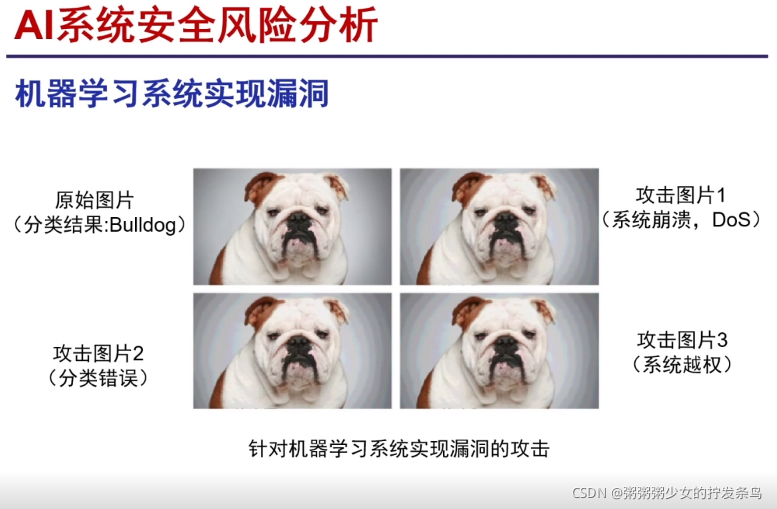

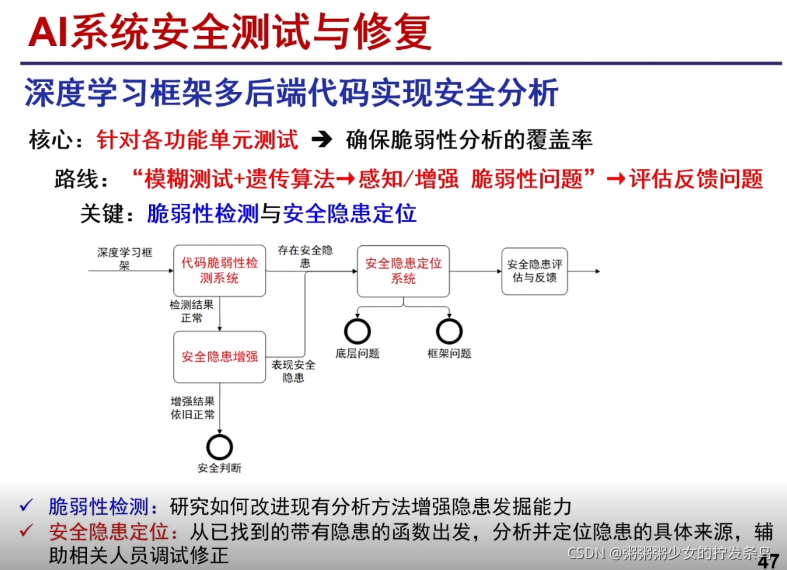

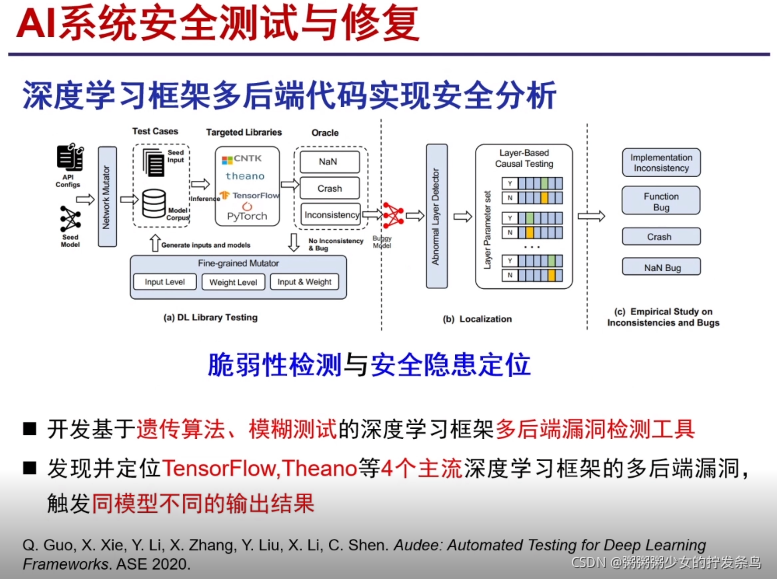

5、框架问题

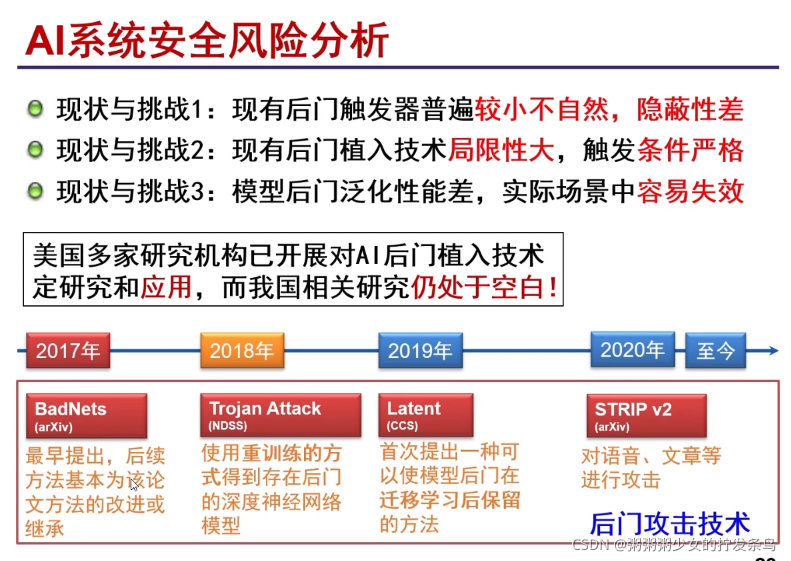

大家写模型都是调包调库,这些开源的框架都是人写的肯定存在漏洞。并且现在都是用别人的模型去跑,不会花费人力物力自己写模型,至少对于中小企业是不可能的,如果在这些需要购买或者开源的模型中加后门,所造成的攻击影响也是不言而喻的。

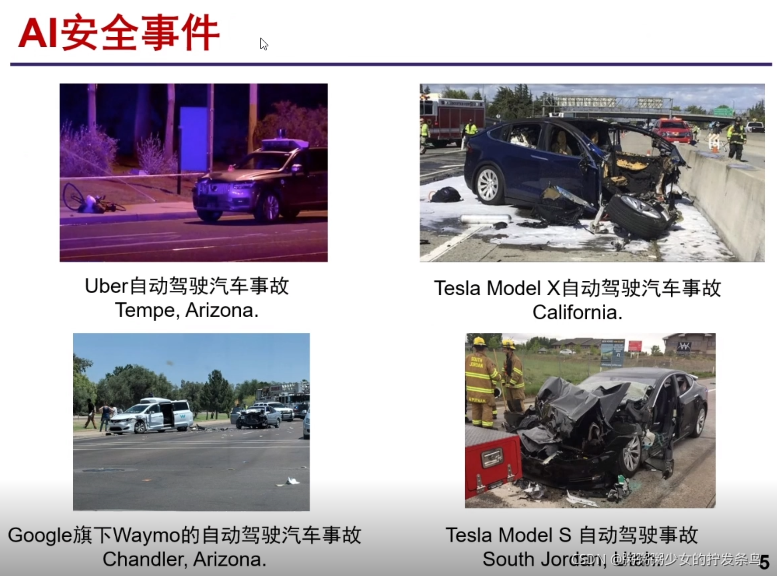

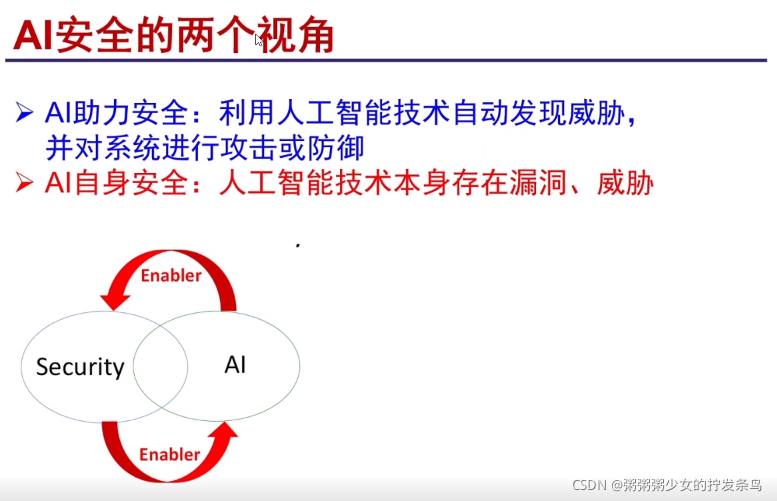

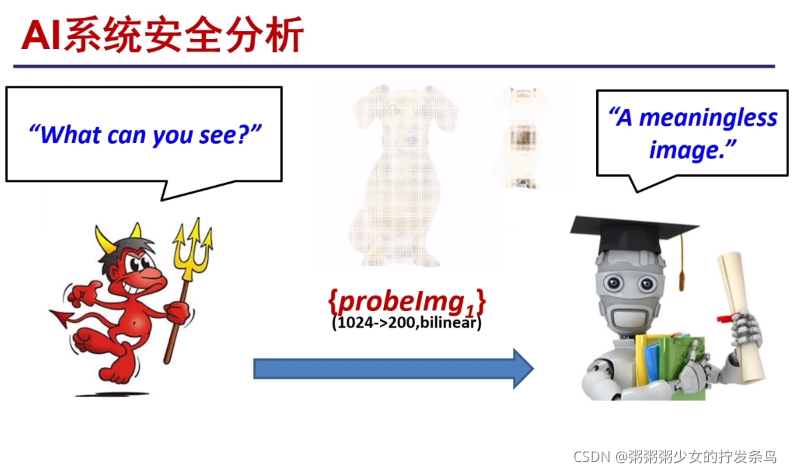

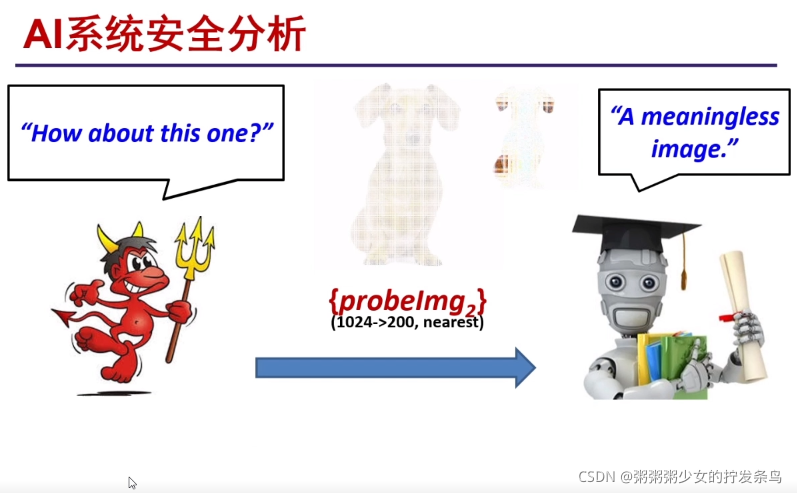

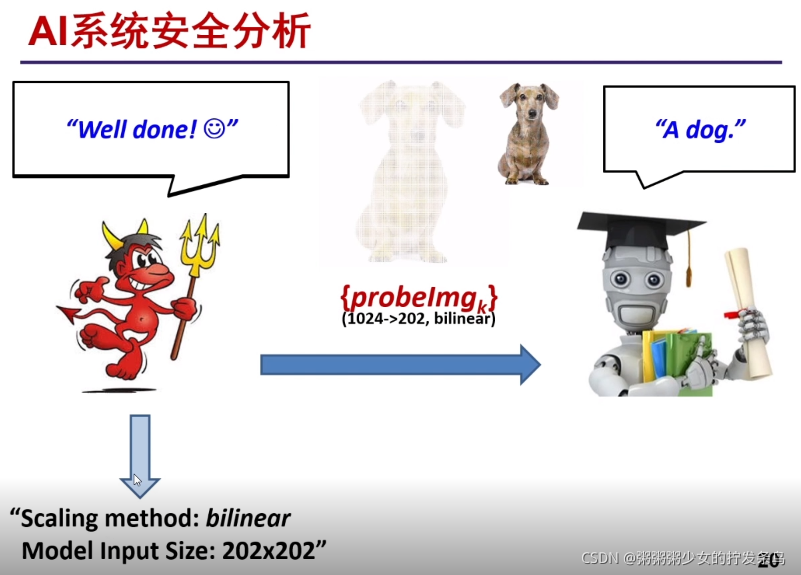

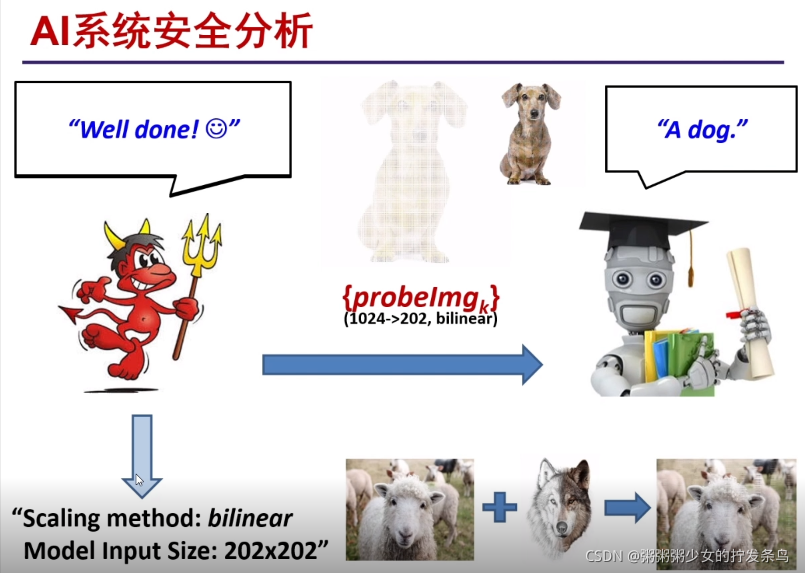

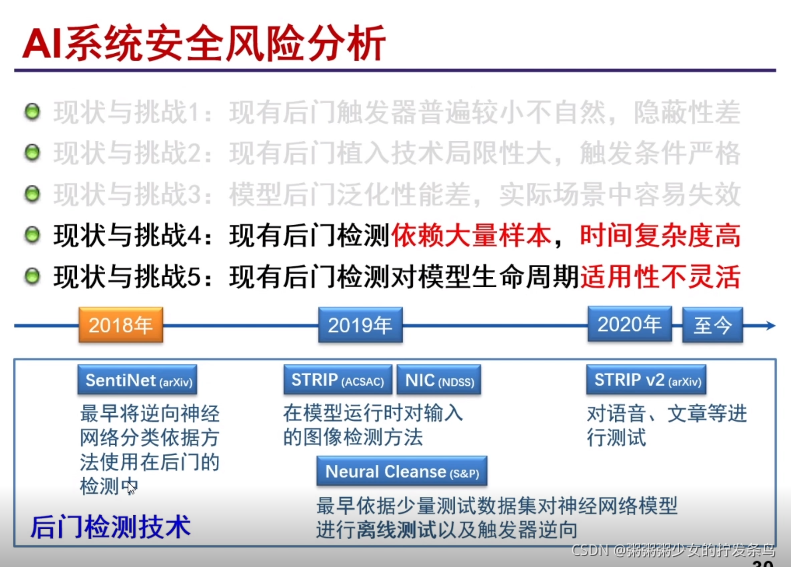

会议纪要

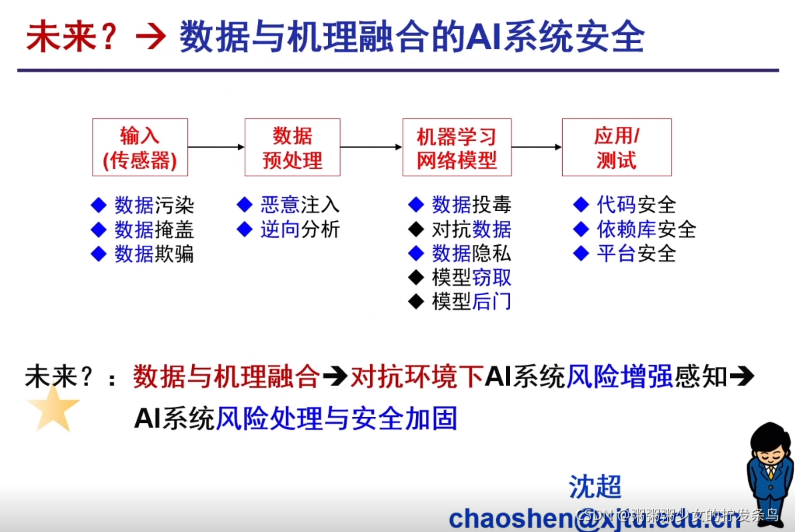

本次会议聚焦于人工智能安全与隐私,探讨了后门攻击和对抗样本的区分,强调寻找影响广泛且门槛低的攻击研究方向。沈超老师指出,由于人工智能领域的安全问题众多,通常只关注单一问题,而忽视了可能的级联效应。他还讨论了决策边界的敏感性,以及开源框架可能存在的安全漏洞,对于依赖他人模型的中小企业来说,可能存在后门攻击的风险。

本次会议聚焦于人工智能安全与隐私,探讨了后门攻击和对抗样本的区分,强调寻找影响广泛且门槛低的攻击研究方向。沈超老师指出,由于人工智能领域的安全问题众多,通常只关注单一问题,而忽视了可能的级联效应。他还讨论了决策边界的敏感性,以及开源框架可能存在的安全漏洞,对于依赖他人模型的中小企业来说,可能存在后门攻击的风险。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?