摘要:

遥感图像超分辨率(SR)在大空间区域或长时间序列的研究场景中通过补充原始高分辨率(HR)图像的不足发挥了重要作用。然而,由于低分辨率(LR)图像中缺乏图像信息,单幅图像超分辨率(SISR)是一个固有的问题。特别是,在大的升缩系数下(如四倍),很难重建HR图像的精细纹理。在这项工作中,基于谷歌地球的HR图像,我们探索了基于参考的超分辨率(RefSR)方法在遥感图像上的潜力,利用HR参考(Ref)图像的丰富纹理信息来重建LR图像的细节。这种方法可以使用现有的HR图像来帮助重建长时间序列或特定时间的LR图像。我们建立了一个基于参考的遥感SR数据集(RRSSRD)。此外,通过采用生成对抗网络(GAN),我们提出了一种新型的端到端基于参考的遥感GAN(RRSGAN)用于SR。RRSGAN可以提取参考特征并将其与LR特征对齐。最终,参考特征中的纹理信息可以被转移到重建的HR图像中。与现有的RefSR方法相比,我们提出了一种梯度辅助的特征对齐方法,该方法采用可变形卷积来对齐Ref和LR特征,并采用相关性注意模块(RAM)来提高模型在不同情况下(如土地覆盖变化和云层覆盖)的鲁棒性。

实验结果表明,RRSGAN是稳健的,在定量评估和视觉结果方面都优于最先进的SISR和RefSR方法,这表明RefSR方法在遥感任务中具有巨大潜力。代码和数据在https://github.com/dongrunmin/RRSGAN。

1. 介绍

高分辨率(HR)遥感图像在城市规划[1]、语义标签[2],[3]、建筑提取[4],[5]、小物体检测[6]等方面至关重要。然而,由于基础技术的限制和硬件的高成本,观察到的人力资源图像往往在空间或时间上存在不完整的覆盖。它们不能满足日益增长的制作和应用需求[7]。

图像超分辨率(SR)技术通过从相对低分辨率(LR)但容易获得的图像中重建HR图像,提供了一种低成本和有效的方式来获得HR图像[8]。近年来,单图像超分辨率(SISR)受到了极大的关注。有许多SISR相关的研究[8]-[10],特别是基于深度学习的方法[7]。然而,由于HR图像的纹理在退化过程中被过度破坏,难以恢复,基于卷积神经网络(CNN)的SISR方法[11]-[13]常常导致模糊的效果。

为了解决这个问题,人们提出了基于生成对抗网络(GAN)的SISR方法[14]-[16],并在视觉质量上取得了突破。然而,基于生成对抗网络的SISR方法往往会产生虚假的纹理,甚至产生人工痕迹。此外,由于有限的先验知识和单一的LR图像中缺乏图像信息,在大比例尺(如4倍)下重建HR的精细纹理仍然是一个具有挑战性的问题。

公开可用的谷歌地球图像极大地促进了HR(最高0.3米)图像的可用性。虽然有许多HR图像,但它们可能无法满足应用的要求(例如,缺乏长时间序列或特定时间的图像[17]),在这种情况下,仍然需要SR技术。然而,现有的HR谷歌地球图像可以促进图像SR任务的新机会。

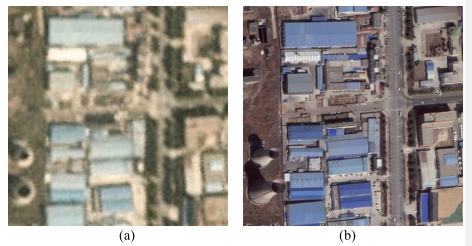

在许多情况下,一张LR遥感图像可以与相应的HR图像相匹配(如图1所示)。直观地说,谷歌地球的HR图像可以提供额外的信息,并可能有助于重建LR图像中的精细纹理。因此,对于遥感SR任务,我们考虑使用谷歌地球上公开的HR图像作为参考(Ref)图像来帮助重建LR图像中的精细纹理。具体来说,参考图像可以指导遥感图像和参考图像包含类似内容的SR过程,从而使SR图像具有鲜明的视觉质量,并保留地面实况类[18]。

图1. LR图像和相应的HR图像的例子。为了方便比较,LR图像被双三次升采样到HR图像的大小。(a)行星图像(3米分辨率)。(b) 谷歌地球图像(0.6米分辨率)。

在计算机视觉领域,一些研究已经从SISR转向探索基于参考的SR(RefSR)[18]-[20]。RefSR引入了额外的参考图像来补偿LR图像中损失的细节。最先进的方法遵循结合图像对齐或补丁匹配和纹理合成的模式[20]。现有的RefSR研究主要基于两种不同类型的假设。

- (1)参考图像和LR图像对准得很好或有很高的内容相似性(例如,从不同的视角或视频帧看同一物体)[19], [21], [22]

- (2)参考图像和LR图像有时明显错位或有不确定的内容相似性(例如,来自网络图像搜索)[20], [23], [24] 。

然而,上述假设并不完全符合本文的遥感场景,主要是由于以下两个原因。

-

(1)在遥感任务中,利用经纬度信息,HR参考图像可以很容易地与同一地点的LR图像相匹配。因此,参考图像和LR图像具有一定的内容相似性。然而,由于拍摄视角的不同,导致高楼大厦的倾斜方向不同,以及地理坐标的偏差(通常在几个像素内),图像的匹配仍然是必要的。对齐的挑战是不同传感器之间的巨大光谱差异、不同时间的土地覆盖变化、视角的移动和光照变化。

-

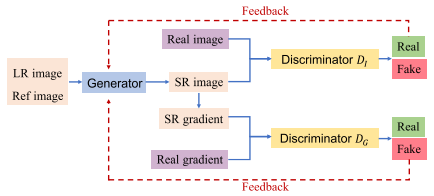

(2)由于不可避免的土地覆盖变化、云层覆盖和缺失的HR Ref图像,对模型的稳健性有更高的要求,特别是在Ref纹理转移过程中。为了解决上述问题,我们提出了一种新的基于参考的遥感GAN(RRSGAN)的SR,如图2所示。我们的方法以 "特征提取-配准-转移 "的方式工作,如图3所示。在特征对齐过程中,具有较大偏移量的物体通常来自于高大的建筑物,而这些建筑物一般都有明显的边界。因此,我们提出了一种梯度辅助特征对齐(GAFA)的方法,将Ref特征与LR特征进行匹配,以便在后续过程中更好地使用。在特征转移过程中,我们提出了一个相关性注意模块(RAM)来抑制不相关的信息,增强参考特征的相关信息以提高模型的稳健性。

图2. RRSGAN的对抗性学习的整体工作流程

为了解决上述问题,我们提出了一种用于SR的新型基于参考的遥感GAN(RRSGAN),如图2所示。我们的方法以 "特征提取-配准-转移 "的方式工作,如图3所示。

在特征对齐过程中,具有较大偏移量的物体通常来自于高大的建筑物,而这些建筑物一般都有明显的边界。因此,我们提出了一种梯度辅助特征对齐(GAFA)的方法,将Ref特征与LR特征进行匹配,以便在后续过程中更好地使用。

在特征转移过程中,我们提出了一个相关性注意模块(RAM)来抑制不相关的信息,增强参考特征的相关信息,以提高模型的稳健性。

我们工作的贡献总结如下。

1)据我们所知,我们是最早在遥感图像上探索RefSR的人之一。基于谷歌地球上公开的HR图像,我们建立了一个开源的基于参考的遥感超分辨率数据集(RRSSRD)。

2)我们提出了一个用于遥感图像的端到端RefSR方法,名为RRSGAN。RRSGAN包含一个特征提取和对齐模块,一个多级纹理变换器,以及在图像和梯度域的基于GAN的损失。考虑到LR和Ref图像之间的错误对齐问题以及Ref图像不同质量的模型鲁棒性,我们提出了一个GAFA方法和一个RAM,以便在遥感场景中更有效地释放RefSR的潜力。

3)我们证明了我们提出的RRSGAN比最先进的SISR方法和现有的RefSR方法在RRSSRD上都要好。我们提出的方法对不同质量的Ref图像也很稳健,在真实世界的图像中表现良好。这项工作证明了RefSR方法在遥感领域的巨大潜力。

本文的其余部分组织如下。我们在第二节中介绍了相关工作,包括现有的遥感图像的SR方法、SISR和基于深度学习的RefSR方法。在第三节中,我们对所提出的方法进行了详细描述。第四部分提供了实验结果和讨论,第五部分总结了我们的工作。

2 相关工作

A. 遥感图像的SR

在遥感领域,根据输入图像的数量,提高遥感图像分辨率的两个主要类别是SISR和多图像超分辨率(MISR)技术[25]。遥感中的MISR技术旨在从同一遥感场景的多个LR版本中重建高空间频率细节[26]-[30]。然而,我们很难将MISR方法应用于不可能或难以获得同一场景的多个遥感图像的应用中[31]。对于这种情况,SISR已经成为更可行的SR技术[32]。

随着深度学习的快速发展,基于深度学习的SISR方法优于传统的SISR方法,被证明在遥感SR领域大有可为[31], [33]。早期基于CNN的方法[34]-[36]通常用遥感图像重新训练为自然图像设计的网络,如SRCNN和VDSR。遥感图像SR的最新进展可以归纳为四个方面。

- (1)改进遥感图像的SR网络结构。例如,Pan等人[37]提出了一种基于残差密集反投影网络(RDBPN)的SISR方法,它可以在全局和局部两个方面利用残差学习。Jiang等人[8]通过在GAN架构中加入边缘增强模块,提高了遥感图像细节方面的性能。Zhang等人[38]提出了一种使用多尺度注意力网络的场景自适应方法,以提高不同场景下的SR性能。

- (2)使用先验信息来帮助重建。例如,Zhang等人[39]引入了遥感图像中不同区域的不同显著性地图来驱动SISR。

- (3)

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1687

1687

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?