目录

1.逻辑回归与线性回归的联系与区别

2.逻辑回归的原理、损失函数推导及优化

3.正则化与模型评估指标

4.逻辑回归的优缺点

5.样本不均衡问题解决办法

1 逻辑回归与线性回归的联系与区别

联系

两者都是通过已知数据和拟合函数来训练未知参数,使得拟合损失到达最小,然后用所得的拟合函数进行预测。

逻辑回归通过somgid函数,将R范围内的取值映射到[0,1]上。

区别

线性回归训练参数方法是最小二乘法,逻辑回归是最大似然估计。

线性回归是一种回归方法,多用来预测连续型数据;逻辑回归是一种分类方法,多用来作二分类判别。

2 逻辑回归原理

逻辑回归分线性与非线性,这里仅谈简单的线性回归。

预测函数构建

z是一个矩阵,θ是参数列向量(要求解的),x是样本列向量(给定的数据集)。θ^T表示θ的转置。g(z)函数实现了任意实数到[0,1]的映射,这样我们的数据集([x0,x1,…,xn]),不管是大于1或者小于0,都可以映射到[0,1]区间进行分类。hθ(x)给出了输出为1的概率。比如当hθ(x)=0.7,那么说明有70%的概率输出为1。输出为0的概率是输出为1的补集,也就是30%。

如果我们有合适的参数列向量θ([θ0,θ1,…θn]^T),以及样本列向量x([x0,x1,…,xn]),那么我们对样本x分类就可以通过上述公式计算出一个概率,如果这个概率大于0.5,我们就可以说样本是正样本,否则样本是负样本。

极大似然给估计法构建代价函数

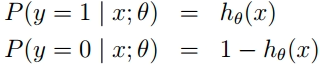

根据sigmoid函数的特性,我们可以做出如下的假设:

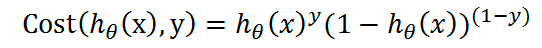

式即为在已知样本x和参数θ的情况下,样本x属性正样本(y=1)和负样本(y=0)的条件概率。理想状态下,根据上述公式,求出各个点的概率均为1,也就是完全分类都正确。但是考虑到实际情况,样本点的概率越接近于1,其分类效果越好。比如一个样本属于正样本的概率为0.51,那么我们就可以说明这个样本属于正样本。另一个样本属于正样本的概率为0.99,那么我们也可以说明这个样本属于正样本。但是显然,第二个样本概率更高,更具说服力。我们可以把上述两个概率公式合二为一。

代价函数:

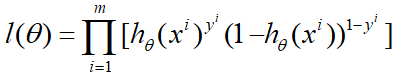

所有样本点,运用极大似然估计,求参数:

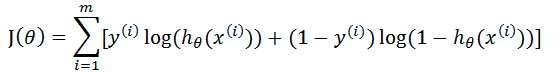

取对数,得对数似然函数:

其中,m为样本的总数,y(i)表示第i个样本的类别,x(i)表示第i个样本,需要注意的是θ是多维向量,x(i)也是多维向量。

综上所述,满足J(θ)的最大的θ值即是我们需要求解的模型。

梯度上升优化函数,求参数

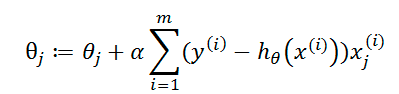

迭代函数:

化简得最后得迭代函数:

使用梯度下降(上升)求最优解。对应得参数即为训练模型得参数。

参考文章:深入浅出–梯度下降法及其实现

机器学习实战教程(六):Logistic回归基础篇之梯度上升算法

3 正则化及模型评估

当模型得参数过多时,很容易过拟合。这是可以通过控制模型复杂度来优化,可以在优化目标中加入正则项,通过惩罚过大得参数来防止过拟。

待完善。

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?