空间注意力机制

空间注意力机制,关注的是某个特定区域的重要程度,如果想要检测一个人,那么人所在的区域就是最重要的

通道注意力机制

浅层一般使用空间注意力:浅层特征图空间维度较大,通道数较少,所以空间注意力更加有效。它可以聚焦在特征图的某个空间区域,过滤不相关的特征。

深层一般使用通道注意力:随网络加深,特征图空间信息消失,通道信息变得更加丰富的一般趋势

通道注意力机制

不同通道关注的细节不同,所以通过赋予权重的方式,关注每个通道的重要程度

添加注意力机制

1 添加在backbone之外的部分,在使用预训练权重时,可以通过这种方式冻结backbone的参数,进行f

inetuning

2 backbone特征的提取是通过大量实验后的结果,没必要去改变骨干网络结构

SENet(通道注意力)

特征层通过一个avgpooling,提取出每一个特征图的信息,维度从bchw变成bc。

分别通过两个fc,第一个fc降维,在代码中通过使用ratio来实现,之后通过一个relu,第二个fc输出与输入特征图的c一致,最后通过一个sigmoid层使输出在0~1之间。

输入特征层×fc的输出

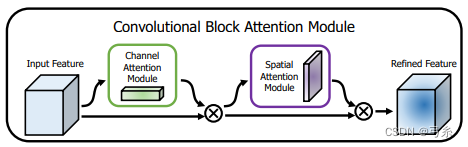

CBAM(通道与空间混合)

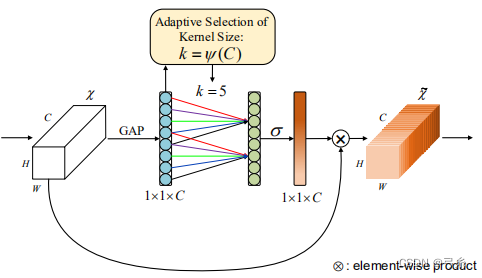

ECANet(通道注意力)

作者认为SENet捕获所有通道的依赖关系是低效的,由于卷积可以跨通道,所以不使用2个fc而是用一个1D卷积来对通过avgpooling的bc进行处理。ECANet通过卷积代替全连接层减少了计算量,更加高效。

每个1D卷积,代表了每次跨通道的数量。

6573

6573

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?