一.安装

- Anaconda是包含了常用的数据科学库的Python发行版本,如果没有安装,可以到https://www.continuum.io/downloads下载对应平台的包安装。

也就是说如果你用的开发环境是Anaconda,直接Window + R 输入cmd进去终端,输入conda inatall Scrapy 安装就完成了。 -

当然,如果没有安装Anaconda,我们也可以通过wheel文件来安装,进http://www.lfd.uci.edu/~gohlke/pythonlibs/,从该网站找到lxml的相关文件。假如是Python3.5版本,WIndows 64位系统,那就找到lxml‑3.7.2‑cp35‑cp35m‑win_amd64.whl 这个文件并下载,然后在终端里输入pip install + 上面下载的文件(找到文件,拖拽到终端即可)。再执行命令conda install scrapy

-

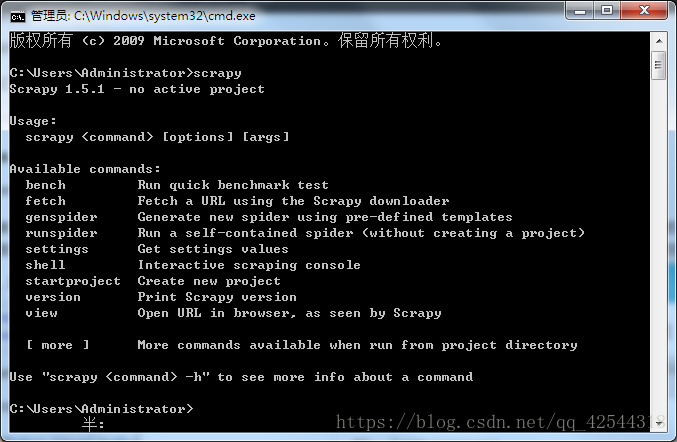

怎么判定安装成功呢?终端输入scrapy 回车

显示如图即为安装成功

二.基本介绍

- 首先要创建一个新的Scrapy项目,默认是在C盘创建,如果要创建在别的盘里可以通过cd (加上空格)或d:的形式

- 其中baidu是项目名称:

scrapy.cfg :项目的配置文件

spiders/items.py :项目的目标文件

spiders/middlewares.py:项目的中间文件

spiders/pipelines.py :项目的管道文件

spiders/settings.py :项目的设置文件 - 基本操作

创建项目:

scrapy startproject name(在终端里操作)

生成爬虫文件:

scrapy genspider example example.com(域名) - 基本框架

Scrapy是用纯Python实现一个为了爬取网站数据、提取结构性数据而编写的应用框架,用途非常广泛。框架的力量,用户只需要定制开发几个模块就可以轻松的实现一个爬虫,用来抓取网页内容以及各种图片,非常之方便。Scrapy 使用了 Twisted['twɪstɪd](其主要对手是Tornado)异步网络框架来处理网络通讯,可以加快我们的下载速度,不用自己去实现异步框架,并且包含了各种中间件接口,可以灵活的完成各种需求。

(1)Scrapy Engine(引擎): 负责Spider、ItemPipeline、Downloader、Scheduler中间的通讯,信号、数据传递等。

(2)Scheduler(调度器): 它负责接受引擎发送过来的Request请求,并按照一定的方式进行整理排列,入队,当引擎需要时,交还给引擎。

(3)Downloader(下载器):负责下载Scrapy Engine(引擎)发送的所有Requests请求,并将其获取到的Responses交还给Scrapy Engine(引擎),由引擎交给Spider来处理

(4)Spider(爬虫):它负责处理所有Responses,从中分析提取数据,获取Item字段需要的数据,并将需要跟进的URL提交给引擎,再次进入Scheduler(调度器)

(5)Item Pipeline(管道):它负责处理Spider中获取到的Item,并进行进行后期处理(详细分析、过滤、存储等)的地方.(6)Downloader Middlewares(下载中间件):你可以当作是一个可以自定义扩展下载功能的组件。

(7)Spider Middlewares(Spider中间件):你可以理解为是一个可以自定扩展和操作引擎和Spider中间通信的功能组件(比如进入Spider的Responses;和从Spider出去的Requests)

275

275

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?