先验概率与后验概率

先验概率:指在观测前已知的概率分布,可以直接对结果进行推测

后验概率:在观测到特征值后对结果进行推测

我们更多在深度学习中使用的是后验概率,因为我们通过特征值得到了更多的信息,能对结果进行更精准的预测,但是由于后验概率无法直接获得,但是我们可以先验概率来计算它=后验概率,也就是使用贝叶斯公式计算。

贝叶斯公式与贝叶斯决策论

假设做了10次投掷硬币的实验,一共有1元和5角两种大小,这个大小就为硬币的特征值(X),其中6次结果是反面,我们这里用y来表示结果,反面为(y=0),在出现反面时,5角的硬币出现了4次。在4次正面的情况下,5角的硬币出现了2次。

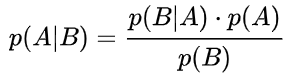

首先,我们是想知道在我们观测到特征值之后预测硬币正反的概率。p(A|B)表示,在B的条件下,A的概率。同理,p(B|A)是在A的条件下,B的概率。那么怎么去计算后验概率呢。

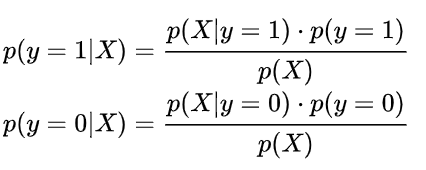

我们可以把上面的公式代换一下:

p(y=1|X)指的是在观测到X特征值的时候,硬币正反的概率,p(X|y=1)是在硬币正面的时候X的概率,p(X)是指特征值出现的概率。那么我们根据上面的数据,可以得出:

观测到5角硬币后反面的后验概率:p(y=0|X) = (2/30.6)/0.6=2/3

观测到5角硬币后正面的后验概率:p(y=1|X) = (0.50.4)/0.6=1/3

而贝叶斯决策的预测值是选取后验概率最大的结果,在这个例子中就是选择两个后验概率中最大的那一个。那么这里5角硬币为反面的后验概率更大,所以我们认为观测到5角硬币时的结果是反面的概率更大。

朴素贝叶斯分类器

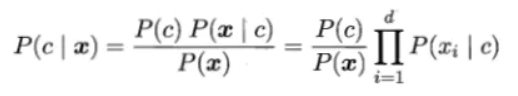

我们已经知道如何通过先验概率求后验概率,也就是贝叶斯公式。那么什么事朴素贝叶斯公式呢?首先贝叶斯公式是在观测到某个特征值的时候预测出概率是多少,而在日常生活中一个物体的特征值往往是很多的,并且是不独立的,那么我们可以假设物体的每个特征值是独立的,计算出每个独立特征值对应的后验概率,然后就可以求出某个物体是某一个类别的概率是多少,这就是朴素贝叶斯分类器。

朴素贝叶斯公式:

由于P(x)和P©是固定的,所以我们只需要知道特征值对应的概率即可求得整体的概率。

半朴素贝叶斯分类器

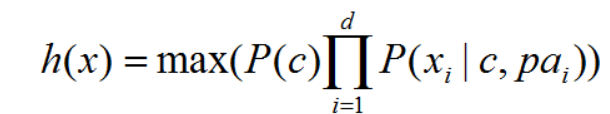

朴素贝叶斯分类的前提是所有属性都是独立的,但是这在现实生活中是不可能的,我们适当考虑一部分属性间的相互依赖关系,这就是半朴素贝叶斯分类器。我们假定每个属性仅依赖于其他最多一个属性,称其依赖的这个属性为其超父属性,这种关系称为:独依赖估计(ODE)。

半朴素贝叶斯公式

半朴素贝叶斯公式比朴素贝叶斯公式多了一个pai,这个就是“超父”属性。

贝叶斯网络

贝叶斯网络(Bayesian network),又称信念网络(Belief Network),或有向无环图模型(directed acyclic graphical model),是一种概率图模型,于1985年由Judea Pearl首先提出。它是一种模拟人类推理过程中因果关系的不确定性处理模型,其网络拓朴结构是一个有向无环图(DAG)。

贝叶斯网络的构成

贝叶斯网络的有向无环图中的节点表示随机变量{x1,x2,x3,…,xn},它们是可以被观测到的变量。我们认为有因果关系的变量用箭头连接。如果两个变量之间用单向箭头连接,表示其中一个节点是因(parents),另一个节点为果(children),两个节点就会产生一个条件概率值。当然,节点的有向路径可以不止一条,一个祖先节点可以通过不同的途径来影响它的后代节点。当我们说一个原因节点会导致某个结果的cahnsheng,都是一个概率的问题,那么我们就需要给每个节点添加一个条件概率。一个节点在它的双亲节点的不同取值条件下有不同属性值的概率,这就是条件概率表。

条件概率表

贝叶斯网络中的条件概率表是结点的条件概率的集合。当使用贝叶斯网络进行推理时,实际上是使用条件概率表当中的先验概率和已知的证据结点来计算所查询的目标结点的后验概率的过程。而条件概率可以用半朴素贝叶斯方程进行计算。

根据条件概率和贝叶斯网络结构,我们不仅可以由祖先接点推出后代的结果,还可以通过后代当中的证据结点来向前推出祖先取各种状态的概率。

EM算法

EM算法是一种迭代算法,用于含有隐变量的概率模型参数的极大似然估计,或极大后验概率估计。EM算法的每次迭代分两步完成:E步,求期望(expectation);M步,求极大值(maximization).所以这一算法称为期望极大算法,简称EM算法。基本思想为:首先根据己经给出的观测数据,估计出模型参数的值;然后再依据上一步估计出的参数值估计缺失数据的值,再根据估计出的缺失数据加上之前己经观测到的数据重新再对参数值进行估计,然后反复迭代,直至最后收敛,迭代结束。

极大似然估计

假设我们需要调查学校男生女生的身高分布,我们抽取100个男生和100个女生,将他们按照性别分为两组,之后统计抽样得到的身高数据。我们现在知道他们的身高服从正态分布,但是这个分布的均值和方差我们是不知道的,而这两个参数就是我们要求的。

我们已知的条件有两个:样本服从的分布模型、随机抽取的样本。我们需要求解模型的参数。根据已知条件,通过极大似然估计,求出未知参数。总的来说:极大似然估计就是用来估计模型参数的统计学方法。

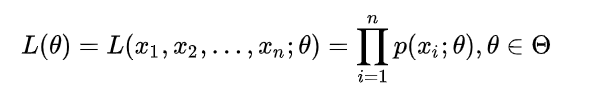

问题数学化:样本集 X={x1,x2,…,xn},n=100 。概率密度是:p(xi|θ) 抽到第i个男生身高的概率。由于100个样本之间独立同分布,所以同时抽到这100个男生的概率是它们各自概率的乘积,就是从分布是p(X|θ)的总体样本中抽取到这100个样本的概率,也就是样本集X中各个样本的联合概率,用下式表示:

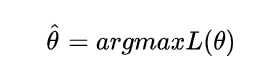

这个概率反映了在概率密度函数的参数是θ时,得到X这组样本的概率。 我们需要找到一个参数θ,使得抽到X这组样本的概率最大,也就是说需要其对应的似然函数L(θ)最大。满足条件的θ叫做θ的最大似然估计值,记为:

EM算法流程

输入:观察到的数据x = (x1,x2,…,xn),联合分布p(x,z;θ),条件分布p(z|x,θ),最大迭代次数J。

算法步骤:

随机初始化模型参数θ的初始值θ0

J = 1,2…J开始迭代

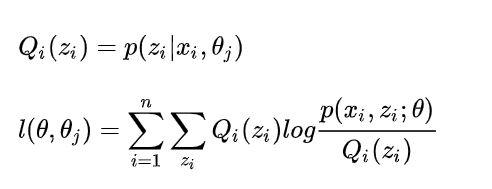

E步:计算联合分布的条件概率的期望值

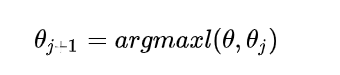

M步:极大化l(θ,θj),得到θj+1:

如果θj+1已收敛,则算法结束,否则继续迭代

输出:模型参数θ

2693

2693

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?