点击上方“计算机书童”,选择加"星标"或“置顶”

顶刊论文解读,第一时间分享题目:自我监督的深度盲视频超分辨率

作者:Haoran Bai and Jinshan Pan

源码:https://github.com/csbhr/Self-Blind-VSR

摘要

现有的基于深度学习的视频超分辨率(SR)方法通常依赖于有监督学习方法,其中训练数据通常是通过已知或预定义的核(例如,双三次核)进行模糊操作后跟一个降采样操作生成的。然而,这对于真实应用来说并不成立,因为退化过程复杂,不能很好地用这些理想情况来近似。此外,在现实世界场景中获取高分辨率(HR)视频及其对应的低分辨率(LR)视频是困难的。为了克服这些问题,我们提出了一种自我监督学习方法来解决盲视频SR问题,该方法同时从LR视频中估计模糊核和HR视频。由于直接使用LR视频作为监督通常会导致平凡解,我们开发了一种简单有效的方法,根据视频SR的成像原理从原始LR视频中生成辅助配对数据,以便网络可以更好地通过生成的配对数据约束模糊核估计和潜在HR视频恢复。此外,我们引入了一个光流估计模块,以利用相邻帧的信息进行HR视频恢复。实验表明,我们的方法在基准测试和真实世界视频上的表现优于现有最先进技术。

关键词

自我监督学习

盲视频超分辨率

卷积神经网络

深度学习

I. 引言

随着高清设备的快速发展,将一些低分辨率(LR)成像设备生成的视频在这些高清设备上可视化通常会导致显著的混叠和模糊效果。因此,开发一种有效的算法以在高清设备上实现更好的可视化,对视频进行超分辨率处理是非常有意义的。

视频超分辨率(SR)的目标是从给定的LR视频中推断出潜在的高分辨率(HR)视频。视频SR问题中的退化过程通常被建模为:

其中,和分别表示第个LR帧,第个HR帧和噪声;和分别表示下采样和模糊矩阵;和表示比例因子和模糊核;表示将扭曲到第帧的扭曲矩阵;表示视频序列的半长度。退化模型(1)是盲视频SR的一个广泛使用的古典模型[6],[7],[8],它考虑了由传感器光学和微小相机运动引起的模糊影响,因此每一帧都有不同的模糊核。

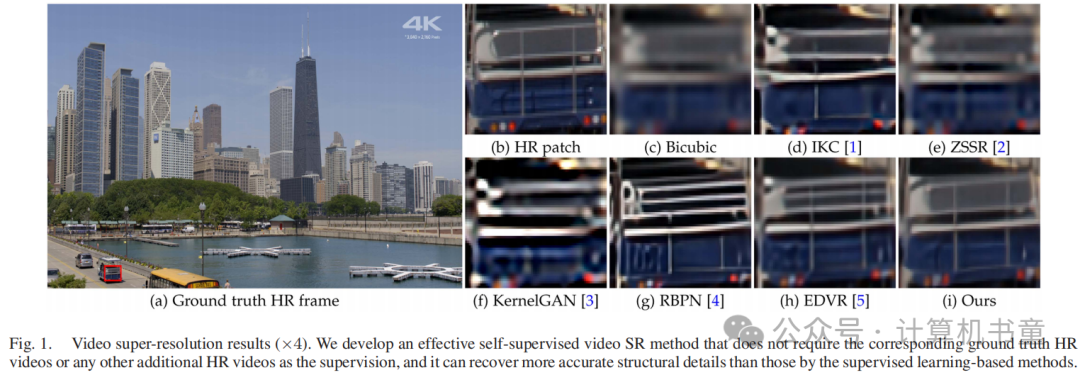

视频SR是一个高度病态的问题,因为潜在的HR帧、模糊矩阵和扭曲矩阵都是未知的。由于深度卷积神经网络(CNNs)的使用,最近取得了一些显著的进展。然而,训练深度模型始终需要真实的HR视频,这在真实应用中很难满足。为了约束深度模型训练,大多数视频SR方法[5],[8],[9],[10],[11],[12],[13],[14],[15]假设模糊核是已知的或预定义的(例如,双三次核)以合成配对数据集。尽管它们在现有的基准数据集上取得了最先进的结果,如图1(g)和(h)所示,但使用预定义模糊核生成的合成数据集训练的深度模型在真实视频上不能很好地泛化,因为真实应用中的模糊核要复杂得多。第IV节将展示更多真实场景下的视觉结果。

为了为SR问题生成真实的模糊核,一些方法开发了有效的深度模型来从输入的LR图像中估计模糊核[1],[3]。另一种方法开发了有效的无配对学习[16]和零样本学习方法[2]来解决SR问题。这些方法在真实世界的应用中取得了不错的性能。然而,这些方法大多是为单图像SR问题设计的,很少有针对视频SR问题开发的。直接将它们应用于视频SR问题无法产生令人信服的结果,如图1(d)-(f)所示。

在本文中,我们提出了一种基于自我监督学习的有效视频SR算法,它可以同时估计模糊核和潜在的HR帧,基于深度CNNs。与合成未配对数据集[16]通常需要复杂的网络设计不同,我们的算法只探索LR输入视频中的信息以恢复HR视频。我们首先开发了深度CNN模型来从LR输入视频中估计模糊核和潜在的HR视频。然后,我们使用原始的LR输入视频来约束再生的LR视频,这些视频是根据视频SR的成像原理由估计的模糊核和潜在的HR视频生成的,以便深度模型可以被学习。然而,直接使用LR输入视频作为网络训练的监督通常会导致平凡解。为了解决这个问题,我们首先探索了模糊核的稀疏属性来约束模糊核估计网络,然后开发了一种简单有效的方法,根据视频SR的成像原理从原始LR输入视频中生成辅助配对数据,以便网络可以更好地被生成的配对数据和稀疏属性约束同时约束模糊核估计和潜在HR视频恢复。此外,我们引入了一个光流估计模块,以利用相邻帧的信息进行更好的HR视频恢复。通过以端到端的方式训练所提出的算法,我们展示了它在基准数据集和真实世界视频上与现有最先进方法相比具有优越性。据我们所知,这是第一个开发自我监督学习方法用于盲视频SR的算法。图1展示了一个超分辨率帧,其中所提出的方法生成的结果比单图像和视频SR方法具有更准确的结构细节。

主要贡献总结如下:

我们提出了一种有效的自我监督学习算法,用于不需要任何配对或未配对数据集作为监督的视频SR。

为了约束视频SR的深度模型,我们开发了一种简单有效的方法,根据视频SR的成像原理从原始LR输入视频中生成辅助配对数据。

我们以端到端的方式训练我们的方法,并展示了它在基准数据集和真实世界视频上生成了有利的结果。据我们所知,这是第一个基于自我监督学习的盲视频SR算法。

III. 提出的方法

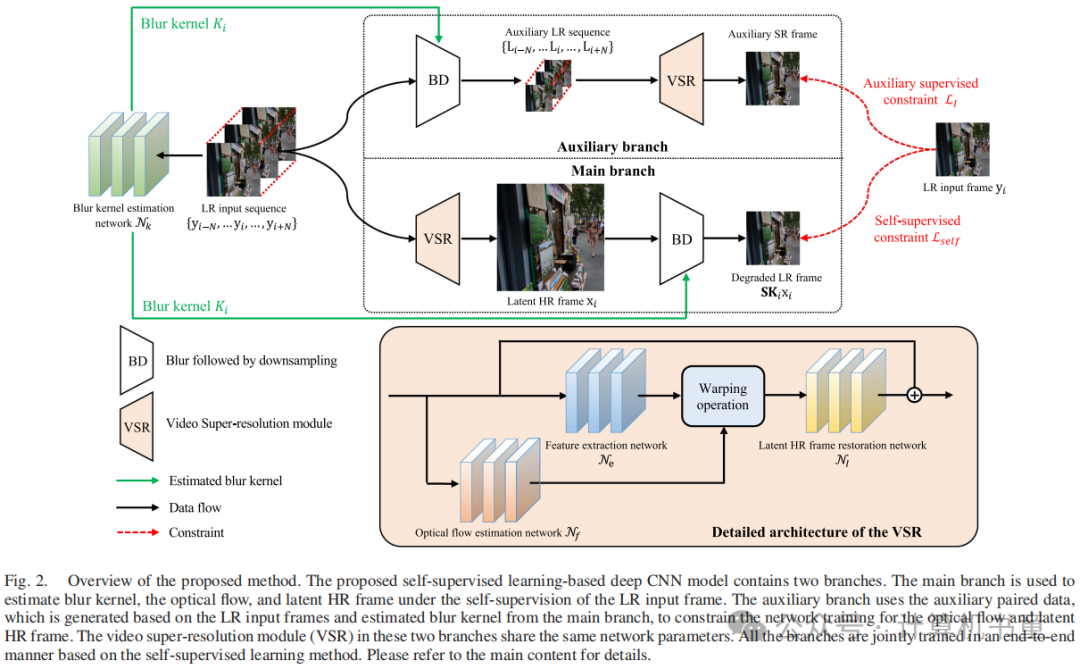

给定低分辨率(LR)序列,我们提出的方法旨在无需任何真实高分辨率(HR)序列的监督下估计HR序列。为了简化问题,我们假设潜在的高分辨率帧可以通过来估计,其中表示输入LR序列的半长度。基于图像形成模型(1),恢复高分辨率帧需要估计模糊核和光流变形矩阵。因此,我们开发了一种有效的自监督学习方法,以便在没有任何HR序列监督的情况下,同时估计模糊核、光流和潜在的HR帧。基于所提出的自监督学习方法,深度CNN模型被设计为两个分支。主分支用于估计模糊核、光流和潜在的HR帧,辅助分支使用基于主分支估计的模糊核从原始LR输入帧生成的辅助成对训练数据,以约束网络训练中的光流和潜在HR帧。所有分支都基于自监督学习方法以端到端的方式联合训练。图2展示了所提出算法的概述。下面,我们首先介绍有关模糊核估计、光流估计和潜在HR帧恢复的网络设计,然后介绍所提出的自监督学习方法来解决盲视频超分辨率问题。

A. 模糊核估计

模糊核估计模块旨在从中估计模糊核。设表示模糊核估计网络,我们通过以下方式估计模糊核:

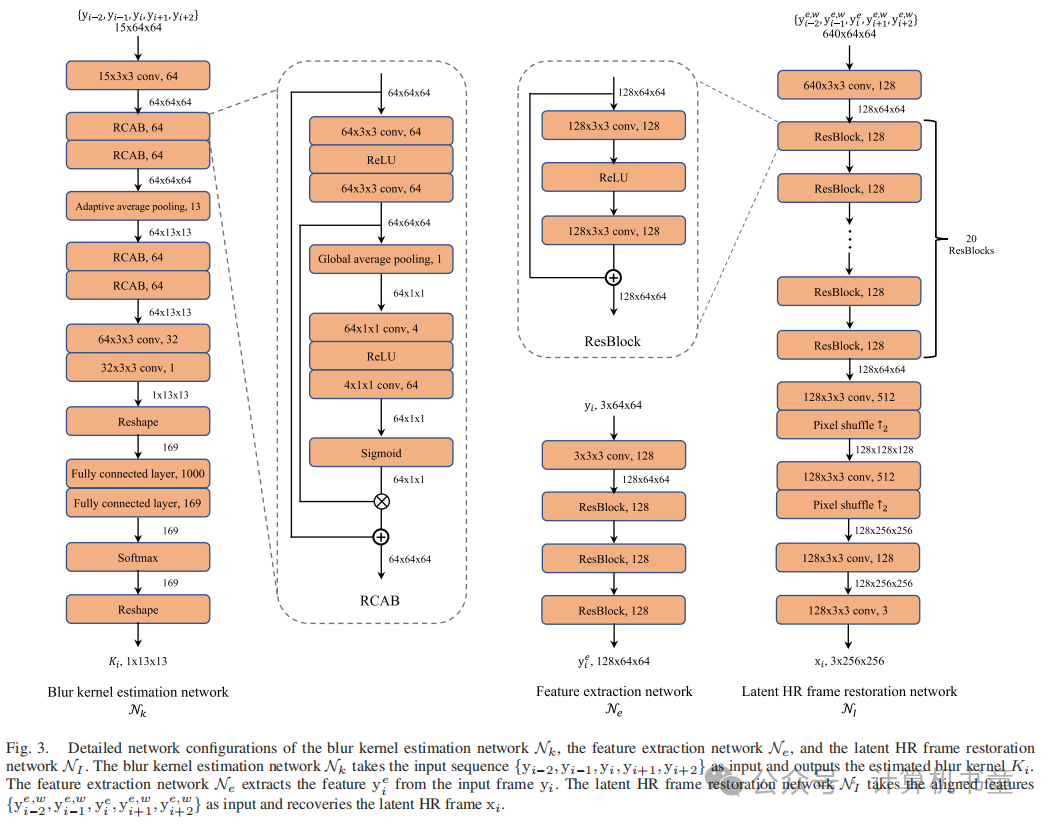

其中表示串联操作。对于网络,我们首先采用带有池化操作的卷积网络从输入中提取模糊核的信息。在这个卷积网络中,我们采用了在[23]中提出的残差通道注意力块(RCAB),它在[30]中已被证明对模糊核估计有效。然后,我们应用两个全连接层,后接softmax激活函数来获得模糊核,并确保所有元素的和为1。图3展示了详细的网络配置。

B. 光流估计

光流估计主要用于计算变形矩阵,以便利用相邻帧的信息进行更好的潜在HR帧恢复。在这项工作中,我们使用PWC-Net[31]作为我们的光流估计模型,因为它在一些视频恢复任务中(例如,视频去模糊[32])是有效的。由于潜在的HR序列不可用,我们通过以下方式从LR输入序列计算光流:

其中表示光流估计网络,采用[31]中的默认网络配置。有了估计的光流,变形操作,即,可以通过对应用双线性插值来计算。与[31]中的变形操作类似,我们在LR输入帧的特征上执行变形操作,其中特征由特征提取网络提取,如图2所示。图3展示了的详细网络配置。

C. 潜在HR帧恢复

给定LR输入帧的变形特征,我们通过以下方式估计潜在帧:

其中表示潜在HR帧恢复网络;表示第个LR帧的提取特征(即,),表示根据估计的光流(即,)变形的特征。

对于网络架构,我们采用20个ResBlocks[33]进行特征重建,并使用像素洗牌模块[34]进行上采样。图3展示了的详细网络配置。

D. 自监督学习

由于真实的HR视频和模糊核不可用,直接训练网络、、和的简单方法是最小化以下损失函数:

其中表示鲁棒函数。在本文中,我们使用L1范数。然而,直接最小化(5)会有无限多的解,大多数情况下可能会得到平凡解[25]、[35]。为了解决这个问题,我们探索了模糊核的属性和图像形成模型(1)来约束模糊核估计和潜在HR帧恢复过程。

由于模糊核的元素通常是稀疏的,我们开发了一个超拉普拉斯先验来模拟网络输出的稀疏属性:

其中表示超参数,其值通常取0.5,根据[3]。

为了规范潜在HR帧恢复过程,我们根据图像形成模型(1)开发了一个视频退化约束。在提出视频退化约束之前,我们首先介绍以下属性。

性质:设、F_i^*_{j\rightarrow i}和分别表示真实的模糊核矩阵、变形矩阵和确切的LR到HR映射函数。也就是说,以下等式

严格成立。因此,对于任何视频,如果,我们有:

在该属性中,确切的LR到HR映射函数是一个理想函数,能够准确地从退化的LR帧中恢复潜在的HR帧,并且它与视频内容无关,因此可以适用于具有相同退化参数的任何视频。此外,我们假设运动场已经根据任何特定给定的高分辨率视频准确估计。由于模糊核与视频内容无关,我们可以根据图像形成模型(1)将估计的模糊核应用于任何HR视频来生成辅助LR视频。而不是使用额外的HR参考视频,我们直接使用作为HR视频来生成辅助LR视频。基于上述属性,如果潜在HR帧恢复网络被准确估计,网络的输出应该接近。因此,我们通过以下方式开发了一个约束来规范网络:

其中表示辅助LR帧的提取特征;表示根据估计的光流变形的特征,并且。

基于上述考虑,所提出的视频超分辨率的自监督学习可以通过最小化以下损失函数实现:

其中和是权重参数。我们将在第V-A节展示自监督学习的有效性。

当训练阶段完成后,只有VSR网络(即,、和)在推理阶段使用,以恢复 潜在的HR视频。

E. 实施细节和数据集

实施细节:我们使用[31]中的预训练模型作为光流估计网络的初始化,并随机初始化网络、和。初始化之后,所有参数都基于所提出的自监督约束联合训练。网络、和的学习率初始化为,而网络的学习率初始化为,因为它采用了预训练模型。我们使用参数、和的ADAM优化器[36]进行网络训练。输入LR序列的半长度设置为2。所有网络都基于自监督学习方法以端到端的方式联合训练。每过100个周期,学习率减半,总共使用200个周期。对于自监督损失函数(10)中的权重参数,我们经验性地将和设置为1和0.04。与[3]类似,我们进一步使用边界损失和中心损失来约束估计的模糊核,通过鼓励边界值为零和质心位于核的中心来实现,它们的权重分别设置为0.5和1.0。本文中使用的训练代码、模型和实验结果将在https://github.com/csbhr/Self-Blind-VSR上提供。

数据集:我们首先在合成数据集上评估所提出的算法,这些数据集是根据不同高斯模糊核和现实运动模糊核[3]基于图像形成模型(1)生成的。然后,我们进一步在真实视频上进行定性评估,以评估所提出方法的泛化能力。由于所提出的方法专注于在LR输入没有真实HR视频的情况下的盲视频SR问题,且模型(1)中的退化参数未知,合成数据集中的真实HR视频仅用于度量计算,不用于深度模型训练。

为了生成用于定量评估的合成数据集,我们将REDS数据集[37]用作训练数据集,并且采用了常用的视频SR数据集REDS4数据集(由[5]从[37]中分割出来)、VID4数据集[6]和SPMCS数据集[8]作为基准来评估我们的方法。在生成LR视频时,我们根据图像形成模型(1),对每个HR视频应用模糊操作和下采样操作。对于模糊操作,我们使用不同的高斯模糊核和来自[3]的真实运动模糊核。对于高斯模糊核,标准差值范围从0.4到2。下采样操作用于根据比例因子提取像素,比例因子设置为4。

IV. 实验结果

由于我们的方法旨在以自监督的方式解决盲视频SR问题,很少有方法提出解决这个问题。评估我们的算法的性能,我们仍然比较它与相关的自我监督单图像SR方法(ZSSR [2],克内尔根[3],MZSR [38]),监督单图像SR方法(RCAN [23]),盲单图像SR方法(IKC [1]),和最先进的视频SR方法基于监督学习(RBPN [4],DUF [14],TDAN [15],EDVR [5],BasicVSR [39],BasicVSR++ [40],RVRT [41]).对于ZSSR [2],默认的内核是用于评估的双边形内核。对于KernelGAN [3],我们使用带有默认设置的已发布代码,其中ZSSR [2]用于恢复HR图像以进行评估。

为了与基于监督学习的方法进行比较,由于地面真实HR视频不能用于训练,监督SR方法(RCAN [23],IKC [1],RBPN [4],DUF [14],TDAN [15],EDVR [5],BasicVSR [39],BasicVSR++ [40],RVRT [41])使用官方提供的预训练模型进行公平评估。我们使用PSNR和SSIM作为合成视频的定量评价指标。

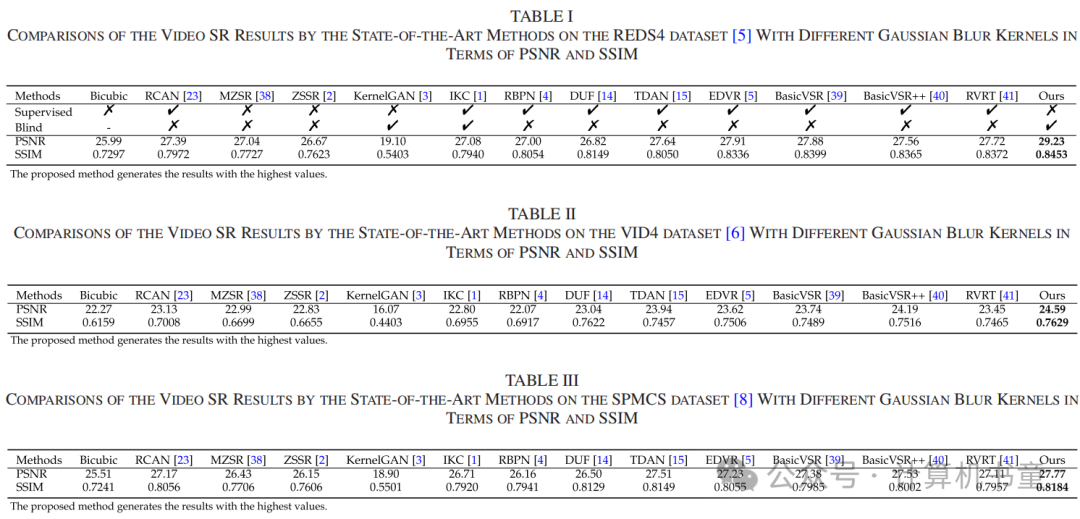

A. 定量评估

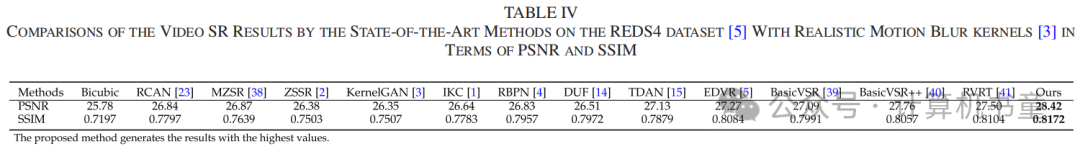

表I-III展示了在不同高斯模糊核下,我们的算法在基准数据集上的定量评估结果,其中我们的方法生成的结果具有比现有方法更高的峰值信噪比(PSNR)和结构相似性指数(SSIM)值。我们注意到,RCAN [23]方法没有生成高质量的超分辨率结果,因为它假设模糊核是已知的。尽管盲图像超分辨率方法[1]、[3]涉及模糊核估计,但它们是为单图像设计的,并且在视频超分辨率问题上表现不佳。结果表明,我们的方法的PSNR值至少比这些盲图像超分辨率方法高出1.06 dB。对于基于监督学习方法的非盲视频超分辨率方法[4]、[5]、[14]、[15]、[39]、[40]、[41],由于它们假设模糊核是已知的,并且在具有固定退化(例如,双三次下采样)的数据集上训练深度模型,它们在未知模糊核的盲视频超分辨率设置下表现不佳。相反,我们的方法明确涉及模糊核估计,并以自监督的方式解决深度模型。因此,它能够在没有成对或非成对训练数据集的情况下生成有利的结果。

我们进一步在表IV中评估了我们的方法在模糊核是复杂的现实运动模糊核[3]时的性能。我们注意到,基于自监督学习算法的方法[2]、[3]、[38],监督图像超分辨率[1]、[23]和监督视频超分辨率方法[4]、[5]、[14]、[15]、[39]、[40]、[41]没有生成好的结果。相比之下,我们的方法生成的结果具有更高的PSNR和SSIM值,这表明我们的方法与现有方法相比具有更好的泛化能力。

B. 定性评估

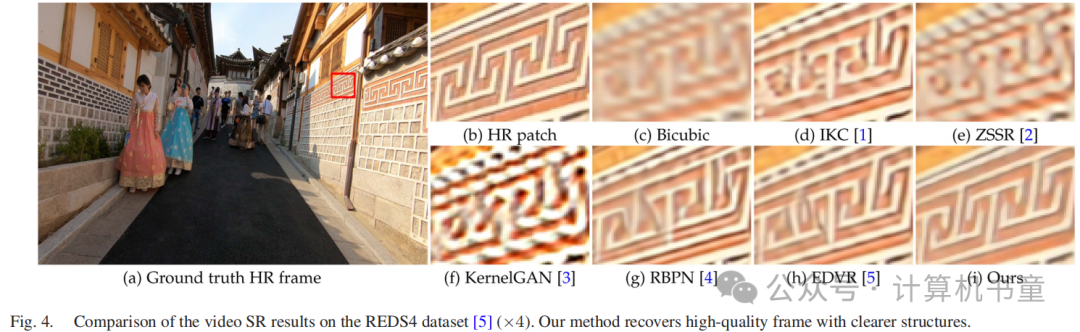

图4显示了在REDS4数据集[37]上,评估方法生成的超分辨率结果的一些视觉比较,放大倍数为4。我们注意到,ZSSR方法[2]没有生成更清晰的图像,因为它没有涉及模糊核估计(见图4(e))。尽管KernelGAN方法[3]从低分辨率图像中明确估计模糊核,并可以使用ZSSR方法进行图像超分辨率,但生成的结果包含由于模糊核不完美而产生的显著伪影(见图4(f))。为了纠正模糊核的错误,IKC方法[1]开发了一种有效的迭代核校正方法。尽管超分辨率结果的质量有所提高(见图4(d)),但结构细节仍未很好地恢复,因为该方法不是为视频超分辨率问题设计的。尽管RBPN方法[4]和EDVR方法[5]是为解决视频超分辨率问题而开发的,但这些方法假设模糊核是已知的,并且不能很好地解决盲视频超分辨率问题,如图4(g)和(h)所示。相反,尽管我们的方法不需要高分辨率视频作为监督,但它生成了更清晰的帧,并具有更好的结构细节,如图4(i)所示。这进一步证明了我们的方法在盲视频超分辨率问题上的有效性。

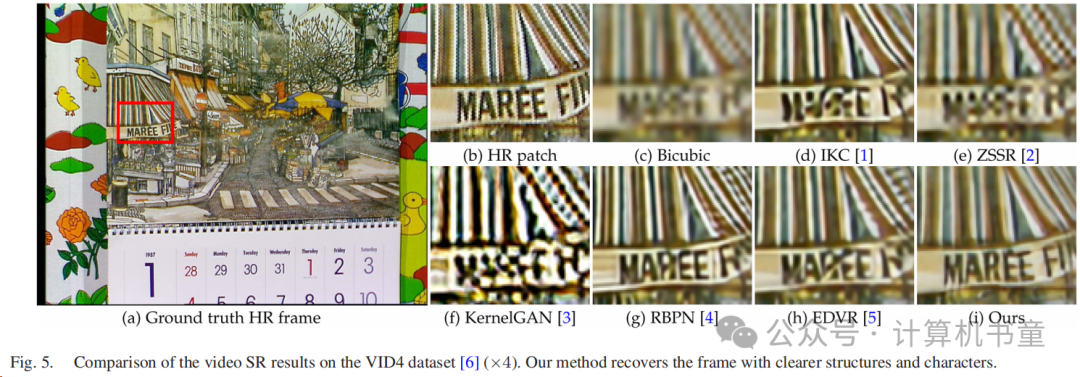

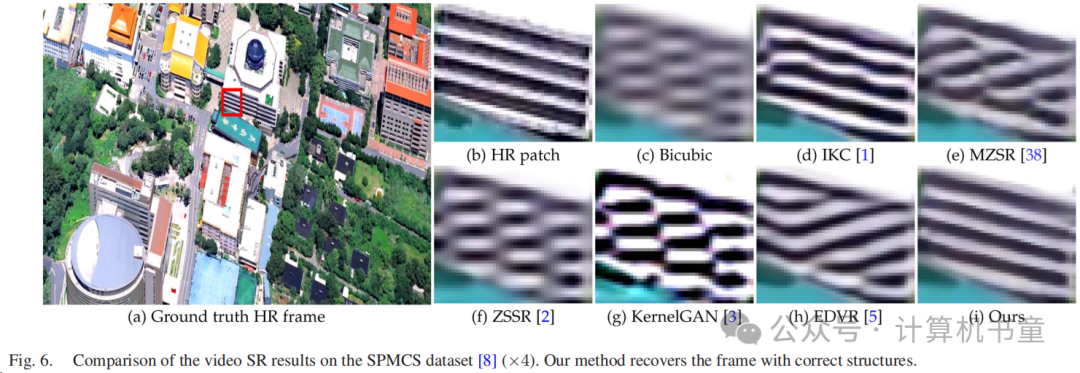

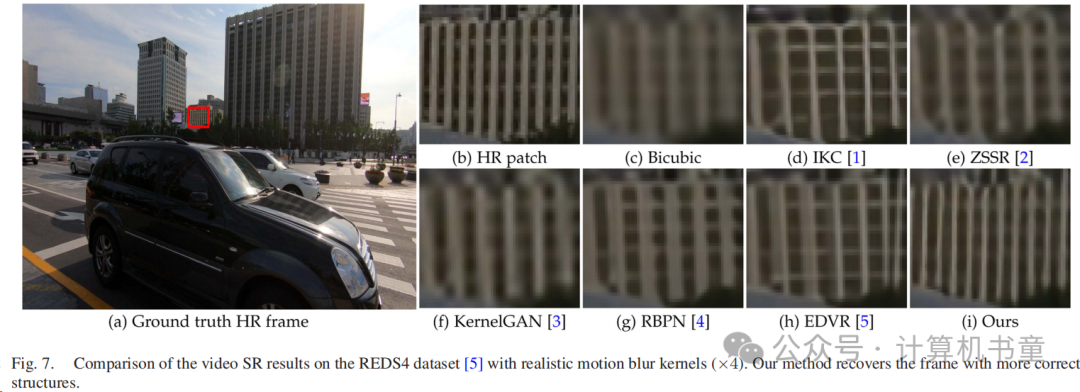

图5和图6分别展示了来自VID4数据集[6]和SPMCS数据集[8]的一些示例。我们的方法生成了具有更精细细节的帧,其中恢复帧中的人物是可识别的。此外,图7展示了在具有现实运动模糊核的REDS4数据集[5]上的视觉比较。我们注意到,由于下采样操作,建筑物边界的模糊方向使这些最先进的方法失败,而我们的方法生成了具有正确建筑物边界方向的更好结果。

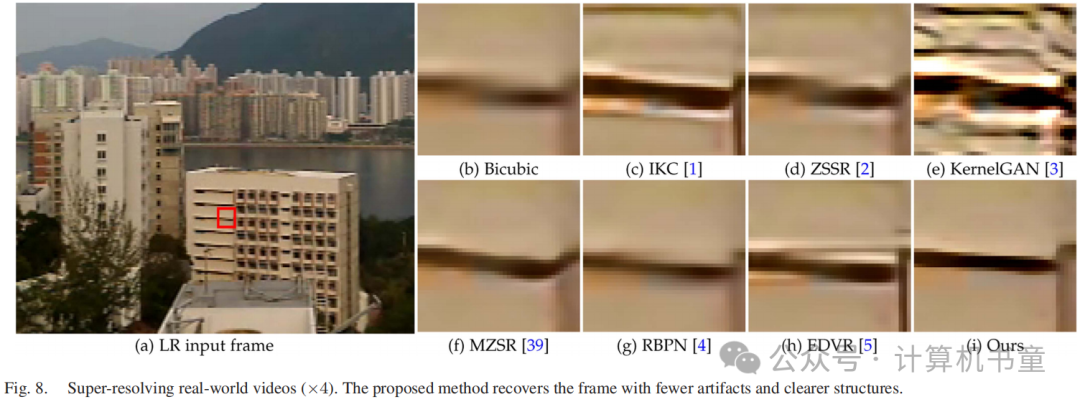

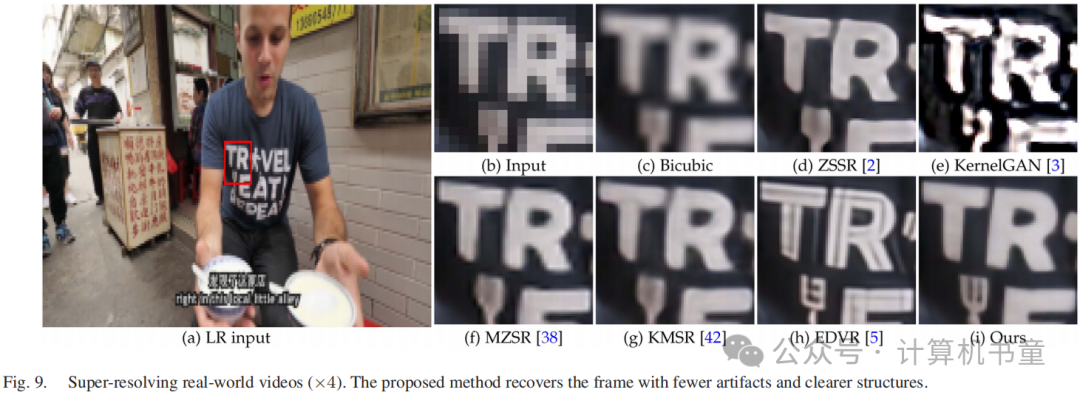

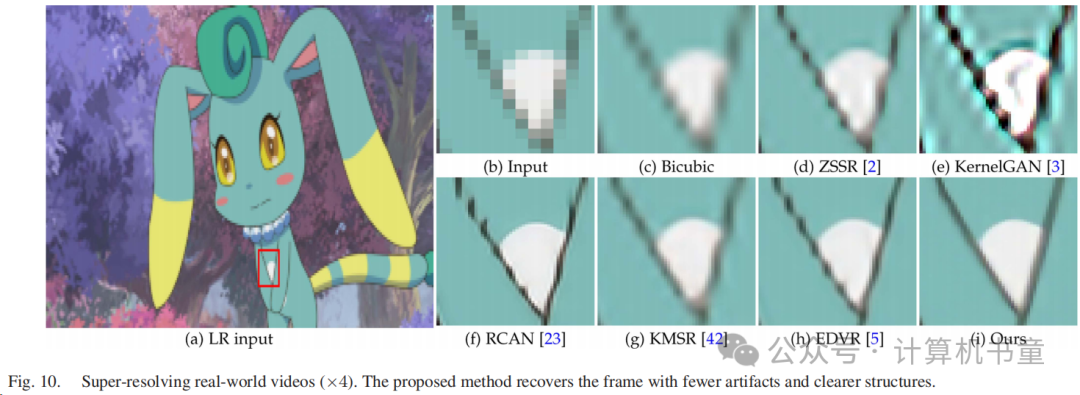

我们进一步在真实世界的视频上评估了我们的方法,并在图8-10中展示了视觉结果。我们注意到,现有的最先进的方法没有很好地恢复结构细节,其中恢复的结果仍然模糊或包含显著的伪影。相比之下,我们的算法生成了更清晰的帧。有关真实世界视频的更多比较可以在补充材料中找到。

V. 分析与讨论

本节中,我们对所提出的自监督学习方法进行了进一步分析,并讨论了与密切相关方法的主要区别。

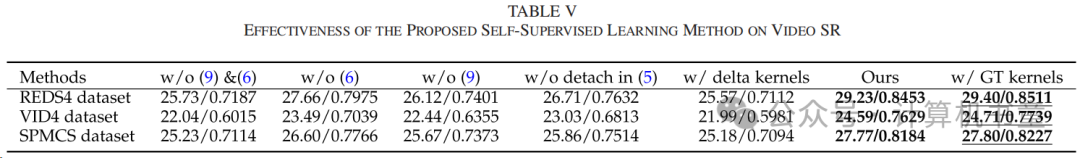

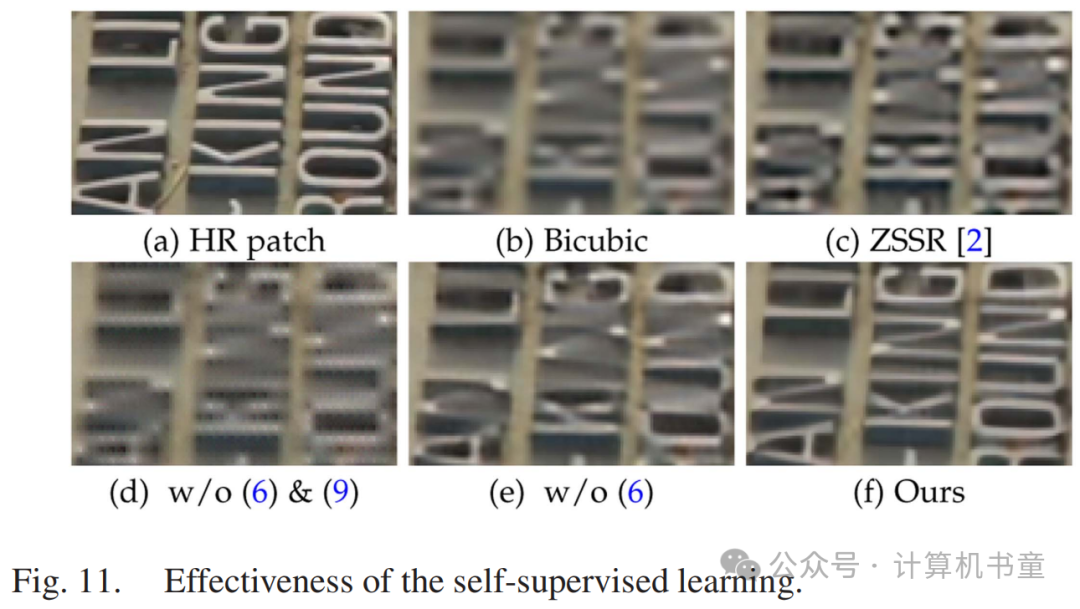

A. 自监督学习的有效性

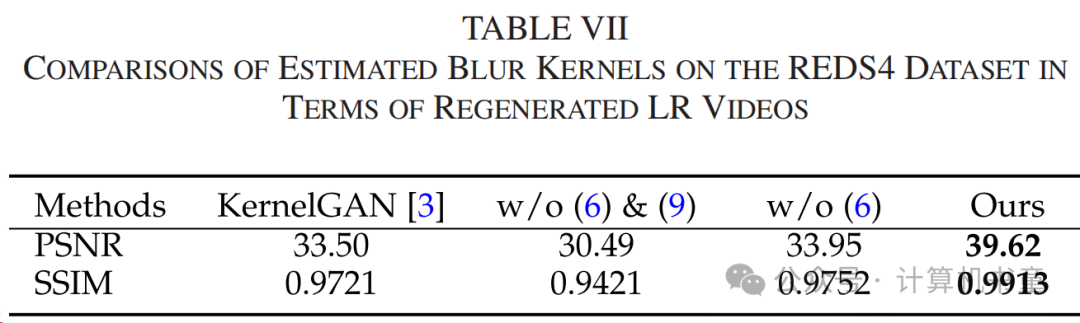

为了证明所提出的自监督学习的有效性,我们在公平比较中禁用了所提出方法中的约束(9)和(6)。表V显示了在基准数据集上的定量评估结果。我们注意到,没有约束(9)和(6)的方法没有生成高质量的视频。该基线方法的PSNR值至少比所提出方法低2.54 dB,这表明所提出的自监督学习在视频超分辨率问题上是有效的。图11(d)显示了没有约束(9)和(6)的方法估计的超分辨率结果,其中恢复的图像中存在显著的伪影。此外,表VII显示了使用估计的模糊核重新生成的低分辨率视频的质量,我们的方法的PSNR值比禁用约束(6)的基线方法高5.67 dB,这表明使用估计的模糊核可以更好地构建辅助监督约束。以上结果表明,尽管约束(6)有利于稀疏模糊核,但当与数据保真项(即约束(5)和(9))一起使用时,它可以在低通滤波器上很好地工作。

此外,我们注意到,仅使用约束(5)和(6)的方法(即表V中的“w/o (9)”)没有生成好的结果,其中该基线方法的PSNR值至少比所提出方法低2.10 dB。这表明使用所提出的辅助监督约束(9)能够在没有真实视频的情况下帮助视频超分辨率。

我们进一步验证任意模糊核是否也能使所提出的自监督训练有效。我们用两种模糊核替换了估计的模糊核:1)使模糊过程不存在的delta核;2)作为上限的真值核。我们使用与我们的方法相同的设置重新训练了这两个基线。我们注意到,使用delta核的方法(即表V中的“w/ delta kernels”)表现不佳,其中该基线方法的PSNR值至少比我们的方法低2.59 dB。相比之下,使用估计的模糊核的我们的方法能够与使用真值核的上限方法(即表V中的“w/ GT kernels”)生成相当的结果。这表明估计的模糊核对网络训练至关重要,使用任意模糊核不能使自监督学习有效。

我们注意到,在约束(5)中的下采样操作丢弃了xi中的大部分像素,这意味着只有xi中的一小部分像素可以受到约束。这可能会阻碍网络在没有真实约束的情况下正确学习。此外,(5)同时约束了模糊核估计网络和潜在高分辨率帧恢复网络,这可能会使两个网络相互妥协,使训练过程不稳定。由于约束(9)可以有效地规范网络,我们使用detach操作(由‘torch.Tensor.detach’实现的stop-gradient操作)阻止约束(5)更新网络,约束(5)仅用于规范网络。为了证明这种detach操作在(5)中的有效性,我们禁用此操作并重新训练这个基线方法(即表V中的“w/o detach”)。结果表明,这个基线方法的PSNR值至少比所提出方法低1.56 dB,这验证了在网络训练过程中这种detach操作的必要性。

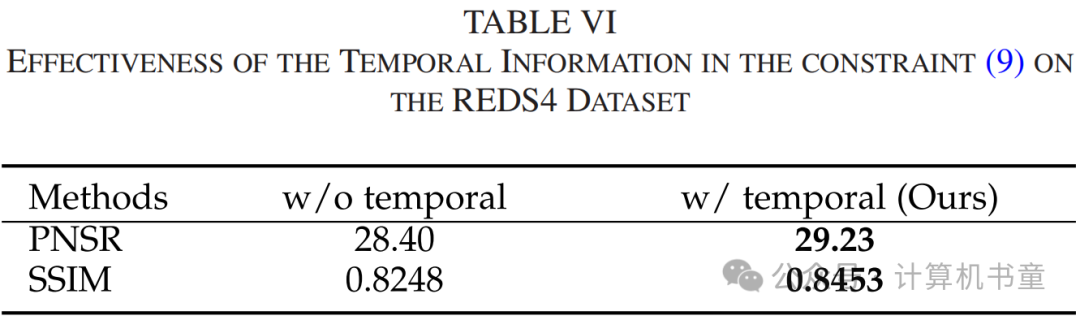

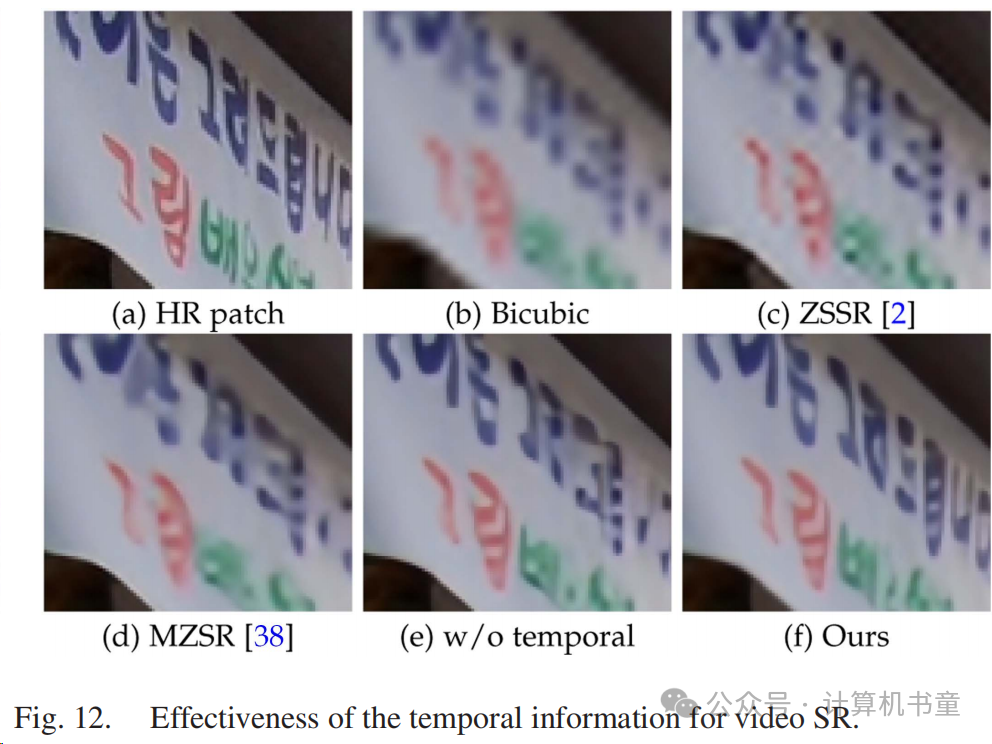

B. 与非成对和自监督学习图像超分辨率方法的关系

我们注意到,一些方法[2]、[3]开发了有效的自监督学习方法,基于深度神经网络来解决单图像超分辨率问题。在[2]中,Shocher等人开发了一种有效的图像特定CNN模型来解决单图像超分辨率问题,这是通过零样本学习算法实现的。在训练过程中,该方法首先从输入低分辨率图像的较低分辨率学习LR到HR的映射函数,然后将学习到的映射函数应用于输入低分辨率图像以恢复潜在的高分辨率图像。这种训练策略与我们的约束(9)相似。然而,所提出的约束(9)隐含地包含了时间信息,可以利用相邻帧的有用特征进行更好的视频超分辨率。如果不使用时间信息,所提出的方法将不会生成更好的结果。为了验证这一点,我们使用原始生成的辅助低分辨率帧的特征而不是在(9)中进行比较(简称为“w/o temporal”)。表VI显示,直接使用原始生成的辅助低分辨率帧的特征而不是在(9)中不会生成好视频。图12(e)和(f)的比较表明,如果不使用时间信息,则不会生成清晰的超分辨率图像。这表明有效地利用多个输入帧的时间信息对于盲视频超分辨率很重要。

此外,ZSSR方法没有涉及模糊核估计。尽管其性能可以通过使用[3]中的模糊核显著提高,但超分辨率图像将受到不准确核的影响。相比之下,我们的方法明确涉及模糊核估计,其中模糊核估计、光流估计和视频帧恢复在统一框架中同时解决。因此,它可以更好地减少不准确核的影响。

我们进一步注意到,Maeda [16]开发了一种有效的基于非成对数据的图像超分辨率算法,其中网络训练不需要相应的高分辨率图像。该方法需要几个网络从额外的示例数据集中生成伪监督以训练网络。然而,使用更多的网络将相应地增加网络训练的难度。相比之下,我们的方法不需要任何其他额外的示例数据集,我们的视频退化约束没有引入额外的网络,这使得训练过程比[16]更容易。此外,[16]中的方法专为单图像超分辨率设计,不能直接扩展到盲视频超分辨率问题。

C. 辅助合成低分辨率视频的准确性

由于我们没有任何高分辨率视频作为监督,我们提出估计模糊核和光流,以探索基于图像形成模型(1)的低分辨率视频中的有效约束。因此,估计的模糊核主要用于生成合成的低分辨率视频,以构建辅助监督约束(9),这可以规范深度模型以更好地恢复高分辨率视频。

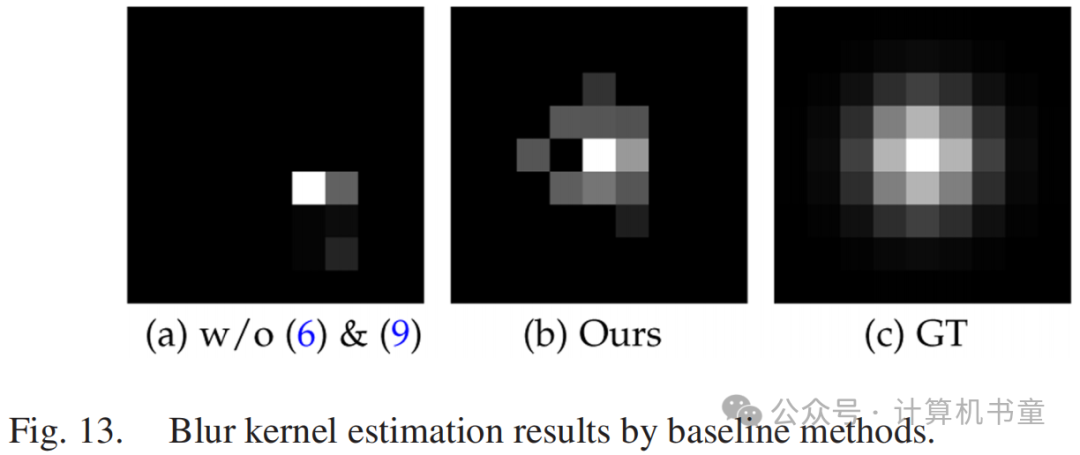

表VII显示,使用估计的模糊核合成的低分辨率视频的质量优于使用模糊核[3]生成的视频。结果还表明,所提出的方法生成了更好的模糊核,能够有效地模拟图像形成模型中的模糊过程(重新合成的低分辨率视频的平均PSNR值为39.62)。尽管所提出的方法没有专注于准确恢复模糊核,我们仍然在图13中可视化了估计的模糊核。它显示,所提出的约束(9)和(6)能够改进模糊核估计。

D. 在真实场景中的在线微调

由于我们的方法不需要真实高分辨率视频作为监督,真实世界退化的视频可以用来以自监督的方式微调我们的方法,以获得更好的泛化能力。因此,我们的方法可以在线微调。为了验证这一特性,我们随机选择了10个来自网站的真实退化视频,并使用它们以自监督的方式微调所提出的模型。

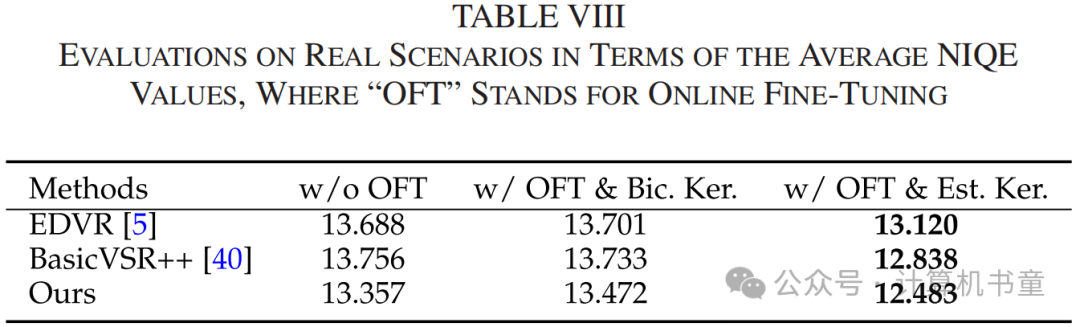

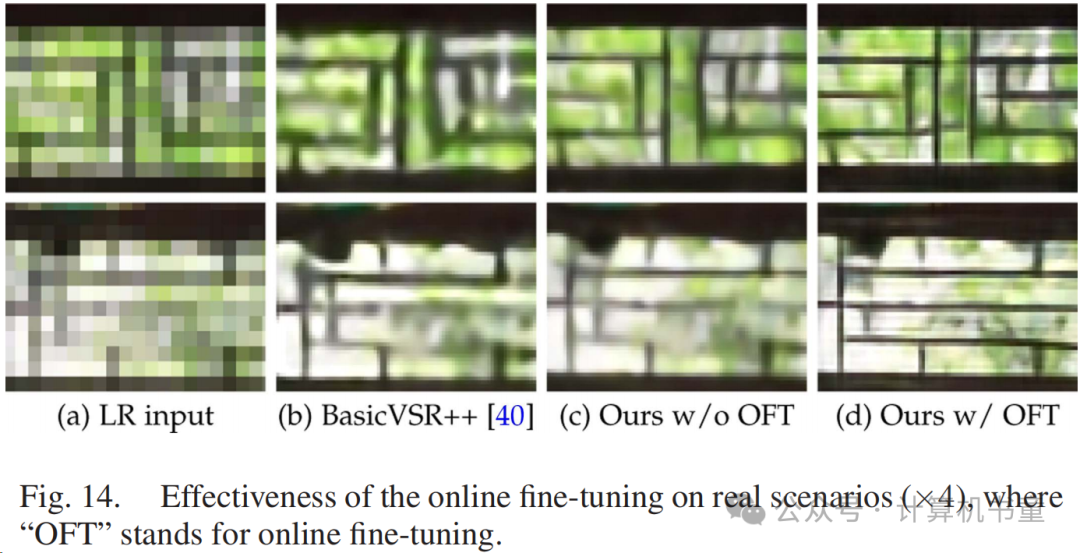

由于没有相应的真实高分辨率视频,我们使用非参考度量NIQE [43]来评估所提出的方法。表VIII显示,我们的方法生成的结果比监督视频超分辨率方法[5]、[40]具有更好的视觉感知质量。此外,使用所提出的自监督方法在退化视频上微调预训练的视频超分辨率模型(包括我们的模型和现有的视频超分辨率模型[5]、[40])能够在这些真实场景中生成更好的结果(见表VIII中的“w/ OFT & Est. Ker.”)。图14展示了一些视觉结果,其中我们的方法使用真实退化视频进行微调生成了具有更精细结构的更好结果(见图14(d))。此外,为了验证在线微调引起的性能改进是否由于网络适应了未见过视频的“内容”,我们使用预定义的模糊核(即双三次核)而不是所提出的核估计网络来微调所提出的模型。表VIII显示,使用预定义的模糊核表现不佳(见表VIII中的“w/ OFT & Bic. Ker.”),这表明性能提升是由于所提出的自监督方法,而不是适应视频内容。

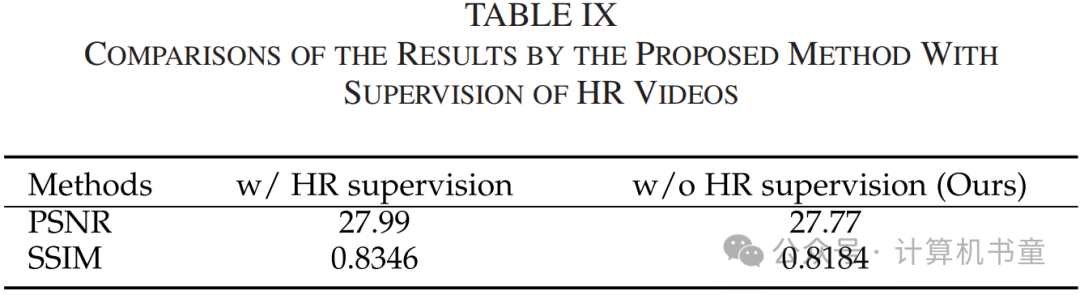

E. 使用高分辨率视频作为监督的所提出方法的评估

由于所提出的方法旨在解决没有真实高分辨率视频可用的盲视频超分辨率问题,因此有趣的是检查如果使用高分辨率视频来监督所提出网络的训练,所提出的方法是否也能很好地工作。为此,我们使用低分辨率视频及其相应的高分辨率视频来训练所提出的网络,其中应用了常用的基于L1范数的损失函数,以确保网络输出接近高分辨率帧。表IX显示,没有使用高分辨率视频作为监督的所提出方法与使用高分辨率视频作为监督的方法在SPMCS数据集上生成的结果相当,这进一步表明所提出的自监督学习方法能够在没有真实视频的情况下解决盲视频超分辨率问题。

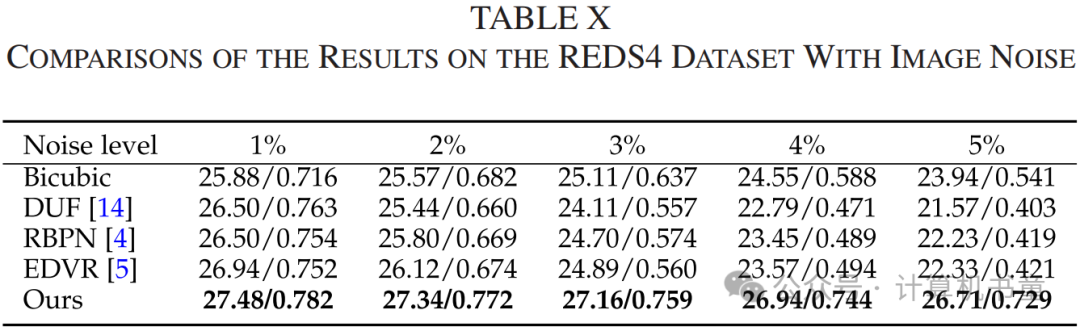

F. 对图像噪声的鲁棒性

我们进一步在数据集上评估了我们的方法对图像噪声的鲁棒性。我们以第III-E2节中提到的方式向每个低分辨率帧添加高斯噪声,噪声水平范围从0%到10%。我们在具有噪声的数据集上训练所提出的方法,并在添加了1%到5%高斯噪声的REDS4数据集上进行评估。表X显示,当测试数据集包含图像噪声时,我们的方法生成了具有最高PSNR和SSIM值的结果,表明所提出的方法在一定程度上对噪声具有鲁棒性。

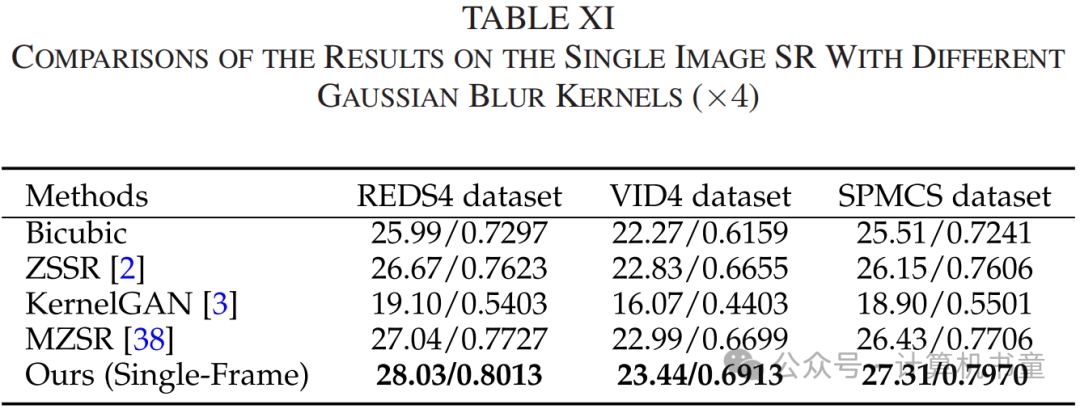

G. 对盲图像超分辨率问题的所提出方法的评估

为了检查所提出的自监督学习是否适用于盲图像超分辨率问题,我们从VSR网络中移除了光流估计模块,并从单个输入低分辨率图像中估计潜在的高分辨率帧和模糊核。我们使用与所提出方法相同的训练设置重新训练这个基线方法。表XI显示,与现有的图像超分辨率方法相比,我们的方法生成了具有更高PSNR和SSIM值的结果。

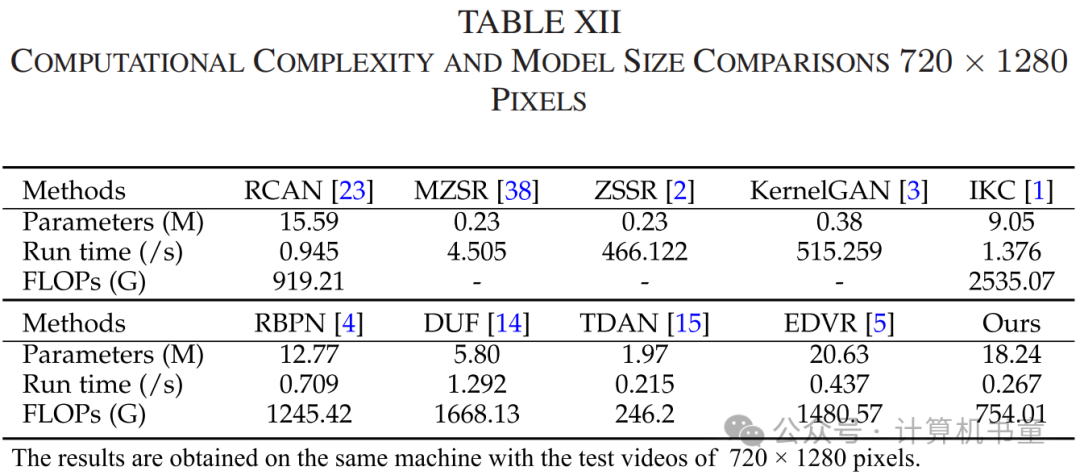

H. 模型大小、运行时间和计算复杂度比较

我们进一步比较了我们的方法与最先进的方法在模型参数、运行时间和浮点运算(FLOPs)方面的模型复杂度。这些指标是在配备有Intel Core i7-7700 CPU和NVIDIA GTX 1080Ti GPU的同一台机器上测试的,其中输入视频的空间分辨率为720 × 1280像素。由于方法MZSR [38]、ZSSR [2]和KernelGAN [3]在推理期间需要通过多次反向传播更新参数,我们没有报告它们的FLOPs值。表XII显示,我们的方法比大多数比较的方法更有效。

I. 局限性分析和未来工作

为了避免在没有真实高分辨率视频作为监督时直接最小化(5)时引起的平凡解决方案,我们首先探索了估计模糊核的稀疏属性,然后使用估计的模糊核和原始低分辨率输入视频生成辅助配对数据,以约束潜在高分辨率视频恢复过程。第V-C节的分析表明,所提出的自监督学习可以提高生成的辅助配对数据的准确性。然而,如图13(b)所示,估计的模糊核与真实核之间仍然存在一定的差距。尽管所提出的方法只关注生成的辅助配对数据的准确性,而不是估计的模糊核,未来的工作将研究如何估计更准确的模糊核,以便进一步提高所提出自监督方法的性能。

此外,尽管基于图像形成模型(1)的方法可以在一定程度上处理一些真实世界的例子,如图8-10所示,但它并不涉及非线性退化,例如通常存在于真实世界退化过程中的相机响应函数。未来的工作将研究如何将所提出的自监督学习扩展到考虑非线性退化操作的更复杂的退化模型。

VI. 结论

我们提出了一种基于自监督学习方法的有效视频超分辨率方法,并开发了一种简单有效的方法,从原始低分辨率输入视频中生成辅助配对数据以约束网络训练。我们引入了一个光流估计模块,以利用相邻帧的信息以更好地恢复高分辨率视频。我们已经展示了我们的方法也可以采用现有的监督深度视频超分辨率模型在没有真实高分辨率视频时进行性能改进。通过以端到端的方式训练所提出的算法,我们已经展示了它在基准数据集和真实世界视频上与最新技术方法相比具有优势。

声明

本文内容为论文学习收获分享,受限于知识能力,本文对原文的理解可能存在偏差,最终内容以原论文为准。本文信息旨在传播和学术交流,其内容由作者负责,不代表本号观点。文中作品文字、图片等如涉及内容、版权和其他问题,请及时与我们联系,我们将在第一时间回复并处理。

下载1:OpenCV-Contrib扩展模块中文版教程

在「小白学视觉」公众号后台回复:扩展模块中文教程,即可下载全网第一份OpenCV扩展模块教程中文版,涵盖扩展模块安装、SFM算法、立体视觉、目标跟踪、生物视觉、超分辨率处理等二十多章内容。

下载2:Python视觉实战项目52讲

在「小白学视觉」公众号后台回复:Python视觉实战项目,即可下载包括图像分割、口罩检测、车道线检测、车辆计数、添加眼线、车牌识别、字符识别、情绪检测、文本内容提取、面部识别等31个视觉实战项目,助力快速学校计算机视觉。

下载3:OpenCV实战项目20讲

在「小白学视觉」公众号后台回复:OpenCV实战项目20讲,即可下载含有20个基于OpenCV实现20个实战项目,实现OpenCV学习进阶。

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~

270

270

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?