深度学习-处理多维度特征的输入 -Multiple Dimension Input-自用笔记6

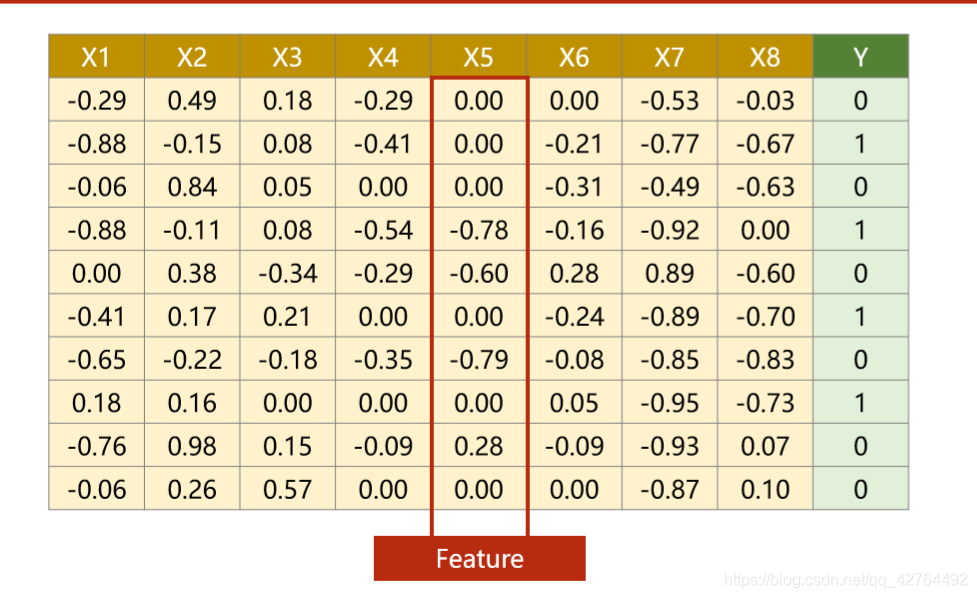

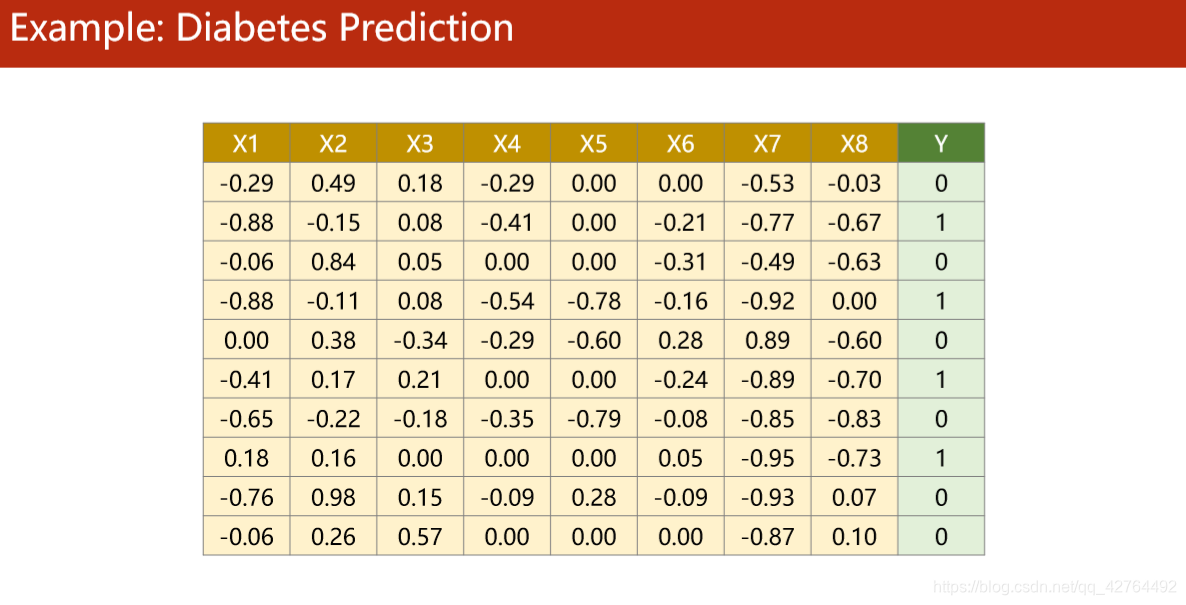

多维度特征的数据集

每一行代表一个样本,每一列代表一重要特征Feature

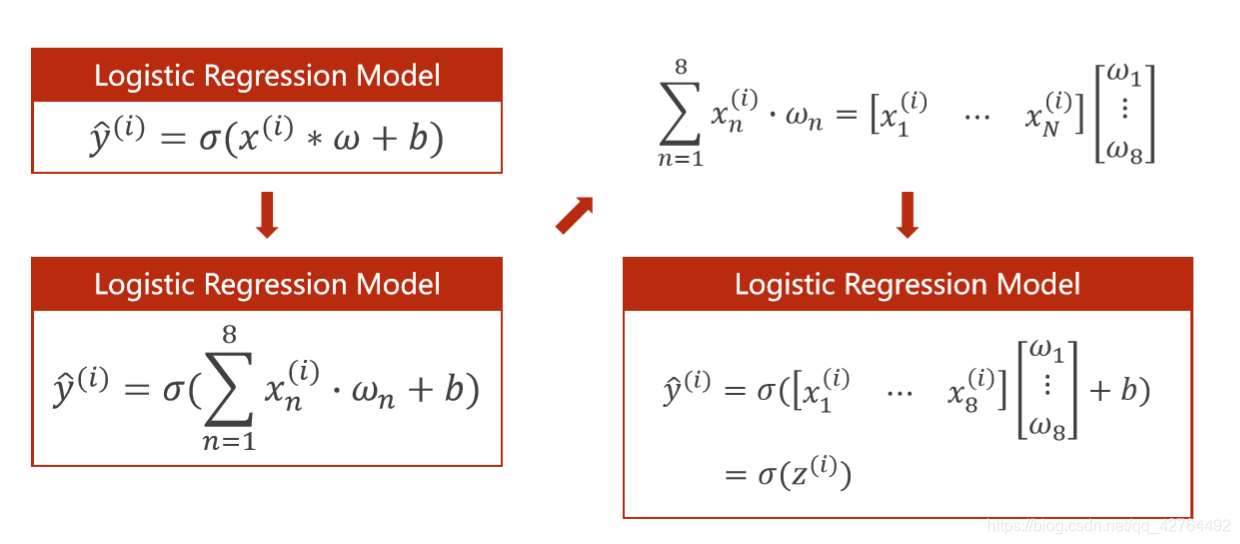

一个样本特征多个的计算图如图所示

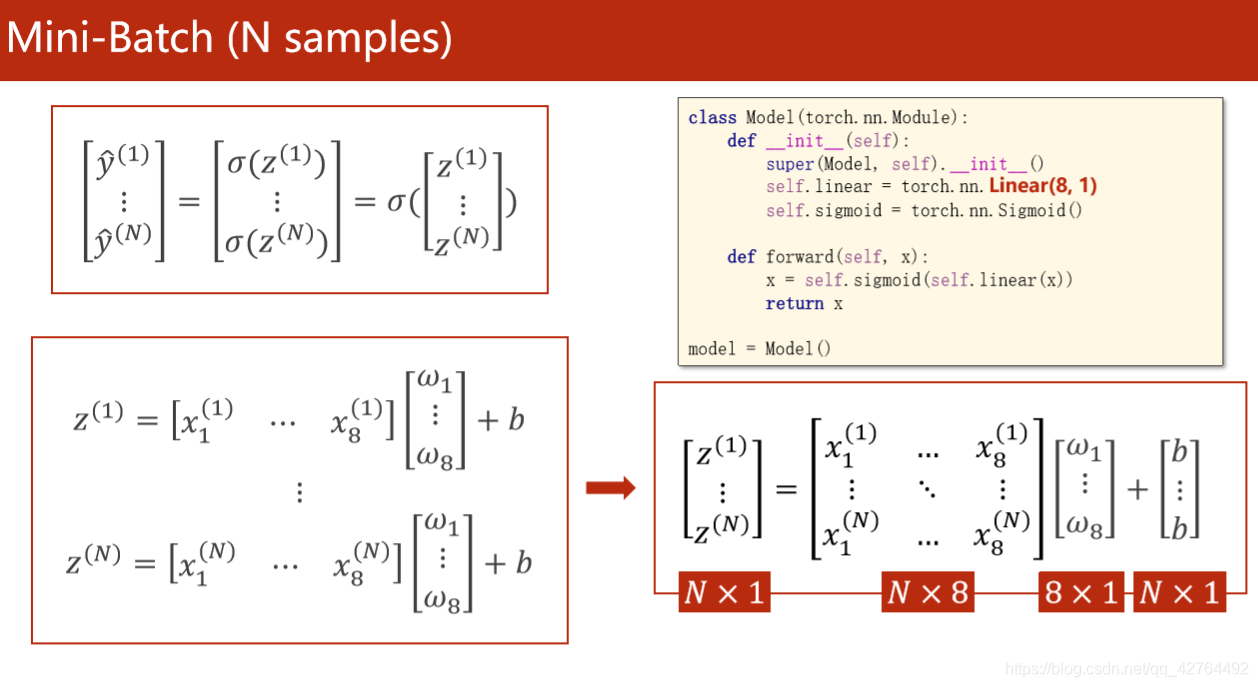

多个样本多个特征的计算图如图所示

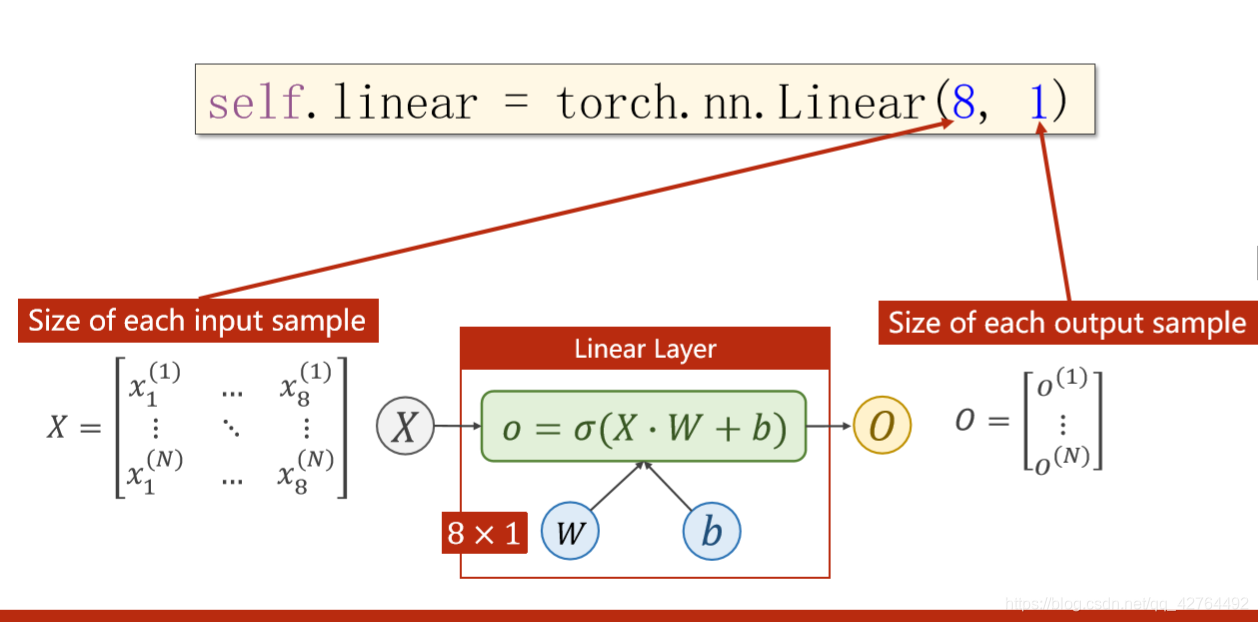

模型采用一层线性函数self.linear = torch.nn.Linear(8, 1),函数的输入的特征维度为8,输出的维度为1,如下图

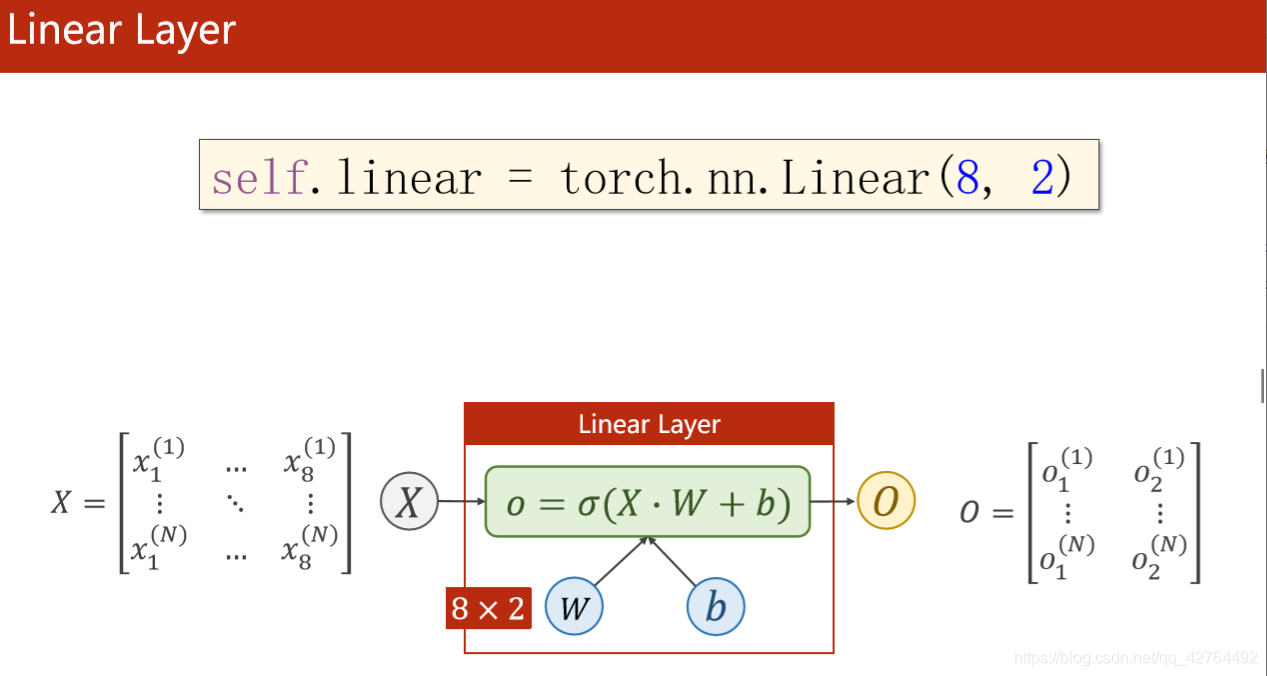

若线性层函数采用输入的特征维度为8,输出的维度为2,如下图:

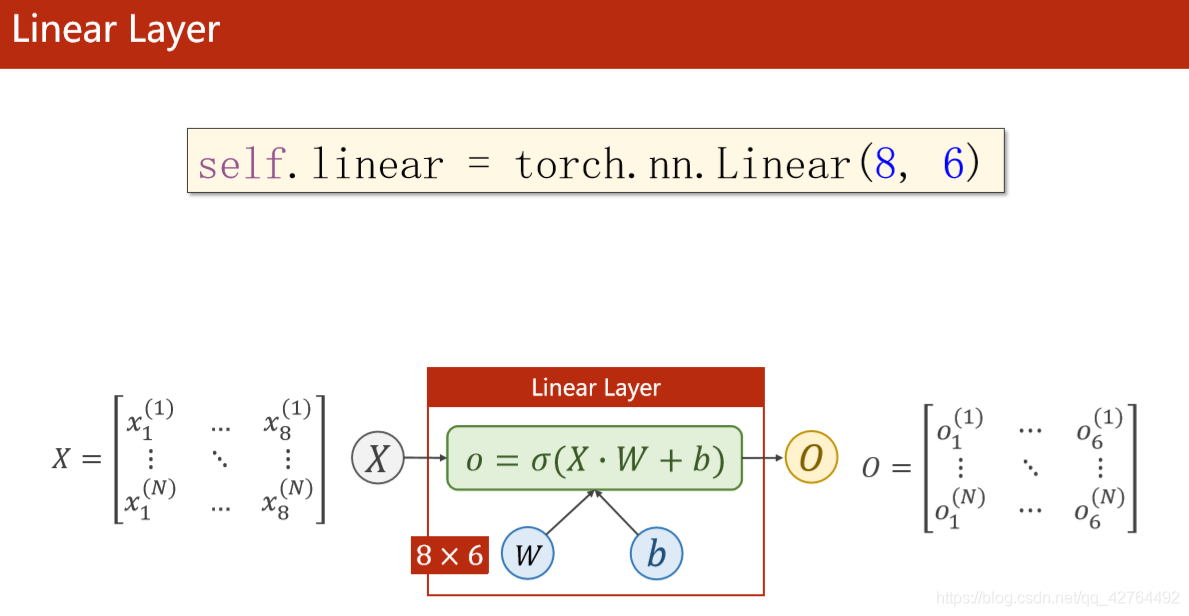

若线性层函数采用输入的特征维度为8,输出的维度为6,如下图:

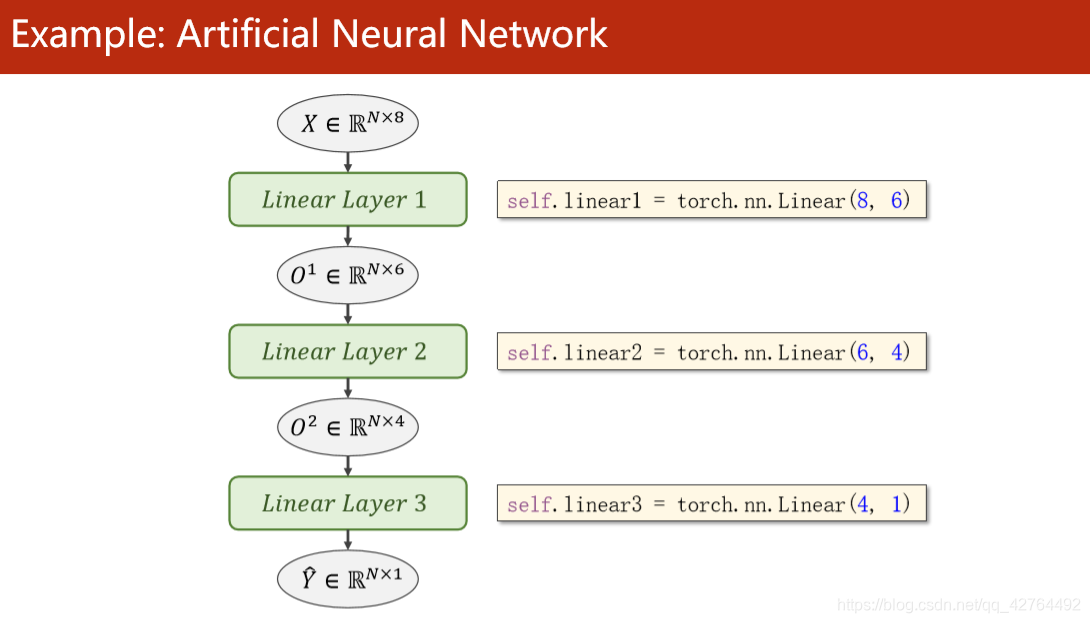

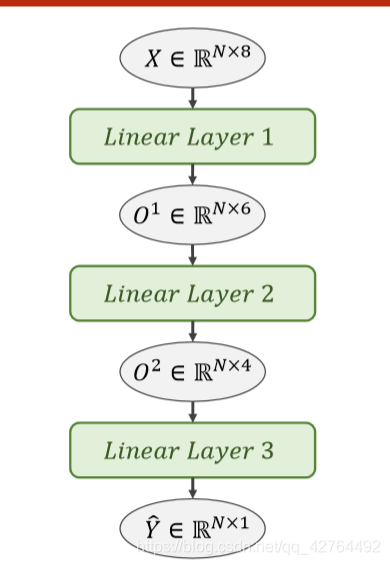

多层神经网络的计算图

将三个一层的神经网络叠加在一起变成三层的神经网络

例如:

举例子+程序代码

- Prepare Dataset

import numpy as np

xy = np.loadtxt('diabetes.csv.gz', delimiter=',', dtype=np.float32)

x_data = torch.from_numpy(xy[:,:-1])

y_data = torch.from_numpy(xy[:, [-1]])

- Define Model

代码

import torch

class Model(torch.nn.Module):

def __init__(self):

super(Model, self).__init__()

self.linear1 = torch.nn.Linear(8, 6)

self.linear2 = torch.nn.Linear(6, 4)

self.linear3 = torch.nn.Linear(4, 1)

self.sigmoid = torch.nn.Sigmoid()

def forward(self, x):

x = self.sigmoid(self.linear1(x))

x = self.sigmoid(self.linear2(x))

x = self.sigmoid(self.linear3(x))

return x

model = Model()

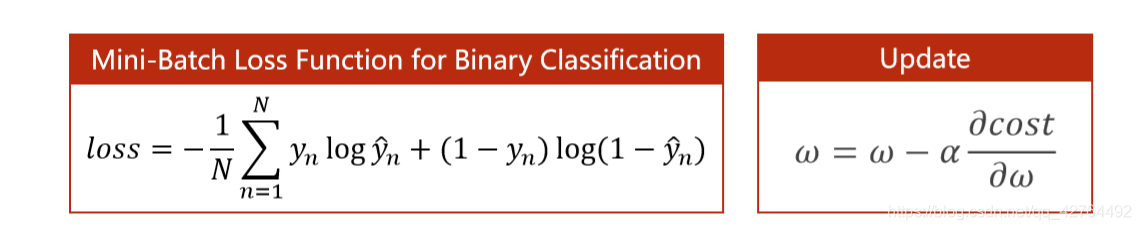

- Construct Loss and Optimizer

代码

criterion = torch.nn.BCELoss(size_average=True)

optimizer = torch.optim.SGD(model.parameters(), lr=0.1)

- Training Cycle

代码

for epoch in range(100):

# Forward

y_pred = model(x_data) l

oss = criterion(y_pred, y_data)

print(epoch, loss.item())

# Backward

optimizer.zero_grad()

loss.backward()

# Update

optimizer.step()

注意:(激活函数种类很多,采用RuLU激活函数时需要注意)

现在非常流行使用RuLU激活函数,但是RuLU存在的问题是当激活函数的输入为小于0时,激活函数的梯度就变为0,不会继续更新维度,所以采用RuLU需要注意。

一般如果做分类,采用RuLU激活函数都是在前面的层数,最后一层激活函数不要使用RuLU,一般会采用sigmoid的。

import torch

import numpy as np

import torch.nn.functional as F

xy = np.loadtxt('diabetes.csv.gz', delimiter=',', dtype=np.float32) #np.loadtxt该语句可以从csv文件中读取数据,也可从csv文件的gz压缩文件中读取

x_data = torch.from_numpy(xy[:,:-1]) #取全部行和除了最后一列的全部列的数据

y_data = torch.from_numpy(xy[:, [-1]])#只取最后一列的数据,并列为一列矩阵,torch.from_numpy该语句的意思是将数组转换成tensor类型。

class Model(torch.nn.Module):

def __init__(self):

super(Model, self).__init__()

self.linear1 = torch.nn.Linear(8, 6)

self.linear2 = torch.nn.Linear(6, 4)

self.linear3 = torch.nn.Linear(4, 1)

self.activate = torch.nn.ReLU()

def forward(self, x):

x = self.activate(self.linear1(x))

x = self.activate(self.linear2(x))

x = F.sigmoid(self.linear3(x))

return x

model = Model()

# ------------------------------------------------------- #

criterion = torch.nn.BCELoss(size_average=True)

optimizer = torch.optim.SGD(model.parameters(), lr=0.1)

# ------------------------------------------------------- #

for epoch in range(10000):

# Forward

y_pred = model(x_data)

loss = criterion(y_pred, y_data)

print(epoch, loss.item())

# Backward

optimizer.zero_grad()

loss.backward()

# Update

optimizer.step()

1225

1225

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?