论文链接:https://arxiv.org/pdf/1811.06031.pdf

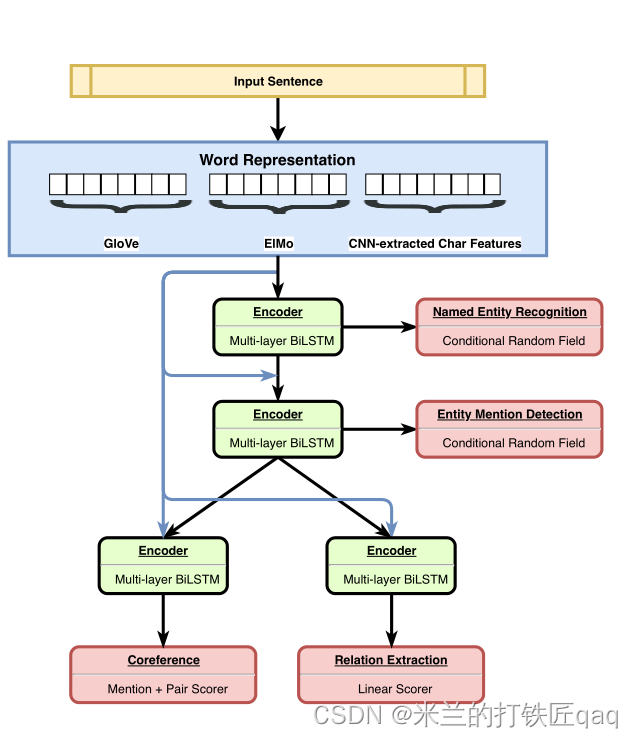

word embedding:用三种向量来表示,glove,eImo,CNN-feature 连接得到向量ge

NER:bilstm+crf(第一层encoder) 得到向量gner

Entity Mention Detection:bilstm+crf(第二层encoder) 将[ge,gner]拼接作为输入 检测实体的指代词 比如说[妈妈,她]

predicate layer:编码器将[ge,gemd]的连接作为输入,并输出表示为gcr的表示

Coreference Resolution :共指消解,该文章是基于span的,mention为枚举出来的,本文设置了一个打分机制,从而将候选的共同提及与其他区间区分开来,编码器将[ge,gemd]的连接作为输入,并输出表示为gcr的表示,然后将这些表示提供给mention pair计分器。

RE:RE编码器是一个多层BiLSTM,它以[ge,gemd]为输入,输出gre,对gre进行分类

919

919

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?